Datawhale----初级算法梳理(Task_3)

决策树算法梳理

- 信息论基础

-

- 熵

- 联合熵

- 条件熵

- 信息增益

- 基尼不纯度

- 决策树的不同分类算法的原理及其应用场景

-

- ID3算法

- C4.5

- CART分类树

- 回归树原理

- 决策树防止过拟合手段.

- 模型评估

- sklearn参数详解,Python绘制决策树

信息论基础

熵

描述随机变量的不确定性,若p表示其分布,则 H ( X ) = − ∑ i = 1 n p ( x ) l o g ( p ( x ) ) H(X)=-\sum_{i=1}^{n}p(x)log(p(x)) H(X)=−∑i=1np(x)log(p(x))

联合熵

两个随机变量X,Y的联合分布,用H(X,Y)表示 H ( X , Y ) = ∑ x ∈ X ∑ y ∈ Y p ( x , y ) l o g p ( x , y ) H(X,Y)=\sum_{x\in X}^{}\sum_{y\in Y}^{}p(x,y)logp(x,y) H(X,Y)=∑x∈X∑y∈Yp(x,y)logp(x,y)

条件熵

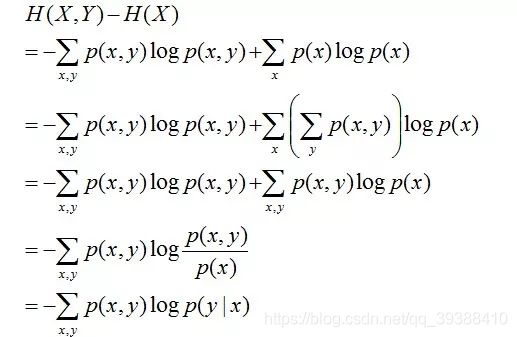

在随机变量X发生的前提下,随机变量Y发生所新带来的熵定义为Y的条件熵,用H(Y|X)表示,用来衡量在已知随机变量X的条件下随机变量Y的不确定性。且此时H(Y|X) = H(X,Y) – H(X)成立。

信息增益

信息增益就是熵和特征条件熵的差.即g(D,A)=H(D)-H(D|A)

对一个确定的数据集来说,H(D)是确定的,那H(D|A)在A特征一定的情况下,随机变量的不确定性越小,信息增益越大,这个特征的表现就越好

基尼不纯度

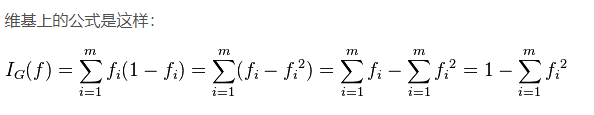

将来自集合中的某种结果随机应用于集合中某一数据项的预期误差率。大概意思是 一个随机事件变成它的对立事件的概率。

- 基尼不纯度越小,纯度越高,集合的有序程度越高,分类的效果越好;

- 基尼不纯度为 0 时,表示集合类别一致;

- 基尼不纯度最高(纯度最低)时, f 1 = f 2 = f 3 ⋯ f m = 1 m f_{1}=f_{2}=f_{3}\cdots f_{m}=\frac{1}{m} f1=f2=f3⋯fm=m1

I G ( f ) = 1 − ( 1 m ) 2 m = 1 − 1 m I_{G}(f)=1-(\frac{1}{m})^{2}m=1-\frac{1}{m} IG(f)=1−(m1)2m=1−m1

决策树的不同分类算法的原理及其应用场景

ID3算法

1970年代,一个叫J Ross Quinlan的人用信息论中的熵(entropy)来度量决策树的决策选择过程得到了很好的效果,这就是决策树最初的高效原型迭代Dichotomiser 3(Iterative Dichotomiser 3,ID3)。熵描述了事物的不确定性,越不确定的事物熵就越高,所以用它来度量可以尽可能的提升划分过程中分支结点的“纯度”(purity)。对于变量X的熵表示为:

H ( X ) = − ∑ i = 1 n p i l o g p i H(X)=-\sum_{i=1}^{n}p_{i}logp_{i} H(X)=−∑i=1npilogpi

其中n代表X取值,p为概率。考虑到不同分支结点所包含的样本树不同,可以赋予一定的权重W(即某属性a的个数S占整个数据集的比率),算出某属性a的信息增益(Information gain):

I ( X , a ) = H ( x ) − ∑ i = 1 n W H ( S ) I(X,a)=H(x)-\sum_{i=1}^{n}WH(S) I(X,a)=H(x)−∑i=1nWH(S)

有了度量方法,我们就可以循环计算当前可选的所有属性的信息增益,每次选择最大的那个特征,并枚举该特征的每一个可能值,对每个值都建立一颗子树,然后将该特征从待选特征表里删除,直至信息增益小于某个阈值或者已经没有特征可以用了。

- 应用场景

好朋友分类的决策

C4.5

C4.5算法对ID3改进如下,

-

不能处理连续特征。

对于连续值怎么计算信息熵?将连续的特征离散化就可以了。取相邻两样本值的平均数,共取n-1个划分点,对于这n-1个点,分别计算以该点作为二元分类点时的信息增益。选择信息增益最大的点作为该连续特征的二元离散分类点。这样我们就做到了连续特征的离散化。要注意的是,与离散属性不同的是,如果当前节点为连续属性,则该属性后面还可以参与子节点的产生选择过程。 -

结果容易偏向取值多的。

换一种度量方法。选用新的属性选择标准–信息增益和特征熵的比值。 -

缺失值处理。

宁缺毋滥。先将他们划入所有分支。 -

过拟合问题。

剪枝。一般有预剪枝(prepruning)或后剪枝(postpruning),预剪枝是在生成过程中,对每个结点在划分前进行估计,若当前结点的划分不能带来决策树泛化性能的提升,则停止划分并将当前结点标记为叶结点;后剪枝是先生成决策树后自底向上对非叶结点进行考察,若将该结点对应的子树替换为叶结点能带来决策树泛化性能的提高,则将该子树替换成叶结点。 -

C4.5还提供了决策树与等价规则集的转换功能,便于人更好的理解。

-

应用场景

用朋友的年龄值做特征

知道某些朋友在某些特征的取值

判断新好朋友

CART分类树

分类和回归树算法(Classification and regression tree,CART)对C4.5又进行了优化。正如它的名字,

CART既能做回归,也能做分类。

分类树的作用是通过一个对象的特征来预测该对象所属的类别,而回归树的目的是根据一个对象的信息预测该对象的属性,并以数值表示。所以如果是分类树,将选择能够最小化分裂后节点GINI值的分裂属性;如果是回归树,选择能够最小化两个节点样本方差–均方误差(均方误差越小即代表分类的数值很相近,效果就越好)的分裂属性。

回归树原理

回归树是可以用于回归的决策树模型,一个回归树对应着输入空间(即特征空间)的一个划分以及在划分单元上的输出值.与分类树不同的是,回归树对输入空间的划分采用一种启发式的方法,会遍历所有输入变量,找到最优的切分变量 j j j和最优的切分点s,即选择第 j j j个特征 x j x_{j } xj 和它的取值 s s s将输入空间划分为两部分,然后重复这个操作。

找到最优的 j j j和 s s s是通过比较不同的划分的误差来得到的。一个输入空间的划分的误差是用真实值和划分区域的预测值的最小二乘来衡量的。

决策树防止过拟合手段.

分类模型误差分为:训练误差(training error)、泛化误差(generalization error)。

一个好的模型需要有较低的泛化误差和训练误差。

- 奥卡姆剃刀(Occam’s razor):

给定两个具有相同泛化误差的模型,较简单的模型比较复杂的模型更可取。 - 悲观误差估计(pessimistic error estimate)

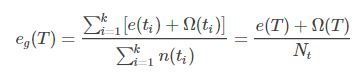

k是决策树的叶节点数目,e(T)为总训练误差,Nt为总训练样本数,Omega为罚项。

对二叉树来说,0.5的罚项意味着只要至少能够改善一个训练记录分类,结点就应当扩展,当1位罚项,意味着除非能够减少一个以上训练记录的误分类,否则结点不应当扩展。 - 先剪枝:

当达到某个条件,提前终止。例如:当观察到某个不纯度度量低于某个确定阈值时就停止扩展叶结点,但是,难点在于很难确定正确终止的阈值。 - 后剪枝:

初始按照最大规模生长,按照自底向上修剪决策树。修剪方式:

(1)子树替换(subtree replacement)用叶结点替代子树,叶结点的类标号为子树的多数类;

(2)子树提升(subtree raising)子树中最常使用的分支替代子树。后剪枝能产生更好的结果。

模型评估

sklearn参数详解,Python绘制决策树

-

重要参数:Criterion

这个参数正是用来决定不纯度的计算方法的。sklearn提供了两种选择:

1)输入”entropy“,使用信息熵(Entropy)

2)输入”gini“,使用基尼系数(Gini Impurity) -

重要参数: random_state & splitter

random_state用来设置分枝中的随机模式的参数,默认None,在高维度时随机性会表现更明显,低维度的数据(比如鸢尾花数据集),随机性几乎不会显现。输入任意整数,会一直长出同一棵树,让模型稳定下来。

splitter也是用来控制决策树中的随机选项的,有两种输入值,输入”best",决策树在分枝时虽然随机,但是还是会优先选择更重要的特征进行分枝(重要性可以通过属性feature_importances_查看),输入“random",决策树在分枝时会更加随机,树会因为含有更多的不必要信息而更深更大,并因这些不必要信息而降低对训练集的拟合。这也是防止过拟合的一种方式。当你预测到你的模型会过拟合,用这两个参数来帮助你降低树建成之后过拟合的可能性。当然,树一旦建成,我们依然是使用剪枝参数来防止过拟合。 -

剪枝参数

在不加限制的情况下,一棵决策树会生长到衡量不纯度的指标最优,或者没有更多的特征可用为止。这样的决策树往往会过拟合,这就是说,它会在训练集上表现很好,在测试集上却表现糟糕。我们收集的样本数据不可能和整体的状况完全一致,因此当一棵决策树对训练数据有了过于优秀的解释性,它找出的规则必然包含了训练样本中的噪声,并使它对未知数据的拟合程度不足。

为了让决策树有更好的泛化性,我们要对决策树进行剪枝。剪枝策略对决策树的影响巨大,正确的剪枝策略是优化决策树算法的核心。sklearn为我们提供了不同的剪枝策略: -

3.1 max_depth

限制树的最大深度,超过设定深度的树枝全部剪掉

这是用得最广泛的剪枝参数,在高维度低样本量时非常有效。决策树多生长一层,对样本量的需求会增加一倍,所以限制树深度能够有效地限制过拟合。在集成算法中也非常实用。实际使用时,建议从=3开始尝试,看看拟合的效果再决定是否增加设定深度。 -

3.2 min_samples_leaf

min_samples_leaf 限定,一个节点在分枝后的每个子节点都必须包含至少min_samples_leaf个训练样本,否则分枝就不会发生,或者,分枝会朝着满足每个子节点都包含min_samples_leaf个样本的方向去发生。

一般搭配max_depth使用,在回归树中有神奇的效果,可以让模型变得更加平滑。这个参数的数量设置得太小会引起过拟合,设置得太大就会阻止模型学习数据。一般来说,建议从=5开始使用。如果叶节点中含有的样本量变化很大,建议输入浮点数作为样本量的百分比来使用。同时,这个参数可以保证每个叶子的最小尺寸,可以在回归问题中避免低方差,过拟合的叶子节点出现。对于类别不多的分类问题,=1通常就是最佳选择。 -

3.3 min_samples_split

min_samples_split限定,一个节点必须要包含至少min_samples_split个训练样本,这个节点才允许被分枝,否则分枝就不会发生。 -

3.4 max_features

一般max_depth使用,用作树的”精修“

max_features限制分枝时考虑的特征个数,超过限制个数的特征都会被舍弃。和max_depth异曲同工,max_features是用来限制高维度数据的过拟合的剪枝参数,但其方法比较暴力,是直接限制可以使用的特征数量而强行使决策树停下的参数,在不知道决策树中的各个特征的重要性的情况下,强行设定这个参数可能会导致模型学习不足。如果希望通过降维的方式防止过拟合,建议使用PCA,ICA或者特征选择模块中的降维算法。 -

3.5 min_impurity_decrease

min_impurity_decrease限制信息增益的大小,信息增益小于设定数值的分枝不会发生。这是在0.19版本种更新的功能,在0.19版本之前时使用min_impurity_split。 -

确认最优的剪枝参数

那具体怎么来确定每个参数填写什么值呢?这时候,我们就要使用确定超参数的曲线来进行判断了,继续使用我们已经训练好的决策树模型clf。超参数的学习曲线,是一条以超参数的取值为横坐标,模型的度量指标为纵坐标的曲线,它是用来衡量不同超参数取值下模型的表现的线。在我们建好的决策树里,我们的模型度量指标就是score。

无论如何,剪枝参数的默认值会让树无尽地生长,这些树在某些数据集上可能非常巨大,对内存的消耗。所以如果你手中的数据集非常大,你已经预测到无论如何你都是要剪枝的,那提前设定这些参数来控制树的复杂性和大小会比较好。 -

目标权重参数

-

5.1 class_weight

完成样本标签平衡的参数。样本不平衡是指在一组数据集中,标签的一类天生占有很大的比例。比如说,在银行要判断“一个办了信用卡的人是否会违约”,就是是vs否(1%:99%)的比例。这种分类状况下,即便模型什么也不做,全把结果预测成“否”,正确率也能有99%。因此我们要使用class_weight参数对样本标签进行一定的均衡,给少量的标签更多的权重,让模型更偏向少数类,向捕获少数类的方向建模。该参数默认None,此模式表示自动给与数据集中的所有标签相同的权重。 -

5.2 min_weight_fraction_leaf

有了权重之后,样本量就不再是单纯地记录数目,而是受输入的权重影响了,因此这时候剪枝,就需要搭配min_ weight_fraction_leaf这个基于权重的剪枝参数来使用。另请注意,基于权重的剪枝参数(例如min_weight_ fraction_leaf)将比不知道样本权重的标准(比如min_samples_leaf)更少偏向主导类。如果样本是加权的,则使用基于权重的预修剪标准来更容易优化树结构,这确保叶节点至少包含样本权重的总和的一小部分。

- 重要属性和接口

属性是在模型训练之后,能够调用查看的模型的各种性质。对决策树来说,最重要的是feature_importances_,能够查看各个特征对模型的重要性。

7.Python绘制决策树

from itertools import product

import numpy as np

import matplotlib.pyplot as plt

from sklearn import datasets

from sklearn.tree import DecisionTreeClassifier

# 仍然使用自带的iris数据

iris = datasets.load_iris()

X = iris.data[:, [0, 2]]

y = iris.target

# 训练模型,限制树的最大深度4

clf = DecisionTreeClassifier(max_depth=4)

#拟合模型

clf.fit(X, y)

# 画图

x_min, x_max = X[:, 0].min() - 1, X[:, 0].max() + 1

y_min, y_max = X[:, 1].min() - 1, X[:, 1].max() + 1

xx, yy = np.meshgrid(np.arange(x_min, x_max, 0.1),

np.arange(y_min, y_max, 0.1))

Z = clf.predict(np.c_[xx.ravel(), yy.ravel()])

Z = Z.reshape(xx.shape)

plt.contourf(xx, yy, Z, alpha=0.4)

plt.scatter(X[:, 0], X[:, 1], c=y, alpha=0.8)

plt.show()