Hadoop 之 MapReduce (InputFormat 和 MapReduce工作流程 )

三、MapReduce 框架原理(重点)

文章目录

-

- 三、MapReduce 框架原理(重点)

-

- 1、InputFormat数据输入

-

- 1.1 切片与MapTask并行度决定机制

- 1.2 Job提交流程源码和切片源码详解

- 1.3 FileInputFormat 切片机制

- 1.4 TextInputFormat

- 1.5 CombineTextInputFormat 切片机制

- 1.6 CombineTextInputFormat案例实操

- 2、MapReduce工作流程

1、InputFormat数据输入

1.1 切片与MapTask并行度决定机制

(1)问题引出

- MapTask 的并行度决定Map阶段的任务处理并发度,进而影响到整个Job的处理速度。

(2)MapTask并行度决定机制

- 数据块:Block 是 HDFS 物理上把数据分成一块一块。(真实切块的)

- 数据切片:数据切片只是在逻辑上对输入进行分片,并不会在磁盘上将其切分成片进行存储。

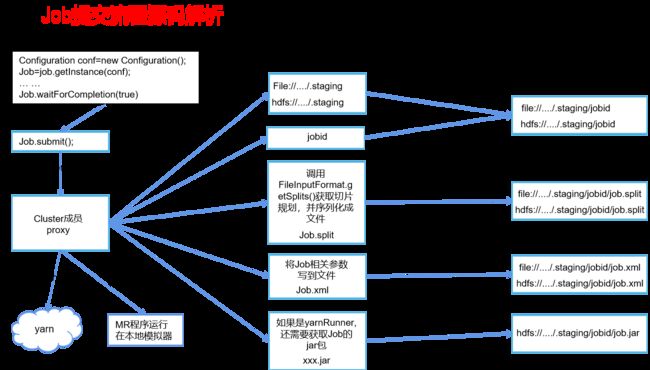

1.2 Job提交流程源码和切片源码详解

1.2.1 Job提交流程源码详解

waitForCompletion()

submit();

// 1建立连接

connect();

// 1)创建提交Job的代理

new Cluster(getConfiguration());

// (1)判断是本地yarn还是远程

initialize(jobTrackAddr, conf);

// 2 提交job

submitter.submitJobInternal(Job.this, cluster)

// 1)创建给集群提交数据的Stag路径

Path jobStagingArea = JobSubmissionFiles.getStagingDir(cluster, conf);

// 2)获取jobid ,并创建Job路径

JobID jobId = submitClient.getNewJobID();

// 3)拷贝jar包到集群

copyAndConfigureFiles(job, submitJobDir);

rUploader.uploadFiles(job, jobSubmitDir);

// 4)计算切片,生成切片规划文件

writeSplits(job, submitJobDir);

maps = writeNewSplits(job, jobSubmitDir);

input.getSplits(job);

// 5)向Stag路径写XML配置文件

writeConf(conf, submitJobFile);

conf.writeXml(out);

// 6)提交Job,返回提交状态

status = submitClient.submitJob(jobId, submitJobDir.toString(), job.getCredentials());

Job提交流程源码图解

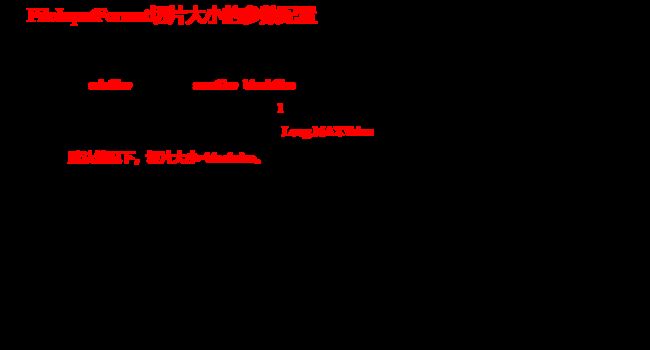

1.2.2 FileInputFormat切片源码解析(input.getSplits(job))

1.3 FileInputFormat 切片机制

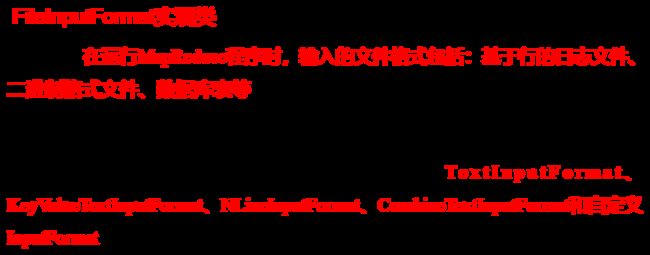

1.4 TextInputFormat

1.5 CombineTextInputFormat 切片机制

框架默认的 TextInputFormat 切片机制是对任务按文件规划切片,不管文件多小,都会是一个单独的切片,都会交给一个MapTask,这样如果有大量小文件,就会产生大量的 MapTask,处理效率极其低下。

1)应用场景:

CombineTextInputFormat 用于小文件过多的场景,它可以将多个小文件从逻辑上规划到一个切片中,这样,多个小文件就可以交给一个MapTask处理。

2)虚拟存储切片最大值设置

CombineTextInputFormat.setMaxInputSplitSize(job, 4194304);// 4m

注意:虚拟存储切片最大值设置最好根据实际的小文件大小情况来设置具体的值。

3)切片机制

生成切片过程包括:虚拟存储过程 和切片 过程 二部分。

(1)虚拟存储过程:

将输入目录下所有文件大小,依次和设置的setMaxInputSplitSize值比较,如果不大于设置的最大值,逻辑上划分一个块。如果输入文件大于设置的最大值且大于两倍,那么以最大值切割一块;当剩余数据大小超过设置的最大值且不大于最大值2倍,此时将文件均分成2个虚拟存储块(防止出现太小切片)。

例如 setMaxInputSplitSize 值为4M,输入文件大小为8.02M,则先逻辑上分成一个4M。剩余的大小为4.02M,如果按照4M逻辑划分,就会出现0.02M的小的虚拟存储文件,所以将剩余的4.02M文件切分成(2.01M和2.01M)两个文件。

(2)切片过程:

(a)判断虚拟存储的文件大小是否大于 setMaxInputSplitSize 值,大于等于则单独形成一个切片。

(b)如果不大于则跟下一个虚拟存储文件进行合并,共同形成一个切片。

(c)测试举例:有4个小文件大小分别为1.7M、5.1M、3.4M以及6.8M这四个小文件,则虚拟存储之后形成6个文件块,大小分别为:

1.7M,(2.55M、2.55M),3.4M以及(3.4M、3.4M)

最终会形成3个切片,大小分别为:

(1.7+2.55)M,(2.55+3.4)M,(3.4+3.4)M

1.6 CombineTextInputFormat案例实操

1)需求

将输入的大量小文件合并成一个切片统一处理。

(1)输入数据

准备4个小文件

(2)期望

期望一个切片处理4个文件

2)实现过程

(1)不做任何处理,运行 WordCount 案例程序,观察切片个数为4。

![]()

(2)在 WordcountDriver 中增加如下代码,运行程序,并观察运行的切片个数为3。

(a)驱动类中添加代码如下:

-

// 如果不设置InputFormat,它默认用的是TextInputFormat.class job.setInputFormatClass(CombineTextInputFormat.class); //虚拟存储切片最大值设置4m CombineTextInputFormat.setMaxInputSplitSize(job, 4194304);

(b)运行如果为3个切片。

-

numbers of splits:3

(3)在 WordcountDriver 中增加如下代码,运行程序,并观察运行的切片个数为1。

(a)驱动中添加代码如下:

-

// 如果不设置InputFormat,它默认用的是TextInputFormat.class job.setInputFormatClass(CombineTextInputFormat.class); //虚拟存储切片最大值设置20m CombineTextInputFormat.setMaxInputSplitSize(job, 20971520);(b)运行如果为1个切片。

-

numbers of splits:1

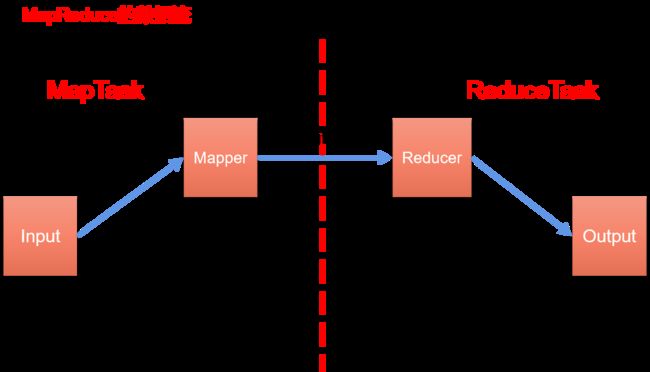

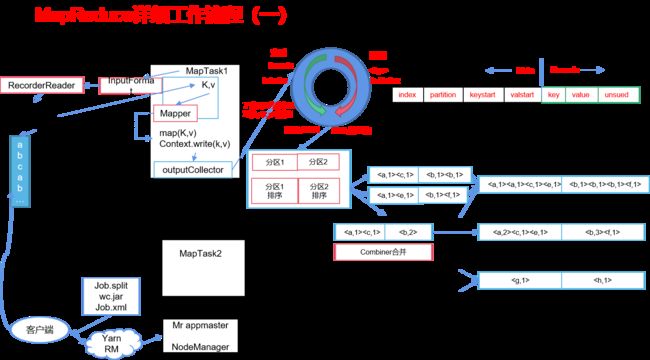

2、MapReduce工作流程

上面的流程是整个 MapReduce 最全工作流程,但是 Shuffle 过程只是从第7步开始到第16步结束,具体 Shuffle 过程详解,如下:

(1)MapTask 收集我们的 map() 方法输出的 KV 对,放到内存缓冲区中

(2)从内存缓冲区不断溢出本地磁盘文件,可能会溢出多个文件

(3)多个溢出文件会被合并成大的溢出文件

(4)在溢出过程及合并的过程中,都要调用 Partitioner 进行分区和针对 key 进行排序

(5)ReduceTask 根据自己的分区号,去各个 MapTask 机器上取相应的结果分区数据

(6)ReduceTask 会抓取到同一个分区的来自不同 MapTask 的结果文件,ReduceTask 会将这些文件再进行合并(归并排序)

(7)合并成大文件后,Shuffle 的过程也就结束了,后面进入 ReduceTask的逻辑运算过程(从文件中取出一个一个的键值对 Group,调用用户自定义的 reduce() 方法)

注意:

(1)Shuffle 中的缓冲区大小会影响到 MapReduce 程序的执行效率,原则上说,缓冲区越大,磁盘 io 的次数越少,执行速度就越快。

(2)缓冲区的大小可以通过参数调整,参数:mapreduce.task.io.sort.mb默认100M。

(3)源码解析流程

================= MapTask ===================

context.write(k, NullWritable.get()); //自定义的map方法的写出,进入

output.write(key, value);

//MapTask727行,收集方法,进入两次

collector.collect(key,value,partitioner.getPartition(key, value, partitions));

HashPartitioner(); //默认分区器

collect() //MapTask1082行 map端所有的kv全部写出后会走下面的close方法

close() //MapTask732行

collector.flush() // 溢出刷写方法,MapTask735行,提前打个断点,进入

sortAndSpill() //溢写排序,MapTask1505行,进入

sorter.sort() QuickSort //溢写排序方法,MapTask1625行,进入

mergeParts(); //合并文件,MapTask1527行,进入

collector.close();

================= ReduceTask ===================

if (isMapOrReduce()) //reduceTask324行,提前打断点

initialize() // reduceTask333行,进入

init(shuffleContext); // reduceTask375行,走到这需要先给下面的打断点

totalMaps = job.getNumMapTasks(); // ShuffleSchedulerImpl第120行,提前打断点

merger = createMergeManager(context); //合并方法,Shuffle第80行

// MergeManagerImpl第232 235行,提前打断点

this.inMemoryMerger = createInMemoryMerger(); //内存合并

this.onDiskMerger = new OnDiskMerger(this); //磁盘合并

eventFetcher.start(); //开始抓取数据,Shuffle第107行,提前打断点

eventFetcher.shutDown(); //抓取结束,Shuffle第141行,提前打断点

copyPhase.complete(); //copy阶段完成,Shuffle第151行

taskStatus.setPhase(TaskStatus.Phase.SORT); //开始排序阶段,Shuffle第152行

sortPhase.complete(); //排序阶段完成,即将进入reduce阶段 reduceTask382行

reduce(); //reduce阶段调用的就是我们自定义的reduce方法,会被调用多次

cleanup(context); //reduce完成之前,会最后调用一次Reducer里面的cleanup方法