Transformer源码解读 PyTorch

Transformer源码解读

刚开始学习深度学习几个月,对于很多近年来提到的模型都不是很清楚,读到Transformer时,注意力是什么都不知道。后面读了一些其他相关的论文逐渐开始懂一些,但是不看到代码,总是有些地方不明白,所以找到了PyTorch实现的Transformer代码进行分析,同时也记录下来,希望能够帮助到大家。

本文是使用notebook直接转的md文件,所以将下面的代码拷贝下来,是直接可以用的(前提是把库都安装好)。

import numpy as np

import torch

import torch.nn as nn

import torch.nn.functional as F

import math, copy, time

from torch.autograd import Variable

import matplotlib.pyplot as plt

import seaborn

seaborn.set_context(context="talk")

%matplotlib inline

模型结构

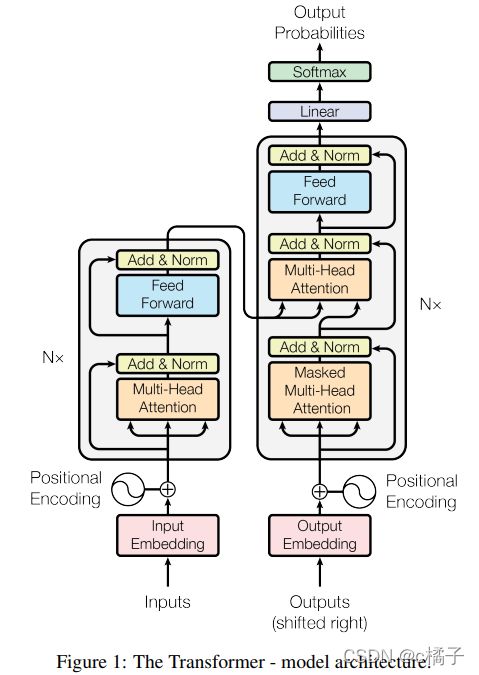

模型结构就是这样的,首先将输入进行Embedding编码,添加进位置信息之后进入编码器。编码器是由N层组成的,每层包括两个子层(图左部分),然后将输出Embedding向量和编码器的输出同时输出解码器,解码器也是由N层组成,每一层包括三个子层(图右面部分),最后将输出经过输出层(Linear+SoftMx)得到输出。

class EncoderDecoder(nn.Module):

"""

A standard Encoder-Decoder architecture. Base for this and many

other models.

"""

def __init__(self, encoder, decoder, src_embed, tgt_embed, generator):

super(EncoderDecoder, self).__init__()

self.encoder = encoder

self.decoder = decoder

self.src_embed = src_embed

self.tgt_embed = tgt_embed

self.generator = generator

def forward(self, src, tgt, src_mask, tgt_mask):

"Take in and process masked src and target sequences."

return self.decode(self.encode(src, src_mask), src_mask,

tgt, tgt_mask)

def encode(self, src, src_mask):

return self.encoder(self.src_embed(src), src_mask)

def decode(self, memory, src_mask, tgt, tgt_mask):

return self.decoder(self.tgt_embed(tgt), memory, src_mask, tgt_mask)

这是一个标准的编码器解码器结构,将模型编码后在进行解码。也就是将模型的编码器解码器部分进行封装,后面会对其中的每层进行逐步实现。

class Generator(nn.Module):

"Define standard linear + softmax generation step."

def __init__(self, d_model, vocab):

super(Generator, self).__init__()

self.proj = nn.Linear(d_model, vocab)

def forward(self, x):

return F.log_softmax(self.proj(x), dim=-1)

这是模型最后的线性输出层,主要就是线性映射+softmax。

编码器和解码器栈

编码器

# 编码器子层

class EncoderLayer(nn.Module):

"Encoder is made up of self-attn and feed forward (defined below)"

def __init__(self, size, self_attn, feed_forward, dropout):

super(EncoderLayer, self).__init__()

self.self_attn = self_attn

self.feed_forward = feed_forward

self.sublayer = clones(SublayerConnection(size, dropout), 2)

self.size = size

def forward(self, x, mask):

"Follow Figure 1 (left) for connections."

x = self.sublayer[0](x, lambda x: self.self_attn(x, x, x, mask))

return self.sublayer[1](x, self.feed_forward)

在原文图中可以看出每层编码器包含两个部分,注意力子层和前馈网络子层。每个子层结构都是相同的,在子层后进行标准化,以及残差连接。所以编码器子层复制了两个一样的连接子层 self.sublayer = clones(SublayerConnection(size, dropout), 2) ,其中第一个子层进行多头自注意力机制计算self.self_attn(x, x, x, mask),然后第二个子层实现前馈网络self.feed_forward (分别对应forward里面传入的第二个部分)。下面我们来对编码器涉及到的一些子层进行讲解。

def clones(module, N):

"Produce N identical layers."

return nn.ModuleList([copy.deepcopy(module) for _ in range(N)])

拷贝函数主要是实现模型的深拷贝,将其拷贝N次。在上面用到的地方在复制两个一样的连接子层。因为编码器是由多个编码器子层构成的,所以在整体编码器中,还会对编码器子层进行深拷贝。

class LayerNorm(nn.Module):

"Construct a layernorm module (See citation for details)."

def __init__(self, features, eps=1e-6):

super(LayerNorm, self).__init__()

self.a_2 = nn.Parameter(torch.ones(features))

self.b_2 = nn.Parameter(torch.zeros(features))

self.eps = eps

def forward(self, x):

mean = x.mean(-1, keepdim=True)

std = x.std(-1, keepdim=True)

return self.a_2 * (x - mean) / (std + self.eps) + self.b_2

标准化部分在传统标准化的基础上加入了系数a和偏置b,eps是防止标准差太小。注意到a和b都是作为模型参数参与训练的,这样可以将模型训练为标准差为a均值为b。

class SublayerConnection(nn.Module):

"""

A residual connection followed by a layer norm.

Note for code simplicity the norm is first as opposed to last.

"""

def __init__(self, size, dropout):

super(SublayerConnection, self).__init__()

self.norm = LayerNorm(size)

self.dropout = nn.Dropout(dropout)

def forward(self, x, sublayer):

"Apply residual connection to any sublayer with the same size."

return x + self.dropout(sublayer(self.norm(x)))

连接子层主要就是对子层进行残差连接。如果对应下面的多头注意力子层的话,传入的参数sublayer就是多头注意力。这也在开始的编码器子层整体部分提到了。这里需要注意的是原文图中是在注意力层后面加入的norm层,但是这里却是首先进行norm,再传入其他子层。我认为这里可能存在一些问题,因为对于每一个子层来说,最后残差连接的x和传入注意力或前馈层的norm(x)就不相等了。原文中提到了,模型所有层都使用了0.1的dropout,所以下面每层都会有dropout,就不做解释了。

到此,编码器子层的总体结构就有了,接下来就是将编码器子层进行堆叠,构成完成的编码器。

# 编码器实现

class Encoder(nn.Module):

"Core encoder is a stack of N layers"

def __init__(self, layer, N):

super(Encoder, self).__init__()

self.layers = clones(layer, N)

self.norm = LayerNorm(layer.size)

def forward(self, x, mask):

"Pass the input (and mask) through each layer in turn."

for layer in self.layers:

x = layer(x, mask)

return self.norm(x)

主要就是将编码器子层复制N层,逐层进行连接,最后进行标准化。

解码器

解码器也是包含六个相同的层,层内也是残差连接。

class Decoder(nn.Module):

"Generic N layer decoder with masking."

def __init__(self, layer, N):

super(Decoder, self).__init__()

self.layers = clones(layer, N)

self.norm = LayerNorm(layer.size)

def forward(self, x, memory, src_mask, tgt_mask):

for layer in self.layers:

x = layer(x, memory, src_mask, tgt_mask)

return self.norm(x)

上面的这段代码和编码器的部分大致相等,只是由于每层解码器第一层注意力需要使用mask,第二层注意力层包含了解码器的输出,所以传入的参数比编码器的多一些。

class DecoderLayer(nn.Module):

"Decoder is made of self-attn, src-attn, and feed forward (defined below)"

def __init__(self, size, self_attn, src_attn, feed_forward, dropout):

super(DecoderLayer, self).__init__()

self.size = size

self.self_attn = self_attn

self.src_attn = src_attn

self.feed_forward = feed_forward

self.sublayer = clones(SublayerConnection(size, dropout), 3)

def forward(self, x, memory, src_mask, tgt_mask):

"Follow Figure 1 (right) for connections."

m = memory

x = self.sublayer[0](x, lambda x: self.self_attn(x, x, x, tgt_mask))

x = self.sublayer[1](x, lambda x: self.src_attn(x, m, m, src_mask))

return self.sublayer[2](x, self.feed_forward)

对于每一层解码器来说有三个子层(分别对应代码的sublayer三个元素),因为三个子层都是残差连接,所以都使用了SublayerConnection类。需要注意的是,第一个子层使用的是带掩码的多头自注意力,QKV都是一样的,但是使用了tgt_mask掩码。目的是将Query后面的mask掉。第二子层同样是多头注意力机制,但是KV是来自编码器的输入,Q是来自解码器的输出。最后一个子层为前馈层。

def subsequent_mask(size):

"Mask out subsequent positions."

attn_shape = (1, size, size)

subsequent_mask = np.triu(np.ones(attn_shape), k=1).astype('uint8') # triu 返回一个上三角矩阵

return torch.from_numpy(subsequent_mask) == 0

这个掩码就是上面提到的tgt_mask,屏蔽掉序列后面的部分。

# 让我们来试一下效果

subsequent_mask(3)

tensor([[[ True, False, False],

[ True, True, False],

[ True, True, True]]])

注意力

注意力机制简单地说就是根据Q和K的相似度输出V的加权和。

def attention(query, key, value, mask=None, dropout=None):

"Compute 'Scaled Dot Product Attention'"

d_k = query.size(-1)

scores = torch.matmul(query, key.transpose(-2, -1)) \

/ math.sqrt(d_k)

if mask is not None:

scores = scores.masked_fill(mask == 0, -1e9) # 将mask=0部分填充为很大的负值,这样使得softmax中exp后的输出接近于0

p_attn = F.softmax(scores, dim = -1)

if dropout is not None:

p_attn = dropout(p_attn)

return torch.matmul(p_attn, value), p_attn

eq上面注意力计算就是使用将Q与K的转置进行乘积,因为Q和K都是 seq_len * hidden_size 的矩阵,将其转置相乘就得出了 s_len * seq_len的矩阵,比如对应矩阵的 (1,3) 位置上,就表示序列中 1 3 这两个词的向量进行点乘,值越大就表示两个词的相似度越高,也就是注意力的含义。然后将矩阵乘积除维度长度的 d k \sqrt{d_k} dk 就是将上面提到地点乘的结果进行缩小,原文中说的是,如果值太大softmax会进入梯度平缓的阶段,导致收敛满。最终将矩阵乘积使用mask进行掩码,使用softmax将得分转化为概率,也就是注意力。将注意力与V相乘,因为序列生成的 s_len * seq_len的矩阵相当于每个 词对于其他每个词的注意力,而V中存储的是每个词的向量表示,将二者相乘的结果为seq_len * hidden_size 的矩阵,每个位置就是该词的注意力对其他所有词的加权的和。

这部分我在一开始是比较蒙的,因为之前只是简单的了解过注意力机制,但是后面详细看了注意力机制的提出论文才明白,所以如果有这块看不懂的也可以看一下。

class MultiHeadedAttention(nn.Module):

def __init__(self, h, d_model, dropout=0.1):

"Take in model size and number of heads."

super(MultiHeadedAttention, self).__init__()

assert d_model % h == 0

# We assume d_v always equals d_k

self.d_k = d_model // h

self.h = h

self.linears = clones(nn.Linear(d_model, d_model), 4) # 这里为什么是4呢 是因为 QKV分别对应一个线性层 最后对应一个线性层嘛

self.attn = None

self.dropout = nn.Dropout(p=dropout)

def forward(self, query, key, value, mask=None):

"Implements Figure 2"

if mask is not None:

# Same mask applied to all h heads.

mask = mask.unsqueeze(1) # BERT没看懂的部分

nbatches = query.size(0)

# 1) Do all the linear projections in batch from d_model => h x d_k

query, key, value = \

[l(x).view(nbatches, -1, self.h, self.d_k).transpose(1, 2)

for l, x in zip(self.linears, (query, key, value))]

# 2) Apply attention on all the projected vectors in batch.

x, self.attn = attention(query, key, value, mask=mask,

dropout=self.dropout)

# 3) "Concat" using a view and apply a final linear.

x = x.transpose(1, 2).contiguous() \

.view(nbatches, -1, self.h * self.d_k)

return self.linears[-1](x)

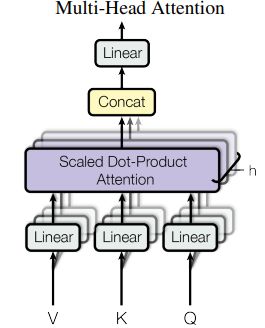

使用多头注意力有点类似于卷积网络中的不同通道(对应于上面代码中使用的线性层),想法就是不同头的注意力可能“注意的点是不同的”。多头注意力机制这里原文提到了,使用多个头的同时减少每个向量的维度,所以在初始化阶段使用 self.d_k = d_model // h计算出的d_K就是模型压缩后的维度,原文中提到的是模型隐藏层维度为512,但是使用8头注意力,所以压缩后变为512/8=64维。文中首先使用线性层将所有的数据转化为 (注意力头 * 序列位置 * 向量维度)形状,输入注意力函数计算每头的结果,最后将所有头的结果进行连接,通过线性层输出。

这就是模型整体结构的实现,接下来就是一些模型应用的部分。

注意力在模型中的应用

位置前馈网络

在这里插入图片描述

class PositionwiseFeedForward(nn.Module):

"Implements FFN equation."

# 注意一下输入的是d_model,所以实际上是将位置编码后的输入

def __init__(self, d_model, d_ff, dropout=0.1):

super(PositionwiseFeedForward, self).__init__()

self.w_1 = nn.Linear(d_model, d_ff)

self.w_2 = nn.Linear(d_ff, d_model)

self.dropout = nn.Dropout(dropout)

def forward(self, x):

return self.w_2(self.dropout(F.relu(self.w_1(x))))

我们在编码器解码器栈中看到,输入的位置会进行编码后与输入的词嵌入向量相加。因为模型完全使用注意力机制,没有向RNN等模型按序列顺序进行计算,这样天然就可以将位置信息带入,所以在Transformer中,使用将位置编码的方式添加位置信息。

实现的方式就两个线性层,中间隐层的维度为d_ff,文中说是2048,两个隐层之间使用relu激活函数(对应于文中式2的max),最终输出的也是d_model维度的向量。

Embedding和Softmax

class Embeddings(nn.Module):

def __init__(self, d_model, vocab):

super(Embeddings, self).__init__()

self.lut = nn.Embedding(vocab, d_model)

self.d_model = d_model

def forward(self, x):

return self.lut(x) * math.sqrt(self.d_model)

嵌入层就是直接使用的与通常序列模型一致的torch的Embedding层,但是对其乘了一个维度的平方根。需要注意的还有两个Embedding还有pre-softmax使用了相同的权重矩阵。

位置编码

class PositionalEncoding(nn.Module):

"Implement the PE function."

def __init__(self, d_model, dropout, max_len=5000):

super(PositionalEncoding, self).__init__()

self.dropout = nn.Dropout(p=dropout)

# Compute the positional encodings once in log space.

pe = torch.zeros(max_len, d_model)

position = torch.arange(0, max_len).unsqueeze(1) #

div_term = torch.exp(torch.arange(0, d_model, 2) *

-(math.log(10000.0) / d_model))

pe[:, 0::2] = torch.sin(position * div_term)

pe[:, 1::2] = torch.cos(position * div_term)

pe = pe.unsqueeze(0)

self.register_buffer('pe', pe)

def forward(self, x):

x = x + Variable(self.pe[:, :x.size(1)],

requires_grad=False)

return self.dropout(x)

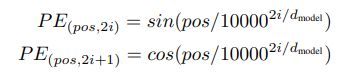

上面的位置前馈网络部分只说了如何将位置添加进去,但是实际上是编码后的位置,上面的函数是将位置编码的函数,将每个词的位置编码为d_model维,也就是就原文中提到的PE函数。其实就是在每个维度使用不同的正弦或余弦进行编码,这样使得每个位置上的向量都不同,最后将位置向量与原序列向量相加得到带有位置信息的序列。

def make_model(src_vocab, tgt_vocab, N=6,

d_model=512, d_ff=2048, h=8, dropout=0.1):

"Helper: Construct a model from hyperparameters."

c = copy.deepcopy

attn = MultiHeadedAttention(h, d_model) # 多头注意力

ff = PositionwiseFeedForward(d_model, d_ff, dropout) # 位置前馈网络

position = PositionalEncoding(d_model, dropout) # 位置编码

model = EncoderDecoder(

Encoder(EncoderLayer(d_model, c(attn), c(ff), dropout), N), # N层编码器

Decoder(DecoderLayer(d_model, c(attn), c(attn), # N层解码器

c(ff), dropout), N),

nn.Sequential(Embeddings(d_model, src_vocab), c(position)),

nn.Sequential(Embeddings(d_model, tgt_vocab), c(position)),

Generator(d_model, tgt_vocab))

# This was important from their code.

# Initialize parameters with Glorot / fan_avg.

for p in model.parameters():

if p.dim() > 1:

nn.init.xavier_uniform(p)

return model

tmp_model = make_model(10, 10, 2)

# 下面是模型输出

D:\Anaconda\envs\py36\lib\site-packages\ipykernel_launcher.py:20: UserWarning: nn.init.xavier_uniform is now deprecated in favor of nn.init.xavier_uniform_.

tmp_model

EncoderDecoder(

(encoder): Encoder(

(layers): ModuleList(

(0): EncoderLayer(

(self_attn): MultiHeadedAttention(

(linears): ModuleList(

(0): Linear(in_features=512, out_features=512, bias=True)

(1): Linear(in_features=512, out_features=512, bias=True)

(2): Linear(in_features=512, out_features=512, bias=True)

(3): Linear(in_features=512, out_features=512, bias=True)

)

(dropout): Dropout(p=0.1, inplace=False)

)

(feed_forward): PositionwiseFeedForward(

(w_1): Linear(in_features=512, out_features=2048, bias=True)

(w_2): Linear(in_features=2048, out_features=512, bias=True)

(dropout): Dropout(p=0.1, inplace=False)

)

(sublayer): ModuleList(

(0): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

(1): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

)

)

(1): EncoderLayer(

(self_attn): MultiHeadedAttention(

(linears): ModuleList(

(0): Linear(in_features=512, out_features=512, bias=True)

(1): Linear(in_features=512, out_features=512, bias=True)

(2): Linear(in_features=512, out_features=512, bias=True)

(3): Linear(in_features=512, out_features=512, bias=True)

)

(dropout): Dropout(p=0.1, inplace=False)

)

(feed_forward): PositionwiseFeedForward(

(w_1): Linear(in_features=512, out_features=2048, bias=True)

(w_2): Linear(in_features=2048, out_features=512, bias=True)

(dropout): Dropout(p=0.1, inplace=False)

)

(sublayer): ModuleList(

(0): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

(1): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

)

)

)

(norm): LayerNorm()

)

(decoder): Decoder(

(layers): ModuleList(

(0): DecoderLayer(

(self_attn): MultiHeadedAttention(

(linears): ModuleList(

(0): Linear(in_features=512, out_features=512, bias=True)

(1): Linear(in_features=512, out_features=512, bias=True)

(2): Linear(in_features=512, out_features=512, bias=True)

(3): Linear(in_features=512, out_features=512, bias=True)

)

(dropout): Dropout(p=0.1, inplace=False)

)

(src_attn): MultiHeadedAttention(

(linears): ModuleList(

(0): Linear(in_features=512, out_features=512, bias=True)

(1): Linear(in_features=512, out_features=512, bias=True)

(2): Linear(in_features=512, out_features=512, bias=True)

(3): Linear(in_features=512, out_features=512, bias=True)

)

(dropout): Dropout(p=0.1, inplace=False)

)

(feed_forward): PositionwiseFeedForward(

(w_1): Linear(in_features=512, out_features=2048, bias=True)

(w_2): Linear(in_features=2048, out_features=512, bias=True)

(dropout): Dropout(p=0.1, inplace=False)

)

(sublayer): ModuleList(

(0): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

(1): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

(2): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

)

)

(1): DecoderLayer(

(self_attn): MultiHeadedAttention(

(linears): ModuleList(

(0): Linear(in_features=512, out_features=512, bias=True)

(1): Linear(in_features=512, out_features=512, bias=True)

(2): Linear(in_features=512, out_features=512, bias=True)

(3): Linear(in_features=512, out_features=512, bias=True)

)

(dropout): Dropout(p=0.1, inplace=False)

)

(src_attn): MultiHeadedAttention(

(linears): ModuleList(

(0): Linear(in_features=512, out_features=512, bias=True)

(1): Linear(in_features=512, out_features=512, bias=True)

(2): Linear(in_features=512, out_features=512, bias=True)

(3): Linear(in_features=512, out_features=512, bias=True)

)

(dropout): Dropout(p=0.1, inplace=False)

)

(feed_forward): PositionwiseFeedForward(

(w_1): Linear(in_features=512, out_features=2048, bias=True)

(w_2): Linear(in_features=2048, out_features=512, bias=True)

(dropout): Dropout(p=0.1, inplace=False)

)

(sublayer): ModuleList(

(0): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

(1): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

(2): SublayerConnection(

(norm): LayerNorm()

(dropout): Dropout(p=0.1, inplace=False)

)

)

)

)

(norm): LayerNorm()

)

(src_embed): Sequential(

(0): Embeddings(

(lut): Embedding(10, 512)

)

(1): PositionalEncoding(

(dropout): Dropout(p=0.1, inplace=False)

)

)

(tgt_embed): Sequential(

(0): Embeddings(

(lut): Embedding(10, 512)

)

(1): PositionalEncoding(

(dropout): Dropout(p=0.1, inplace=False)

)

)

(generator): Generator(

(proj): Linear(in_features=512, out_features=10, bias=True)

)

)

Reference

【1】The Annotated Transformer

【2】Attention is all you need