- C#中使用split分割字符串

互联网打工人no1

c#

1、用字符串分隔:usingSystem.Text.RegularExpressions;stringstr="aaajsbbbjsccc";string[]sArray=Regex.Split(str,"js",RegexOptions.IgnoreCase);foreach(stringiinsArray)Response.Write(i.ToString()+"");输出结果:aaabbbc

- 基于社交网络算法优化的二维最大熵图像分割

智能算法研学社(Jack旭)

智能优化算法应用图像分割算法php开发语言

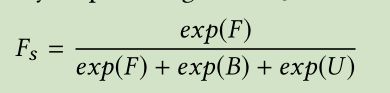

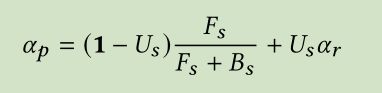

智能优化算法应用:基于社交网络优化的二维最大熵图像阈值分割-附代码文章目录智能优化算法应用:基于社交网络优化的二维最大熵图像阈值分割-附代码1.前言2.二维最大熵阈值分割原理3.基于社交网络优化的多阈值分割4.算法结果:5.参考文献:6.Matlab代码摘要:本文介绍基于最大熵的图像分割,并且应用社交网络算法进行阈值寻优。1.前言阅读此文章前,请阅读《图像分割:直方图区域划分及信息统计介绍》htt

- 【目标检测数据集】卡车数据集1073张VOC+YOLO格式

熬夜写代码的平头哥∰

目标检测YOLO人工智能

数据集格式:PascalVOC格式+YOLO格式(不包含分割路径的txt文件,仅仅包含jpg图片以及对应的VOC格式xml文件和yolo格式txt文件)图片数量(jpg文件个数):1073标注数量(xml文件个数):1073标注数量(txt文件个数):1073标注类别数:1标注类别名称:["truck"]每个类别标注的框数:truck框数=1120总框数:1120使用标注工具:labelImg标注

- 钢筋长度超限检测检数据集VOC+YOLO格式215张1类别

futureflsl

数据集YOLO深度学习机器学习

数据集格式:PascalVOC格式+YOLO格式(不包含分割路径的txt文件,仅仅包含jpg图片以及对应的VOC格式xml文件和yolo格式txt文件)图片数量(jpg文件个数):215标注数量(xml文件个数):215标注数量(txt文件个数):215标注类别数:1标注类别名称:["iron"]每个类别标注的框数:iron框数=215总框数:215使用标注工具:labelImg标注规则:对类别进

- [数据集][目标检测]汽车头部尾部检测数据集VOC+YOLO格式5319张3类别

FL1623863129

数据集目标检测汽车YOLO

数据集制作单位:未来自主研究中心(FIRC)版权单位:未来自主研究中心(FIRC)版权声明:数据集仅仅供个人使用,不得在未授权情况下挂淘宝、咸鱼等交易网站公开售卖,由此引发的法律责任需自行承担数据集格式:PascalVOC格式+YOLO格式(不包含分割路径的txt文件,仅仅包含jpg图片以及对应的VOC格式xml文件和yolo格式txt文件)图片数量(jpg文件个数):5319标注数量(xml文件

- 个人学习笔记7-6:动手学深度学习pytorch版-李沐

浪子L

深度学习深度学习笔记计算机视觉python人工智能神经网络pytorch

#人工智能##深度学习##语义分割##计算机视觉##神经网络#计算机视觉13.11全卷积网络全卷积网络(fullyconvolutionalnetwork,FCN)采用卷积神经网络实现了从图像像素到像素类别的变换。引入l转置卷积(transposedconvolution)实现的,输出的类别预测与输入图像在像素级别上具有一一对应关系:通道维的输出即该位置对应像素的类别预测。13.11.1构造模型下

- 保证RTOS线程安全的常规操作

WittXie

单片机嵌入式硬件

线程安全定义原子操作:一种不可分割的操作,要么完全执行成功,要么完全不执行,不能被打断临界区:一段代码,这段代码需要在同一时间只允许一个线程执行互斥锁:一种用于保护共享资源的机制,确保同一时间只有一个线程可以访问特定资源应用裸机原子操作/临界区可以通过暂时关闭中断响应实现一般用不到互斥锁RTOS原子操作:暂时关闭中断响应+挂起所有应用(不建议,RTOS尽量不要开启中断,改为线程监听)临界区:挂起所

- 十五年前写的《致母亲》

慧有福报

最近翻出一些,学生时代写的东西。《致母亲》成笔于2004年8月。假如它有生命,距今已经15年了。那时候,独自一个人远到成都去上大学。有段时间,非常不适应,就像小孩子一样想妈妈。站在少年,回忆童年,回忆青春期的母亲印象。时值母亲节,已时过境迁,我却只能望天遥祝。拿出当年稚嫩的文字,再看一看。---------------------------分割线-------------------------

- Python OpenCV图像处理:从基础到高级的全方位指南

极客代码

玩转Python开发语言pythonopencv图像处理计算机视觉

目录第一部分:PythonOpenCV图像处理基础1.1OpenCV简介1.2PythonOpenCV安装1.3实战案例:图像显示与保存1.4注意事项第二部分:PythonOpenCV图像处理高级技巧2.1图像变换2.2图像增强2.3图像复原第三部分:PythonOpenCV图像处理实战项目3.1图像滤波3.2图像分割3.3图像特征提取第四部分:PythonOpenCV图像处理注意事项与优化策略4

- 遥感图像分割系统:融合空间金字塔池化(FocalModulation)改进YOLOv8

xuehaisj

YOLO人工智能计算机视觉yolov8

1.研究背景与意义项目参考AAAIAssociationfortheAdvancementofArtificialIntelligence研究背景与意义遥感图像分割是遥感技术领域中的一个重要研究方向,它的目标是将遥感图像中的不同地物或地物类别进行有效的分割和识别。随着遥感技术的不断发展和遥感图像数据的大规模获取,遥感图像分割在农业、城市规划、环境监测等领域具有广泛的应用前景。然而,由于遥感图像的特

- 文本编辑器markdown语法

花北城

科技随笔Markdown

markdown语法1.介绍Markdown是一种使用一定的语法将普通的文本转换成HTML标签文本的编辑语言,它的特点是可以使用普通的文本编辑器来编写,只需要按照特定的语法标记就可以得到丰富多样的HTML格式的文本。2.标题分级"#"->一级标题"##"->二级标题"###"->三级标题3.分割线使用三个或以上的“-”或者“*”表示(混合的不行)4.斜体和粗体使用(*或者_)和(**或者__)分别

- linux的安装程序 与 文件 相关的命令

可能只会写BUG

c语言c/c++linuxlinux服务器运维

软件安装卸载命令软件包介绍软件包命名格式dpkg命令apt-get命令apt-get命令压缩和解压命令压缩文件后缀压缩命令打包和解包命令tar命令文件分割命令split命令文件操作相关命令cat命令head命令tail命令more命令less命令管道命令wc命令grep命令find命令cut命令sort命令uniq命令diff命令文件属性命令chmod命令chown命令chgrp命令ln命令硬链接

- 罗马假日剧照

点线面2018

这次尝试一下画双人像。挑来挑去仍然还是女神,有猿份!这是一个夜场舞会上的剧照,背景是黑的,头上有几个不同方向亮度不太高的灯泡。涂抹这个黑背景花了不少时间,而且效果不好,下次不再干这种蠢事了!后面有点没耐心了,手画得随意粗糙一些。上图底部纸张有点翻卷,下图用铅笔压一下。图片发自App图片发自App

- 自由不是你想做什么就做什么,而是你不想做什么就不做什么

张一铭Eva

今天落实了两个工作上的大事件,心里感到异常的轻松,中午饭后就觉得有了很多的空闲时间,于是4点开始去跑步,力量训练。突然想到前段时间给朋友说,我平时的生活就是读书健身,有空了就去工作,还招的他一顿羡慕嫉妒恨。其实所谓的有空了再去上班,只是一个比喻,我想表达的是一种自由的状态。尽管现在的快节奏,让每个人的生活和工作都变得难以分割,但我们依然要清楚的知道自己生活的重心是什么?你想要的是什么?而我幸运的知

- 华为OD机试 - 敏感字段加密(Python)

AsiaFT.

Py华为OD机试AB卷华为odpython算法

题目描述给定一个由多个命令字组成的命令字符串:1、字符串长度小于等于127字节,只包含大小写字母,数字,下划线和偶数个双引号;2、命令字之间以一个或多个下划线_进行分割;3、可以通过两个双引号””来标识包含下划线_的命令字或空命令字(仅包含两个双引号的命令字),双引号不会在命令字内部出现;请对指定索引的敏感字段进行加密,替换为******(6个*),并删除命令字前后多余的下划线_。如果无法找到指定

- 自己看---华为od--敏感字段加密

我狠狠地刷刷刷刷刷

华为od数据结构

题目描述给定一个由多个命令字组成的命令字符串:字符串长度小于等于127字节,只包含大小写字母,数字,下划线和偶数个双引号;命令字之间以一个或多个下划线_进行分割;可以通过两个双引号””来标识包含下划线_的命令字或空命令字(仅包含两个双引号的命令字),双引号不会在命令字内部出现;请对指定索引的敏感字段进行加密,替换为******(6个*),并删除命令字前后多余的下划线_。如果无法找到指定索引的命令字

- Open3D 使用RANSAC分割平面

今夕是何年,

单目+双目计算机视觉

目录1,概述2,拟合平面3,实现过程4,主要函数:defsegment_plane(self,distance_threshold,ransac_n,num_iterations):'''5,代码实现6,结果展示1,概述随机抽样一致性算法QRANSAC(Randomsampleconsensus)是一种迭代的方法来从一系列包含有离异值的数据中计算数学模型参数的方法。RANSAC算法本质上由两步组成

- 讲解Linux内核操作系统——进程状态与转换

Linux加油站

网络服务器运维

一.进程控制进程控制的主要功能是对系统中的所有进程实施有效的管理,它具有创建新进程、撤销已有进程、实现进程状态转换等功能。在操作系统中,一般把进程控制用的程序段称为原语,原语的特点是执行期间不允许中断,它是一个不可分割的基本单位。1.1创建进程UNIX中进程为树状层次结构,Windows下所有进程没有层次结构允许一个进程创建另一个进程,创建者称为父进程,被创建的进程称为子进程。子进程可以继承父进程

- Spring Boot实现多租户架构

spring_root

springboot架构后端

一、概述1什么是多租户架构?多租户架构是指在一个应用中支持多个租户(Tenant)同时访问,每个租户拥有独立的资源和数据,并且彼此之间完全隔离。通俗来说,多租户就是把一个应用按照客户的需求“分割”成多个独立的实例,每个实例互不干扰。2多租户架构的优势更好地满足不同租户的个性化需求。可以降低运维成本,减少硬件、网络等基础设施的投入。节约开发成本,通过复用代码,快速上线新的租户实例。增强了系统的可扩展

- mysql查询慢排查_mysql慢查询排查优化

weixin_39970855

mysql查询慢排查

即时分析:showfullpercesslist;开启慢查询日志,分析日志记录:long_query_time=1log-slow-queries=/data/3306/slow.loglog_queries_not_using_indexes分割日志发送至邮箱加explain查看语句的具体执行方式,并定位在哪些字段加上索引,查看条件字段的唯一值selectcount(distinctcolumn

- 我的高中时代

枉江三年

图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App图片发自App2016--2017我的兵荒马乱的高中时代无人像你让我眼泪倒着流仅此纪念

- SAM2:环境安装&代码调试

要养家的程序猿

AI算法python算法ai人工智能科技

引子时隔大半年,SAM2代终于来了,之前写过一篇《SegmentAnything(SAM)环境安装&代码调试》,感兴趣童鞋请移步SegmentAnything(SAM)环境安装&代码调试-CSDN博客,OK,让我们开始吧。一、模型介绍Meta公司去年发布了SAM1基础模型,已经可以在图像上分割对象。而最新发布的SAM2可用于图片和视频,并可以实现实时、可提示的对象分割。SAM2在图像分割准确性方面

- 视频也能分割?!在云服务器上部署最新视觉大模型SAM2教程、详细代码注释和视频演示

Hanley_Yeung

图像处理人工智能python人工智能python深度学习SAM2计算机视觉图像分割

使用SAM2进行视频分割本笔记本展示了如何使用SAM2在视频中进行交互式分割。它将涵盖以下内容:在帧上添加点击以获取和细化masklets(时空掩码)在整个视频中传播点击以获取_masklets同时分割和跟踪多个目标我们使用术语_segment_或_mask_来指代单个帧上对象的模型预测,_masklet_指代整个视频中的时空掩码。如果使用Jupyter在本地运行,请首先根据安装说明在您的环境中安

- android10 系统定制:增加应用使用数据埋点,应用使用时长统计

ljl_jiaLiang

android系统定制

需求意在统计应用的使用时长和开始结束时间,最终生成一个文件可以直观看出什么时候进入了哪个应用、什么时候退出,如图:每行记录了应用的进入或退出,以逗号分割。分别记录了事件开始时间,应用包名,进入或退出(1或2),应用名称。根据上面的数据记录可以看出:2024-08-1209:52:54进入了设置,09:52:57退出设置回到了桌面,09:53:11进入了包名为com.example.intellig

- 【代码随想录Day17】二叉树Part05|练习递归

夜雨翦春韭

代码随想录数据结构算法leetcodejava

654.最大二叉树题目链接/文章讲解:代码随想录视频讲解:又是构造二叉树,又有很多坑!|LeetCode:654.最大二叉树_哔哩哔哩_bilibili思路和昨天的从中序与后序遍历序列构造二叉树很像,那一题是根节点对数组分割,这一题是最大元素对数组分割。代码解释:基本检查:如果输入数组nums为空,直接返回null。找到最大值的索引:使用getMaxIndex方法找到数组中的最大值的索引。创建根节

- 21.挥军所指尽烟云,衙门设帐论学问

星海燎原

做足了准备,王阳明就开始了具体的军事战略规划。他考虑到南赣“匪盗”气势强盛,便要求福建、广东等省联合征剿,对他们进行分割包围,各个击破。正德十二年(1517年)正月,王阳明率军攻打福建漳南的“山贼”,以解除后顾之忧。对于处在江西、广东交界处的横水、桶冈、浰头的“匪盗”,则需要谋定而后动,不可轻易用兵。王阳明首先来了一招声东击西,故意散布消息说要讨伐横水、桶冈,实则将兵锋直指漳南。这个假消息既可以让

- 注意力训练——时间管理(巧用计时器)

凌萱23143

对孩子注意力的培养是我们教育过程中一个重要的环节,其实注意力与时间之间也有着不可分割的关系,培养孩子的注意力,就要交给孩子时间管理的能力。我们来看这样一个案例:一位妈妈在孩子小的时候送给了他一个计时器当作礼物,并教他学会使用这个计时器。在后来的日子里,妈妈如果要求孩子看15分钟书,就给他用计时器定好15分钟,然后要求他在计时器响起之前,他都不能做别的事情。随着孩子慢慢成长,妈妈给他设定的时间越来越

- 使用HTMLSectionSplitter进行智能HTML文档分割

afTFODguAKBF

htmlpython前端

使用HTMLSectionSplitter进行智能HTML文档分割引言在处理大型HTML文档时,将其分割成更小的、语义相关的部分是一个常见需求。这不仅有助于提高文本处理的效率,还能保持文档的结构和上下文信息。本文将介绍LangChain库中的HTMLSectionSplitter,这是一个强大的工具,可以根据HTML结构智能地分割文档。HTMLSectionSplitter简介HTMLSectio

- C++的类和对象(下)

近听水无声477

c++开发语言

Hello,亲爱的小伙伴们,我又回来了,今天我们将继续学习C++的类和对象,这时我们学习类和对象的第三节课,掌握了前面的知识,我们就算是对C++有了基础的认识,好,废话不多说,开始我们今天的正题!1.再谈构造函数之前我们在实现构造函数的时候,初始化成员变量主要使用函数体内赋值。构造函数的初始化还有一种方式就是使用初始化列表,初始化列表的使用方式是由一个冒号开始,接着是一个以逗号分割的数据成员列表。

- 倪云华:80%合伙人内斗源于股权分配,这样做让你避免陷入纷争

云华商业频道

作者:倪云华创业早期,只要你不是一个人创业,那你一定会在搭建创始团队时遇到合伙人组建的问题。有很多创业者在寻找合伙人时,优先考虑的对象都是身边的好朋友。由于是好朋友的关系,比较注重相互之间的情谊,因此在股份的分配上,也就比较讲情面的采用平均化的方式。这样的分割,看似公平,但却为将来的团队发展埋下了深深的隐患。对于创始团队的搭建,创业圈一直都有一个常见的作法,那就是采取“415原则”。以下将与你分享

- 用MiddleGenIDE工具生成hibernate的POJO(根据数据表生成POJO类)

AdyZhang

POJOeclipseHibernateMiddleGenIDE

推荐:MiddlegenIDE插件, 是一个Eclipse 插件. 用它可以直接连接到数据库, 根据表按照一定的HIBERNATE规则作出BEAN和对应的XML ,用完后你可以手动删除它加载的JAR包和XML文件! 今天开始试着使用

- .9.png

Cb123456

android

“点九”是andriod平台的应用软件开发里的一种特殊的图片形式,文件扩展名为:.9.png

智能手机中有自动横屏的功能,同一幅界面会在随着手机(或平板电脑)中的方向传感器的参数不同而改变显示的方向,在界面改变方向后,界面上的图形会因为长宽的变化而产生拉伸,造成图形的失真变形。

我们都知道android平台有多种不同的分辨率,很多控件的切图文件在被放大拉伸后,边

- 算法的效率

天子之骄

算法效率复杂度最坏情况运行时间大O阶平均情况运行时间

算法的效率

效率是速度和空间消耗的度量。集中考虑程序的速度,也称运行时间或执行时间,用复杂度的阶(O)这一标准来衡量。空间的消耗或需求也可以用大O表示,而且它总是小于或等于时间需求。

以下是我的学习笔记:

1.求值与霍纳法则,即为秦九韶公式。

2.测定运行时间的最可靠方法是计数对运行时间有贡献的基本操作的执行次数。运行时间与这个计数成正比。

- java数据结构

何必如此

java数据结构

Java 数据结构

Java工具包提供了强大的数据结构。在Java中的数据结构主要包括以下几种接口和类:

枚举(Enumeration)

位集合(BitSet)

向量(Vector)

栈(Stack)

字典(Dictionary)

哈希表(Hashtable)

属性(Properties)

以上这些类是传统遗留的,在Java2中引入了一种新的框架-集合框架(Collect

- MybatisHelloWorld

3213213333332132

//测试入口TestMyBatis

package com.base.helloworld.test;

import java.io.IOException;

import org.apache.ibatis.io.Resources;

import org.apache.ibatis.session.SqlSession;

import org.apache.ibat

- Java|urlrewrite|URL重写|多个参数

7454103

javaxmlWeb工作

个人工作经验! 如有不当之处,敬请指点

1.0 web -info 目录下建立 urlrewrite.xml 文件 类似如下:

<?xml version="1.0" encoding="UTF-8" ?>

<!DOCTYPE u

- 达梦数据库+ibatis

darkranger

sqlmysqlibatisSQL Server

--插入数据方面

如果您需要数据库自增...

那么在插入的时候不需要指定自增列.

如果想自己指定ID列的值, 那么要设置

set identity_insert 数据库名.模式名.表名;

----然后插入数据;

example:

create table zhabei.test(

id bigint identity(1,1) primary key,

nam

- XML 解析 四种方式

aijuans

android

XML现在已经成为一种通用的数据交换格式,平台的无关性使得很多场合都需要用到XML。本文将详细介绍用Java解析XML的四种方法。

XML现在已经成为一种通用的数据交换格式,它的平台无关性,语言无关性,系统无关性,给数据集成与交互带来了极大的方便。对于XML本身的语法知识与技术细节,需要阅读相关的技术文献,这里面包括的内容有DOM(Document Object

- spring中配置文件占位符的使用

avords

1.类

<?xml version="1.0" encoding="UTF-8"?><!DOCTYPE beans PUBLIC "-//SPRING//DTD BEAN//EN" "http://www.springframework.o

- 前端工程化-公共模块的依赖和常用的工作流

bee1314

webpack

题记: 一个人的项目,还有工程化的问题嘛? 我们在推进模块化和组件化的过程中,肯定会不断的沉淀出我们项目的模块和组件。对于这些沉淀出的模块和组件怎么管理?另外怎么依赖也是个问题? 你真的想这样嘛? var BreadCrumb = require(‘../../../../uikit/breadcrumb’); //真心ugly。

- 上司说「看你每天准时下班就知道你工作量不饱和」,该如何回应?

bijian1013

项目管理沟通IT职业规划

问题:上司说「看你每天准时下班就知道你工作量不饱和」,如何回应

正常下班时间6点,只要是6点半前下班的,上司都认为没有加班。

Eno-Bea回答,注重感受,不一定是别人的

虽然我不知道你具体从事什么工作与职业,但是我大概猜测,你是从事一项不太容易出现阶段性成果的工作

- TortoiseSVN,过滤文件

征客丶

SVN

环境:

TortoiseSVN 1.8

配置:

在文件夹空白处右键

选择 TortoiseSVN -> Settings

在 Global ignote pattern 中添加要过滤的文件:

多类型用英文空格分开

*name : 过滤所有名称为 name 的文件或文件夹

*.name : 过滤所有后缀为 name 的文件或文件夹

--------

- 【Flume二】HDFS sink细说

bit1129

Flume

1. Flume配置

a1.sources=r1

a1.channels=c1

a1.sinks=k1

###Flume负责启动44444端口

a1.sources.r1.type=avro

a1.sources.r1.bind=0.0.0.0

a1.sources.r1.port=44444

a1.sources.r1.chan

- The Eight Myths of Erlang Performance

bookjovi

erlang

erlang有一篇guide很有意思: http://www.erlang.org/doc/efficiency_guide

里面有个The Eight Myths of Erlang Performance: http://www.erlang.org/doc/efficiency_guide/myths.html

Myth: Funs are sl

- java多线程网络传输文件(非同步)-2008-08-17

ljy325

java多线程socket

利用 Socket 套接字进行面向连接通信的编程。客户端读取本地文件并发送;服务器接收文件并保存到本地文件系统中。

使用说明:请将TransferClient, TransferServer, TempFile三个类编译,他们的类包是FileServer.

客户端:

修改TransferClient: serPort, serIP, filePath, blockNum,的值来符合您机器的系

- 读《研磨设计模式》-代码笔记-模板方法模式

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.sql.Connection;

import java.sql.DriverManager;

import java.sql.PreparedStatement;

import java.sql.ResultSet;

- 配置心得

chenyu19891124

配置

时间就这样不知不觉的走过了一个春夏秋冬,转眼间来公司已经一年了,感觉时间过的很快,时间老人总是这样不停走,从来没停歇过。

作为一名新手的配置管理员,刚开始真的是对配置管理是一点不懂,就只听说咱们公司配置主要是负责升级,而具体该怎么做却一点都不了解。经过老员工的一点点讲解,慢慢的对配置有了初步了解,对自己所在的岗位也慢慢的了解。

做了一年的配置管理给自总结下:

1.改变

从一个以前对配置毫无

- 对“带条件选择的并行汇聚路由问题”的再思考

comsci

算法工作软件测试嵌入式领域模型

2008年上半年,我在设计并开发基于”JWFD流程系统“的商业化改进型引擎的时候,由于采用了新的嵌入式公式模块而导致出现“带条件选择的并行汇聚路由问题”(请参考2009-02-27博文),当时对这个问题的解决办法是采用基于拓扑结构的处理思想,对汇聚点的实际前驱分支节点通过算法预测出来,然后进行处理,简单的说就是找到造成这个汇聚模型的分支起点,对这个起始分支节点实际走的路径数进行计算,然后把这个实际

- Oracle 10g 的clusterware 32位 下载地址

daizj

oracle

Oracle 10g 的clusterware 32位 下载地址

http://pan.baidu.com/share/link?shareid=531580&uk=421021908

http://pan.baidu.com/share/link?shareid=137223&uk=321552738

http://pan.baidu.com/share/l

- 非常好的介绍:Linux定时执行工具cron

dongwei_6688

linux

Linux经过十多年的发展,很多用户都很了解Linux了,这里介绍一下Linux下cron的理解,和大家讨论讨论。cron是一个Linux 定时执行工具,可以在无需人工干预的情况下运行作业,本文档不讲cron实现原理,主要讲一下Linux定时执行工具cron的具体使用及简单介绍。

新增调度任务推荐使用crontab -e命令添加自定义的任务(编辑的是/var/spool/cron下对应用户的cr

- Yii assets目录生成及修改

dcj3sjt126com

yii

assets的作用是方便模块化,插件化的,一般来说出于安全原因不允许通过url访问protected下面的文件,但是我们又希望将module单独出来,所以需要使用发布,即将一个目录下的文件复制一份到assets下面方便通过url访问。

assets设置对应的方法位置 \framework\web\CAssetManager.php

assets配置方法 在m

- mac工作软件推荐

dcj3sjt126com

mac

mac上的Terminal + bash + screen组合现在已经非常好用了,但是还是经不起iterm+zsh+tmux的冲击。在同事的强烈推荐下,趁着升级mac系统的机会,顺便也切换到iterm+zsh+tmux的环境下了。

我为什么要要iterm2

切换过来也是脑袋一热的冲动,我也调查过一些资料,看了下iterm的一些优点:

* 兼容性好,远程服务器 vi 什么的低版本能很好兼

- Memcached(三)、封装Memcached和Ehcache

frank1234

memcachedehcachespring ioc

本文对Ehcache和Memcached进行了简单的封装,这样对于客户端程序无需了解ehcache和memcached的差异,仅需要配置缓存的Provider类就可以在二者之间进行切换,Provider实现类通过Spring IoC注入。

cache.xml

<?xml version="1.0" encoding="UTF-8"?>

- Remove Duplicates from Sorted List II

hcx2013

remove

Given a sorted linked list, delete all nodes that have duplicate numbers, leaving only distinct numbers from the original list.

For example,Given 1->2->3->3->4->4->5,

- Spring4新特性——注解、脚本、任务、MVC等其他特性改进

jinnianshilongnian

spring4

Spring4新特性——泛型限定式依赖注入

Spring4新特性——核心容器的其他改进

Spring4新特性——Web开发的增强

Spring4新特性——集成Bean Validation 1.1(JSR-349)到SpringMVC

Spring4新特性——Groovy Bean定义DSL

Spring4新特性——更好的Java泛型操作API

Spring4新

- MySQL安装文档

liyong0802

mysql

工作中用到的MySQL可能安装在两种操作系统中,即Windows系统和Linux系统。以Linux系统中情况居多。

安装在Windows系统时与其它Windows应用程序相同按照安装向导一直下一步就即,这里就不具体介绍,本文档只介绍Linux系统下MySQL的安装步骤。

Linux系统下安装MySQL分为三种:RPM包安装、二进制包安装和源码包安装。二

- 使用VS2010构建HotSpot工程

p2p2500

HotSpotOpenJDKVS2010

1. 下载OpenJDK7的源码:

http://download.java.net/openjdk/jdk7

http://download.java.net/openjdk/

2. 环境配置

▶

- Oracle实用功能之分组后列合并

seandeng888

oracle分组实用功能合并

1 实例解析

由于业务需求需要对表中的数据进行分组后进行合并的处理,鉴于Oracle10g没有现成的函数实现该功能,且该功能如若用JAVA代码实现会比较复杂,因此,特将SQL语言的实现方式分享出来,希望对大家有所帮助。如下:

表test 数据如下:

ID,SUBJECTCODE,DIMCODE,VALUE

1&nbs

- Java定时任务注解方式实现

tuoni

javaspringjvmxmljni

Spring 注解的定时任务,有如下两种方式:

第一种:

<?xml version="1.0" encoding="UTF-8"?>

<beans xmlns="http://www.springframework.org/schema/beans"

xmlns:xsi="http

- 11大Java开源中文分词器的使用方法和分词效果对比

yangshangchuan

word分词器ansj分词器Stanford分词器FudanNLP分词器HanLP分词器

本文的目标有两个:

1、学会使用11大Java开源中文分词器

2、对比分析11大Java开源中文分词器的分词效果

本文给出了11大Java开源中文分词的使用方法以及分词结果对比代码,至于效果哪个好,那要用的人结合自己的应用场景自己来判断。

11大Java开源中文分词器,不同的分词器有不同的用法,定义的接口也不一样,我们先定义一个统一的接口:

/**

* 获取文本的所有分词结果, 对比

![]()

![]()

![]()