【机器学习算法】Logistic回归分类算法

文章目录

- 一、Logistic回归

-

- 1. 分类问题

- 2. Logistic函数

-

- (1) 阶跃函数(不可导)

- (2)可导的阶跃函数

- 二、Logistic回归的算法原理

-

- 1. 基本思路

- 2. 数学解析

-

- (1) 数学表达式

- (2) 损失函数

- 3. 具体步骤

- 三、在Python中使用Logistic回归算法

-

- 1. LinearRegression类

- 2. Ridge类

- 3. Lasso类

- 4. LogisticRegression类

- 四、Logistic回归算法的使用场景

上一篇:【机器学习算法】线性回归算法

一、Logistic回归

我们知道,回归问题的预测值是连续的,而分类问题的预测值是非连续的,或者称为是离散的。我们还知道,线性模型的一大特点就是“耿直”,是一条纯纯粹粹、不肯走弯路的直线。直线是连续的,所以能被用于回归问题,可又怎么用来解决离散的分类问题呢?

这么说也许听起来很厉害,但总感觉不太直观,画个图就好多了。离散数据总带着“阶跃”这么一种特征,所谓阶跃,顾名思义就是像台阶一样猛地一下蹦上去,样子有点像大写的字母“S”,画成图像类似于图4-1a,而直图线(见4-1b)我们就见得多了。

线性模型所面临的情况说来也简单,就是怎样把图4-1a中a图变成b图。

- 分类问题

- Logistic函数

1. 分类问题

分类问题与回归问题一样,都属于有监督学习,也就是满足两个要素:一是要进行预测,二是有参考答案,并分为三个阶段。

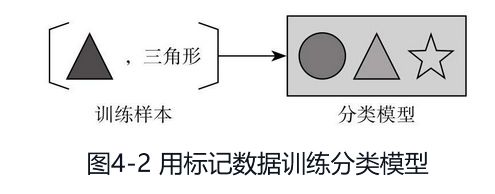

首先分类问题会确定有哪些类别,也就是类别是预先设定的;然后在模型训练阶段,输入的训练集样本每一条都包含了类别信息,也就是告诉你什么样的样本属于哪一类(见图4-2)。

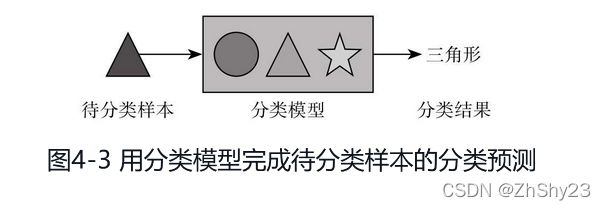

最后就是进行预测,这也是研究分类问题的最终目的,给定一条样本让模型自动判断究竟属于哪一类,并输出最终的分类结果(见图4-3)。

不妨以分类问题的视角看看垃圾分类。垃圾桶一般会预先设置“可回收”和“不可回收”两个投入口,这就是两种预设类别,然后通过各种环保宣传告诉大家哪些垃圾属于可回收,哪些属于不可回收,这就是模型训练的过程。当我们最终开始投放垃圾时,都需要对当前的垃圾进行一次判断,看看究竟符合哪一种分类,然后放到对应的投放口,这就是根据模型训练的结果进行预测的整个过程。

分类问题所要预测的不是数值,而是两个或两个以上的类别,机器学习算法所要完成的是预测输入属于哪个类别。

学术上对分类问题做了更为细致的区别:

- 如果待分类别只有两个,通常称之为二元分类(Binary Classification)问题,在机器学习中较多使用Logistic函数来解决。

- 而若待分类别超过两个,则称之为多分类(Multi-classClassification)问题,在机器学习中较多使用Softmax函数来解决。

机器学习能跳出实物类别的限制,把逻辑性区分当作一种类别,进而用分类问题加以分析解决。

譬如说对于“现在是不是该睡觉了”,可能的选项用语言描述可能五花八门,包括“该睡觉了”和“还没到睡觉的时候”,但对语义进行抽象,都可以划入“是”类或者“否”类。

“是”类和“否”类在机器学习中非常常见,也非常重要,因此,机器学习专门规定了术语,将“是”类称为**“正类”(Positive),而将“否”类称为“负类”(Negative),与之对应的训练集中也可划分成“正样本”和“负样本”。**

通过这个视角,就可以把二元分类问题和多分类问题统一起来,将多分类看成由很多个二元分类组成的分类问题,形成数据结构中的二叉搜索树。

现在的垃圾分类逐渐也出现了多分类趋势,譬如分成厨余垃圾、可回收垃圾、有害垃圾等,那么用二元分类的方法,首先可以进行一次是不是厨余垃圾的分类,不是厨余垃圾的这类也就是负类,并对其继续进行一次是不是可回收垃圾的分类,沿着这套框架不断进行下去,多分类问题也就可以用二元分类问题解决,这也是许多针对二元分类问题设计的算法泛用到多分类问题领域的一种主要方式。

因此,二元分类问题也就成为最基础的分类问题。

2. Logistic函数

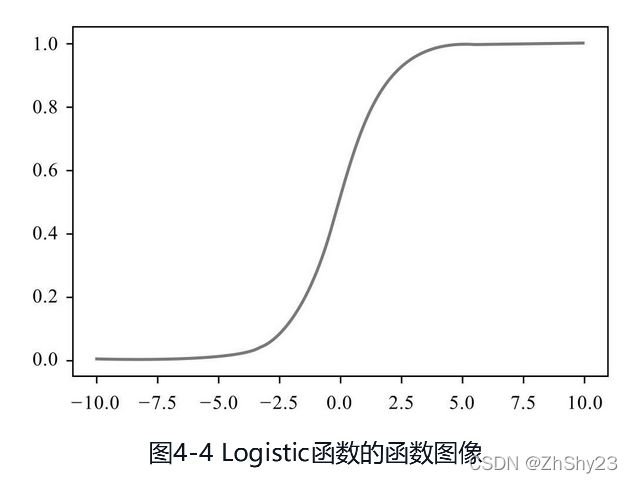

线性模型能够预测离散的分类问题的秘密全部藏在Logistic函数里面。Logistic函数由统计学家皮埃尔·弗朗索瓦·韦吕勒发明于19世纪,它有很多名字,如在神经网络算法中称它为Sigmoid函数,也有人称它为Logistic曲线,总的来说,它是一个“身材”很好的函数。Logistic函数的最大特征就是它天生就拥有许多人梦寐以求的目标——亮眼的S型曲线,函数图像如图4-4所示。

(1) 阶跃函数(不可导)

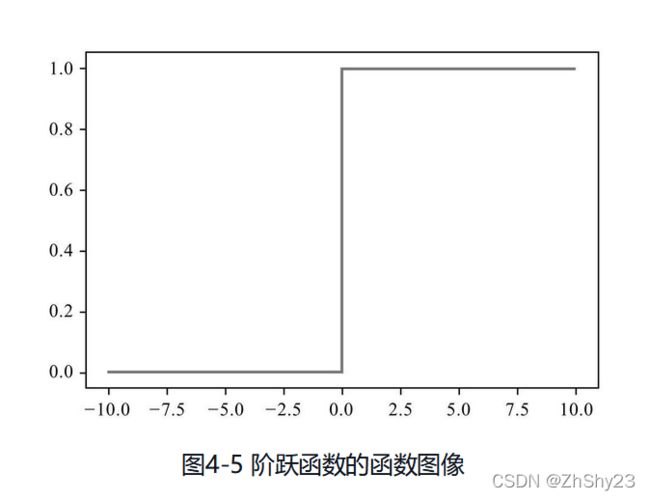

前面我们讨论分类问题时提到分类问题的预测结果是离散的,会出现阶跃现象。“阶跃”这个术语特别形象,图像最开始也是一条平淡无奇的直线,但到了某一个点,譬如说在横坐标“0”的位置,图像突然变化了,来了一个垂直上跃,好像一条受惊了的眼镜蛇猛地昂起了头,接着又若无其事地继续沿着直线往前走。

对于工程应用,阶跃函数的这种性质具有特别高的实用价值,譬如可以起到“开关”的作用。对,就是随处可见、一拨动就发出“吧嗒”脆响的开关,因此常见于信号系统分析。说到“开关”,马上可以想到这就是二元分类问题的一种典型实例,于是,阶跃函数与机器学习似乎开始有了交集。

可惜也就到此为止了,阶跃函数无法直接用于机器学习。不难看出,Logistic函数和标准阶跃函数还是存在着明显的不同。阶跃函数的线条显然非常硬朗,垂角位置全都是硬邦邦的直角,这样的函数是不可导的。

更糟糕的是,实际上阶跃函数的准确图像应该是两条直线加一个点:

- 当x<0时,图像始终是某个值,

- 当x>0时,图像又始终是某个值,

- 而当x=0时,函数的值只能为一个确数,比如0。

阶跃函数内部包含不连续的点,因此也称为奇异函数。阶跃函数的图像是不连续的,不连续的函数同样不可导。但在机器学习中,可导性非常重要,否则就无法搭配使用梯度下降等优化算法,使得偏差最小了。

(2)可导的阶跃函数

Logistic函数是一种可导函数,又是一种阶跃函数,或者说能够扮演类似阶跃函数的角色。从上文给出的Logistic函数图像不难看出,它最开始也是一条直线,然后到了某个位置猛然抬头上升,后面继续变成一条直线。因此, Logistic函数也能起到“开关”的功能。

那我们就很好奇了,Logistic函数是怎样同时满足这两种冲突要求的呢?秘密就在于缩放。对于Logistic函数来说,坐标轴“0”是一个有着特殊意义的坐标,越靠近0和越远离0,也就是沿着0轴缩小和放大,函数图像将呈现截然不同的形状,堪称“函数界的变形金刚”。

上面给出的Logistic函数图像是以(-10,10)这样的跨度来绘制的,呈现出了漂亮的S曲线。如果这个跨度值沿着0轴缩小,则可以看出S曲线变得越来越“直”,到了(-1,1)甚至更小时,几乎就变成了一条直线。这就是Logistic函数为什么可导,如图4-6所示。

但反过来,只要跨度值不断扩大,Logistic函数图像将越来越接近于原生的阶跃函数,越能发挥出“开关”的效果。如图4-7所示。

但反过来,只要跨度值不断扩大,Logistic函数图像将越来越接近于原生的阶跃函数,越能发挥出“开关”的效果。如图4-7所示。

现在可以看出来,Logistic函数作为阶跃函数来说,是尺度越大,效果越明显。利用这个性质,我们就能把Logistic函数作为连接线性连续值和阶跃离散值的桥梁。

线性模型的预测结果是一个连续的数值,这项设定是无法更改的。但Logistic函数有一样很便利的特性:

- X轴的值越是小于0,Y轴的值则越是接近于0 ;

- X轴的值越是大于0,Y轴的值则越是接近于1。

那么,通过Logistic函数就可以把线性模型的预测结果映射成分类问题所需的预测结果。思路如下:

- 将线性模型的输出和Logistic函数的输入串接起来。

- 当样本为负类时,让线性模型输出的预测值小于0,而且越小越好。

- 当样本为正类时,让线性模型输出的预测值大于0,而且越大越好。

有了Logistic函数进行映射,线性模型不再需要输出某个特定的值,而只要满足“让输出尽可能地接近0或者1”这一条要求即可。这条要求是线性模型可以满足的。

二、Logistic回归的算法原理

1. 基本思路

分类问题的预测结果自然预测的是类别,也许你在日常生活中习惯以类别的名字作为不同类别的区分,但在机器学习中,使用的是事前约定的数值来代表类别,常用的形式有如下三种:

- 数字形式:这是最为直接的一种形式,譬如直接用“1”代表正类,“-1”代表负类,那么预测结果是正类就输出“1”,是负类就输出-1,简单明了。当然,指代的数字不是唯一的,只要能与类别对应就行,譬如另一种常见习惯是用“0”来指代负类。

- 向量形式:这是当前深度学习在分类问题上使用最多的一种形式,特别是在多分类问题上多采用这种形式,用向量中元素按顺序代表类别,譬如有A、B、C三类,就可以用[x1, x2, x3]这样的向量元素依次代表,预测结果为哪一类,就把向量中的对应元素置1,其他置0。如预测的结果类别为“A”,则输出的预测结果就表示为[1,0,0];预测结果为“B”,则表示为[0,1,0]。

- 概率值形式:前面两种表示形式都以1或0等确值来表示预测结果是否为这个类,但部分算法给出的预测结果不是绝对的“是/否”,而是每个类的可能概率。如上文对A、B、C三类的预测结果,用这种形式就表示为如[0.8435, 0.032, 0.000419],可以看出,虽然三个元素都存在一定概率,但显然“A”的概率要高于其他,同样能够起到预测类别的效果。

先明确条件,假设要预测的是一个二元分类问题,输出格式按数字形式,也就是1或者-1。以0为界,把连续值两边一分,于是就得到了想要的离散值。

if (线性模型输出的连续值 > 0):

return 1

else:

return -1

关键还是在于线性回归。我们俯下身子,学着从线性模型的视角看,就会发现这里根本不存在什么预测值是离散的分类问题,而是要预测得到一个连续值。

对于任意一个非零数值,当然不是大于0就是小于0,为了使预测更准确,唯一的要求就是预测值距离0点越远越好,譬如说把正类看成是要预测3756.2、3890、3910.7,把负类结果看成要预测-2116.4、-2213、-2305.6这样的连续值。这当然还是典型的回归问题,然后就可以照葫芦画瓢地用线性回归那套老办法去拟合。只要线性回归圆满完成了它的任务,我们自然就能保证正类的预测结果大于0,而负类小于0了(见图4-8)。

上面这个似乎很简单的判断结构,它其实是大名鼎鼎的Sgn函数,也正是我们前面所讲的Logistic函数所要效仿的阶跃函数,Sgn函数如下所示:

s g n ( x ) = { 1 , x > 0 0 , x = 0 − 1 , x < 0 (4-1) sgn(x)= \begin{cases} 1,&x>0\\ 0,&x=0\\ -1,&x<0 \end{cases} \tag{4-1} sgn(x)=⎩⎪⎨⎪⎧1,0,−1,x>0x=0x<0(4-1)

不过也正如前面所讲,Sgn函数存在不可导的问题,所以实际上我们选择用Logistic函数顶替了它的位置。

2. 数学解析

(1) 数学表达式

Logistic函数数学表达式:

L o g i s t i c ( z ) = 1 1 + e − z (4-2) Logistic(z)=\frac{1}{1+e^{-z}} \tag{4-2} Logistic(z)=1+e−z1(4-2)

- e称为自然常数,也就是一个固定值的“常量”, e − z e^{-z} e−z是以e为底、z为变量的指数函数,更常见的写法为 e − x e^{-x} e−x。以e为底的指数函数 e x e^x ex又可以写成exp(x),这种形式更接近于编程的函数写法。二者只存在写法风格的不同,有时候你看到的Logistic回归可能采用这样的写法,但与上式表达的内容是一样的:

L o g i s t i c ( z ) = 1 1 + e x p ( − z ) (4-3) Logistic(z)=\frac{1}{1+exp(-z)} \tag{4-3} Logistic(z)=1+exp(−z)1(4-3)

Logistic回归的假设函数就是套上Logistic函数的线性方程,也就是把线性方程表达式带入上式的z,表达式如下:

H ( x ) = 1 1 + e − ( w T x i + b ) (4-4) H(x)=\frac{1}{1+e^{-(w^Tx_i+b)}} \tag{4-4} H(x)=1+e−(wTxi+b)1(4-4)

(2) 损失函数

表达式:

L ( x ) = − y l o g H ( x ) − ( 1 − y ) l o g ( 1 − H ( x ) ) (4-5) L(x)=-ylogH(x)-(1-y)log(1-H(x)) \tag{4-5} L(x)=−ylogH(x)−(1−y)log(1−H(x))(4-5)

仔细观察Logistic函数的输出区间,值域是从0到1。什么与预测相关,值域又是从0到1的呢?在你的脑海里也许闪过一个念头,没错,概率!这不是偶然。选取Logistic函数作为马甲,一是看上它的S曲线,二是因为它的输出区间符合概率的要求。

Logistic所输出的概率是正类的概率。除了特征外,分类问题的数据还带有类别标签(Class Label)信息。分类问题的y就是类别,而这个类别信息的值被设置成0或1,这个值并不是随意赋予的,如果该样本是正类则为1,否则为0。也就是说,在清理数据时,就已经把正类当作标准,预测时理所应当也得把正类当作标准。

损失函数需要把预测结果和实际结果结合起来,如果把预测结果看作概率,则可以写出第一版损失函数:

L ( x ) = − H ( x i ) y i ( 1 − H ( x i ) ) 1 − y i (4-6) L(x)=-H(x_i)^{y_i}(1-H(x_i))^{1-y_i}\tag{4-6} L(x)=−H(xi)yi(1−H(xi))1−yi(4-6)

这是一个很巧妙的函数,是根据概率设计出来的。函数的值由 H ( x i ) y i H(x_i)^{y_i} H(xi)yi和 ( 1 − H ( x i ) ) 1 − y i (1-H(x_i))^{1-y_i} (1−H(xi))1−yi两部分相乘,但由于y的值只会为0或1,所以实际上每次只会有一个部分能够输出值。

- 当y=1时,1-y就为0,所以第二部分的值为1,相乘后不会对函数的值产生影响,函数值为 H ( x i ) y i H(x_i)^{y_i} H(xi)yi。

- 同理,当y=0时,函数值为 ( 1 − H ( x i ) ) 1 − y i (1-H(x_i))^{1-y_i} (1−H(xi))1−yi。

现在确定一下损失函数是否正常工作。

当y=1时,如果预测正确,预测值则无限接近1,也即 H ( x i ) y i H(x_i)^{y_i} H(xi)yi的值为1,损失值则为-1。如果预测错误, H ( x i ) y i H(x_i)^{y_i} H(xi)yi的值为0,损失值也为0。预测错误的损失值确实比预测正确的大,满足要求。

也许刨根究底的你会好奇,为什么要在前面加个负号,难道只是一个硬性设定?其实前面已经提供答案,损失函数是根据概率来设计的,具体来说是根据似然函数 P ( Y ∣ X ; w ) P(Y|X; w) P(Y∣X;w)来指定的。“似然”这个概念比较复杂,我们将在后面详述,简单的理解就是预测值和实际结果越相似,似然函数的值越大。现在我们希望的是预测值与实际结果相差越大,函数的值越大,而只要对似然函数取负,就能达到这个目的。

第一版的损失函数虽然能够表达预测值和实际值之间的偏差,但存在一个致命的问题:它不是一个凸函数,这将导致无法使用梯度下降等优化方法使得损失值最小。好在机器学习界早就掌握了应对这种状况的解决方法:对数函数,也即取log。

关于对数函数的知识,我们只需要知道两点,首先对数都是单调函数,即要么递增,要么递减;然后大致了解一下不同底数所对应的函数图像,一共也就两类,当底数大于1时,函数单调递增,而当底数小于1并大于0时,函数单调递减。如果你觉得这也有点复杂的话,那么只需要知道,机器学习中大量使用了log,但底数均大于1,而且在绝大多数情况下都取自然对数e,也就是底数大于1的情况,函数图像是单调递增的(见图4-9)。

3. 具体步骤

Logistic回归和线性回归的步骤类似,输出却是一个离散的值。具体如表4-1所示。

具体步骤同样是三步:

- 为假设函数设定参数w,通过假设函数计算出一个预测值。

- 将预测值带入损失函数,计算出一个损失值。

- 通过得到的损失值,利用梯度下降等优化方法调整参数w。不断重复这个过程,使得损失值最小。

三、在Python中使用Logistic回归算法

1. LinearRegression类

对应线性回归算法,也称为普通最小二乘法,用于预测回归问题,损失函数的数学表达式:

L ( x ) = m i n w ∥ X w − y ∥ 2 2 (4-8) L(x)=\underset{w}{min}\|Xw-y\|^2_2 \tag{4-8} L(x)=wmin∥Xw−y∥22(4-8)

LinearRegression会调用fit方法来拟合数组X、y,并且将线性模型的系数存储在其成员变量coef_中。

2. Ridge类

对应Ridge回归算法,又称为岭回归,用于预测回归问题,是在线性回归的基础上添加了L2正则项,使得权重weight的分布更为平均,其损失函数的数学表达式如下:

L ( x ) = m i n w ∥ X w − y ∥ 2 2 + a ∥ w ∥ 2 2 (4-9) L(x)=\underset{w}{min}\|Xw-y\|^2_2+a\|w\|^2_2 \tag{4-9} L(x)=wmin∥Xw−y∥22+a∥w∥22(4-9)

表达式的左侧与线性回归算法的损失函数一致,只是额外添加了右侧的L2正则表达式,其中a是一个常数,根据经验设置。

3. Lasso类

对应Lasso回归算法。我们知道,常用的正则项有L1和L2,用了L2正则项的线性回归是Ridge回归,用了L1正则项的线性回归是什么呢?正是Lasso回归,同样用于预测回归问题。其损失函数的数学表达式如下:

L ( x ) = m i n w 1 2 n ∥ X w − y ∥ 2 2 + a ∥ w ∥ 1 (4-10) L(x)=\underset{w}{min}\frac{1}{2n}\|Xw-y\|^2_2+a\|w\|_1 \tag{4-10} L(x)=wmin2n1∥Xw−y∥22+a∥w∥1(4-10)

表达式的左侧与Ridge回归算法的损失函数基本一致,只是将右侧的L2正则表达式替换成了L1正则表达式。你可能关注到左侧式子相比线性回归,多了一个 1 2 n \frac{1}{2n} 2n1,其中n是样本数量,在优化过程的运算中不会发生变化,是一个常量,并不会对权重w的调整产生影响,所以本质还是一样的。

4. LogisticRegression类

# 导入线性模型中的Logistic回归算法

from sklearn.linear_model import LogisticRegression

# Scikit-Learn库中带有知名的鸢尾花分类数据集,是一个分类问题的数据集

from sklearn.datasets import load_iris

# 载入鸢尾花数据集

X, y = load_iris(return_X_y=True)

# 训练模型

clf = LogisticRegression().fit(X, y)

# 使用模型进行分类预测

clf.predict(X)

print("array({})".format(clf.predict(X)))

===================================================

array([0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0 0

0 0 0 0 0 0 0 0 0 0 0 0 0 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 1 2 1 1 1 2 1 1 1

1 1 1 1 1 1 1 1 1 2 2 2 1 1 1 1 1 1 1 1 1 1 1 1 1 1 2 2 2 2 2 2 2 2 2 2 2

2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 1 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2 2

2 2])

模型自带默认的性能评估器,使用方法如下:

print("{}".format(clf.score(X, y)))

=============================

0.96