遥感影像分类方法

最初的遥感影像分类是通过目视解译(濮静娟, 1984)来完成的,对研究人员的主观意识有较强的依赖性,而且效率较低,适用于数据量较小的情况,通常作为其他方法对比的对象。目前的遥感图像分类主要以计算机分类为主,因此按照人工参与的程度可以将分类方法划分为监督分类、非监督分类(陶超等, 2021)。

近年来,分类方法逐渐向机器学习的方向发展。传统机器学习方法,如Smolensky的受限玻尔兹曼机(Restricted Boltzmann Machine, RBM)( Midhun M E, 2014)、Olshausen和Field的稀疏编码(Sparse Coding, SC)(Olshausen B A&Field D J, 1996)等;深度学习是基于人脑学习的思想提出了一种深度神经网络的机器学习方法(Hinton G E, 2006)。

1监督分类

监督分类(Supervised Classification),是指利用人们对实验区域的先验知识,去定义地物的类别,通过选择训练样本将先验知识应用于分类过程,对不同分类器进行训练,然后用训练好的判决规则或者判决函数对未知数据进行分类;利用已知地物的信息对未知地物进行分类的方法。下面主要介绍最大似然、支持向量机、随机森林三种较为常见分类方法,目前在遥感影像分类中主要应用的是支持向量机和随机森林两种分类方法以及相应的优化方法。

1.1 最大似然分类法

最大似然分类(Maximum Likelihood Classification, MLC)(Ahmad A et al., 2012)又称贝叶斯分类。用统计方法根据最大似然比贝叶斯判决准则法建立非线性判别函数集,假定各类分布函数为正态分布,并选择训练区,计算待分类样区的归属概率,而进行分类的一种图像分类方法。

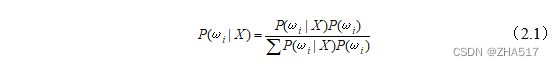

该方法是一种较为常见的分类方法,它的原理是基于贝叶斯理论:

最大似然分类的原理:设有k个类别,P(wi)表示第 i个类别发生的概率,P(X|wi)为对应类别的条件概率,由贝叶斯定理可以得到选择样本X的后验概率P(wi|X) 。通过这个后验概率来作为分类原则,将概率最大的判定为属于哪一个类别。

图 4 最大似然分类步骤

最大似然法的优点是简单,便于操作,而且可以和贝叶斯理论、其他先验知识融合,但是它也有自身的缺陷,如只适合于波段数少的多波段数据,还有分类时间长,训练样本要求较高等问题。

1.2 支持向量机分类法

支持向量机(Support Vector Machine, SVM)是一种基于统计学习理论的机器学习算法(Corinna C et al., 1995; Gualfieri J A&Cromp R F, 1998),采用结构风险最小化(Structural Risk Minimization, SRM )原理。根据有限的样本信息在模型的复杂性和学习能力之间寻求最佳平衡,以求获得最好的推广能力。是一种对线性和非线性数据进行分类的方法。它使用一种非线性映射,把原始训练数据映射到较高的维上,在新的维上搜索最佳分离超平面。

SVM可分为线性可分的线性SVM、线性不可分的线性SVM、非线性SVM。如果训练数据线性可分,则通过硬间隔最大化学习得到一个线性分类器即线性可分支持向量机,也称硬间隔支持向量机(Tzotsos A et al., 2008);如果训练数据近似线性可分,则通过软间隔最大化学习得到一个线性分类器即线性支持向量机,也称软间隔支持向量机(Theodoridis S et al., 2003);对于数据非线性可分的情况,通过扩展线性SVM的方法,得到非线性的SVM,即采用非线性映射把输入数据变换到较高维空间,在新的空间搜索分离超平面(Optimal Separating Hyperplane, OSH) (Mountrakis G et al., 2011; Min J H et al., 2005)。

对于一个二分类问题, 在 d 维特征空间中有N个训练模式,每个模式的目标属性yi∈(-1,1) 。非线性 SVM 把数据投影到一个更高维的特征空间 ,在这个空间里,两个类别的区分是通过寻找一个权向量为w偏置为b的OSH:

f(x)是超平面的判别函数, 与OSH平行且在平面f(x)=±1上的训练样本称为支持向量 (Support Vectors, SVs)。OSH是通过最大化两个超平面的距离和最小化训练错误优化计算。

图 5 SVM二维线性分类

通常采用的核函数有以下两种:

多项式函数(Polynomial Kernel):

径向基函数(Radial Basis Function):

其中:d是多项式函数的阶数, γ是径向基函数的宽度。

SVM最初是用来解决两类模式识别问题,通常有两种多类SVM算法:一对一(One Against One, OAO)和一对多(One Against All, OAA),对每个两类问题使用一个SVM,最终的类别归属用投票的方式确定;而OAA则是对k类问题采用k个分类器,每个分类器解决类别i和其它所有类别的区分问题,最终根据区分函数值的大小来确定每个样本的属性。

SVM算法,使用核函数可以向高维空间进行映射;使用核函数可以解决非线性的分类;分类思想很简单,就是将样本与决策面的间隔最大化,分类效果较好。但是SVM算法对大规模训练样本难以实施,解决多分类问题存在困难,对缺失数据敏感,对参数和核函数的选择敏感。

1.3 随机森林分类方法

随机森林 (Random Forest, RF)算法(Breiman L, 2001)是一种将多颗决策树组合到一起进行分类的算法。随机森林就是通过集成学习的Bagging思想将多棵树集成的一种算法,它的基本单元就是决策树。

图 6 随机森林构建步骤

每一颗决策树模型的训练是通过自助采样法抽出来的,在构建每一颗决策树模型的时候是从所有特征中随机抽取一个子集来对模型进行训练。随机森林算法是由众多的决策树组成,每一决策树会产生一种分类结果,而随机森林则是将所有结果汇总从中选出最佳的分类器,进行分类。

图 7 随机森林分类流程

随机森林算法是一种比较成熟的算法,在光学遥感影像土地利用分类中普遍使用,特别是在数据维度较高,样本数据少,同时对准确性要求较高的多光谱、多时相遥感影像分类中,随机森林算法更能体现速度快、精度高、稳定性好的优势,取得了很好的应用效果。

2 非监督分类

非监督分类主要采用聚类分析的方法, 根据光谱或者空间特征 , 把像素按照相似性归成若干类别 "它的目的是使得属于同一类别的像素之间的距离尽可能的小而不同类别上像素间的距离尽可能的大。非监督分类凭计算机自己对数据进行处理从而分出不同类别,但是不能确定分类结果的属性(Hemalatha S and Anouncia S M, 2016)。下面主要介绍K均值和ISODATA分类方法。

2.1 K均值分类方法

K均值分类算法(K-Means)是一种迭代求解的聚类分析算法,是由MacQueen首先提出。其基本思想对于给定的聚类数目K,首先随机创建一个初始划分,然后采用迭代方法通过将聚类中心不断移动来尝试着改进划分(张文君等, 2006)。

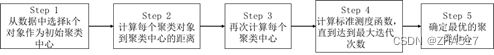

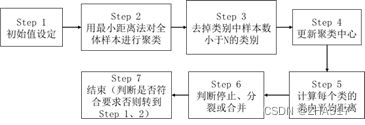

图 8 K均值分类步骤

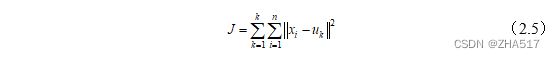

K均值采用距离作为相似性指标,从而发现给定数据集中的K个类,且每个类的中心是根据类中所有值的均值得到,每个类用聚类中心来描述。对于给定的一个包含n个d维数据点的数据集X以及要分得的类别K,选取欧式距离作为相似度指标,聚类目标是使得各类的聚类平方和最小,即使得距离J最小化:

结合最小二乘法和拉格朗日原理,聚类中心为对应类别中各数据点的平均值,同时为了使得算法收敛,在迭代过程中,应使最终的聚类中心尽可能的不变。

K-Means算法对孤立点敏感。因为是相似度的度量是以某个样本到类别中心的距离作为依据的,同时,类别中心也是用所有属于当前类别的样本的均值计算得到的,所以如果总体样本集合中存在噪声点,或者孤立点,那么,它必然会影响到最后的分类结果。

2.1 ISODATA分类方法

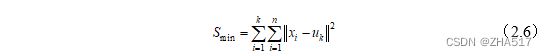

迭代自组织的数据分析算法(Iterative Self Organizing Data Analysis Techniques Algorithm , ISODATA)与K均值分类有很多相似之处,它在K-均值算法的基础上,对分类过程增加了“合并”和“分裂”两个操作,并通过设定参数来控制这两个操作的一种聚类算法(Ball G H&Hall D J, 1965)。

该算法思想首先确定初始分类个数确定归类阈值,通过引入归并与分裂过程不断调整类别个数,两种类别之间的样本均值距离小于参数值时,就触发归并机制进行归类,如果大于参数值则进行分裂,分成两类,如此不断调整分类样本个数和参数值进行分类,直到迭代结果较为满意为止。与K均值的目标函数是相同的:

图 9 ISODATA算法分类步骤

ISODATA 算法简单具有较好的分类精度,同物异谱和同谱异物对 ISODATA 算法分类精度影像较大。传统的 ISODATA 算法以一整幅遥感影像为处理对象,边学习边分类,分类效率低,并行计算技术和 ISODATA 算法的结合解决了运算耗时问题。

3 深度学习分类方法

深度学习(LECUN Y, 2015)是一种端到端的模型,它起源于人工神经网络的研究,是模拟人脑神经元认知过程的一种抽象计算模型,能够从原始数据中学习一个低层次的表达,并在此基础上通过线性或非线性组合获得高层次的表达(Hinton G E, 2006)。其主要的思想就是利用神经网络进行信息识别,通过利用大量的样本进行训练,寻找样本数据内在的规律,得到最优训练模型,然后将待处理数据输入训练模型得到最优分类的过程。

深度神经网络(Deep Neural Network, DNN)也称深度学习(Deep Learning)已成为一种从海量图像数据中直接学习图像特征表达的强大框架。从计算机视觉的角度提取遥感影像信息,能够极大地提高含有大量未知信息的遥感图像分类的精度。因此,深度学习成为遥感图像分类研究中的热点。下面介绍几种主要的深度学习方法。

3.1 卷积神经网络

卷积神经网络(Convolutional Neural Networks, CNN)是对二维数字图像进行处理的复杂神经网络结构(LeCun Y, 1989; Krizhevsky A et al., 2012)。

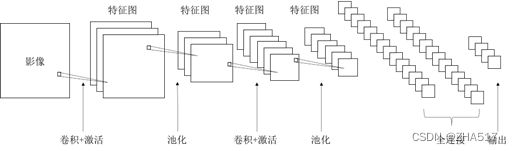

图 10 卷积神经网络架构

CNN 是一种带有卷积结构的神经网络,包含卷积层(Convolutional Layer)、池化层(Pooling Layer)和全连接层(Fully Connected Layers),其“,通过卷积、池化等操作,对图像的高层语义特征进行提取。CNN 采用局部感知、权值共享和下采样的方式,一方面减少了参数量使网络易于优化,另一方面能提高了网络训练性能,提升分类效果。

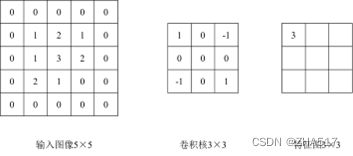

卷积层是 CNN 的最核心部分,它是利用卷积核对上一层得到的特征图进行卷积运算并产生相应输出的网络层。假设输入图像为 3×3 大小的图像,通常边界填充补0得到一个 5×5 大小图像,从图像的左上角开始,用一个 3×3 的卷积核(Kernel Size)以步距为1在原图中从左至右、从上至下进行滑动,将卷积核与相应的图像像元相乘再相加计算,并用计算结果代替窗口中心的像元值,由此得到输出的特征图。利用不同的卷积核提取影像不同的特征。

图 11 卷积过程示意图

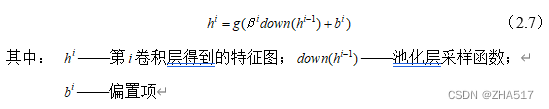

池化层又叫作下采样层,池化层能够缩小特征图尺寸,减少参数量,降低网络的复杂度和计算量;另外池化层能够对特征进行压缩,使特征更加抽象和具有概括性。

池化计算公式:

CNN因其强大的图像特征提取能力,现在也被广泛应用在遥感影像分类中, CNN发展出更深的模型包括LeNet、A1exNet、VGG、ResNet等(LeCun Y, 1990;LeCun Y, 1998;Fan J et al., 2010; Simonyan K& Zisserman A, 2014;He K, 2016)。CNN 的强大之处在于它的多层神经网络结构能够自动学习影像的深层次特征,同时,CNN 的局部连接、权值感知和下采样的特点,使学习到的特征具有平移、旋转和缩放不变性,更重要的是,它能够学习遥感影像中由于传感器拍摄角度不同、地物尺度不同等原因造成的地物不同形态的特征,有利于提高遥感影像的分类精度。然而,CNN 的下采样操作会降低影像分辨率,丢失细节信息,输出的结果通常是待分类图像属于某一类别的概率向量值,且 CNN 的全连接层中的向量长度是固定的,限制了输入图像的尺寸也必须为固定值。

3.2 全卷积神经网络

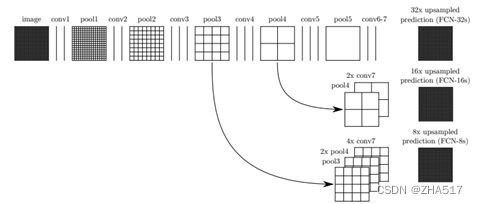

全卷积神经网络(Fully Convolutional Networks, FCN)是在 CNN 基础上的发展和延伸。针对CNN的缺点进行了改进并提出了FCN(Long J et al., 2015)。用于解决图像语义分割方面的问题。

图像语义分割的概念延伸至遥感领域即是遥感影像的分类,因此,FCN 能够确定遥感影像中每一个像素的类别,不仅能够识别像素“是什么”,还能够定位像素“在哪里”,实现了从 CNN 图像级别的分类进一步延伸到像素级别的分类。

FCN可以接受任意尺寸的输入图像,采用反卷积层对最后一个卷基层的特征图进行上采样,使它恢复到输入图像相同的尺寸,从而可以对每一个像素都产生一个预测,同时保留了原始输入图像中的空间信息。

图 12 FCN网络结构示意图(Long J et al., 2015)

FCN仍有一些缺点,得到的结果还不够精细,对细节不够敏感;没有考虑像素与像素之间的关系,缺乏空间一致性等。

FCN 主要有三个特点,分别是全卷积化、上采样和跳跃结构。 全卷积化是指将网络结构中的全连接层全部转换成卷积层。一方面,它将输出结果从一维向量转换为二维矩阵,有利于进行后续的上采样操作。另一方面,由于全连接层的神经元节点是固定的,因此它与上一层特征图中所有神经元节点之间的权值个数也是固定的,当神经网络结构确定后,权值个数不能改变,特征图的大小也不能改变,所以层层反推。

全卷积化的 FCN 可以接受任意尺寸的输入图像。同时,GPU能够加速卷积操作,进而缩短计算时间,提高计算效率。上采样能够保证预测图与输入图像间具有相同的尺寸,实现像素到像素之间的映射。但由于 FCN 中的池化操作会降低图像分辨率,因此最后一层卷积层输出的特征图会丢失细节信息,且上采样过程只能还原图像尺寸,无法还原图像的本来特征,因此对特征图进行上采样后获得的图像分割精度低,分割边缘粗糙。基于此,J Long 提出了跳跃结构(Long J et al., 2015)。

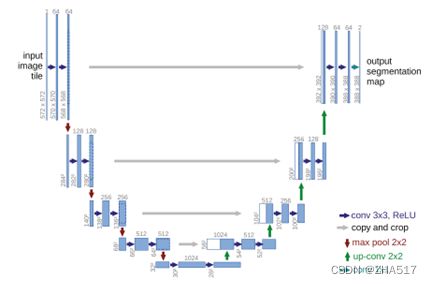

3.3 U-Net模型

U-Net模型是O Ronneberger 等人提出的一种改进的 FCN 结构,最初应用于医学图像的语义分割,它由左半边的压缩通道(Contracting Path)和右半边扩展通道(Expansive Path)组成,因结构清晰优雅呈 U 状而得名。

图 13 U-Net结构(Ronneberger O et al.,2015)

压缩通道是典型的卷积神经网络结构,它重复采用 2 个卷积层和 1 个最大池化层的结构,每进行一次池化操作后特征图的维数就增加 1 倍。在扩展通道,先进行 1 次反卷积操作,使特征图的维数减半,然后拼接对应压缩通道裁剪得到的特征图,重新组成一个 2 倍大小的特征图,再采用 2 个卷积层进行特征提取,并重复这一结构。在最后的输出层,用 2 个卷积层将 64 维的特征图映射成 2 维的输出图。

U-Net 模型是 FCN 的改进和延伸,它沿用了 FCN 进行图像语义分割的思想,即利用卷积层、池化层进行特征提取,再利用反卷积层还原图像尺寸。然而 U-Net 融合了编码-解码结构和跳跃网络的特点。

U-Net 模型在较少的训练样本情况下也能得到更加准确的分类结果。U-Net以模型结构简洁、鲁棒性高等优势,受到了遥感领域研究人员的关注,其模型也被不断改进,并广泛应用影像分类中。

图像的语义分割模型还有DeepLab、SegNet等,其中DeepLab已经有V1、V2、V3、V3+四个版本(Chen L C et al., 2014; Badrinarayanan V, 2015;Chen L C et al., 2017; Chen L C et al., 2018),并且有很多研究者都提出了各种优化模型以改善模型的适用性以及准确性。针对应用中的缺陷进行优化。这些模型其最初都是在其他的领域应用,如计算机视觉、医学影像等领域,因为其优势在遥感领域受到研究者的关注被逐渐应用在了遥感影像分类。

深度学习具有特征学习和深层结构两个特点,有利于遥感图像分类精度的提升。特征学习能够根据不同的应用自动从海量数据中学习到所需的高级特征表示,更能表达数据的内在信息。深层结构通常拥有多层的隐层节点,包含更多的非线性变换,使得拟合复杂模型的能力大大增强。

4 分类方法应用分析

各种分类方法的最终目的都是将影像中的每个像元根据其在不同的波段、空间或其他信息中表现出来与其他周围像元不同的特征,依据一定的规则和算法将其进行归类。最简单的是依靠专业人士的专业经验对像元信息进行判断,随之便是利用单一光谱亮度值进行半自动化分类。

对于复杂的异构景观的空间单元,目视解译提供了一个有效方法(Antrop M&Van Eetvelde V, 2000),Antrop利用目视解译方法对郊区景观全方位进行研究,构建了景观指数图;目视解译可以从遥感影像中直接获取目标地物(Schepaschenko, D, 2019);而且目视解译还能够较为准确的从影像中获取时序影像的变化(Bastin J-F et al., 2017)。

目视解译主要依靠专业人士的专业知识对遥感图像的分析解译以及相应的光谱特征描述。通过解译标识的建立、类别的判断等工作完成分类,该方法过于依赖人的专业知识,面对海量影像数据分类效率不高,但是总体分类精度较高。监督分类利用计算机自动分类,计算效率远高于目视解译方法,适用于大范围的研究区域,是目前遥感影像信息提取普及率较高的方法之一。

Otukei 等(Otukei J R et al., 2009)以Landsat影像为实验数据,研究帕利萨区的基巴莱县的土地利用变化,最大似然分类精度达到87%以上。郑彦龙等(郑彦龙等, 2017)用Landsat 影像对咸安区进行最大似然分类,将该区域的土地利用类型分为六类,分类总体精度高达 90% 以上。樊利恒(樊利恒等, 2017)等用多光谱数据得到了印第安纳州Tippecanoe 郡的分类结果,改进后的最大似然法总体分类精度提高3%以上。李杰等(李杰等, 2018)以0.5m分辨率的 WorldView-2 影像数据和1m分辨率的 IKONOS 全色遥感图像数据,利用最大似然分类方法进行实验,结果总体精度都高达85%。赵恒谦等(赵恒谦等, 2019)使用SVM分类方法对2006—2016年北京市通州区地物类型进行分类,整体分类精度均高于80%以上。张静(张静等, 2019)等使用 Landsat TM 多光谱影像, 通过对支持向量机引入地表植被指数以及地物在影像中的纹理信息特征进行优化,分类总体精度最高达到 97%。郭玉宝等(郭玉宝等, 2016)以北京市某区国产高分一号影像数据,利用随机森林算法进行土地利用情况进行分类提取分析,3种分类方法中随机森林总体分类精度达到 85%以上。李玉等(李玉等, 2019)人提出一种基于熵加权的K-Means全局信息聚类的分类算法,对高光谱图像中具有不同光谱反射率差异程度的各类地物目标均能取得很好的分类结果。

监督分类可以根据研究区域和研究目的,充分利用该地区的先验经验,来决定分类类别,避免不必要的分类,可以通过对训练样本的控制与检查判断样本数据是否被精准分类,避免重大错误。由于监督分类中训练样本的选择人为因素较强,研究人员定义的分类类别可能并非影像中存在的类别,或者影像中某些类别没有被定义均会导致监督分类方法无法识别。

Abbas 等(Abbas, 2016)以巴基斯坦大气研究委员会的卫星数据为数据源,选择巴基斯坦东北部巴德地区作为研究区域,以 ISODATA 算法作为影像分类的研究方法,迭代次数增加时分类精度也相应提高。韩洁等(韩洁, 2017)使用ISODATA对QuickBird 影像数据初步分割,同时融合了几何、纹理等信息进行道路提取,最终结果表明实验相比其他算法在完整率、正确率和监测质量平均提高了 26. 61% 、5. 57% 和 26. 77%。朱爽等(朱爽, 2020)利用 ISODATA 算法对北京郊区 Landsat TM 影像中冬小麦种植区进行提取,ISODATA 算法的像元精度达到86.6%。

非监督分类不需要像监督分类预先对研究区域进行样本训练,降低了研究人员对样本分类差错导致的分类错误的概率,但是仍然需要经验丰富的研究员对分类集群进行解译。非监督分类只需要设定初始参数( 迭代次数,误差阈值等) 即可自动进行分类,而且可以识别影像中特殊的、小覆盖类别。由于分类之前没有进行过训练,其分类结果需要大量的分析,结果中的类别可能并非研究员所需要的类别,研究人员需要对结果进行类别匹配,而且分集群会因光谱特征的变化(时间、地形变化) 无法连续。

Chen等人(Chen J et al., 2020)使用带标记的数据集自动学习 CNN 架构,从而获得可以适应不同类型数据的CNN网络。该方法的提出可以帮助理解哪些类型的特征对于遥感图像的智能理解是至关重要的。Zhang等(Zhang W et al., 2019)人将CNN和CapsNet结合起来用于场景分类,使最终的分类结果相比单一网络而言得到有效提升。REZAEE等(Rezaee M et al.,2018)采用在ImageNet上预训练的A1exNet网络进行了湿地土地覆被制图的研究,并将其与随机森林等经典机器学习模型进行比较,结果表明卷积神经网络可以有效改善湿地土地覆被分类精度。吴永静等(吴永静等, 2021)采用ResNet作为特征提取网络对DeepLab进行改进,并基于高分辨率遥感影像实现了光伏用地的高精度分类。Han等(Fu H, 2021)人基于DeepLab V3+网络的深度学习方法,利用多源数据(包括光学遥感影像和数字高程模型DEM数据)记录锥体溶岩景观。采用基于深度学习的像素级图像分割方法,以四通道数据作为训练样本的并集平均交集最高,精度可达95.5%。

深度学习分类模型有很多类,神经网络对于待分类别的先验知识要求较少,计算过程高速并行,可以处理海量数据,处理特征空间较为复杂数据,在处理非线性分类时优势明显。由于神经网络层数确定并没有理论基础,目前均以实验确定,因此算法存在收敛速度慢,参数复杂,易限于局部极小,网络层和神经元个数难确定的局限。但是各种分类方法都有自身的局限性又各有优点。

参考:

- Ball G H, Hall D J. ISODATA, a novel method of data analysis and pattern classification[R]. Stanford research inst Menlo Park CA, 1965.

- LeCun Y, Boser B, Denker J S, et al. Backpropagation applied to handwritten zip code recognition[J]. Neural computation, 1989, 1(4): 541-551.

- LeCun Y, Denker J, Henderson D, et al. Imagenet classification with deep convolutional neural networks[J]. Advances in neural information processing systems, 1990.

- Bastin J-F, Berrahmouni N, Grainger A et al (2017a) The extent of forest in dryland biomes. Science 356:635–638.

- Cortes C, Vapnik V. Support-vector networks[J]. Machine learning, 1995, 20(3): 273-297.

- Olshausen B A, Field D J. Emergence of simple-cell receptive field properties by learning a sparse code for natural images[J]. Nature, 1996, 381(6583): 607-609.

- LeCun Y, Bottou L, Bengio Y, et al. Gradient-based learning applied to document recognition[J]. Proceedings of the IEEE, 1998, 86(11): 2278-2324.

- Gualtieri J A, Cromp R F. Support vector machines for hyperspectral remote sensing classification[C]. 27th AIPR workshop: advances in computer-assisted recognition. SPIE, 1999, 3584: 221-232.

- Antrop M, Van Eetvelde V. Holistic aspects of suburban landscapes: visual image interpretation and landscape metrics[J]. Landscape and urban planning, 2000, 50(1-3): 43-58.

- Breiman L. Random forests[J]. Machine learning, 2001, 45(1): 5-32.

- Theodoridis S,Koutroumbas K. Pattern recognition[M]. 2nd ed, 2003, New York: Elsevier Academic Press.

- Min J H, Lee Y C. Bankruptcy prediction using support vector machine with optimal choice of kernel function parameters[J]. Expert systems with applications, 2005, 28(4): 603-614.

- HINTON G E,SALAKHUTDINOV P R.Reducing the dimensionality of data with neural networks[J].Science,2006,313(5786) : 504-507.

- Tzotsos A, Argialas D. Support vector machine classification for object-based image analysis[M]. Object-based image analysis. Springer, Berlin, Heidelberg, 2008: 663-677.

- Otukei J R, Blaschke T. Land cover change assessment using decision trees,support vector machines and maximum likelihood classification algorithms[J]. International Journal of Applied Earth Observations and Geoinformation, 2009, 12: 27-31.

- Fan J, Xu W, Wu Y, et al. Human tracking using convolutional neural networks[J]. IEEE transactions on Neural Networks, 2010, 21(10): 1610-1623.

- Mountrakis G, Im J, Ogole C. Support vector machines in remote sensing: A review[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 2011, 66(3): 247-259.

- Hinton G E, Deng L, Yu D, et al. Deep neural networks for acoustic modeling in speech recognition: The shared views of four research groups[J]. IEEE Signal Processing Magazine, 2012, 29(6): 82-97.

- Ahmad A, Quegan S. Analysis of maximum likelihood classification on multispectral data[J]. Applied Mathematical Sciences, 2012, 6( 129): 6425-6436.

- Krizhevsky A, Sutskever I, Hinton G E. Imagenet classification with deep convolutional neural networks[J]. Advances in neural information processing systems, 2012, 25.

- Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition[J]. arXiv preprint arXiv:1409.1556, 2014.

- Chen L C, Papandreou G, Kokkinos I, et al. Semantic image segmentation with deep convolutional nets and fully connected crfs[J]. arXiv preprint arXiv:1412.7062, 2014.

- Midhun M E, Nair S R, Prabhakar V T, et al. Deep model for classification of hyperspectral image using restricted boltzmann machine[C]. Proceedings of the 2014 International Conference on Interdisciplinary Advances in Applied Computing. ACM, 2014: 35.

- Badrinarayanan V, Kendall A, SegNet R C. A deep convolutional encoder-decoder architecture for image segmentation[J]. arXiv preprint arXiv:1511.00561, 2015, 5.

- Ronneberger O, Fischer P, Brox T. U-Net: Convolutional networks for biomedical image segmentation[M]. Medical Image Computing and Computer-Assisted Intervention—MICCAI 2015. Springer International Publishing, 2015:234-241.

- LECUN Y,BENGl0 Y,HINTON G.Deep learningI[J].Nature,2015,521:436—444.

- Long J, Shelhamer E, Darrell T. Fully convolutional networks for semantic segmentation[C]. Proceedings of the IEEE conference on computer vision and pattern recognition. 2015: 3431-3440.

- Abbas A W, Minallh N, Ahmad N, et al. K-means and ISODATA clustering algorithms for landcover classification using remote sensing[J]. Sindh University Research Journal (Science Series), 2016,48(2) : 315-318.

- He K, Zhang X, Ren S, et al. Deep residual learning for image recognition[C]. Proceedings of the IEEE conference on computer vision and pattern recognition. 2016: 770-778.

- Chen L C, Papandreou G, Kokkinos I, et al. Deeplab: Semantic image segmentation with deep convolutional nets, atrous convolution, and fully connected crfs[J]. IEEE transactions on pattern analysis and machine intelligence, 2017, 40(4): 834-848.

- Hemalatha S, Anouncia S M. Unsupervised segmentation of remote sensing images using FD based texture analysis model and ISODATA[J]. International Journal of Ambient Computing and Intelligence (IJACI), 2017, 8(3): 58-75.

- Chen L C, Papandreou G, Schroff F, et al. Rethinking atrous convolution for semantic image segmentation[J]. arXiv preprint arXiv:1706.05587, 2017.

- Chen L C, Zhu Y, Papandreou G, et al. Encoder-decoder with atrous separable convolution for semantic image segmentation[C]. Proceedings of the European conference on computer vision (ECCV). 2018: 801-818.

- Rezaee M, Mahdianpari M, Zhang Y, et al. Deep convolutional neural network for complex wetland classification using optical remote sensing imagery[J]. IEEE Journal of Selected Topics in Applied Earth Observations and Remote Sensing, 2018, 11(9): 3030-3039.

- Schepaschenko, D, See, L, Lesiv, M,. et al. Recent Advances in Forest Observation with Visual Interpretation of Very High-Resolution Imagery. Surv Geophys 40, 839–862 (2019).

- Zhang W, Tang P, Zhao L. Remote sensing image scene classification using CNN-CapsNet[J]. Remote Sensing, 2019, 11(5): 494.

- Chen J, Huang H, Peng J, et al. Convolution neural network architecture learning for remote sensing scene classification[J]. arXiv preprint arXiv:2001.09614, 2020.

- Fu H, Fu B, Shi P. An improved segmentation method for automatic mapping of cone karst from remote sensing data based on deeplab V3+ model[J]. Remote Sensing, 2021, 13(3): 441.

- 濮静娟. 应用遥感图象研究河床演变[J].地理科学,1984(03):235-242+293.

- 张文君,顾行发,陈良富,余涛,许华.基于均值-标准差的K均值初始聚类中心选取算法[J].遥感学报,2006(05):715-721.

- 樊利恒,吕俊伟,于振涛,等. 基于改进最大似然方法的多光谱遥感图像分类方法[J].电光与控制,2014,21 ( 10) : 52-56,74

- 翁健. 基于全卷积神经网络的全向场景分割研究与算法实现 [D].山东大学,2017.

- 郭玉宝,池天河,彭玲, 等. 利用随机森林的高分一号遥感数据进行城市用地分类[J]. 测绘通报,2016(5) : 73-76.

- 郑彦龙,江辉仙,刘文霞. 基于高分遥感影像的城市精细土地分类研究[J].福建师范大学学报(自然科学版) , 2017, 33(6) : 60-68.

- 韩洁,郭擎,李安. 结合非监督分类和几何-纹理-光谱特征的高分影像道路提取[J].中国图象图形学报,2017,22(12) : 1788-1797.

- 张静,张翔,田龙等. 西北旱区遥感影像分类的支持向量机法[J]. 测绘科学,2017,42(1) : 49-52, 58

- 李杰,李玉,王玉,等. 结合最大似然算法和波利亚罐模型的全色遥感图像分类[J].测绘通报, 2018( 4) : 36-43, 49.

- 李玉,甄畅,石雪,赵泉华.基于熵加权K-means全局信息聚类的高光谱图像分类[J].中国图象图形学报,2019,24(04):630-638.

- 赵恒谦,贾梁,尹政然,等. 基于多源遥感数据的北京市通州区土地利用/覆盖与生态环境变化监测研究[J].地理与地理信息科学,2019,35(1) : 38-43.

- 朱爽,张锦水,李长青等. 软硬结合分类方法提取特定地物信息--以冬小麦为例[J].中国农业资源与区划, 2020,41(8) : 31-40.

- 陶超,阴紫薇,朱庆,李海峰. 遥感影像智能解译:从监督学习到自监督学习[J].测绘学报,2021,50(08):1122-1134.

- 吴永静,吴锦超,林超,窦宝成,黎珂.基于深度学习的高分辨率遥感影像光伏用地提取[J].测绘通报,2021(05):96-101.