pytorch 图像分割的交并比_Pytorch深度学习实战教程:UNet模型训练

1

前言本文属于 Pytorch 深度学习语义分割系列教程。

该系列文章的内容有:

Pytorch 的基本使用

语义分割算法讲解

由于微信不允许外部链接,你需要点击页尾左下角的“

2

项目背景

深度学习算法,无非就是我们解决一个问题的方法。选择什么样的网络去训练,进行什么样的预处理,采用什么Loss和优化方法,都是根据具体的任务而定的。

所以,让我们先看一下今天的任务。

没错,就是 UNet 论文中的经典任务:医学图像分割。

选择它作为今天的任务,就是因为简单,好上手。

简单描述一个这个任务:如动图所示,给一张细胞结构图,我们要把每个细胞互相分割开来。

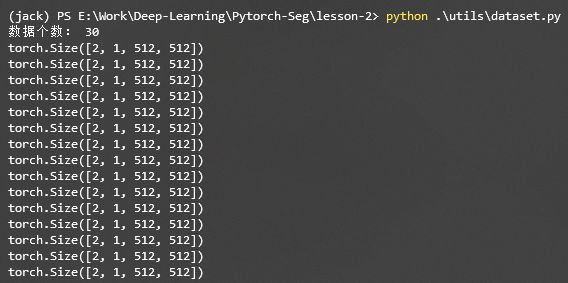

这个训练数据只有30张,分辨率为512x512,这些图片是果蝇的电镜图。

好了,任务介绍完毕,开始准备训练模型。

3

UNet训练 想要训练一个深度学习模型,可以简单分为三个步骤:数据加载:数据怎么加载,标签怎么定义,用什么数据增强方法,都是这一步进行。

模型选择:模型我们已经准备好了,就是该系列上篇文章讲到的 UNet 网络。

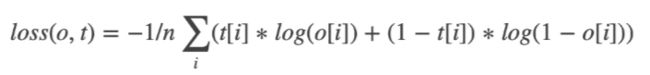

算法选择:算法选择也就是我们选什么 loss ,用什么优化算法。

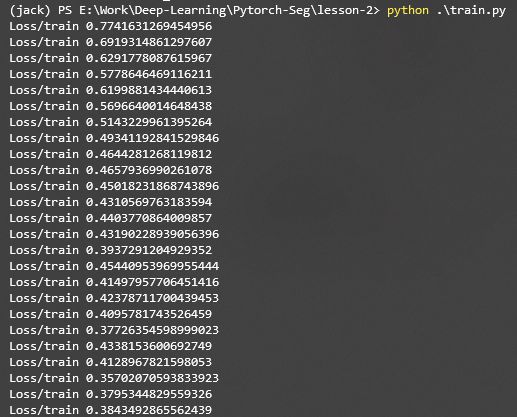

# ================================================================== ## Input pipeline for custom dataset ## ================================================================== ## You should build your custom dataset as below.class CustomDataset(torch.utils.data.Dataset): def __init__(self): # TODO # 1. Initialize file paths or a list of file names. pass def __getitem__(self, index): # TODO # 1. Read one data from file (e.g. using numpy.fromfile, PIL.Image.open). # 2. Preprocess the data (e.g. torchvision.Transform). # 3. Return a data pair (e.g. image and label). pass def __len__(self): # You should change 0 to the total size of your dataset. return 0 # You can then use the prebuilt data loader. custom_dataset = CustomDataset()train_loader = torch.utils.data.DataLoader(dataset=custom_dataset, batch_size=64, shuffle=True)import torchimport cv2import osimport globfrom torch.utils.data import Datasetimport randomclass ISBI_Loader(Dataset): def __init__(self, data_path): # 初始化函数,读取所有data_path下的图片 self.data_path = data_path self.imgs_path = glob.glob(os.path.join(data_path, 'image/*.png')) def augment(self, image, flipCode): # 使用cv2.flip进行数据增强,filpCode为1水平翻转,0垂直翻转,-1水平+垂直翻转 flip = cv2.flip(image, flipCode) return flip def __getitem__(self, index): # 根据index读取图片 image_path = self.imgs_path[index] # 根据image_path生成label_path label_path = image_path.replace('image', 'label') # 读取训练图片和标签图片 image = cv2.imread(image_path) label = cv2.imread(label_path) # 将数据转为单通道的图片 image = cv2.cvtColor(image, cv2.COLOR_BGR2GRAY) label = cv2.cvtColor(label, cv2.COLOR_BGR2GRAY) image = image.reshape(1, image.shape[0], image.shape[1]) label = label.reshape(1, label.shape[0], label.shape[1]) # 处理标签,将像素值为255的改为1 if label.max() > 1: label = label / 255 # 随机进行数据增强,为2时不做处理 flipCode = random.choice([-1, 0, 1, 2]) if flipCode != 2: image = self.augment(image, flipCode) label = self.augment(label, flipCode) return image, label def __len__(self): # 返回训练集大小 return len(self.imgs_path)if __name__ == "__main__": isbi_dataset = ISBI_Loader("data/train/") print("数据个数:", len(isbi_dataset)) train_loader = torch.utils.data.DataLoader(dataset=isbi_dataset, batch_size=2, shuffle=True) for image, label in train_loader: print(image.shape)""" Parts of the U-Net model """"""https://github.com/milesial/Pytorch-UNet/blob/master/unet/unet_parts.py"""import torchimport torch.nn as nnimport torch.nn.functional as Fclass DoubleConv(nn.Module): """(convolution => [BN] => ReLU) * 2""" def __init__(self, in_channels, out_channels): super().__init__() self.double_conv = nn.Sequential( nn.Conv2d(in_channels, out_channels, kernel_size=3, padding=1), nn.BatchNorm2d(out_channels), nn.ReLU(inplace=True), nn.Conv2d(out_channels, out_channels, kernel_size=3, padding=1), nn.BatchNorm2d(out_channels), nn.ReLU(inplace=True) ) def forward(self, x): return self.double_conv(x)class Down(nn.Module): """Downscaling with maxpool then double conv""" def __init__(self, in_channels, out_channels): super().__init__() self.maxpool_conv = nn.Sequential( nn.MaxPool2d(2), DoubleConv(in_channels, out_channels) ) def forward(self, x): return self.maxpool_conv(x)class Up(nn.Module): """Upscaling then double conv""" def __init__(self, in_channels, out_channels, bilinear=True): super().__init__() # if bilinear, use the normal convolutions to reduce the number of channels if bilinear: self.up = nn.Upsample(scale_factor=2, mode='bilinear', align_corners=True) else: self.up = nn.ConvTranspose2d(in_channels // 2, in_channels // 2, kernel_size=2, stride=2) self.conv = DoubleConv(in_channels, out_channels) def forward(self, x1, x2): x1 = self.up(x1) # input is CHW diffY = torch.tensor([x2.size()[2] - x1.size()[2]]) diffX = torch.tensor([x2.size()[3] - x1.size()[3]]) x1 = F.pad(x1, [diffX // 2, diffX - diffX // 2, diffY // 2, diffY - diffY // 2]) x = torch.cat([x2, x1], dim=1) return self.conv(x)class OutConv(nn.Module): def __init__(self, in_channels, out_channels): super(OutConv, self).__init__() self.conv = nn.Conv2d(in_channels, out_channels, kernel_size=1) def forward(self, x): return self.conv(x)""" Full assembly of the parts to form the complete network """"""Refer https://github.com/milesial/Pytorch-UNet/blob/master/unet/unet_model.py"""import torch.nn.functional as Ffrom .unet_parts import *class UNet(nn.Module): def __init__(self, n_channels, n_classes, bilinear=True): super(UNet, self).__init__() self.n_channels = n_channels self.n_classes = n_classes self.bilinear = bilinear self.inc = DoubleConv(n_channels, 64) self.down1 = Down(64, 128) self.down2 = Down(128, 256) self.down3 = Down(256, 512) self.down4 = Down(512, 512) self.up1 = Up(1024, 256, bilinear) self.up2 = Up(512, 128, bilinear) self.up3 = Up(256, 64, bilinear) self.up4 = Up(128, 64, bilinear) self.outc = OutConv(64, n_classes) def forward(self, x): x1 = self.inc(x) x2 = self.down1(x1) x3 = self.down2(x2) x4 = self.down3(x3) x5 = self.down4(x4) x = self.up1(x5, x4) x = self.up2(x, x3) x = self.up3(x, x2) x = self.up4(x, x1) logits = self.outc(x) return logitsif __name__ == '__main__': net = UNet(n_channels=3, n_classes=1) print(net)from model.unet_model import UNetfrom utils.dataset import ISBI_Loaderfrom torch import optimimport torch.nn as nnimport torchdef train_net(net, device, data_path, epochs=40, batch_size=1, lr=0.00001): # 加载训练集 isbi_dataset = ISBI_Loader(data_path) train_loader = torch.utils.data.DataLoader(dataset=isbi_dataset, batch_size=batch_size, shuffle=True) # 定义RMSprop算法 optimizer = optim.RMSprop(net.parameters(), lr=lr, weight_decay=1e-8, momentum=0.9) # 定义Loss算法 criterion = nn.BCEWithLogitsLoss() # best_loss统计,初始化为正无穷 best_loss = float('inf') # 训练epochs次 for epoch in range(epochs): # 训练模式 net.train() # 按照batch_size开始训练 for image, label in train_loader: optimizer.zero_grad() # 将数据拷贝到device中 image = image.to(device=device, dtype=torch.float32) label = label.to(device=device, dtype=torch.float32) # 使用网络参数,输出预测结果 pred = net(image) # 计算loss loss = criterion(pred, label) print('Loss/train', loss.item()) # 保存loss值最小的网络参数 if loss < best_loss: best_loss = loss torch.save(net.state_dict(), 'best_model.pth') # 更新参数 loss.backward() optimizer.step()if __name__ == "__main__": # 选择设备,有cuda用cuda,没有就用cpu device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') # 加载网络,图片单通道1,分类为1。 net = UNet(n_channels=1, n_classes=1) # 将网络拷贝到deivce中 net.to(device=device) # 指定训练集地址,开始训练 data_path = "data/train/" train_net(net, device, data_path)4

预测

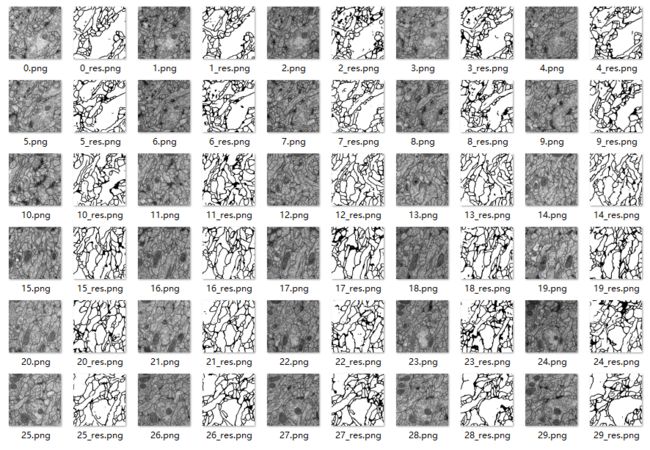

模型训练好了,我们可以用它在测试集上看下效果。

在工程根目录创建 predict.py 文件,编写如下代码:

import globimport numpy as npimport torchimport osimport cv2from model.unet_model import UNetif __name__ == "__main__": # 选择设备,有cuda用cuda,没有就用cpu device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') # 加载网络,图片单通道,分类为1。 net = UNet(n_channels=1, n_classes=1) # 将网络拷贝到deivce中 net.to(device=device) # 加载模型参数 net.load_state_dict(torch.load('best_model.pth', map_location=device)) # 测试模式 net.eval() # 读取所有图片路径 tests_path = glob.glob('data/test/*.png') # 遍历所有图片 for test_path in tests_path: # 保存结果地址 save_res_path = test_path.split('.')[0] + '_res.png' # 读取图片 img = cv2.imread(test_path) # 转为灰度图 img = cv2.cvtColor(img, cv2.COLOR_RGB2GRAY) # 转为batch为1,通道为1,大小为512*512的数组 img = img.reshape(1, 1, img.shape[0], img.shape[1]) # 转为tensor img_tensor = torch.from_numpy(img) # 将tensor拷贝到device中,只用cpu就是拷贝到cpu中,用cuda就是拷贝到cuda中。 img_tensor = img_tensor.to(device=device, dtype=torch.float32) # 预测 pred = net(img_tensor) # 提取结果 pred = np.array(pred.data.cpu()[0])[0] # 处理结果 pred[pred >= 0.5] = 255 pred[pred < 0.5] = 0 # 保存图片 cv2.imwrite(save_res_path, pred)运行完后,你可以在data/test目录下,看到预测结果:

大功告成!

5

最后本文主要讲解了训练模型的三个步骤:数据加载、模型选择、算法选择。

这是一个简单的例子,训练正常的视觉任务,要复杂很多。比如:在训练模型的时候,需要根据模型在验证集上的准确率选择保存哪个模型;需要支持tensorboard方便我们观察loss收敛情况等等。

PS:如果觉得本篇本章对您有所帮助,欢迎关注、评论、赞!

更多精彩内容(请点击图片进行阅读)

公众号: AI蜗牛车 保持谦逊、保持自律、保持进步

个人微信 备注: 昵称+学校/公司+方向 如果没有备注不拉群! 拉你进AI蜗牛车交流群

公众号: AI蜗牛车 保持谦逊、保持自律、保持进步

个人微信 备注: 昵称+学校/公司+方向 如果没有备注不拉群! 拉你进AI蜗牛车交流群

点个在看,么么哒!