sklearn——K近邻算法及朴素贝叶斯

sklearn——K近邻算法及朴素贝叶斯

一.K近邻算法

1.原理

定义:如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

来源:KNN算法最早是由Cover和Hart提出的一种分类算法

K近邻的核心算法:

两个样本的距离可以通过如下公式计算,又叫欧式距离

比如说,a(a1,a2,a3),b(b1,b2,b3)

2.sklearn API

①代码

from sklearn.neighbors import KNeighborsClassifier

KNN=KNeighborsClassifier(n_neighbors=5,algorithm='auto')

②参数含义

n_neighbors:int,可选(默认= 5),k_neighbors查询默认使用的邻居数

algorithm:{‘auto’,‘ball_tree’,‘kd_tree’,‘brute’},可选用于计算最近邻居的算法:‘ball_tree’将会使用 BallTree,‘kd_tree’将使用 KDTree。‘auto’将尝试根据传递给fit方法的值来决定最合适的算法。 (不同实现方式影响效率)

二.问题

1.k值取多大?有什么影响?

k值取很小:容易受异常点影响

k值取很大:容易受最近数据太多导致比例变化

2.性能问题

三.优缺点

1.优点

优点:

简单,易于理解,易于实现,无需估计参数,无需训练

2.缺点:

懒惰算法,对测试样本分类时的计算量大,内存开销大

必须指定K值,K值选择不当则分类精度不能保证

3.使用场景

小数据场景,几千~几万样本,具体场景具体业务去测试

四.鸢尾花分类

1.导入库

from sklearn.neighbors import KNeighborsClassifier

from sklearn.model_selection import train_test_split

导入鸢尾花分类数据集

from sklearn.datasets import load_iris

load_iris().data

load_iris().target

train_x,test_x,train_y,test_y=train_test_split(load_iris().data,load_iris().target,test_size=0.25,random_state=2000)

knn=KNeighborsClassifier(n_neighbors=5,algorithm='auto')#实例化knn

knn.fit(train_x,train_y)#训练

predict_y=knn.predict(test_x)#得出预测集

from sklearn.metrics import accuracy_score

accuracy_score(test_y, predict_y)

knn.score(test_x,test_y)

五.分类模型的评估

1.estimator.score()

一般最常见使用的是准确率,即预测结果正确的百分比

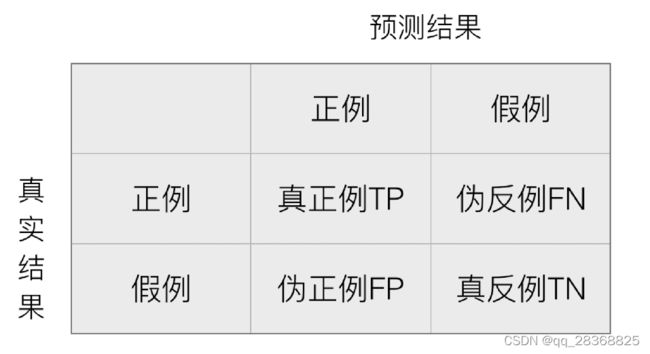

2.混淆矩阵

在分类任务下,预测结果(Predicted Condition)与正确标记(True Condition)之间存在四种不同的组合,构成混淆矩阵(适用于多分类)

3.精确率(Precision)与召回率(Recall)

精确率:预测结果为正例样本中真实为正例的比例(查得准)

召回率:真实为正例的样本中预测结果为正例的比例(查的全,对正样本的区分能力)

4.F1-score

反映了模型的稳健型

5.API

sklearn.metrics.classification_report

from sklearn.metrics import classification_report

sklearn.metrics.classification_report(y_true, y_pred, target_names=None)

y_true:真实目标值

y_pred:估计器预测目标值

target_names:目标类别名称

return:每个类别精确率与召回率

六.朴素贝叶斯

1.概率基础

概率定义为一件事情发生的可能性

联合概率:包含多个条件,且所有条件同时成立的概率

记作:P(A,B)

条件概率:就是事件A在另外一个事件B已经发生条件下的发生概率

记作:P(A|B)

特性:P(A1,A2|B) = P(A1|B)P(A2|B)

注意:此条件概率的成立,是由于A1,A2相互独立的结果

2.贝叶斯

注:w为给定文档的特征值(频数统计,预测文档提供),c为文档类别

公式可以理解为:

P(C│F1,F2,…)=P(F1,F2,… │C)P©/P(F1,F2,…)

其中c可以是不同类别

公式分为三个部分:

P©:每个文档类别的概率(某文档类别词数/总文档词数)

P(W│C):给定类别下特征(被预测文档中出现的词)的概率

计算方法:P(F1│C)=Ni/N (训练文档中去计算)

Ni为该F1词在C类别所有文档中出现的次数

N为所属类别C下的文档所有词出现的次数和

P(F1,F2,…) 预测文档中每个词的概率

3.例子

训练集统计结果(指定统计词频):

现有一篇被预测文档:出现了影院,支付宝,云计算,计算属于科技、娱乐的

类别概率?

科技:P(影院,支付宝,云计算 │科技)∗P(科技)=8/100∗20/100∗63/100∗(100/221) =0.00456109

娱乐:P(影院,支付宝,云计算│娱乐)∗P(娱乐)=56/121∗15/121∗0/121∗(121/221)=0

4.拉普拉斯平滑

问题:从上面的例子我们得到娱乐概率为0,这是不合理的,如果词频列表里面

有很多出现次数都为0,很可能计算结果都为零

解决方法:拉普拉斯平滑系数

P(F1│C)=Ni+α/N+αm

α为指定的系数一般为1,m为训练文档中统计出的特征词个数

5.sklearn朴素贝叶斯实现API

from sklearn.naive_bayes import MultinomialNB

Nb=MultinomialNB(alpha=1)

sklearn.naive_bayes.MultinomialNB(alpha = 1.0)

朴素贝叶斯分类

alpha:拉普拉斯平滑系数

6.例子

from sklearn.naive_bayes import MultinomialNB

from sklearn.datasets import fetch_20newsgroups

Nb=MultinomialNB(alpha=1)

news=fetch_20newsgroups(subset='all')

train_x,test_x,train_y,test_y=train_test_split(news.data,news.target,test_size=0.3,random_state=2022)

from sklearn.feature_extraction.text import TfidfVectorizer

tf=TfidfVectorizer()

train_x = tf.fit_transform(train_x)

test_x=tf.transform(test_x)

Nb.fit(train_x,train_y)

Nb.score(test_x,test_y)

![]()

7.朴素贝叶斯分类优缺点

1.优点:

朴素贝叶斯模型发源于古典数学理论,有稳定的分类效率。

对缺失数据不太敏感,算法也比较简单,常用于文本分类。

分类准确度高,速度快

2.缺点:

需要知道先验概率P(F1,F2,…|C),因此在某些时候会由于假设的先验

模型的原因导致预测效果不佳。

七.模型的选择与调优

1、交叉验证

交叉验证:为了让被评估的模型更加准确可信

交叉验证:将拿到的数据,分为训练和验证集。以下图为例:将数据分

成5份,其中一份作为验证集。然后经过5次(组)的测试,每次都更换不同

的验证集。即得到5组模型的结果,取平均值作为最终结果。又称5折交叉

验证。

2、网格搜索

通常情况下,有很多参数是需要手动指定的(如k-近邻算法中的K值),

这种叫超参数。但是手动过程繁杂,所以需要对模型预设几种超参数组

合。每组超参数都采用交叉验证来进行评估。最后选出最优参数组合建

立模型。

sklearn.model_selection.GridSearchCV(estimator, param_grid=None,cv=None)

对估计器的指定参数值进行详尽搜索

estimator:估计器对象

param_grid:估计器参数(dict){“n_neighbors”:[1,3,5]}

cv:指定几折交叉验证

fit:输入训练数据

score:准确率

结果分析:

best_score_:在交叉验证中测试的最好结果

best_estimator_:最好的参数模型

cv_results_:每次交叉验证后的测试集准确率结果和训练集准确率结果

3.例子

from sklearn.model_selection import GridSearchCV,train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.datasets import load_iris

train_x,test_x,train_y,test_y=train_test_split(load_iris().data,load_iris().target,test_size=0.25,random_state=2022)

Nb=KNeighborsClassifier()

param_grid={'n_neighbors':[3,4,5,6,7]}

grid_search = GridSearchCV(Nb, param_grid, cv=5,

scoring=None,n_jobs=-1)

grid_search.fit(train_x,train_y)

grid_search.best_score_

grid_search.best_params_