CVPR2021|基于双边扩充和自适应融合方法的点云语义分割网络

Semantic Segmentation for Real Point Cloud Scenes via Bilateral Augmentation and Adaptive Fusion

1、Motivation

本期带来的是一篇2021年CVPR接收的一篇关于点云语义分割的文章。本文的核心出发点是,认为目前设备获取的点云信息过剩,而现有方法却不能很好的利用这些信息。

2、目的

针对点云语义分割任务,识别真实点云场景中每个点的语义标签。

图1 点云场景的语义分割示例

3、引言

真实的点云场景通常包含非常复杂的环境,加上3D数据所具有的原始几何属性,针对点云的详细信息分析对于机器感知来说往往非常具有挑战性。随着3D获取技术的发展,获取到的点云信息愈加完善,但对这些信息的利用率远远不够,因此对点云信息的分析十分重要。尽管有许多经典的方法涉及具有简单结构的2D图像的语义分割,但是点云在3D空间中具有离散性、无序且分布不均匀的特点,这使得3D点云语义分割任务更具挑战性,特别是对于从现实世界中采集的由数百万甚至数亿个点组成的大型场景。

当然,这其中还会包括一些其他问题。例如在邻域构建过程中,邻域之间的噪点和重叠是很难避免的,往往会产生歧义;冗余特征的处理,导致网络框架的前处理和后处理非常耗时;再比如不充分的全局表达,会导致采样阶段破坏全局的信息表达等等问题。

4、本文的主要贡献

针对这些问题,作者提出了一种双边扩充结构来有效处理多分辨率点云,并利用自适应融合方法更全面有效地表示点对特征。主要贡献如下:

1)引入了一个双边区块来扩大点与邻域点的联系(local context)。

2)自适应地融合多分辨率特征,以获取更加全面的点云信息。

3)提出一种全新的语义分割网络用来处理真实点云场景。

4)通过在真实点云场景数据集上的评估,证明本文方法与SOTA方法相比具有优势

5、相关工作

在相关工作部分中,作者从三个方面对现有的文章进行缺点的描述(1.基于点的方法;2.点云特征的描述;3.语义分割的网络)。总结完总之就一句话,作者认为现有方法尚未充分利用点云的信息或者处理效率很低,获取数据详细信息的能力有限。

6、方法

首先,需要明确点数为N的点云可以从两个方面进行表述:

(1)三维坐标点P本身表示;

(2)用一种d维的特征空间F表示。

而作者的思路就是以某种方式利用P和F组合,从而完成训练学习全面的特征图以进行准确的语义分割。

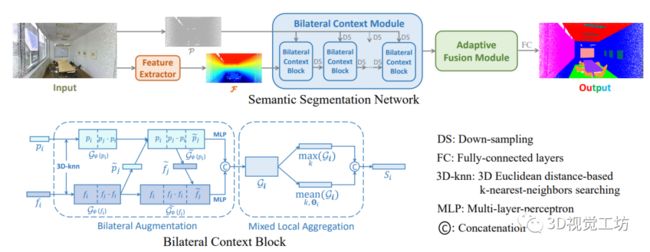

6.1、双边上下文模型

双向上下文模型由多个双向上下文块(Blocks)组成,以完成不同分辨率下的点云信息收集,如图2所示。在双向上下文模块中,作者通过包含偏移量来扩展每个点的局部上下文:实现从双边输入信息(pi和fi)中相互学习,然后合并两种特征信息用于点特征表示,从而实现增强局部上下文。为此,作者特别提出了两个新的unit和一个loss function。

图2 所提方法的网络框架

6.2、自适应融合模型

为了有效地分析由大量点组成的真实3D场景,作者通过逐步降低分辨率来分析点云信息。但是通过这种方法会使得相应的输出特征却变得抽象不好理解。为了解决这个问题,作者选择通过自适应地融合多分辨率特征图中的细节信息,从而表示原始点云的特征图并更加全面的解释每个点的编码信息。(PS:注意,这里需要说明的是,就每个点而言,基于多种分辨率的上采样特征表示可能会导致信息尺度不同)

图2自适应融合模块的体系结构

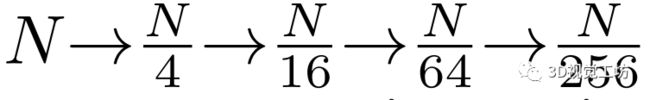

需要说明的是,这里我觉得有两点很重要,一是作者在“双边上下文模块”探索了点云数据的不同分辨率,其使用基于CUDA的最远点采样(FPS)来对数据进行采样,即逐渐处理点云的低分辨率:

二是与此同时,网络输出的尺寸增加为:

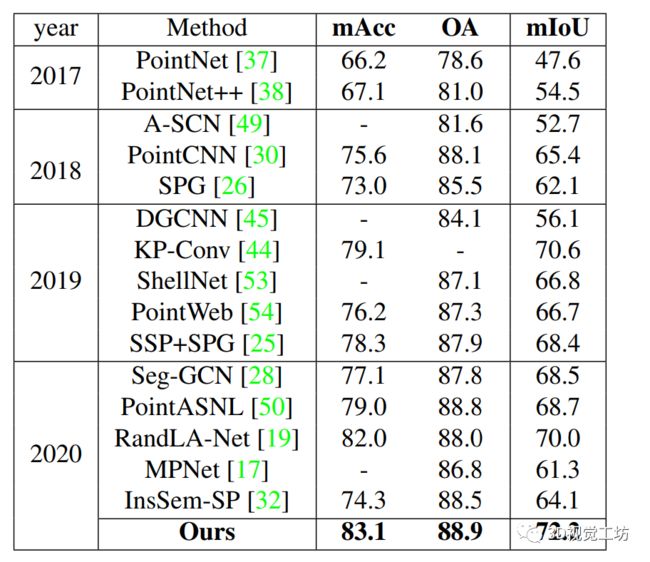

7 、实验部分

通过在三个公开数据集(S3DIS,Semantic3D,SemanticKITTI)上的实验表明所提方法效果还是可以的。表1是在S3DIS数据的 mAcc,OA和mIoU三个指标的对比结果。(更多数据对比请参见原文)

表1

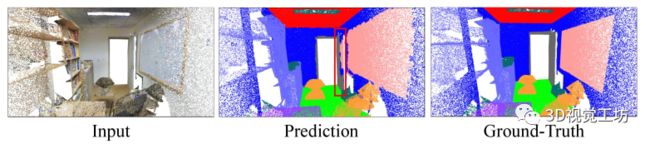

在图3中作者展示了融合多分辨率特征图的模块效果。

图3 基于S3DIS数据集中的办公室场景的自适应融合模块效果

同时,针对作者提到的之前的方法有可能在处理特征时过于复杂,有可能重复处理信息,作者也通过进一步数据分析给予了所提方法更有效的证明。

表2 SemanticKITTI数据上不同语义分割网络的复杂性分析

图4 方法预测结果的展示

7、总结

本文着重于对真实点云场景的基础分析和语义分割。具体来说,作者提出了一个结合双向扩展局部上下文和自适应融合多分辨率特征的网络。并在三个基准数据(包括S3DIS,Semantic3D和SemanticKITTI)上均取得了出色的性能。同时也提出希望优化实时应用程序的效率,利用不同框架中的关键思想,为更多3D任务(例如对象检测,实例分割等)推广网络构架。

备注:作者也是我们「3D视觉从入门到精通」特邀嘉宾:一个超干货的3D视觉学习社区

本文仅做学术分享,如有侵权,请联系删文。

下载1

在「计算机视觉工坊」公众号后台回复:深度学习,即可下载深度学习算法、3D深度学习、深度学习框架、目标检测、GAN等相关内容近30本pdf书籍。

下载2

在「计算机视觉工坊」公众号后台回复:计算机视觉,即可下载计算机视觉相关17本pdf书籍,包含计算机视觉算法、Python视觉实战、Opencv3.0学习等。

下载3

在「计算机视觉工坊」公众号后台回复:SLAM,即可下载独家SLAM相关视频课程,包含视觉SLAM、激光SLAM精品课程。

重磅!计算机视觉工坊-学习交流群已成立

扫码添加小助手微信,可申请加入3D视觉工坊-学术论文写作与投稿 微信交流群,旨在交流顶会、顶刊、SCI、EI等写作与投稿事宜。

同时也可申请加入我们的细分方向交流群,目前主要有ORB-SLAM系列源码学习、3D视觉、CV&深度学习、SLAM、三维重建、点云后处理、自动驾驶、CV入门、三维测量、VR/AR、3D人脸识别、医疗影像、缺陷检测、行人重识别、目标跟踪、视觉产品落地、视觉竞赛、车牌识别、硬件选型、深度估计、学术交流、求职交流等微信群,请扫描下面微信号加群,备注:”研究方向+学校/公司+昵称“,例如:”3D视觉 + 上海交大 + 静静“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进去相关微信群。原创投稿也请联系。

▲长按加微信群或投稿

▲长按关注公众号

3D视觉从入门到精通知识星球:针对3D视觉领域的知识点汇总、入门进阶学习路线、最新paper分享、疑问解答四个方面进行深耕,更有各类大厂的算法工程人员进行技术指导。与此同时,星球将联合知名企业发布3D视觉相关算法开发岗位以及项目对接信息,打造成集技术与就业为一体的铁杆粉丝聚集区,近3000星球成员为创造更好的AI世界共同进步,知识星球入口:

学习3D视觉核心技术,扫描查看介绍,3天内无条件退款

圈里有高质量教程资料、可答疑解惑、助你高效解决问题