- linux git clone出现fatal: unable to access Failed to connect to github.com port 443: Timed out解决方案

herosunly

C/C++/Linux解决方案linuxgitgithubtimeoutport443

大家好,我是herosunly。985院校硕士毕业,现担任算法研究员一职,热衷于机器学习算法研究与应用。曾获得阿里云天池比赛第一名,CCF比赛第二名,科大讯飞比赛第三名。拥有多项发明专利。对机器学习和深度学习拥有自己独到的见解。曾经辅导过若干个非计算机专业的学生进入到算法行业就业。希望和大家一起成长进步。 本文主要介绍了linuxgitclone出现fatal:unabletoaccessF

- flask+layui学生信息管理系统

元宇宙中的程序员

flasklayuipython

提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档文章目录前言一、pandas是什么?二、使用步骤1.引入库2.读入数据总结前言提示:这里可以添加本文要记录的大概内容:例如:随着人工智能的不断发展,机器学习这门技术也越来越重要,很多人都开启了学习机器学习,本文就介绍了机器学习的基础内容。一、数据库建模1、创建数据模型classStudentORM(db.Model):stu_id=d

- Github趋势榜的新年冠军,竟是用AI玩数独

beyondma

AI与最新技术演进AIMINSTGithub

今天笔者无意中打开Github发现了这个目前趋势榜霸榜的项目是是一个利用AI玩数独的项目AI_Sudoku(Github发址:https://github.com/neeru1207/AI_Sudoku)笔者体验了一下感觉还是比较有意思的,AI_Sudoku本质上就是使用图像识别的方式来完成MINST数字识别,然后再使用dancinglinksx算法解出数独问题,对于初学者来说既能解决AI的入门问

- 基于微信小程序的生鲜销售应用设计与实现

赵谨言

论文经验分享毕业设计

标题:基于微信小程序的生鲜销售应用设计与实现内容:1.摘要随着移动互联网的普及和人们生活水平的提高,生鲜产品的线上销售逐渐成为一种趋势。本设计旨在开发一款基于微信小程序的生鲜销售应用,为用户提供便捷、高效的购物体验。该应用采用了先进的技术和算法,实现了生鲜产品的在线展示、下单、支付、配送等功能。通过对用户需求的分析和市场调研,我们设计了简洁明了的界面和操作流程,使用户能够轻松地浏览商品、下单购买。

- LeetCode:62.不同路径

xiaoshiguang3

代码随想录-跟着Carl学算法leetcode算法java动态规划

跟着carl学算法,本系列博客仅做个人记录,建议大家都去看carl本人的博客,写的真的很好的!代码随想录LeetCode:62.不同路径一个机器人位于一个mxn网格的左上角(起始点在下图中标记为“Start”)。机器人每次只能向下或者向右移动一步。机器人试图达到网格的右下角(在下图中标记为“Finish”)。问总共有多少条不同的路径?示例1:输入:m=3,n=7输出:28示例2:输入:m=3,n=

- 超简洁 100行Javascript代码实现2048游戏,浏览器可玩

入职啦

100行实战项目javascript游戏开发语言

本文发表于入职啦(公众号:ruzhila)大家可以访问入职啦学习更多的编程实战。完全用Javascript的Canvas实现2048游戏,打开浏览器就可以玩项目地址代码已经开源,2048-js欢迎Star代码运行效果:所有的项目都在github上开源:100-line-code欢迎Star用100行代码的不同语言(Java、Python、Go、Javascript、Rust)实现项目,通过讲解项目

- Python 3.9它来啦!!!

python程序员小'鹏

python编程语言经验分享程序人生

Python3.9,来了!小编本身就是一名python开发工程师,我自己花了三天时间整理了一套python学习教程,从最基础的python脚本到web开发,爬虫,数据分析,数据可视化,机器学习,等,这些资料有想要的小伙伴"点击"即可领取过去一年,来自世界各地的开发者们一直在致力于Python3.8的改进。Python3.9beta版本已经存在了一段时间,第一个正式版本于2020年10月5日发布。每

- Spring Cloud底层原理

spring_root

springCloud原理

概述毫无疑问,SpringCloud是目前微服务架构领域的翘楚,无数的书籍博客都在讲解这个技术。不过大多数讲解还停留在对SpringCloud功能使用的层面,其底层的很多原理,很多人可能并不知晓。因此本文将通过大量的手绘图,给大家谈谈SpringCloud微服务架构的底层原理。实际上,SpringCloud是一个全家桶式的技术栈,包含了很多组件。本文先从其最核心的几个组件入手,来剖析一下其底层的工

- AI软件外包需要注意什么 外包开发AI软件的关键因素是什么 如何选择AI外包开发语言

北京动点飞扬软件

AI外包

1.定义目标与需求首先,要明确你希望AI智能体做什么。是自动化任务、数据分析、自然语言处理,还是其他功能?明确目标可以帮助你选择合适的技术和方法。2.选择开发平台与工具开发AI智能体的软件时,你需要选择适合的编程语言、框架和工具。例如:编程语言:Python是最常用的语言,因为它有强大的AI/ML库,如TensorFlow、PyTorch、scikit-learn等。开发平台:你可以使用本地环境、

- AI智能制造软件有什么用处

雪叶雨林

行业资讯AI人工智能制造

随着信息技术与制造业的深度融合,人工智能(AI)逐渐成为提升制造效率和灵活性的重要工具。AI智能制造软件通过集成数据分析、机器学习和自动化流程,为企业提供了优化生产、降低成本和提高质量的新途径。生产过程优化实时监控与反馈AI智能制造软件能够实时收集生产线上的各类数据,如温度、压力、速度等参数,并通过机器学习算法进行分析处理。一旦检测到异常情况,系统会立即发出警报并提供改进建议,帮助企业快速响应问题

- ModuleNotFoundError: No module named ‘pywin32_bootstrap‘解决方案

爱编程的喵喵

Python基础课程pythonModuleNotFoundwin32_bootstap解决方案

大家好,我是爱编程的喵喵。双985硕士毕业,现担任全栈工程师一职,热衷于将数据思维应用到工作与生活中。从事机器学习以及相关的前后端开发工作。曾在阿里云、科大讯飞、CCF等比赛获得多次Top名次。现为CSDN博客专家、人工智能领域优质创作者。喜欢通过博客创作的方式对所学的知识进行总结与归纳,不仅形成深入且独到的理解,而且能够帮助新手快速入门。 本文主要介绍了ModuleNotFoundErro

- 人脸识别的经典深度学习方法

明初啥都能学会

深度学习人工智能

人脸识别的经典深度学习方法引言1.卷积神经网络(CNN)1.1LeNet1.2AlexNet1.3VGGNet1.4ResNet2.人脸检测2.1Viola-Jones算法2.2基于深度学习的人脸检测3.人脸特征提取3.1主成分分析(PCA)3.2人脸对齐3.2.1基于特征点的对齐3.2.2基于深度学习的对齐4.人脸识别模型4.1传统机器学习方法4.2基于深度学习的方法5.公式解读5.1卷积运算5

- mbedtls | 06 - 非对称加密算法的配置与使用(RSA算法)

Mculover666

mbedtlsRSA

mbedtls系列文章mbedtls|01-移植mbedtls库到STM32的两种方法mbedtls|02-伪随机数生成器(ctr_drbg)的配置与使用mbedtls|03-单向散列算法的配置与使用(MD5、SHA1、SHA256、SHA512)mbedtls|04-对称加密算法的配置与使用(AES算法)mbedtls|05-消息认证码的配置与使用(HMAC算法、GCM算法)Demo工程源码ht

- 一文讲解Java中Object类常用的方法

Journey_CR

JavaSEjava哈希算法开发语言

在Java中,经常提到一个词“万物皆对象”,其中的“万物”指的是Java中的所有类,而这些类都是Object类的子类;Object主要提供了11个方法,大致可以分为六类:对象比较:publicnativeinthashCode():native方法,用于返回对象的哈希码;publicnativeinthashCode();publicinthashCode(){returnObjects.hash

- AI智能获客工具的意义是什么

雪叶雨林

AI行业资讯人工智能

在当今竞争激烈的市场环境中,企业需要高效、精准的获客策略来维持增长和竞争力。AI智能获客工具的出现,为企业提供了一种全新的解决方案,通过自动化和智能化手段提高获客效率和质量。一、AI智能获客工具的核心价值1.1提高获客效率AI智能获客工具通过自动化流程,如自动筛选潜在客户、自动发送营销信息等,大幅减少了人力投入和时间成本,从而提高了获客效率。1.2精准定位潜在客户利用机器学习和大数据分析技术,AI

- LeetCode:70. 爬楼梯

xiaoshiguang3

代码随想录-跟着Carl学算法leetcode算法java动态规划

跟着carl学算法,本系列博客仅做个人记录,建议大家都去看carl本人的博客,写的真的很好的!代码随想录LeetCode:70.爬楼梯假设你正在爬楼梯。需要n阶你才能到达楼顶。每次你可以爬1或2个台阶。你有多少种不同的方法可以爬到楼顶呢?示例1:输入:n=2输出:2解释:有两种方法可以爬到楼顶。1阶+1阶2阶示例2:输入:n=3输出:3解释:有三种方法可以爬到楼顶。1阶+1阶+1阶1阶+2阶2阶+

- MicroAI™将人工智能培训引入RENESAS MCU

sinat_41698914

人工智能mcubigdata

在端点部署的人工智能技术将加快资产密集型行业的上市时间达拉斯--(美国商业资讯)--边缘原生人工智能(AI)和机器学习(ML)产品领域的先驱MicroAITM今天宣布,公司已将其MicroAIAtomML™技术与RenesasRA微控制器(MCU)产品线进行整合。与全球微控制器领导者Renesas合作将机器学习引入MCU,并借助MicroAI直接在嵌入式环境中训练机器学习模型的能力——这在业界尚属

- [c语言日寄]越界访问:意外的死循环

siy2333

c语言日寄c语言开发语言学习算法笔记

【作者主页】siy2333【专栏介绍】⌈c语言日寄⌋:这是一个专注于C语言刷题的专栏,精选题目,搭配详细题解、拓展算法。从基础语法到复杂算法,题目涉及的知识点全面覆盖,助力你系统提升。无论你是初学者,还是进阶开发者,这里都能满足你的需求!【食用方法】1.根据题目自行尝试2.查看基础思路完善题解3.学习拓展算法【Gitee链接】资源保存在我的Gitee仓库:https://gitee.com/siy

- unix&linux大学教程的学习之旅

Freeflicker

linuxunix学习

1、unix&linux第一章、第二章第一章主要是作者讲解unix的发展历史第二章前部分讲解unix发展中的重要历史事件和对unix,linux做出重大推进的人物unix=unix内核+实用工具内核:操作系统核心单内核:一个独立大的程序,能够独立完成所有任务。微内核:规模较小,是一个非常小的程序,只能执行最基本的任务。为了执行其他功能,微内核要调用其他程序,这些程序称为服务器。unix、linux

- ultralytics 是什么?

博刻

AI学习笔记python

ultralytics是一个用于计算机视觉任务的Python库,专注于提供高效、易用的目标检测、实例分割和图像分类工具。它最著名的功能是实现YOLO(YouOnlyLookOnce)系列模型,特别是最新的YOLOv8。1.YOLO是什么?YOLO是一种流行的目标检测算法,以其速度快和精度高而闻名。YOLO的核心思想是将目标检测问题转化为一个回归问题,直接预测目标的边界框和类别。YOLOv8是YOL

- mysql 树形结构_MySQL 树形结构数据库设计 | 剑花烟雨江南

来B

mysql树形结构

程序设计过程中,我们常常用树形结构来表示某些数据的关联关系,如企业的部门上下级、电商平台的商品分类等等,通常而言,我们需要通过数据库来完成数据的持久化。由于关系型数据库没有一个很好的树形结构解决方案,因此设计合适的Schema以及其对应的CURD算法是关键。接下来,我们以电商商品分类结构来介绍几种解决方案。邻接表邻接表就是把所有节点都放在一张表中,然后用一个属性来记录每个节点的父节点。如下:CRE

- C++ 与机器学习:构建高效推理引擎的秘诀

salsm

C++编程魔法师c++机器学习开发语言

随着深度学习模型逐渐从研究走向生产环境,推理能力成为部署中的关键环节。模型的推理引擎需要以极低的延迟快速处理输入数据,同时最大化地利用硬件资源。虽然Python被广泛用于模型的训练和开发,但C++却在推理领域独占鳌头,其性能优势和硬件控制能力无可替代。在这篇文章中,我们将从为什么选择C++、构建高效推理引擎的细节,以及相似的开源项目三个方面深入探讨如何利用C++打造高效的机器学习推理引擎。目录为什

- 【Java程序员面试专栏 数据结构】五 高频面试算法题:二叉树

存在morning

Java程序员技术栈#二叉树java面试算法

一轮的算法训练完成后,对相关的题目有了一个初步理解了,接下来进行专题训练,以下这些题目就是二叉树相关汇总的高频题目总的来说,前序遍历是自上而下调整或比较节点,中序遍历用来对节点排序,后序遍历是自下而上的寻找或求最值供上层决策,这里的上下指的是树的层高题目关键字解题思路时间空间二叉树的前序遍历DFS-前序遍历按照根左右的顺序进行递归,补充迭代思路,依赖辅助栈O(n)O(n)二叉树的中序遍历DFS-中

- 从简单到深刻的认知发展

AI架构设计之禅

计算机软件编程原理与应用实践javapythonjavascriptkotlingolang架构人工智能

认知发展,人工智能,深度学习,神经网络,机器学习,自然语言处理,计算机视觉1.背景介绍认知发展是人类从简单到复杂的思维方式演进的过程,它涉及感知、记忆、语言、推理和决策等多个方面。随着人工智能技术的飞速发展,我们开始尝试用计算机模拟人类的认知能力,构建能够学习、理解和解决复杂问题的智能系统。从早期的符号逻辑到如今的深度学习,人工智能的发展经历了多个阶段。早期的人工智能研究主要集中在规则和逻辑推理上

- 改进候鸟优化算法之三:引入自适应策略的候鸟优化算法(AS-MBO)

搏博

算法算法人工智能机器学习启发式算法python

引入自适应策略的候鸟优化算法(MigratingBirdsOptimizationwithAdaptiveStrategy,简称AS-MBO)是对传统候鸟优化算法(MigratingBirdsOptimization,MBO)的一种改进。MBO算法本身是一种基于群体智能的元启发式优化算法,其灵感来源于候鸟迁徙时的“V”字形飞行队列,通过模拟候鸟的迁徙行为来优化问题的解。一、传统MBO算法概述(1)

- 云计算与虚拟化技术讲解视频分享

互联网之路.

知识点信息与通信

互联网各领域资料分享专区(不定期更新):Sheet前言由于内容较多,且不便于排版,为避免资源失效,请用手机点击链接进行保存,若链接生效请及时反馈,谢谢~正文链接如下(为避免资源失效,请用手机点击链接进行保存):夸克网盘分享

- 大数据和智能数据应用架构系列教程之:大数据与人工智能

AI天才研究院

AI实战大数据AI人工智能Python实战大数据人工智能语言模型JavaPython架构设计

作者:禅与计算机程序设计艺术1.背景介绍概述“大数据”是指海量、高维、多样化的数据集合。随着人类对数据处理和管理的需求越来越复杂,越来越依赖机器学习、人工智能等新兴技术。在过去的一段时间里,越来越多的人开始关注到“大数据”这一颗龙头。如今,“大数据”已经成为一个新的名词,它既包含了大量的数据,也带来了巨大的价值。因此,研究、开发、应用“大数据”技术也逐渐成为各行各业的专业人才需求。在这个快速发展的

- 【C语言算法刷题】第9题

花生_TL00007

C语言算法刷题算法c语言数据结构

题目描述给定一个非空字符串S,其被N个‘-’分隔成N+1的子串,给定正整数K,要求除第一个子串外,其余的子串每K个字符组成新的子串,并用‘-’分隔。对于新组成的每一个子串,如果它含有的小写字母比大写字母多,则将这个子串的所有大写字母转换为小写字母;反之,如果它含有的大写字母比小写字母多,则将这个子串的所有小写字母转换为大写字母;大小写字母的数量相等时,不做转换。输入输出描述输入两行:第一行为参数K

- 【C语言算法刷题】第10题

花生_TL00007

C语言算法刷题c语言算法开发语言

题目描述主管期望你来实现英文输入法单词联想功能。需求如下:依据用户输入的单词前缀,从已输入的英文语句中联想出用户想输入的单词,按字典序输出联想到的单词序列,如果联想不到,请输出用户输入的单词前缀。注意:英文单词联想时,区分大小写缩略形式如”don’t”,判定为两个单词,”don”和”t”输出的单词序列,不能有重复单词,且只能是英文单词,不能有标点符号输入描述输入为两行。首行输入一段由英文单词wor

- React Fiber 架构详解

JimmyHeat

前端框架

ReactFiber架构详解ReactFiber是React16引入的新架构,它重新实现了React的协调算法,使得React能更高效地处理更新、渲染,提升了应用的性能和响应速度。Fiber的目标是优化UI更新流程,尤其是在大型应用中保证流畅的用户体验。1.什么是ReactFiber?ReactFiber是React核心算法的重写。它是一种增量渲染的机制,允许React将更新工作分成多个小任务,并

- Algorithm

香水浓

javaAlgorithm

冒泡排序

public static void sort(Integer[] param) {

for (int i = param.length - 1; i > 0; i--) {

for (int j = 0; j < i; j++) {

int current = param[j];

int next = param[j + 1];

- mongoDB 复杂查询表达式

开窍的石头

mongodb

1:count

Pg: db.user.find().count();

统计多少条数据

2:不等于$ne

Pg: db.user.find({_id:{$ne:3}},{name:1,sex:1,_id:0});

查询id不等于3的数据。

3:大于$gt $gte(大于等于)

&n

- Jboss Java heap space异常解决方法, jboss OutOfMemoryError : PermGen space

0624chenhong

jvmjboss

转自

http://blog.csdn.net/zou274/article/details/5552630

解决办法:

window->preferences->java->installed jres->edit jre

把default vm arguments 的参数设为-Xms64m -Xmx512m

----------------

- 文件上传 下载 解析 相对路径

不懂事的小屁孩

文件上传

有点坑吧,弄这么一个简单的东西弄了一天多,身边还有大神指导着,网上各种百度着。

下面总结一下遇到的问题:

文件上传,在页面上传的时候,不要想着去操作绝对路径,浏览器会对客户端的信息进行保护,避免用户信息收到攻击。

在上传图片,或者文件时,使用form表单来操作。

前台通过form表单传输一个流到后台,而不是ajax传递参数到后台,代码如下:

<form action=&

- 怎么实现qq空间批量点赞

换个号韩国红果果

qq

纯粹为了好玩!!

逻辑很简单

1 打开浏览器console;输入以下代码。

先上添加赞的代码

var tools={};

//添加所有赞

function init(){

document.body.scrollTop=10000;

setTimeout(function(){document.body.scrollTop=0;},2000);//加

- 判断是否为中文

灵静志远

中文

方法一:

public class Zhidao {

public static void main(String args[]) {

String s = "sdf灭礌 kjl d{';\fdsjlk是";

int n=0;

for(int i=0; i<s.length(); i++) {

n = (int)s.charAt(i);

if((

- 一个电话面试后总结

a-john

面试

今天,接了一个电话面试,对于还是初学者的我来说,紧张了半天。

面试的问题分了层次,对于一类问题,由简到难。自己觉得回答不好的地方作了一下总结:

在谈到集合类的时候,举几个常用的集合类,想都没想,直接说了list,map。

然后对list和map分别举几个类型:

list方面:ArrayList,LinkedList。在谈到他们的区别时,愣住了

- MSSQL中Escape转义的使用

aijuans

MSSQL

IF OBJECT_ID('tempdb..#ABC') is not null

drop table tempdb..#ABC

create table #ABC

(

PATHNAME NVARCHAR(50)

)

insert into #ABC

SELECT N'/ABCDEFGHI'

UNION ALL SELECT N'/ABCDGAFGASASSDFA'

UNION ALL

- 一个简单的存储过程

asialee

mysql存储过程构造数据批量插入

今天要批量的生成一批测试数据,其中中间有部分数据是变化的,本来想写个程序来生成的,后来想到存储过程就可以搞定,所以随手写了一个,记录在此:

DELIMITER $$

DROP PROCEDURE IF EXISTS inse

- annot convert from HomeFragment_1 to Fragment

百合不是茶

android导包错误

创建了几个类继承Fragment, 需要将创建的类存储在ArrayList<Fragment>中; 出现不能将new 出来的对象放到队列中,原因很简单;

创建类时引入包是:import android.app.Fragment;

创建队列和对象时使用的包是:import android.support.v4.ap

- Weblogic10两种修改端口的方法

bijian1013

weblogic端口号配置管理config.xml

一.进入控制台进行修改 1.进入控制台: http://127.0.0.1:7001/console 2.展开左边树菜单 域结构->环境->服务器-->点击AdminServer(管理) &

- mysql 操作指令

征客丶

mysql

一、连接mysql

进入 mysql 的安装目录;

$ bin/mysql -p [host IP 如果是登录本地的mysql 可以不写 -p 直接 -u] -u [userName] -p

输入密码,回车,接连;

二、权限操作[如果你很了解mysql数据库后,你可以直接去修改系统表,然后用 mysql> flush privileges; 指令让权限生效]

1、赋权

mys

- 【Hive一】Hive入门

bit1129

hive

Hive安装与配置

Hive的运行需要依赖于Hadoop,因此需要首先安装Hadoop2.5.2,并且Hive的启动前需要首先启动Hadoop。

Hive安装和配置的步骤

1. 从如下地址下载Hive0.14.0

http://mirror.bit.edu.cn/apache/hive/

2.解压hive,在系统变

- ajax 三种提交请求的方法

BlueSkator

Ajaxjqery

1、ajax 提交请求

$.ajax({

type:"post",

url : "${ctx}/front/Hotel/getAllHotelByAjax.do",

dataType : "json",

success : function(result) {

try {

for(v

- mongodb开发环境下的搭建入门

braveCS

运维

linux下安装mongodb

1)官网下载mongodb-linux-x86_64-rhel62-3.0.4.gz

2)linux 解压

gzip -d mongodb-linux-x86_64-rhel62-3.0.4.gz;

mv mongodb-linux-x86_64-rhel62-3.0.4 mongodb-linux-x86_64-rhel62-

- 编程之美-最短摘要的生成

bylijinnan

java数据结构算法编程之美

import java.util.HashMap;

import java.util.Map;

import java.util.Map.Entry;

public class ShortestAbstract {

/**

* 编程之美 最短摘要的生成

* 扫描过程始终保持一个[pBegin,pEnd]的range,初始化确保[pBegin,pEnd]的ran

- json数据解析及typeof

chengxuyuancsdn

jstypeofjson解析

// json格式

var people='{"authors": [{"firstName": "AAA","lastName": "BBB"},'

+' {"firstName": "CCC&

- 流程系统设计的层次和目标

comsci

设计模式数据结构sql框架脚本

流程系统设计的层次和目标

- RMAN List和report 命令

daizj

oraclelistreportrman

LIST 命令

使用RMAN LIST 命令显示有关资料档案库中记录的备份集、代理副本和映像副本的

信息。使用此命令可列出:

• RMAN 资料档案库中状态不是AVAILABLE 的备份和副本

• 可用的且可以用于还原操作的数据文件备份和副本

• 备份集和副本,其中包含指定数据文件列表或指定表空间的备份

• 包含指定名称或范围的所有归档日志备份的备份集和副本

• 由标记、完成时间、可

- 二叉树:红黑树

dieslrae

二叉树

红黑树是一种自平衡的二叉树,它的查找,插入,删除操作时间复杂度皆为O(logN),不会出现普通二叉搜索树在最差情况时时间复杂度会变为O(N)的问题.

红黑树必须遵循红黑规则,规则如下

1、每个节点不是红就是黑。 2、根总是黑的 &

- C语言homework3,7个小题目的代码

dcj3sjt126com

c

1、打印100以内的所有奇数。

# include <stdio.h>

int main(void)

{

int i;

for (i=1; i<=100; i++)

{

if (i%2 != 0)

printf("%d ", i);

}

return 0;

}

2、从键盘上输入10个整数,

- 自定义按钮, 图片在上, 文字在下, 居中显示

dcj3sjt126com

自定义

#import <UIKit/UIKit.h>

@interface MyButton : UIButton

-(void)setFrame:(CGRect)frame ImageName:(NSString*)imageName Target:(id)target Action:(SEL)action Title:(NSString*)title Font:(CGFloa

- MySQL查询语句练习题,测试足够用了

flyvszhb

sqlmysql

http://blog.sina.com.cn/s/blog_767d65530101861c.html

1.创建student和score表

CREATE TABLE student (

id INT(10) NOT NULL UNIQUE PRIMARY KEY ,

name VARCHAR

- 转:MyBatis Generator 详解

happyqing

mybatis

MyBatis Generator 详解

http://blog.csdn.net/isea533/article/details/42102297

MyBatis Generator详解

http://git.oschina.net/free/Mybatis_Utils/blob/master/MybatisGeneator/MybatisGeneator.

- 让程序员少走弯路的14个忠告

jingjing0907

工作计划学习

无论是谁,在刚进入某个领域之时,有再大的雄心壮志也敌不过眼前的迷茫:不知道应该怎么做,不知道应该做什么。下面是一名软件开发人员所学到的经验,希望能对大家有所帮助

1.不要害怕在工作中学习。

只要有电脑,就可以通过电子阅读器阅读报纸和大多数书籍。如果你只是做好自己的本职工作以及分配的任务,那是学不到很多东西的。如果你盲目地要求更多的工作,也是不可能提升自己的。放

- nginx和NetScaler区别

流浪鱼

nginx

NetScaler是一个完整的包含操作系统和应用交付功能的产品,Nginx并不包含操作系统,在处理连接方面,需要依赖于操作系统,所以在并发连接数方面和防DoS攻击方面,Nginx不具备优势。

2.易用性方面差别也比较大。Nginx对管理员的水平要求比较高,参数比较多,不确定性给运营带来隐患。在NetScaler常见的配置如健康检查,HA等,在Nginx上的配置的实现相对复杂。

3.策略灵活度方

- 第11章 动画效果(下)

onestopweb

动画

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- FAQ - SAP BW BO roadmap

blueoxygen

BOBW

http://www.sdn.sap.com/irj/boc/business-objects-for-sap-faq

Besides, I care that how to integrate tightly.

By the way, for BW consultants, please just focus on Query Designer which i

- 关于java堆内存溢出的几种情况

tomcat_oracle

javajvmjdkthread

【情况一】:

java.lang.OutOfMemoryError: Java heap space:这种是java堆内存不够,一个原因是真不够,另一个原因是程序中有死循环; 如果是java堆内存不够的话,可以通过调整JVM下面的配置来解决: <jvm-arg>-Xms3062m</jvm-arg> <jvm-arg>-Xmx

- Manifest.permission_group权限组

阿尔萨斯

Permission

结构

继承关系

public static final class Manifest.permission_group extends Object

java.lang.Object

android. Manifest.permission_group 常量

ACCOUNTS 直接通过统计管理器访问管理的统计

COST_MONEY可以用来让用户花钱但不需要通过与他们直接牵涉的权限

D

本文收录于《深入浅出讲解自然语言处理》专栏,此专栏聚焦于自然语言处理领域的各大经典算法,将持续更新,欢迎大家订阅!

本文收录于《深入浅出讲解自然语言处理》专栏,此专栏聚焦于自然语言处理领域的各大经典算法,将持续更新,欢迎大家订阅! 个人主页:有梦想的程序星空

个人主页:有梦想的程序星空 个人介绍:小编是人工智能领域硕士,全栈工程师,深耕Flask后端开发、数据挖掘、NLP、Android开发、自动化等领域,有较丰富的软件系统、人工智能算法服务的研究和开发经验。

个人介绍:小编是人工智能领域硕士,全栈工程师,深耕Flask后端开发、数据挖掘、NLP、Android开发、自动化等领域,有较丰富的软件系统、人工智能算法服务的研究和开发经验。 如果文章对你有帮助,欢迎

如果文章对你有帮助,欢迎

![]()

![]() 和特征

和特征![]() ,根据如下步骤计算信息增益:

,根据如下步骤计算信息增益:![]() 的经验熵:

的经验熵:![]() 为第

为第![]() 类样本的数目,

类样本的数目,![]() 为数据集D的数目。

为数据集D的数目。![]() 对数据集

对数据集![]() 的经验条件熵

的经验条件熵![]() :

:![]()

![]() 来进行划分所获得的“纯度提升” 越大。因此,我们可使用信息增益来进行决策树的划分属性选择。ID3决策树学习算法就是以信息增益为准则来选择划分属性的。

来进行划分所获得的“纯度提升” 越大。因此,我们可使用信息增益来进行决策树的划分属性选择。ID3决策树学习算法就是以信息增益为准则来选择划分属性的。![]() 对于数据集

对于数据集![]() 的信息增益比定义为:

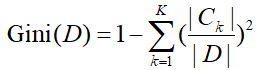

的信息增益比定义为:![]() 个类,样本点属于

个类,样本点属于![]() 的概率

的概率![]() ,则概率分布的基尼指数:

,则概率分布的基尼指数:![]()

![]() ,基尼指数:

,基尼指数:![]() 的纯度可用基尼值来度量,

的纯度可用基尼值来度量,![]() 越小,则数据集的纯度越高。CART生成的是二叉树,计算量相对来说不是很大,可以处理连续和离散变量,能够对缺失值进行处理。

越小,则数据集的纯度越高。CART生成的是二叉树,计算量相对来说不是很大,可以处理连续和离散变量,能够对缺失值进行处理。