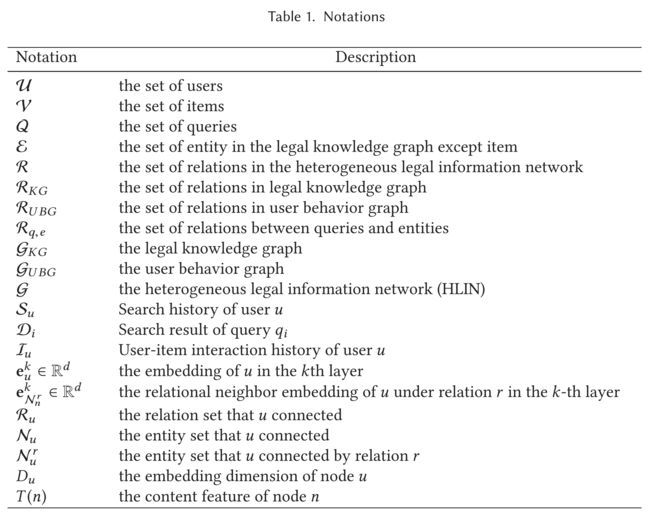

Re30:读论文 LegalGNN: Legal Information Enhanced Graph Neural Network for Recommendation

诸神缄默不语-个人CSDN博文目录

论文标题:LegalGNN: Legal Information Enhanced Graph Neural Network for Recommendation

论文ACM官方下载地址:https://dl.acm.org/doi/abs/10.1145/3469887

官方GitHub项目:yangjun12/LegalGNN: Code for Paper: LegalGNN: Legal Information Enhanced Graph Neural Network for Recommendation

本文是2022年ACM Transactions on Information Systems论文,作者来自清华和IBM。我很少读这种长篇的论文,分析很完整、到位,包括了对新方法和以前论文提出方法的详细对比和分析。

提出了第一个用于法律推荐系统的GNN模型。

实现针对用户兴趣(根据搜索历史得到)的文书推荐(Legal-Rec任务,感觉比标准的案例检索任务要更推荐一些)。

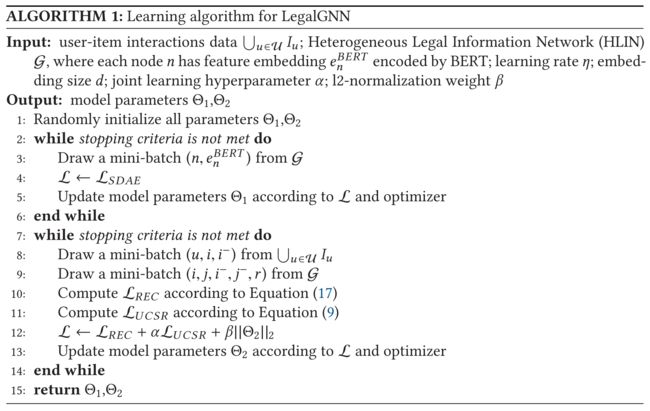

- 本文提出HLIN (Heterogeneous Legal Information Network) 来统一法律内容(案例文本和法律概念定义文本)和结构信息(法条、案由 (cause of action) 之间的关系,案例文本中含有法律概念(犯罪原因、关键要素等),法律概念之间有层级化、结构化的关系。知识图谱)。

- 为了建模用户兴趣,将用户在法律推荐系统中提出的query结合进HLIN,链接到被检索的文档和提出问题的用户上,这对冷启动用户/item也很有用。

- relational attention mechanism的GNN模型将HLIN中的高阶信息应用于推荐任务中。

文章目录

- 1. Background & Motivation

- 2. LegalGNN

-

- 2.1 HLIN

- 2.2 LegalGNN

- 3. 实验

-

- 3.1 数据集

- 3.2 baseline

- 3.3 实验设置

- 3.4 主实验结果

- 3.5 模型分析

-

- 3.5.1 Ablation Study

- 3.5.2 冷启动问题

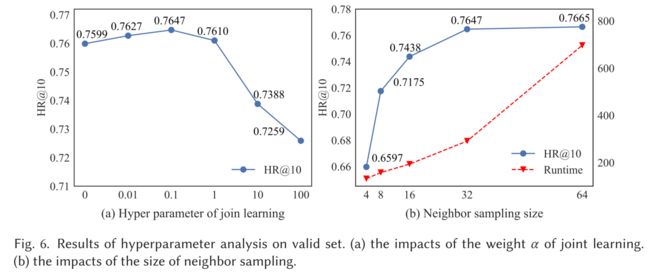

- 3.5.3 超参设置

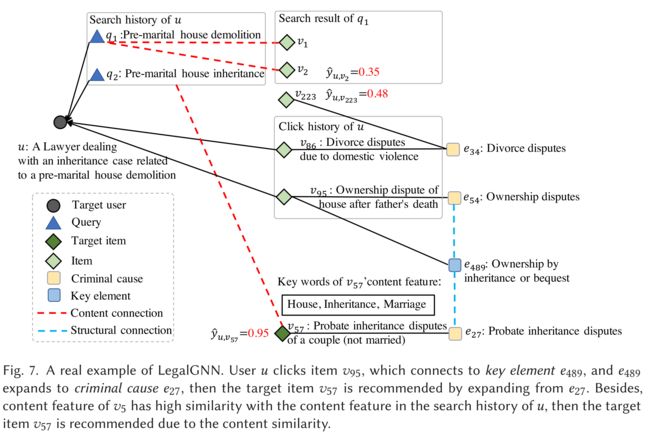

- 3.5.4 案例分析

1. Background & Motivation

Legal-Rec和传统推荐系统的区别:

- 法律信息的结构联系和文本内容都很重要,因此特征融合很重要。

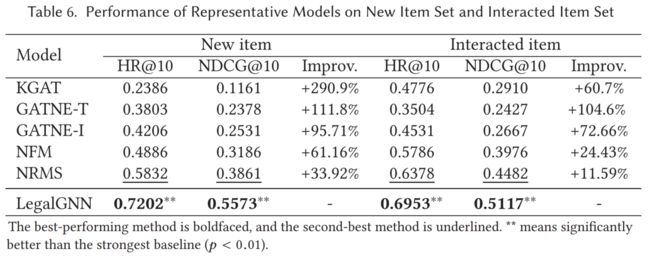

- 用户偏向于新案例(最新司法解释和司法实践),因此新item问题严重。

- 用户关注少数主题、兴趣稳定,所以准确建模用户兴趣很重要。

本文认为:

- 传统在图中传播节点特征的方法对结构联系的应用不够充分。

- 传统解决new-item的方法是基于内容,没有考虑与之前有充分交互信息的item的关系。本文用法律概念作为这个桥梁。

以前的Legal-Rec工作主要考虑多主题内容和冗余关系,因此使用基于主题模型的方法(如LDA)或基于图的方法。但这忽略了法律信息的联系。基于图的方法还丢失了法律文书的内容信息。

以前有用法律知识图谱做IR或QA的工作。

传统仅使用内容的推荐系统缺失结构信息,使用知识图谱的推荐系统(KG+user-item二部图)缺乏对知识图谱节点内容的应用(利用节点内容特征不够充分)。

2. LegalGNN

2.1 HLIN

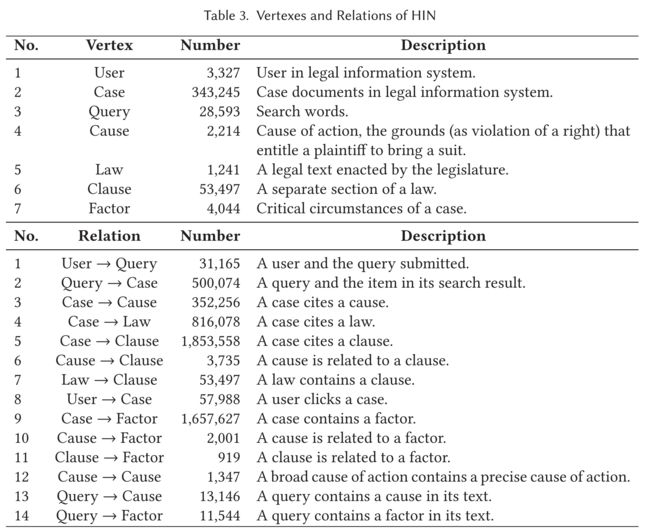

节点:users, cases, queries, legal concepts, and connections among them

法律概念包括:cause, law, clause, and factor

特征:文本

边(建模用户兴趣):user-query and item-query relationships

User-item Interaction History

Search History

legal knowledge graph

Legal Domain Knowledge(作为side information):文本法律概念和其间的结构化联系。

结构化联系包括:

- item-entity alignments(案例与法律概念相关)

- 法律概念之间的联系(层级化定义)

有向图,但是每种关系同时考虑其反向关系

user behavior graph

interaction:user & item

submit:user & query

retrieval:query & item

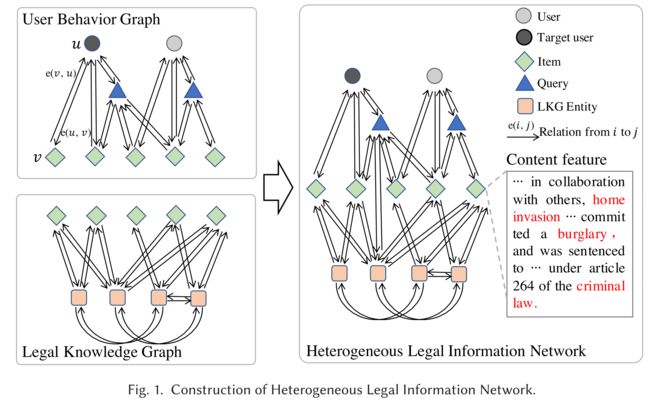

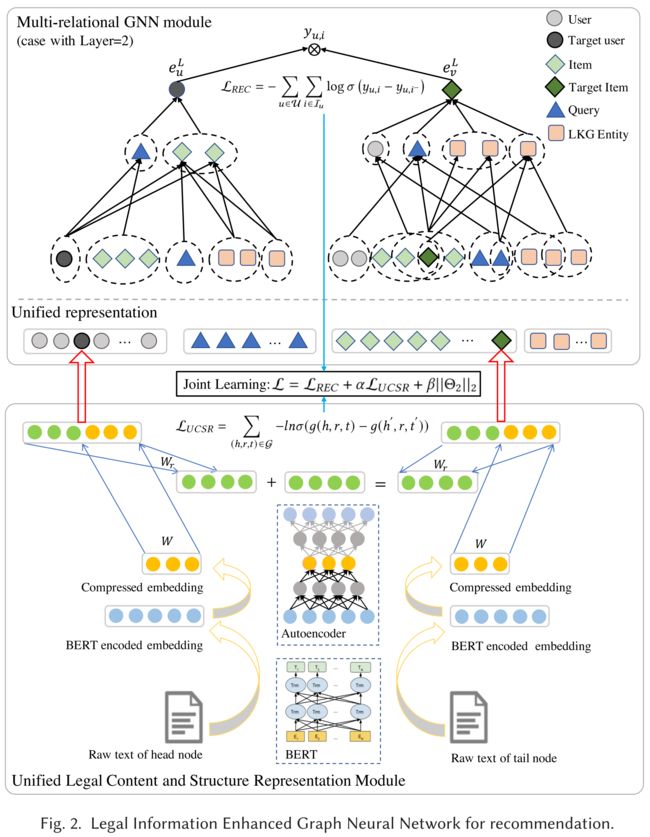

2.2 LegalGNN

BERT+SDAE+TransR+GNN

Unified Content and Structure Representation Module

图基本上就是上一节的构图内容

BERT(OpenCLaP的预训练模型,最后一层嵌入token的平均池化)

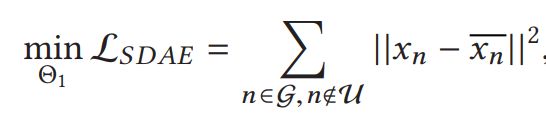

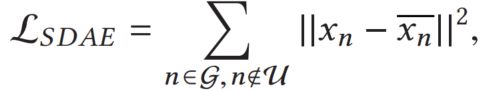

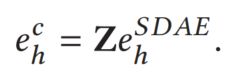

降维:autoencoder (SDAE)

Denoising Autoencoder (DAE)

两层SDAE:

以上两个模块与下游任务解耦

Unified Node Representation:TransR+与固定的文本内容向量(经线性变换后)concat

两种嵌入都随机初始化后梯度下降(我没太搞懂为什么,难道不是前面得到的吗?而且我确实觉得已经有GNN了还要显式建模一下结构,很奇怪)

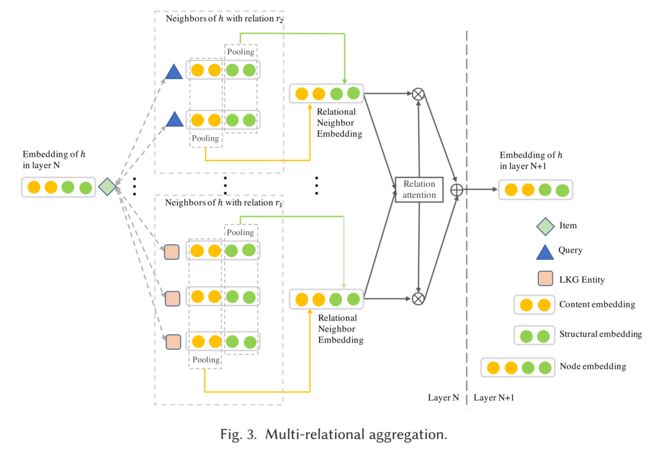

Multi-relational GNN Module

本文参考LightGCN构建了简化版的GNN模型。

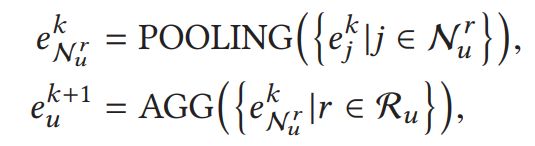

GNN:pool + aggregate(直接对每种关系的邻居做一个整体的池化,然后再用attention进行聚合。不使用transformation矩阵:避免过拟合问题)

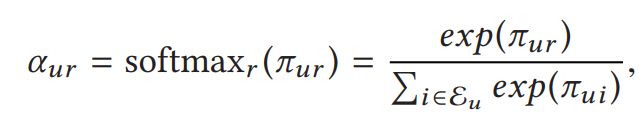

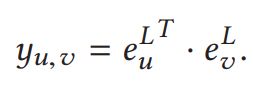

propagation:

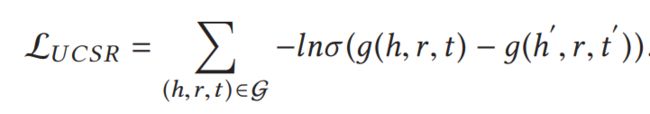

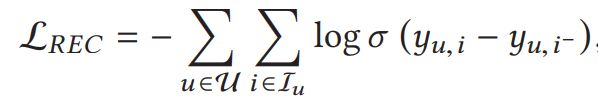

模型训练

Leakage Path Bias during Graph Modeling

break-path strategy

3. 实验

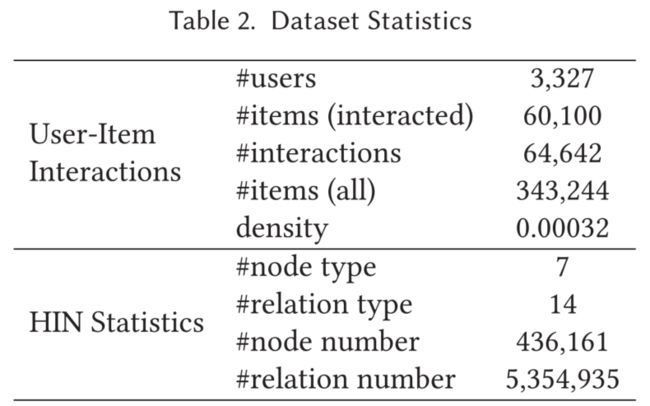

3.1 数据集

大型法律推荐数据集。由于隐私问题不能完全公开。

划分数据集:leave-one-out strategy(用每个用户最新交互作为测试集,倒数第二次交互作为验证集,其他作为训练集)

不考虑重复推荐问题

negative sampling method:评估排序任务中的推荐表现(1-99)

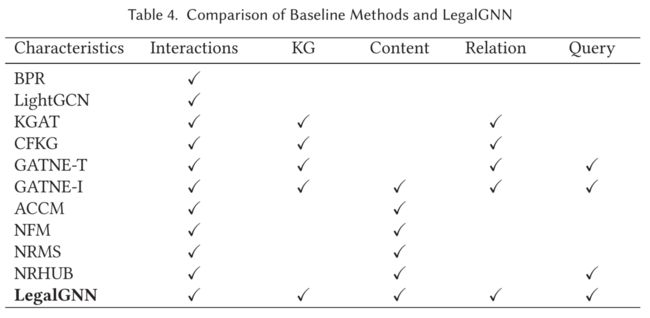

3.2 baseline

- 基于因式分解:BPR

- 基于GNN

- KGAT

- LightGCN

- 基于HIN

- CFKG

- GATNE-T

- GATNE-I

- 基于内容

- ACCM

- NFM

- NRMS

- NRHUB

3.3 实验设置

PyTorch

重复5次实验(只有随机种子改变)

其他略

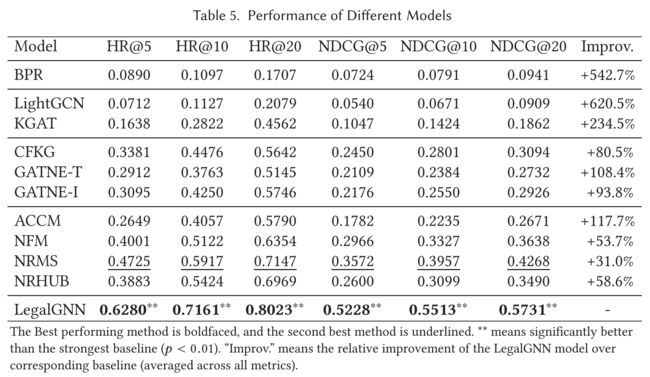

3.4 主实验结果

评估指标:

Hit Ratio (HR)

Normalized Discounted Cumulative Gain (NDCG)

3.5 模型分析

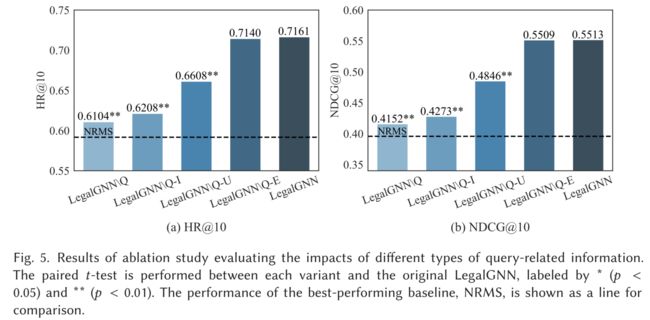

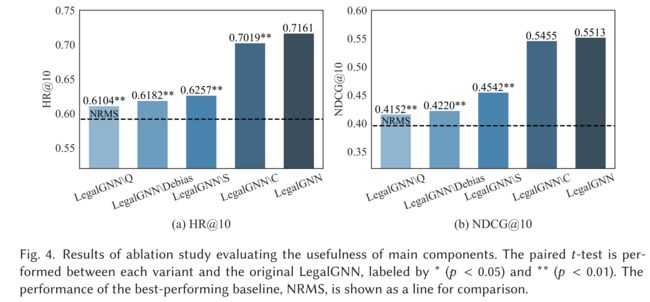

3.5.1 Ablation Study

C:文本内容特征

S:结构特征

Debias:训练过程中的debias strategy

Q:query节点及其相关边