学神经网络需要什么基础,深度神经网络怎么用

深度学习都需要学习那些内容?

数学基础如果你能够顺畅地读懂深度学习论文中的数学公式,可以独立地推导新方法,则表明你已经具备了必要的数学基础。

掌握数学分析、线性代数、概率论和凸优化四门数学课程包含的数学知识,熟知机器学习的基本理论和方法,是入门深度学习技术的前提。

因为无论是理解深度网络中各个层的运算和梯度推导,还是进行问题的形式化或是推导损失函数,都离不开扎实的数学与机器学习基础。数学分析在工科专业所开设的高等数学课程中,主要学习的内容为微积分。

对于一般的深度学习研究和应用来说,需要重点温习函数与极限、导数(特别是复合函数求导)、微分、积分、幂级数展开、微分方程等基础知识。在深度学习的优化过程中,求解函数的一阶导数是最为基础的工作。

当提到微分中值定理、Taylor公式和拉格朗日乘子的时候,你不应该只是感到与它们似曾相识。线性代数深度学习中的运算常常被表示成向量和矩阵运算。线性代数正是这样一门以向量和矩阵作为研究对象的数学分支。

需要重点温习的包括向量、线性空间、线性方程组、矩阵、矩阵运算及其性质、向量微积分。

当提到Jacobian矩阵和Hessian矩阵的时候,你需要知道确切的数学形式;当给出一个矩阵形式的损失函数时,你可以很轻松的求解梯度。

概率论概率论是研究随机现象数量规律的数学分支,随机变量在深度学习中有很多应用,无论是随机梯度下降、参数初始化方法(如Xavier),还是Dropout正则化算法,都离不开概率论的理论支撑。

除了掌握随机现象的基本概念(如随机试验、样本空间、概率、条件概率等)、随机变量及其分布之外,还需要对大数定律及中心极限定理、参数估计、假设检验等内容有所了解,进一步还可以深入学习一点随机过程、马尔可夫随机链的内容。

凸优化结合以上三门基础的数学课程,凸优化可以说是一门应用课程。

但对于深度学习而言,由于常用的深度学习优化方法往往只利用了一阶的梯度信息进行随机梯度下降,因而从业者事实上并不需要多少“高深”的凸优化知识。

理解凸集、凸函数、凸优化的基本概念,掌握对偶问题的一般概念,掌握常见的无约束优化方法如梯度下降方法、随机梯度下降方法、Newton方法,了解一点等式约束优化和不等式约束优化方法,即可满足理解深度学习中优化方法的理论要求。

机器学习归根结底,深度学习只是机器学习方法的一种,而统计机器学习则是机器学习领域事实上的方法论。

以监督学习为例,需要你掌握线性模型的回归与分类、支持向量机与核方法、随机森林方法等具有代表性的机器学习技术,并了解模型选择与模型推理、模型正则化技术、模型集成、Bootstrap方法、概率图模型等。

深入一步的话,还需要了解半监督学习、无监督学习和强化学习等专门技术。

请问想入行深度学习领域需要个人掌握哪些知识?

入行深度学习首先我们应该掌握的就是python知识!深度学习本质上是深层的Python人工神经网络,它不是一项孤立的技术,而是数学、统计机器学习、计算机科学和人工神经网络等多个领域的综合爱发猫 www.aifamao.com。

想做好深度学习开发,在编程方面除了掌握python自身语法外,还应该着重掌握下面这些库:pandas:超级excel,表格式操作数据,数据清洗和预处理的强大工具。

numpy:数值计算库,快的不要不要的。matplotlib:模仿MATLAB的数据可视化工具。scikit-learn:封装超级好的机器学习库,一些简便的算法用起来不要太顺手。

ipythonnotebook:数据科学家和算法工程师的笔记本。深度学习看似难度大,掌握了正确的学习方法,入门还是很轻松的。

为了帮助行业人才更快地掌握人工智能技术,中公优就业联合中科院自动化研究所专家,开设人工智能《深度学习》课程,通过深度剖析人工智能领域深度学习技术,培养人工智能核心人才。

深度学习具体学什么?

深度学习具体都会学神经网络、BP反向传播算法、TensorFlow深度学习工具等。

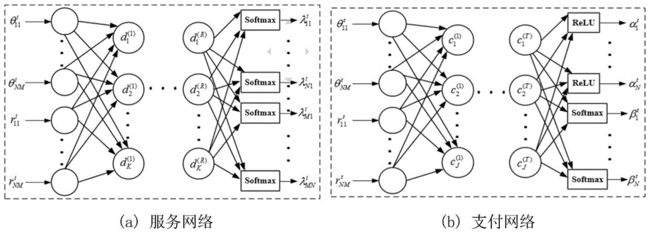

而神经网络需要学习的有:从生物神经元到人工神经元激活函数Relu、Tanh、Sigmoid透过神经网络拓扑理解逻辑回归分类透过神经网络拓扑理解Softmax回归分类透过神经网络隐藏层理解升维降维剖析隐藏层激活函数必须是非线性的原因神经网络在sklearn模块中的使用水泥强度预测案例及绘制神经网络拓扑BP反向传播算法需要学习的有:BP反向传播目的链式求导法则BP反向传播推导不同激活函数在反向传播应用不同损失函数在反向传播应用Python实现神经网络实战案例TensorFlow深度学习工具设计到:TF安装(包含CUDA和cudnn安装)TF实现多元线性回归之解析解求解TF实现多元线性回归之梯度下降求解TF预测california房价案例TF实现Softmax回归Softmax分类MNIST手写数字识别项目案例TF框架模型的保存和加载8)TF实现DNN多层神经网络9)DNN分类MNIST手写数字识别项目案例10)Tensorboard模块可视化这些就是深度学习涉及到的一些知识,一般来说深入理解神经网络算法及其优化算法,掌握TensorFlow开发流程,通过实现神经网络完成回归和分类任务。

TensorFlow框架学好了,其它深度学习框架比如Keras、PyTorch掌握起来易如反掌。另外可以进行一些实战,这样才更熟练。

深度学习如何入门,需要什么基础?

学习深度学习课程的话最基本的就是要具有一定的编程基础,并且具备一定的数学基础。比如计算机相关专业的本科生、研究生,计算机相关专业的高校讲师,从事IT行业的编程人员,人工智能领域的从业人员。

在有一定基础的前提下还是能学会的。无编程基础的人员则需要提前学习python的基础课程(某公的深度学习课程会单独赠送python基础课程的,无基础学员也能学习)。

深度学习现在有多火?需要什么基础?

深度学习需要有数学和计算机基础。

深度学习(DL,DeepLearning)是机器学习(ML,MachineLearning)领域中一个新的研究方向,它被引入机器学习使其更接近于最初的目标——人工智能(AI,ArtificialIntelligence)。

深度学习是学习样本数据的内在规律和表示层次,这些学习过程中获得的信息对诸如文字,图像和声音等数据的解释有很大的帮助。它的最终目标是让机器能够像人一样具有分析学习能力,能够识别文字、图像和声音等数据。

深度学习是一个复杂的机器学习算法,在语音和图像识别方面取得的效果,远远超过先前相关技术。

深度学习在搜索技术,数据挖掘,机器学习,机器翻译,自然语言处理,多媒体学习,语音,推荐和个性化技术,以及其他相关领域都取得了很多成果。

深度学习使机器模仿视听和思考等人类的活动,解决了很多复杂的模式识别难题,使得人工智能相关技术取得了很大进步。

深度学习学什么?

深度学习主要学的有:神经网络、BP反向传播算法、TensorFlow深度学习工具等。

深度学习英文全称为:deeplearning,是机器学习的分支,主要是把人工神经网络当作构架,进而对数据进行表征学习的算法。

至今已有数种深度学习框架,如深度神经网络、卷积神经网络和深度置信网络和递归神经网络已被应用在计算机视觉、语音识别、自然语言处理、音频识别与生物信息学等领域并获取了极好的效果。

另外,“深度学习”已成为类似术语,或者说是神经网络的品牌重塑。通过多层处理,逐渐将初始的“低层”特征表示转化为“高层”特征表示后,用“简单模型”即可完成复杂的分类等学习任务。

由此可将深度学习理解为进行“特征学习”或“表示学习”。以往在机器学习用于现实任务时,描述样本的特征通常需由人类专家来设计,这成为“特征工程”(featureengineering)。

众所周知,特征的好坏对泛化性能有至关重要的影响,人类专家设计出好特征也并非易事;特征学习(表征学习)则通过机器学习技术自身来产生好特征,这使机器学习向“全自动数据分析”又前进了一步。

而深度学习的主要应用场景为:语音识别微软研究人员通过与hinton合作,首先将RBM和DBN引入到语音识别声学模型训练中,并且在大词汇量语音识别系统中获得巨大成功,使得语音识别的错误率相对减低30%。

但是,DNN还没有有效的并行快速算法,很多研究机构都是在利用大规模数据语料通过GPU平台提高DNN声学模型的训练效率。

在国际上,IBM、google等公司都快速进行了DNN语音识别的研究,并且速度飞快。国内方面,阿里巴巴,科大讯飞、百度、中科院自动化所等公司或研究单位,也在进行深度学习在语音识别上的研究。

自然语言处理等其他领域很多机构在开展研究,2013年TomasMikolov,KaiChen,GregCorrado,JeffreyDean发表论文EfficientEstimationofWordRepresentationsinVectorSpace建立word2vector模型,与传统的词袋模型(bagofwords)相比,word2vector能够更好地表达语法信息。

深度学习在自然语言处理等领域主要应用于机器翻译以及语义挖掘等方面。

怎么快速入门深度学习?

自己挖的坑:咱们在学习的过程中一定要循序渐进,切不可急于求成。这就像练武功一样,一味的求快求狠只能走火入门。

这里我暂且认为想要入门的同学们的基础都是比较薄弱的,咱们不能跳过传统机器学习这条路直接一大步迈进深度学习这个领域中,我们起码要知道神经网络是怎么一回事。

这对于咱们理解以及掌握深度学习有着重要的帮助,比如咱们第一步要做的就是去搞明白什么是前向和反向传播以及从头到尾的自己推导一遍,有了这样一个过程咱们再去学习深度学习就会轻松多啦。

千万不可自欺欺人,一步还没走稳呢就着急跑去下一个知识点啦,在积累的过程中不要给自己挖坑,确保自己搞明白一个点啦再去深入到下一个点中。

掉进别人的坑:我们在学习的路上肯定会挖掘到很多的资源,但是这些资源不可盲目学习,我们需要有一定的鉴别能力。

就好比说我们跟着一个武功一般的学,怎么也不会学到哪里去,但是我们给一个武林至尊当小弟,我们学到的也不会少嘛。

深度学习入门必看的书和论文?有哪些必备的技能需学习

。

先了解个大概ADeepLearningTutorial:FromPerceptronstoAlgorithms神经网络肯定是要学习的,主要是BP算法,可以看看PRML3、4、5三章,可先忽略其中的贝叶斯视角的解释。

一些主要的算法理解要看具体的论文了,有个Matlab的程序不错,有基本算法的实现,见rasmusbergpalm/DeepLearnToolbox·GitHub。

有一本系统的介绍深度学习的书,不过还没写完,样稿见DEEPLEARNING。

还有评论中提到的UFLDL教程:UnsupervisedFeatureLearningandDeepLearningTutorial。