6--多尺度目标检测

6.1多尺度锚框

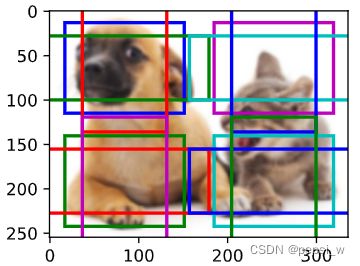

如果以每个像素为中心生成锚框,则会导致锚框数量极其大。如果想要减少锚框,可以考虑使用不同尺度的锚框来检测不同大小的物体。即当使用较小的锚框检测较小的物体时,可以采样更多的区域,而对于较大的物体,可以采样较少的区域。

通过定义卷积层输出的二维特征图的形状,可以确定任何图像上均匀采样锚框的中心。由于锚框(anchors)的中心分布于特征图(fmap)上的所有单位,因此这些中心必须根据其相对空间位置在任何输入图像上均匀分布。以这些均匀采样的像素为中心,将会生成大小为s(假设列表s的长度为1)且宽高比(ratios)不同的锚框。

!pip install git+https://github.com/d2l-ai/d2l-zh@release # installing d2l

!pip install matplotlib_inline

!pip install matplotlib==3.0.0

%matplotlib inline

import torch

from d2l import torch as d2l

img = d2l.plt.imread('/content/drive/MyDrive/data/dogcat.png')

h,w = img.shape[:2]

h,w

#d2l.plt.imshow(img)

def display_anchors(fmap_w,fmap_h,s):

d2l.set_figsize()

fmap = torch.zeros((1,10,fmap_h,fmap_w))

anchors = d2l.multibox_prior(fmap,sizes=s,ratios=[1,2,0.5])

bbox_scale = torch.tensor((w,h,w,h))

d2l.show_bboxes(d2l.plt.imshow(img).axes,anchors[0]*bbox_scale)

display_anchors(fmap_w=4,fmap_h=4,s=[0.15])

display_anchors(fmap_w=2,fmap_h=2,s=[0.4])

display_anchors(fmap_w=1,fmap_h=1,s=[0.8])

运行结果:

6.2 多尺度检测(基于CNN)

假设有c张形状为h×w的特征图,在生成多尺度的锚框后,每个锚框都根据真实值边界框来标记了类和偏移量。 在当前尺度下,目标检测模型需要预测输入图像上hw组锚框类别和偏移量,其中不同组锚框具有不同的中心。

假设此处的c张特征图是CNN基于输入图像的正向传播算法获得的中间输出。 既然每张特征图上都有hw个不同的空间位置,那么相同空间位置可以看作含有c个单元。 因此,可以将特征图在同一空间位置的c个单元变换为使用此空间位置生成的a个锚框类别和偏移量。 即用输入图像在某个感受野区域内的信息,来预测输入图像上与该区域位置相近的锚框类别和偏移量。

当不同层的特征图在输入图像上分别拥有不同大小的感受野时,它们可以用于检测不同大小的目标。即可以利用深层神经网络在多个层次上对图像进行分层表示,从而实现多尺度目标检测。

6.3 目标检测数据集

该数据集由一些背景图片的随机位置上放一张香蕉的图像组成,并在图片上为香蕉标记了边界框。部分图片如下所示:

import pandas as pd

import torchvision

import os

d2l.DATA_HUB['banana-detection'] = (

d2l.DATA_URL + 'banana-detection.zip',

'5de26c8fce5ccdea9f91267273464dc968d20d72')

#通过read_data_bananas函数,我们读取香蕉检测数据集。该数据集包括一个的CSV文件,

#内含目标类别标签和位于左上角和右下角的真实边界框坐标。

def read_data_bananas(is_train=True):

"""读取香蕉检测数据集中的图像和标签"""

data_dir = d2l.download_extract('banana-detection')

csv_fname = os.path.join(data_dir, 'bananas_train' if is_train

else 'bananas_val', 'label.csv')

csv_data = pd.read_csv(csv_fname)

csv_data = csv_data.set_index('img_name')

images, targets = [], []

for img_name, target in csv_data.iterrows():

images.append(torchvision.io.read_image(

os.path.join(data_dir, 'bananas_train' if is_train else

'bananas_val', 'images', f'{img_name}')))

# 这里的target包含(类别,左上角x,左上角y,右下角x,右下角y),

# 其中所有图像都具有相同的香蕉类(索引为0)

targets.append(list(target))

return images, torch.tensor(targets).unsqueeze(1) / 256

class BananasDataset(torch.utils.data.Dataset):

"""一个用于加载香蕉检测数据集的自定义数据集"""

def __init__(self, is_train):

self.features, self.labels = read_data_bananas(is_train)

print('read ' + str(len(self.features)) + (f' training examples' if

is_train else f' validation examples'))

def __getitem__(self, idx):

return (self.features[idx].float(), self.labels[idx])

def __len__(self):

return len(self.features)

def load_data_bananas(batch_size):

"""加载香蕉检测数据集"""

train_iter = torch.utils.data.DataLoader(BananasDataset(is_train=True),

batch_size, shuffle=True)

val_iter = torch.utils.data.DataLoader(BananasDataset(is_train=False),

batch_size)

return train_iter, val_iter

#小批量的形状为(批量大小,m,5),其中m是数据集的任何图像中边界框可能出现的最大数量

#5指的是每个物体的标签和对应的矩形框的四个坐标

#对于香蕉数据集而言,由于每张图像上只有一个边界框,因此m=1

batch_size = 32

train_iter, _ = load_data_bananas(batch_size)

batch = next(iter(train_iter))

batch[0].shape, batch[1].shape#batch[1]应该就是标签的批量

imgs = (batch[0][0:10].permute(0,2,3,1))/255

edge_size = 256

axes = d2l.show_images(imgs,2,5,scale=2)

for ax,label in zip(axes,batch[1][0:10]):

d2l.show_bboxes(ax,[label[0][1:5] * edge_size],colors='w')#label[0][1:5]估计是框的坐标