VS2017+OpenCV4.5.5 SVM-鸢尾花分类

支持向量机(SVM)

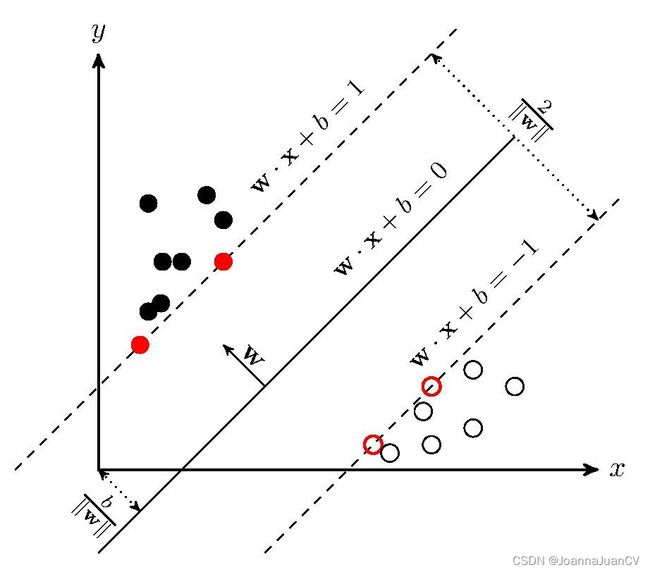

支持向量机(support vector machines, SVM)是一种二分类模型,它的基本模型是定义在特征空间上的间隔最大的线性分类器,间隔最大使它有别于感知机;SVM还包括核技巧,这使它成为实质上的非线性分类器。SVM的的学习策略就是间隔最大化,可形式化为一个求解凸二次规划的问题,也等价于正则化的合页损失函数的最小化问题。SVM的的学习算法就是求解凸二次规划的最优化算法。

SVM算法原理

SVM学习的基本原理是求解能够正确划分训练数据集并且几何间隔最大的分离超平面。

如图,样本数据集是二维的,分散在平面上,需要找到一条直线将数据集分割开。可以分开的直线有很多,我们要找到其中泛化能力最好,鲁棒性最强的直线。如果是在三维空间中,则需要找到一个平面;如果是超过三维以上的维数,则需要找到一个超平面。

测试用例

鸢尾花数据集下载:http://download.tensorflow.org/data/iris_training.csv

#include测试结果:2