PyTorch快速入门教程【小土堆】-神经网络-搭建小实战和Sequential的使用

1.torch.nn.Sequential(*args)

作用:一个序列容器, 模块将按照在构造函数中传递的顺序被添加到它中,最后返回最后一个模块的输出。

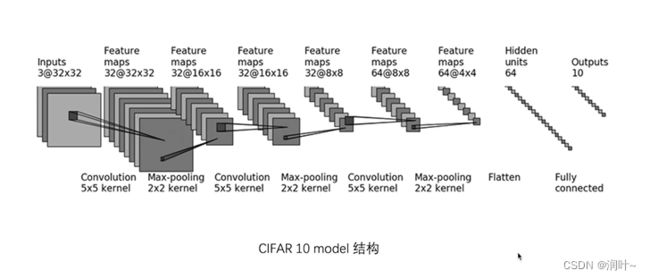

2.CIFAR10 图像分类

(1)输入:通道数 3,尺寸是32*32 经过卷积核为5*5的卷积Convolution后输出:通道数为32,尺寸为32*32

思路1:

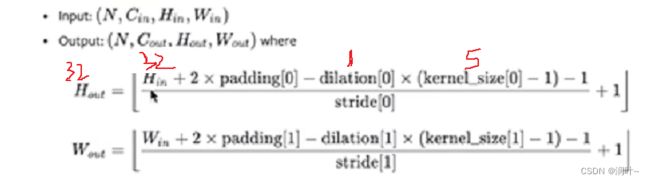

根据公式 计算卷积的padding,得出stride=1,padding=2

思路2:

kernel=5,要保证输出尺寸不变,kernel的中心块要置于输入的四个角上才能尺寸不变,中心块的上下左右都有2块所以padding=2

(2)再经过池化核为2*2的最大池化,输出 通道数为32,尺寸为16*16

(3)再经过卷积核为5*5的卷积Convolution后输出:通道数为32,尺寸为16*16

(4)再经过池化核为2*2的最大池化,输出 通道数为32,尺寸为8*8

(5)再经过卷积核为5*5的卷积Convolution后输出:通道数为64,尺寸为8*8

(6)再经过池化核为2*2的最大池化,输出 通道数为64,尺寸为4*4

(7)再经过flatten将输入展成1行,尺寸为1*1024(64*4*4)

(8)再经过一个线性层 in_features=1024,out_features=64

(9)再经过一个线性层 in_features=64,out_features=10

3.代码演示

import torchvision.datasets

import torch

from torch import nn

from torch.nn import Conv2d, MaxPool2d, Flatten, Linear

from torch.utils.tensorboard import SummaryWriter

dataset=torchvision.datasets.CIFAR10("dataset")

class Tudui(nn.Module):

def __init__(self) -> None:

super().__init__()

# self.conv1=Conv2d(3,32,5,padding=2)

# #kernel=5,要保证输出尺寸不变,kernel的中心块要置于输入的四个角上才能尺寸不变,中心块的上下左右都有2块所以,padding=2

# self.maxpool1=MaxPool2d(2)

# self.conv2=Conv2d(32,32,5,padding=2)

# self.maxpool2=MaxPool2d(2)

# self.conv3=Conv2d(32,64,5,padding=2)

# self.maxpool3=MaxPool2d(2)

# self.flatten=Flatten()

# self.linear1=Linear(1024,64)

# self.linear2=Linear(64,10)

self.modul1=nn.Sequential(

Conv2d(3, 32, 5, padding=2),

MaxPool2d(2),

Conv2d(32, 32, 5, padding=2),

MaxPool2d(2),

Conv2d(32, 64, 5, padding=2),

MaxPool2d(2),

Flatten(),

Linear(1024, 64),

Linear(64, 10)

)

def forward(self,x):

# x=self.conv1(x)

# x=self.maxpool1(x)

# x=self.conv2(x)

# x=self.maxpool2(x)

# x=self.conv3(x)

# x=self.maxpool3(x)

# x=self.flatten(x)

# x=self.linear1(x)

# x=self.linear2(x)

x=self.modul1(x)

return x

tudui=Tudui()

print(tudui)

#检查网络正确性

#生成全1的相应规格的数据

input=torch.ones((64,3,32,32))#batchsize=64,channel=3,尺寸32*32

output=tudui(input)

print(output.shape)

writer=SummaryWriter("logs_seq")

writer.add_graph(tudui,input)

writer.close()