初识深度学习(Deep Learning)——深度学习框架、步骤和内容简介

在根据台大李宏毅教授《1天搞懂深度学习》和其他相关学习资料后进行了整理,以下为学习成果,不当之处敬请指出。

PPT资源也在以下方式下载和分享,需要的伙伴自取:

链接: https://pan.baidu.com/s/1zalyIhTaVYHJp1U3a8KEVg 提取码: ptsd

一、概念含义

人工智能(Artificial Intelligence)>机器学习(Machine Learning)>深度学习(Deep Learning),三者之间的关系为:机器学习是实现人工智能的方法,深度学习是实现机器学习算法的技术。

人工智能是研究、开发用于模拟、延伸和扩展人的的理论、方法、技术及应用系统的一门新的技术科学。

机器学习本质上就是让计算机自己在数据中学习规律,并根据所得到的规律对未来数据进行预测,包括如聚类、分类、决策树、贝叶斯、神经网络、深度学习等算法。

深度学习被引入机器学习使其更接近于最初的目标:人工智能。

二、深度学习概述

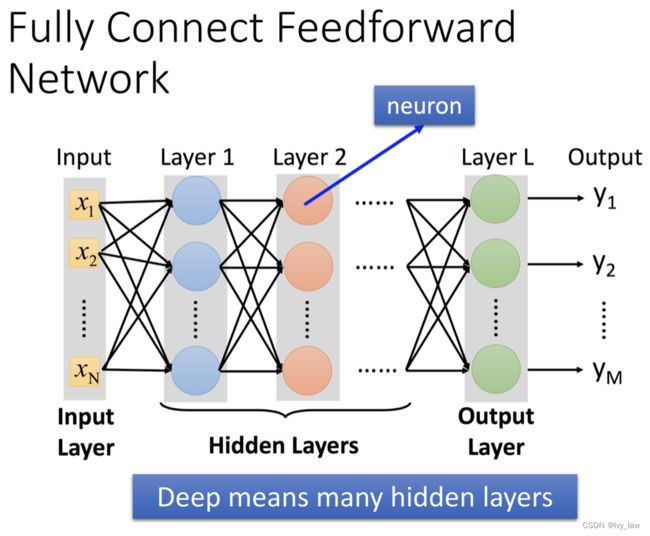

1.定义:深度学习是构建含有多隐层的机器学习架构模型,通过大规模数据进行训练,得到大量更具代表性的特征信息,从而对样本进行分类和预测,提高分类和预测的精度。和传统浅层学习模型(如支持向量机(support vector machine,SVM)、人工神经网络(artificial neural networks,ANN))的区别在于:

(1)深度学习模型结构含有更多的层次,包含隐层节点的层数通常在5层以上。

(2)明确强调了特征学习对于深度模型的重要性,即通过逐层特征提取,将数据样本在原空间的特征变换到一个新的特征空间来表示初始数据,这使得分类或预测问题更加容易实现。

2.深度学习步骤:

定义方法-评估方法的优劣-获得最佳的学习方法

(1)定义方法:神经网络:通过一层层Layer的计算归纳,逐步的将抽象的原始数据变的具体。

(2)评估方法的优劣:损失函数(Loss function)是用于评估方法优劣,通常我们用学习出来的参数对测试数据进行计算,得出对应的预测(y)然后和真实的测试数据的目标值(t)进行比对,y和t之间的差距往往就是Loss。评估一个算法的好坏,就是要尽可能的降低Loss。

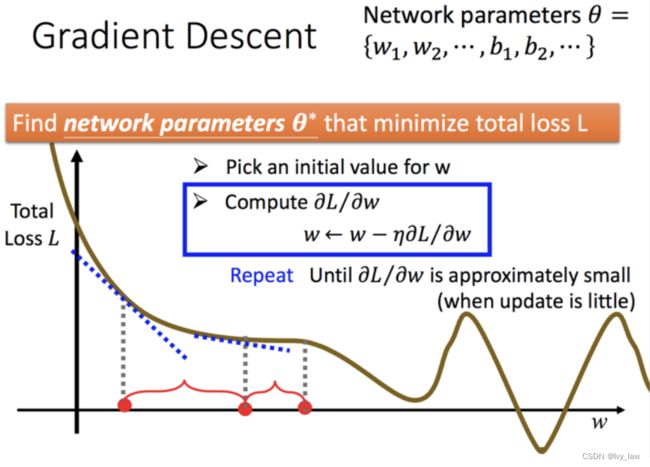

(3)获得最佳的学习方法:梯度下降算法。梯度下降算法存在局部最优解的问题。神经网络计算梯度的算法是反向传播算法,简称BP。

三、训练方法

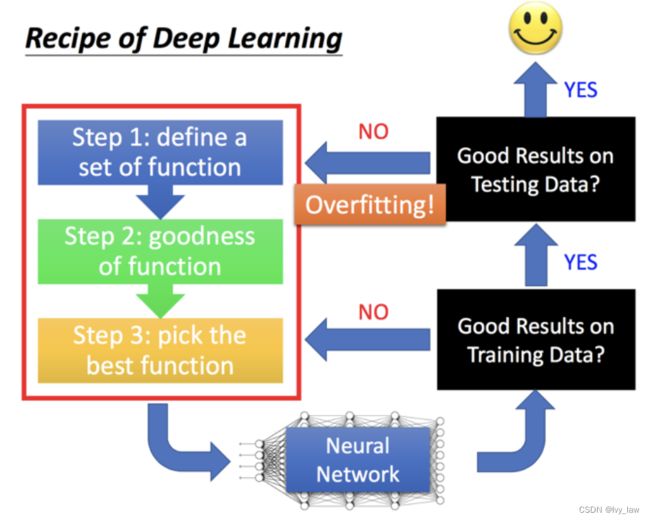

1.选择训练方法

训练中的两种情况:

(1)没有得到很好的训练结果:重新选择训练结果。

(2)没有得到很好的测试结果:过度拟合,重新选择训练结果。

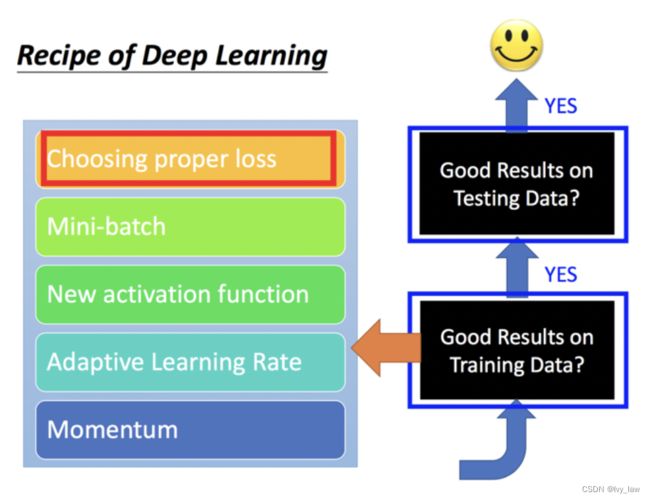

2.优化训练方法的手段

(1)选择合适的Loss function:使用Cross Entropy效果要优于Mean Square Error

(2)Mini-batch: 每次训练使用少量数据而不是全量数据效率更高

(3)Activation Function:使用ReLU替代Sigmoid可以解决梯度消失的问题,可以训练更深的神经网络

(4) Adaptive Learning Rate:可以随着迭代不断自我调整,提高学习效率

(5)Momentum: 可以一定程度上避免陷入局部最低点的问题

3.避免过度拟合(Overfitting)的方法

(1)Early Stopping:使用cross validation的方式,不断对validation data进行检验,一旦发现预测精度下降则停止。

(2)Weight Decay:参数正则化的一种方式。

(3)Dropout:通过随机去掉一些节点的连接达到改变网络形式,所以会产生出多种网络形态,然后汇集得到一个最佳结果。

(4)Network Structure: 例如CNN等其他形态的网络。

更多学习资源可以访问:https://b23.tv/nchH1D5 李宏毅教授讲解视频