- 【深度学习】神经网络剪枝方法的分类

烟锁池塘柳0

机器学习与深度学习深度学习神经网络剪枝

神经网络剪枝方法的分类摘要随着深度学习模型,特别是大语言模型(LLM)的参数量爆炸式增长,模型的部署和推理成本变得异常高昂。如何在保持模型性能的同时,降低其计算和存储需求,成为了工业界和学术界的核心议题。神经网络剪枝(Pruning)作为模型压缩的关键技术之一,应运而生。本文将解析剪枝技术的不同分类,深入探讨其原理、优缺点。文章目录神经网络剪枝方法的分类摘要1为什么我们需要剪枝?2分类方法一:剪什

- Python 图像分类入门

超龄超能程序猿

机器学习python分类开发语言

一、介绍图像分类作为深度学习的基础任务,旨在将输入图像划分到预定义的类别集合中。在实际的业务中,图像分类技术是比较常用的一种技术技能。例如,在安防监控中,可通过图像分类识别异常行为;在智能交通系统中,实现对交通标志和车辆类型的快速识别等。本文将通过安装包已有数据带你逐步了解使用Python进行图像分类的全过程。二、环境搭建在开始图像分类项目前,需要确保Python环境中安装了必要的库。主要包括:T

- 初始CNN(卷积神经网络)

超龄超能程序猿

机器学习cnn人工智能神经网络

卷积神经网络(ConvolutionalNeuralNetwork,简称CNN)作为深度学习的重要分支,在图像识别、目标检测、语义分割等领域大放异彩。无论是手机上的人脸识别解锁,还是自动驾驶汽车对道路和行人的识别,背后都离不开CNN的强大能力一、CNN诞生的背景与意义在CNN出现之前,传统的图像识别方法主要依赖人工提取特征,例如使用SIFT(尺度不变特征变换)、HOG(方向梯度直方图)等算法。这些

- 深度学习实验:GPU加速,突破性能瓶颈

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

深度学习实验:GPU加速,突破性能瓶颈1.背景介绍随着深度学习模型变得越来越复杂和庞大,传统的CPU已经无法满足训练和推理的计算需求。GPU凭借其强大的并行计算能力和专门为矩阵运算优化的架构,成为了深度学习领域的核心加速器。本文将探讨如何利用GPU加速深度学习实验,突破性能瓶颈,提高模型训练和推理的效率。2.核心概念与联系2.1GPU架构GPU(图形处理器)最初是为了加速图形渲染而设计的,但由于其

- 深度学习相关指标工作笔记

Victor Zhong

AI框架深度学习笔记人工智能

这里写目录标题检测指标iou/Gou/Diou/CiouMSE(MeanSquaredError)(均方误差)(回归问题)交叉熵损失函数(CrossEntropyErrorFunction)(分类问题)检测指标iou/Gou/Diou/CiouIntersectionoverUnion(IoU)是目标检测里一种重要的评价值交并比令人遗憾的是IoU无法优化无重叠的bboxes如果用IoU作为loss

- 典型的几种神经网络

Victor Zhong

AI框架神经网络人工智能深度学习

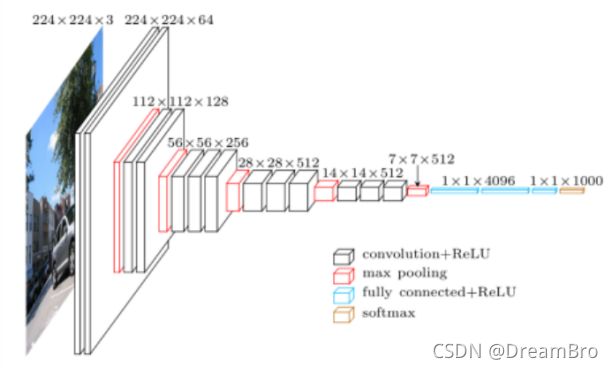

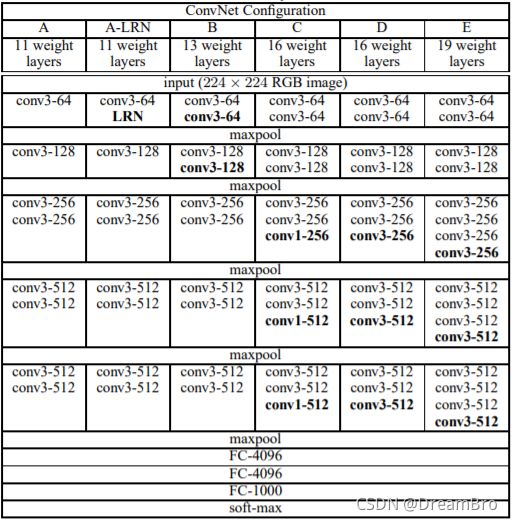

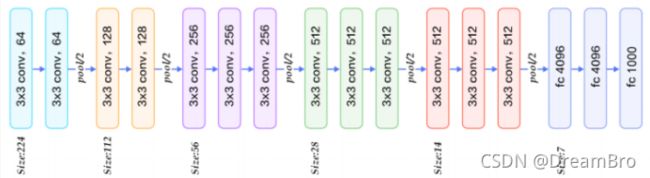

骨干网络CNN(卷积神经网络)RNN(循环神经网络)三级目录CNN(卷积神经网络)包括输入层、隐藏层、输出层:输入层一般为一张图片(w,h,d),输入层数据一般要做归一化处理;隐藏层包含特有的卷积层(卷积核有权重系数)、池化层(没有权重系数)、全连接层,还有残差块?和Inception模块?。;输出层:RNN(循环神经网络)单向的RNN示意图:三级目录

- 【深度学习新浪潮】基于扩散模型的图像编辑加速方法

小米玄戒Andrew

深度学习新浪潮深度学习人工智能扩散模型TransformerDiT图像编辑模型加速

在基于扩散模型的图像编辑任务中,实现高质量与高效加速的平衡需要综合运用模型架构优化、采样策略创新、条件控制增强及硬件加速等多维度技术。一、一步反演与掩码引导的编辑框架通过一步反演框架将输入图像映射到可编辑的潜在空间,结合掩码引导的注意力重缩放机制,实现文本引导的局部编辑。例如,SwiftEdit通过一步反演和注意力重缩放,将编辑时间压缩至0.23秒,比传统多步方法快50倍。具体步骤包括:一步反演:

- 生物启发AI新突破:神经形态芯片+脉冲神经网络落地指南

HeartException

人工智能

前言前些天发现了一个巨牛的人工智能免费学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站《生物启发AI新突破:神经形态芯片+脉冲神经网络落地指南》副标题:基于2025年英特尔Loihi3芯片的工业级部署实战(附能耗对比&代码库)封面建议:脉冲神经网络动态脉冲传导图覆盖在神经形态芯片显微结构上,标注「能效比:传统GPU的1/800」一、2025生物启发AI的临界点突破生物神经特性事件

- 《从Backprop到Diffusion:深度学习的算法进化树全景图》

HeartException

学习人工智能

前言前些天发现了一个巨牛的人工智能免费学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站《从Backprop到Diffusion:深度学习的算法进化树全景图》**展开系统性解析。全文基于算法原理-技术突破-产业重塑的三层逻辑链,融合2025年最新研究成果与产业数据,呈现深度学习四十年的底层技术迁徙路径从Backprop到Diffusion:深度学习的算法进化树全景图副标题:一部算法

- 多模态大模型:技术原理与实战 看清GPT的进化史和创新点

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

多模态大模型:技术原理与实战看清GPT的进化史和创新点1.背景介绍1.1人工智能的发展历程1.1.1早期人工智能1.1.2机器学习时代1.1.3深度学习的崛起1.2自然语言处理的演进1.2.1基于规则的方法1.2.2统计机器学习方法1.2.3深度学习方法1.3大语言模型的出现1.3.1Transformer架构的提出1.3.2GPT系列模型的发展1.3.3多模态大模型的兴起2.核心概念与联系2.1

- 聚焦的伟力:注意力机制与Transformer的创世纪

田园Coder

人工智能科普人工智能科普

当LSTM和GRU凭借其精密的门控系统,成功驯服了时间的长河,让神经网络能够跨越数十甚至数百步记住关键信息,并在机器翻译、文本生成等领域大放异彩时,一个看似微小却影响深远的瓶颈逐渐浮出水面,尤其是在序列到序列(Seq2Seq)框架中。在标准的Seq2Seq模型(如用于神经机器翻译)里,编码器(通常是一个RNN如LSTM)需要将整个输入序列(如一个英语句子)的信息压缩成一个固定长度的上下文向量(Co

- 《卷积神经网络到Vision Transformer:计算机视觉的十年架构革命》

HeartException

人工智能学习

前言前些天发现了一个巨牛的人工智能免费学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站题目《卷积神经网络到VisionTransformer:计算机视觉的十年架构革命》展开深度解析,全文采用技术演进史+架构对比+产业影响的三段式结构,附关键数据与趋势预测:卷积神经网络到VisionTransformer:计算机视觉的十年架构革命副标题:从局部感知到全局建模,一场改变AI视觉基石的

- 目标检测:从基础原理到前沿技术全面解析

随机森林404

计算机视觉目标检测人工智能计算机视觉

引言在计算机视觉领域,目标检测是一项核心且极具挑战性的任务,它不仅要识别图像中有什么物体,还要确定这些物体在图像中的具体位置。随着人工智能技术的快速发展,目标检测已成为智能监控、自动驾驶、医疗影像分析等众多应用的基础技术。本文将全面介绍目标检测的基础概念、发展历程、关键技术、实践应用以及未来趋势,为读者提供系统性的知识框架。第一章目标检测概述1.1目标检测的定义与重要性目标检测(ObjectDet

- 【网络通信安全】深入解析 OSPF 协议:从概念到 eNSP 实战配置(附完整代码与排错指南)

不羁。。

网络通信安全智能路由器网络

目录一、OSPF协议核心概念:为什么它是企业网络的“神经网络”?1.协议本质与设计目标2.核心组件与工作原理(1)链路状态数据库(LSDB)(2)区域划分原则(3)路由器角色二、实验环境搭建:3台路由器构建跨区域OSPF网络1.网络拓扑图2.设备与IP规划表三、逐设备配置详解:从接口到OSPF进程的全流程操作1.基础配置:接口IP与设备命名(以R1为例)2.OSPF进程配置:区域划分与网络宣告(1

- 结合创新idea:机器学习+运筹优化=CCF高端局

Ai多利

机器学习人工智能

2024深度学习发论文&模型涨点之——机器学习+运筹优化机器学习是人工智能的一个分支,它使计算机系统能够从数据中学习并改进其性能,而无需进行明确的编程。运筹优化,也称为运筹学或运营管理,是应用数学的一个分支,它使用数学模型和算法来支持复杂决策过程的制定。机器学习与运筹优化的结合是一个前沿且活跃的研究领域,它们相互补充,为解决复杂问题提供了新的思路和方法。小编整理了一些机器学习+运筹优化【论文+代码

- JuPyter(IPython) Notebooks中使用pip安装Python的模块

weixin_34218890

开发工具python人工智能

问题描述:没有带GPU的电脑,搞深度学习不是耍流氓嘛,我网上看到有个云平台,免费使用了一下,小姐姐很热情。使用过程如下:他们给的接口是Jupyter编辑平台,我就在上面跑了一个小例子。tensorflow和python环境是他们配置好的,不过我的例子中需要导入matplotlib.pylot模块。可是他们没有提供,怎么办呢?网上查了一下啊解决方法:采用如下方法:importpipdefMyPipi

- 【LangChain编程:从入门到实践】LangChain与其他框架的比较

AI天才研究院

AgenticAI实战计算AI人工智能与大数据计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

【LangChain编程:从入门到实践】LangChain与其他框架的比较1.背景介绍1.1人工智能发展现状在当今时代,人工智能(AI)已经成为科技领域中最热门和最具革命性的话题之一。随着计算能力的不断提升和算法的持续优化,AI系统正在不断扩展其应用范围,包括自然语言处理、计算机视觉、决策系统等各个领域。1.2LangChain概述在这种背景下,LangChain作为一个新兴的AI框架应运而生。L

- happy-llm 第一章 NLP 基础概念

weixin_38374194

自然语言处理人工智能学习

文章目录一、什么是NLP?二、NLP发展三大阶段三、NLP核心任务精要四、文本表示演进史1.传统方法:统计表征2.神经网络:语义向量化课程地址:happy-llmNLP基础概念一、什么是NLP?核心目标:让计算机理解、生成、处理人类语言,实现人机自然交互。现状与挑战:成就:深度学习推动文本分类、翻译等任务达到近人类水平。瓶颈:歧义性、隐喻理解、跨文化差异等。二、NLP发展三大阶段时期代表技术核心思

- Happy-LLM 第二章 Transformer

HalukiSan

transformer深度学习人工智能

Transform架构图片来自[Happy-llm](happy-llm/docs/chapter2/第二章Transformer架构.mdatmain·datawhalechina/happy-llm),若加载不出来,请开梯子注意力机制前馈神经网络每一层的神经元都与上下两层的每一个神经元完全连接数据在其中只向前流动,用于处理静态的数据,进行图像识别或者分类,但是该网络没有记忆能力,数据在它里面没

- PHP接单涨薪系列(九)之计算机视觉实战:PHP+Stable Diffusion接单指南(2025高溢价秘籍)

攻城狮凌霄

PHPPHP接单涨薪AIphp计算机视觉stablediffusion

案例场景某电商公司使用本方案后,产品图制作成本降低90%,广告转化率提升35%,单月节省设计费用超¥80,000。本文将彻底解密如何用PHP+AI视觉技术接取高单价设计外包,让你在竞争激烈的市场中脱颖而出!一、视觉设计市场的AI革命1.1传统设计vsAI设计设计任务传统流程AI流程需求沟通初稿设计反复修改最终交付AI生成微调即时交付2025年设计市场数据对比:指标传统设计AI设计提升幅度单图制作时

- 供应链风险管理:AI预测潜在风险

AI智能应用

AI大模型应用入门实战与进阶javapythonjavascriptkotlingolang架构人工智能

供应链风险管理,AI预测,机器学习,深度学习,自然语言处理,风险评估,供应链可视化1.背景介绍在当今全球化经济体系中,供应链的复杂性和脆弱性日益凸显。供应链风险是指任何可能对供应链正常运行造成负面影响的事件或因素。这些风险可能来自自然灾害、政治动荡、经济波动、技术故障、供应商违约等方面。一旦供应链风险爆发,可能会导致生产中断、产品短缺、成本飙升、品牌形象受损等严重后果。传统供应链风险管理方法主要依

- 供应链风险管理:AI如何预测供应链风险

AI大模型应用之禅

javapythonjavascriptkotlingolang架构人工智能

供应链风险管理,AI预测,机器学习,深度学习,自然语言处理,时间序列分析,风险评估1.背景介绍在当今全球化经济体系中,供应链风险已成为企业面临的重大挑战。供应链的复杂性和不可预测性使得企业更容易受到各种风险的影响,例如自然灾害、政治动荡、经济波动、疫情爆发等。这些风险可能导致供应中断、成本增加、交付延迟,甚至损害企业声誉。传统供应链风险管理方法主要依赖于经验和专家判断,缺乏数据驱动和预测能力。随着

- 【极光优化算法+分解对比】VMD-PLO-Transformer-LSTM多变量时间序列光伏功率预测Matlab代码

matlab科研助手

算法transformerlstm

✅作者简介:热爱数据处理、建模、算法设计的Matlab仿真开发者。更多Matlab代码及仿真咨询内容点击:Matlab科研工作室个人信条:格物致知。内容介绍光伏发电作为一种清洁能源,其功率预测对于电网稳定运行和电力系统调度至关重要。然而,光伏功率具有高度的非线性和波动性,传统的预测方法难以准确捕捉其动态特性。近年来,深度学习技术在时间序列预测领域取得了显著进展,为提高光伏功率预测精度提供了新的途径

- Day36 复习日

cylat

python打卡深度学习机器学习人工智能python神经网络

目录一、对之前的信贷项目,利用神经网络训练下二、尝试进入nn.Module中,查看他的方法模型训练与评估相关参数管理相关模块管理相关设备相关钩子函数相关一、对之前的信贷项目,利用神经网络训练下importtorchimporttorch.nnasnnimporttorch.optimasoptimfromsklearn.model_selectionimporttrain_test_splitfr

- 【python深度学习】DAY 51 复习日

抽风的雨610

【打卡】Python训练营python深度学习开发语言

作业:day43的时候我们安排大家对自己找的数据集用简单cnn训练,现在可以尝试下借助这几天的知识来实现精度的进一步提高1.读取数据使用CIFAR-10图像数据importtorchfromtorchvisionimportdatasets,transforms#数据预处理transform=transforms.Compose([transforms.ToTensor(),transforms.

- 用Python解锁图像处理之力:从基础到智能应用的深度探索

熊猫钓鱼>_>

python图像处理开发语言

在像素构成的数字世界里,Python已成为解码图像奥秘的核心引擎。一、为何选择Python处理图像?超越工具的本质思考当人们谈论图像处理时,往往会陷入工具对比的漩涡(PythonvsMATLABvsC++)。但Python的真正价值在于其构建的完整生态闭环:科学计算基石:NumPy的ndarray结构完美对应图像的多维矩阵本质算法实现自由:从传统算子到深度学习模型的无缝衔接可视化即战力:Matpl

- 深度学习数据集加载

Ethan@LM

深度学习人工智能

数据集结构E:\Mytest\test20250622\pythonProject\dataset├──rose│├──rose1.jpg│├──rose2.jpg│└──...└──sunflower├──sunflower1.jpg├──sunflower2.jpg└──...主要只有的两个类fromtorch.utils.dataimportDatasetfromtorchvisionimp

- 纹理贴图算法研究论文综述

点云SLAM

算法图形图像处理算法纹理贴图计算机图形学计算机视觉人工智能虚拟现实(VR)纹理贴图算法综述

纹理贴图(TextureMapping)是计算机图形学和计算机视觉中的核心技术,广泛应用于三维重建、游戏渲染、虚拟现实(VR)、增强现实(AR)等领域。对其算法的研究涵盖了纹理生成、映射、缝合、优化等多个方面。1.引言纹理贴图是指将二维图像纹理映射到三维几何表面上,以增强模型的视觉真实感。传统方法主要关注静态几何模型上的纹理生成与映射,而近年来,随着多视角图像重建、RGB-D扫描、神经渲染的发展,

- 使用TVM编译部署DarkNet模型:YOLO-V2和YOLO-V3实战指南

周情津Raymond

使用TVM编译部署DarkNet模型:YOLO-V2和YOLO-V3实战指南tvm-cnTVMDocumentationinChineseSimplified/TVM中文文档项目地址:https://gitcode.com/gh_mirrors/tv/tvm-cn前言在深度学习模型部署领域,TVM作为一个高效的深度学习编译器栈,能够将训练好的模型优化并部署到各种硬件平台上。本文将详细介绍如何使用T

- ConvNeXT:面向 2020 年代的卷积神经网络

摘要视觉识别的“咆哮二十年代”始于VisionTransformer(ViT)的引入,ViT很快取代了ConvNet,成为图像分类任务中的最新最强模型。然而,vanillaViT在应用于目标检测、语义分割等通用计算机视觉任务时面临困难。HierarchicalTransformer(如SwinTransformer)重新引入了若干ConvNet的先验知识,使Transformer成为实用的通用视觉

- html

周华华

html

js

1,数组的排列

var arr=[1,4,234,43,52,];

for(var x=0;x<arr.length;x++){

for(var y=x-1;y<arr.length;y++){

if(arr[x]<arr[y]){

&

- 【Struts2 四】Struts2拦截器

bit1129

struts2拦截器

Struts2框架是基于拦截器实现的,可以对某个Action进行拦截,然后某些逻辑处理,拦截器相当于AOP里面的环绕通知,即在Action方法的执行之前和之后根据需要添加相应的逻辑。事实上,即使struts.xml没有任何关于拦截器的配置,Struts2也会为我们添加一组默认的拦截器,最常见的是,请求参数自动绑定到Action对应的字段上。

Struts2中自定义拦截器的步骤是:

- make:cc 命令未找到解决方法

daizj

linux命令未知make cc

安装rz sz程序时,报下面错误:

[root@slave2 src]# make posix

cc -O -DPOSIX -DMD=2 rz.c -o rz

make: cc:命令未找到

make: *** [posix] 错误 127

系统:centos 6.6

环境:虚拟机

错误原因:系统未安装gcc,这个是由于在安

- Oracle之Job应用

周凡杨

oracle job

最近写服务,服务上线后,需要写一个定时执行的SQL脚本,清理并更新数据库表里的数据,应用到了Oracle 的 Job的相关知识。在此总结一下。

一:查看相关job信息

1、相关视图

dba_jobs

all_jobs

user_jobs

dba_jobs_running 包含正在运行

- 多线程机制

朱辉辉33

多线程

转至http://blog.csdn.net/lj70024/archive/2010/04/06/5455790.aspx

程序、进程和线程:

程序是一段静态的代码,它是应用程序执行的蓝本。进程是程序的一次动态执行过程,它对应了从代码加载、执行至执行完毕的一个完整过程,这个过程也是进程本身从产生、发展至消亡的过程。线程是比进程更小的单位,一个进程执行过程中可以产生多个线程,每个线程有自身的

- web报表工具FineReport使用中遇到的常见报错及解决办法(一)

老A不折腾

web报表finereportjava报表报表工具

FineReport使用中遇到的常见报错及解决办法(一)

这里写点抛砖引玉,希望大家能把自己整理的问题及解决方法晾出来,Mark一下,利人利己。

出现问题先搜一下文档上有没有,再看看度娘有没有,再看看论坛有没有。有报错要看日志。下面简单罗列下常见的问题,大多文档上都有提到的。

1、address pool is full:

含义:地址池满,连接数超过并发数上

- mysql rpm安装后没有my.cnf

林鹤霄

没有my.cnf

Linux下用rpm包安装的MySQL是不会安装/etc/my.cnf文件的,

至于为什么没有这个文件而MySQL却也能正常启动和作用,在这儿有两个说法,

第一种说法,my.cnf只是MySQL启动时的一个参数文件,可以没有它,这时MySQL会用内置的默认参数启动,

第二种说法,MySQL在启动时自动使用/usr/share/mysql目录下的my-medium.cnf文件,这种说法仅限于r

- Kindle Fire HDX root并安装谷歌服务框架之后仍无法登陆谷歌账号的问题

aigo

root

原文:http://kindlefireforkid.com/how-to-setup-a-google-account-on-amazon-fire-tablet/

Step 4: Run ADB command from your PC

On the PC, you need install Amazon Fire ADB driver and instal

- javascript 中var提升的典型实例

alxw4616

JavaScript

// 刚刚在书上看到的一个小问题,很有意思.大家一起思考下吧

myname = 'global';

var fn = function () {

console.log(myname); // undefined

var myname = 'local';

console.log(myname); // local

};

fn()

// 上述代码实际上等同于以下代码

m

- 定时器和获取时间的使用

百合不是茶

时间的转换定时器

定时器:定时创建任务在游戏设计的时候用的比较多

Timer();定时器

TImerTask();Timer的子类 由 Timer 安排为一次执行或重复执行的任务。

定时器类Timer在java.util包中。使用时,先实例化,然后使用实例的schedule(TimerTask task, long delay)方法,设定

- JDK1.5 Queue

bijian1013

javathreadjava多线程Queue

JDK1.5 Queue

LinkedList:

LinkedList不是同步的。如果多个线程同时访问列表,而其中至少一个线程从结构上修改了该列表,则它必须 保持外部同步。(结构修改指添加或删除一个或多个元素的任何操作;仅设置元素的值不是结构修改。)这一般通过对自然封装该列表的对象进行同步操作来完成。如果不存在这样的对象,则应该使用 Collections.synchronizedList 方

- http认证原理和https

bijian1013

httphttps

一.基础介绍

在URL前加https://前缀表明是用SSL加密的。 你的电脑与服务器之间收发的信息传输将更加安全。

Web服务器启用SSL需要获得一个服务器证书并将该证书与要使用SSL的服务器绑定。

http和https使用的是完全不同的连接方式,用的端口也不一样,前者是80,后

- 【Java范型五】范型继承

bit1129

java

定义如下一个抽象的范型类,其中定义了两个范型参数,T1,T2

package com.tom.lang.generics;

public abstract class SuperGenerics<T1, T2> {

private T1 t1;

private T2 t2;

public abstract void doIt(T

- 【Nginx六】nginx.conf常用指令(Directive)

bit1129

Directive

1. worker_processes 8;

表示Nginx将启动8个工作者进程,通过ps -ef|grep nginx,会发现有8个Nginx Worker Process在运行

nobody 53879 118449 0 Apr22 ? 00:26:15 nginx: worker process

- lua 遍历Header头部

ronin47

lua header 遍历

local headers = ngx.req.get_headers()

ngx.say("headers begin", "<br/>")

ngx.say("Host : ", he

- java-32.通过交换a,b中的元素,使[序列a元素的和]与[序列b元素的和]之间的差最小(两数组的差最小)。

bylijinnan

java

import java.util.Arrays;

public class MinSumASumB {

/**

* Q32.有两个序列a,b,大小都为n,序列元素的值任意整数,无序.

*

* 要求:通过交换a,b中的元素,使[序列a元素的和]与[序列b元素的和]之间的差最小。

* 例如:

* int[] a = {100,99,98,1,2,3

- redis

开窍的石头

redis

在redis的redis.conf配置文件中找到# requirepass foobared

把它替换成requirepass 12356789 后边的12356789就是你的密码

打开redis客户端输入config get requirepass

返回

redis 127.0.0.1:6379> config get requirepass

1) "require

- [JAVA图像与图形]现有的GPU架构支持JAVA语言吗?

comsci

java语言

无论是opengl还是cuda,都是建立在C语言体系架构基础上的,在未来,图像图形处理业务快速发展,相关领域市场不断扩大的情况下,我们JAVA语言系统怎么从这么庞大,且还在不断扩大的市场上分到一块蛋糕,是值得每个JAVAER认真思考和行动的事情

- 安装ubuntu14.04登录后花屏了怎么办

cuiyadll

ubuntu

这个情况,一般属于显卡驱动问题。

可以先尝试安装显卡的官方闭源驱动。

按键盘三个键:CTRL + ALT + F1

进入终端,输入用户名和密码登录终端:

安装amd的显卡驱动

sudo

apt-get

install

fglrx

安装nvidia显卡驱动

sudo

ap

- SSL 与 数字证书 的基本概念和工作原理

darrenzhu

加密ssl证书密钥签名

SSL 与 数字证书 的基本概念和工作原理

http://www.linuxde.net/2012/03/8301.html

SSL握手协议的目的是或最终结果是让客户端和服务器拥有一个共同的密钥,握手协议本身是基于非对称加密机制的,之后就使用共同的密钥基于对称加密机制进行信息交换。

http://www.ibm.com/developerworks/cn/webspher

- Ubuntu设置ip的步骤

dcj3sjt126com

ubuntu

在单位的一台机器完全装了Ubuntu Server,但回家只能在XP上VM一个,装的时候网卡是DHCP的,用ifconfig查了一下ip是192.168.92.128,可以ping通。

转载不是错:

Ubuntu命令行修改网络配置方法

/etc/network/interfaces打开后里面可设置DHCP或手动设置静态ip。前面auto eth0,让网卡开机自动挂载.

1. 以D

- php包管理工具推荐

dcj3sjt126com

PHPComposer

http://www.phpcomposer.com/

Composer是 PHP 用来管理依赖(dependency)关系的工具。你可以在自己的项目中声明所依赖的外部工具库(libraries),Composer 会帮你安装这些依赖的库文件。

中文文档

入门指南

下载

安装包列表

Composer 中国镜像

- Gson使用四(TypeAdapter)

eksliang

jsongsonGson自定义转换器gsonTypeAdapter

转载请出自出处:http://eksliang.iteye.com/blog/2175595 一.概述

Gson的TypeAapter可以理解成自定义序列化和返序列化 二、应用场景举例

例如我们通常去注册时(那些外国网站),会让我们输入firstName,lastName,但是转到我们都

- JQM控件之Navbar和Tabs

gundumw100

htmlxmlcss

在JQM中使用导航栏Navbar是简单的。

只需要将data-role="navbar"赋给div即可:

<div data-role="navbar">

<ul>

<li><a href="#" class="ui-btn-active&qu

- 利用归并排序算法对大文件进行排序

iwindyforest

java归并排序大文件分治法Merge sort

归并排序算法介绍,请参照Wikipeida

zh.wikipedia.org/wiki/%E5%BD%92%E5%B9%B6%E6%8E%92%E5%BA%8F

基本思想:

大文件分割成行数相等的两个子文件,递归(归并排序)两个子文件,直到递归到分割成的子文件低于限制行数

低于限制行数的子文件直接排序

两个排序好的子文件归并到父文件

直到最后所有排序好的父文件归并到输入

- iOS UIWebView URL拦截

啸笑天

UIWebView

本文译者:candeladiao,原文:URL filtering for UIWebView on the iPhone说明:译者在做app开发时,因为页面的javascript文件比较大导致加载速度很慢,所以想把javascript文件打包在app里,当UIWebView需要加载该脚本时就从app本地读取,但UIWebView并不支持加载本地资源。最后从下文中找到了解决方法,第一次翻译,难免有

- 索引的碎片整理SQL语句

macroli

sql

SET NOCOUNT ON

DECLARE @tablename VARCHAR (128)

DECLARE @execstr VARCHAR (255)

DECLARE @objectid INT

DECLARE @indexid INT

DECLARE @frag DECIMAL

DECLARE @maxfrag DECIMAL

--设置最大允许的碎片数量,超过则对索引进行碎片

- Angularjs同步操作http请求with $promise

qiaolevip

每天进步一点点学习永无止境AngularJS纵观千象

// Define a factory

app.factory('profilePromise', ['$q', 'AccountService', function($q, AccountService) {

var deferred = $q.defer();

AccountService.getProfile().then(function(res) {

- hibernate联合查询问题

sxj19881213

sqlHibernateHQL联合查询

最近在用hibernate做项目,遇到了联合查询的问题,以及联合查询中的N+1问题。

针对无外键关联的联合查询,我做了HQL和SQL的实验,希望能帮助到大家。(我使用的版本是hibernate3.3.2)

1 几个常识:

(1)hql中的几种join查询,只有在外键关联、并且作了相应配置时才能使用。

(2)hql的默认查询策略,在进行联合查询时,会产

- struts2.xml

wuai

struts

<?xml version="1.0" encoding="UTF-8" ?>

<!DOCTYPE struts PUBLIC

"-//Apache Software Foundation//DTD Struts Configuration 2.3//EN"

"http://struts.apache