【论文笔记】InverseForm: A Loss Function for Structured Boundary-Aware Segmentation

论文

标题:InverseForm: A Loss Function for Structured Boundary-Aware Segmentation

收录于:CVPR 2021

论文:[2104.02745] InverseForm: A Loss Function for Structured Boundary-Aware Segmentation (arxiv.org)

代码:GitHub - Qualcomm-AI-research/InverseForm

参考:【图像分割】InverseForm: A Loss Function for Structured Boundary-Aware Segmentation - 知乎 (zhihu.com)

摘要

提出了一种新的基于逆变换网络的边界感知损失项语义分割方法(InverseForm boundary loss),该方法能够有效地学习估计边界和目标边界之间的参数变换程度。此损失项补充了捕获边界变换时的交叉熵损失,并允许在不增加其大小和计算复杂性的情况下,对分段主干模型进行一致且显著的性能改进。分析该损失函数对三个室内和室外分段基准的定量和定性影响,包括Citycapes、NYU-Depth-v2和Pascal,并将其整合到单任务和多任务环境下的几个骨干网络的训练阶段。大量实验表明,该方法的性能始终优于基线,甚至在两个数据集上都达到了sota。

We present a novel boundary-aware loss term for semantic segmentation using an inverse-transformation network, which efficiently learns the degree of parametric transformations between estimated and target boundaries. This plug-in loss term complements the cross-entropy loss in capturing boundary transformations and allows consistent and significant performance improvement on segmentation backbone models without increasing their size and computational complexity.

引言

语义分割有两个改进方向:一是集成多分辨率和多层特征;二是利用边界信息进行增强。

以往的工作大多采用交叉熵Cross-entropy 来作为边界检测的损失函数,但是cross-entropy 只是衡量了预测值和Ground Truth之间的像素变化,忽略了像素离目标边界的空间距离,并且它不能有效地测量局部空间变化,如平移、旋转、缩放等。

为解决上述问题,在常用的分割损失函数中引入一种基于边界距离的度量--InverseForm。我们设计了一个逆变换网络来建模边界图之间的距离,该网络可以有效地学习局部空间区域之间的参数变换程度。这一措施使我们能够在不增加推理规模和网络计算复杂性的情况下,使用任何骨干模型在语义分割方面实现显著和一致的改进。

具体地说,我们在训练阶段提出了一种边界感知的分割方案,通过将我们的空间距离损失InverseForm整合到现有的基于像素的损失中。我们基于距离的损失是对捕捉边界变换的基于像素的损失的补充。我们利用我们的逆变换网络来测量与边界的距离,并联合优化像素标签精度和边界距离。我们可以将我们提出的方案集成到任何分割模型中;

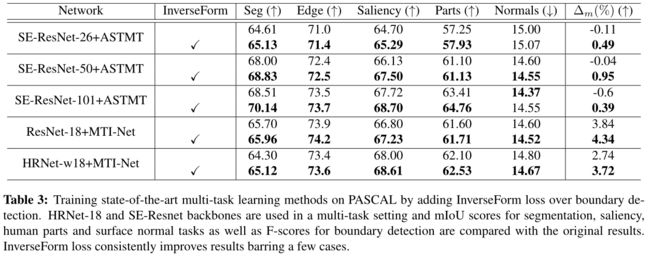

例如,我们采用了最新的HRNet[45]架构作为主干之一,因为它保持了高分辨率的特征地图。我们还采用了各种MTL框架[31][44]来利用它们的边界检测任务,在不增加计算和存储成本的情况下,进一步提高分割性能。在这个变种中,我们展示了所有任务的一致性能改进。

在NYU-Depth-v2 ,Cityscapes and PASCAL-Context进行实验,性能明显提升。

图1:左图:城市景观Val基准图片[9]。中:HRNet-48-OCR基线的分割预测。右:同样的骨干训练使用 InverseForm boundary loss。我们的模型取得了明显的改进,例如,顶部图形的路边边界与边界结构更好地对齐,底部的路边被正确检测出来。

本文的主要工作包括以下几个方面:

- 提出一种基于边界距离的语义分割方法--InverseForm。实验结果表明,与基于交叉熵的分割方法相比,该方法能够更好地捕捉空间边界变换,从而得到更准确的分割结果。

- 我们的方案与主干架构选择无关,并且非常灵活地插入到任何现有的分段模型中,而不需要额外的推理成本。由于其即插即用的特性,它不会影响网络的主要结构。它是灵活的并且可以适应多任务学习框架。

- 大量实验表明,我们的边界感知分割方法的性能始终优于它的基线,并且在单任务(NYUDepth-v2)和多任务设置(Pascal)上都优于最先进的方法。

方法 InverseForm

基于距离的度量的动机 Motivation for distance-based metrics

边界感知分割方法使用像素级交叉熵或平衡交叉熵损失。这种损失函数考虑了像素级特征(强度等)。而不是物体边界和地面真实边界之间的空间距离。因此,它们不足以实施边界对齐以进行分割。

基于像素的损耗不足以衡量这些输入间的距离。为抵消对小位移的敏感性的影响,用基于像素的损失训练的边界检查网络会产生更厚和扭曲的边界。需要一个损失函数,可以准确地建模对象边界的两个图像间地距离,且计算高效。

逆变换网络 Inverse transformation network

为了模拟两个边界图之间的空间关系,假设它们通过单应变换相互关联。为此创建一个网络,它输入两个边界图,并预测“单应变化”作为其输出。理论上,该网络执行空间变压器网络(Spatial transformer network,STN)的逆操作。

如图3(A)所示,STN将图像x作为其输入,生成受控变换矩阵θ,并生成逼真的变换边界图像t![]() 。图3(B)显示论文提出的网络。网络的输入是两个边界图。网络将这些映射之间的变换参数作为其输出进行回归。逆变换网络,用于学习两幅图像间的变换关系。

。图3(B)显示论文提出的网络。网络的输入是两个边界图。网络将这些映射之间的变换参数作为其输出进行回归。逆变换网络,用于学习两幅图像间的变换关系。

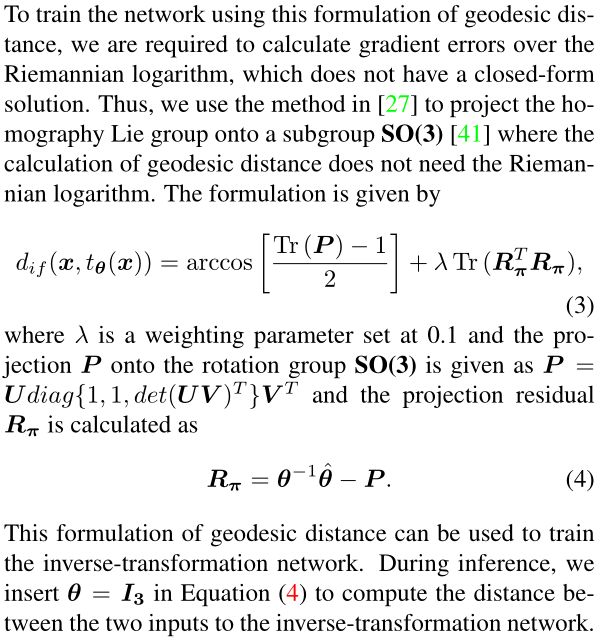

从单应性测量距离 Measuring distances from homography

假设两个边界映射通过单应变换相互关联,逆变换网络输入两个边界映射并估计变换矩阵参数。在逆变换网络被训练后,冻结它的权重以产生InverseForm loss。如果输入边界图之间存在完美匹配,则网络应估计单位矩阵。因此,可以通过将网络输出与单位矩阵进行比较来计算边界图之间的空间距离的测量。

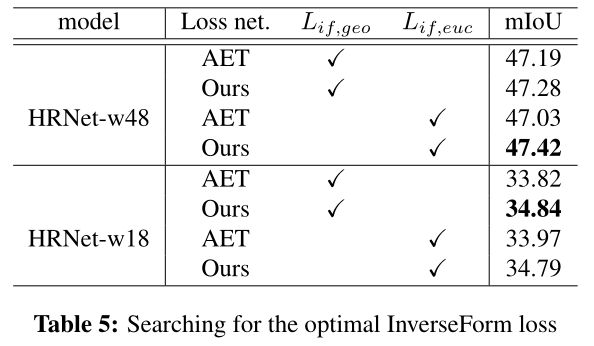

这里有两个距离度量,将其联系起来:Euclidean distance and Geodesic distance. (欧几里德距离和测地距离)。

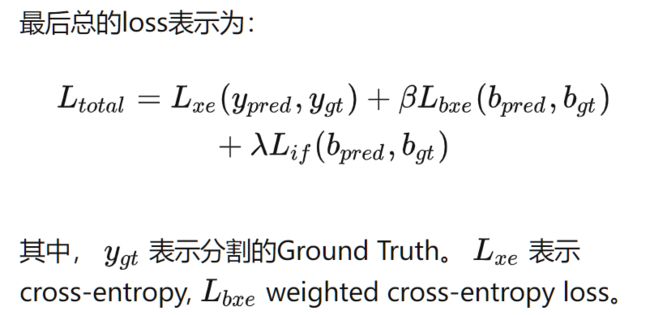

使用InverseForm作为损失函数 Using InverseForm as a loss function

实验

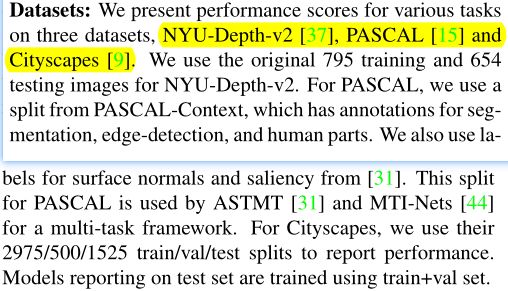

数据集和评价指标

实验结果

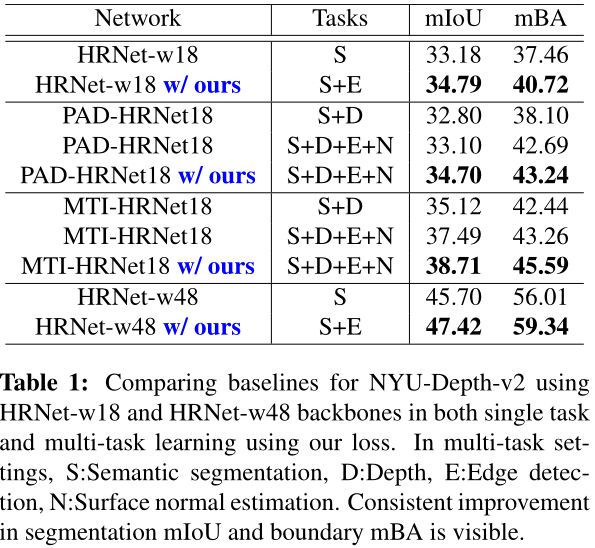

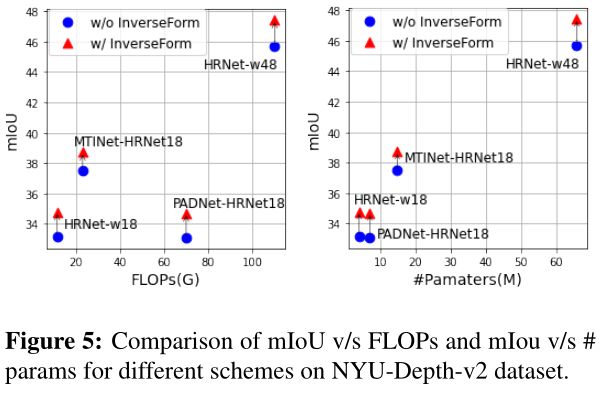

NYU-Depth-v2

Cityscapes