【CVPR2022文章翻译】Oriented RepPoints for Aerial Object Detection全文翻译

paper:https://arxiv.org/pdf/2105.11111.pdf

Oriented RepPoints for Aerial Object Detection

- Abstract

- 1. Introduction

- 2. Related Work

-

- 2.1. Oriented Object detection

- 2.2. Non-axis Aligned Features Learning

- 2.3. Samples Assignment for Object Detection

- 3. Oriented RepPoints

-

- 3.1. Overview

- 3.2. Adaptive Points Learning with Orientation

- 3.3. Adaptive Points Assessment and Assignment

- 4. Experiments

-

- 4.1. Evaluation Testbed

- 4.2. Implementation Details

- 4.3. Ablation Study

- 4.4. Comparison with the State-of-the-art methods

- 4.5. Evaluation on Orientation Accuracy

- 5. Conclusion

Abstract

与一般目标不同,空中目标是在杂乱的环境中以任意方向排列的十个非轴目标。与主流的包围盒方向回归方法不同,本文提出了一种有效的自适应点学习方法,该方法利用自适应点表示,能够捕获任意方向实例的几何信息。为此,提出了三个定向转换函数,以便于准确定位的分类定位。此外,我们还提出了一种有效的自适应点学习质量评估和样本分配方案,在训练过程中选择有代表性的重复点样本,能够捕获相邻目标或背景噪声中的非轴对齐特征。引入空间约束来惩罚Roust自适应学习中的离群点。在DOTA、HRSC2016、UCAS-AOD和Dior-R四个具有挑战性的航空数据集上的实验结果表明了该方法的有效性。源代码可以在:https://github.com/LiWentomng/OrientedRepPoints上找到

1. Introduction

空中目标检测作为一项重要的计算机视觉任务,近年来受到越来越多的关注,在远程图像理解中发挥着重要的作用。与一般的目标检测不同,空中目标定位有其自身的困难,包括任意方向的非轴对齐目标和密集分布的复杂背景。

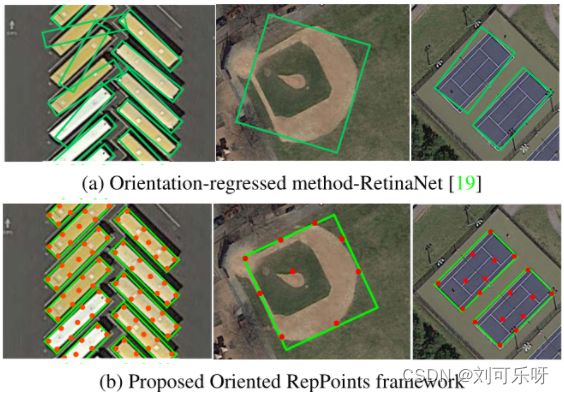

直接方向回归方法在这一研究领域占据主导地位,它是由带有额外取向参数的普通香草检测器衍生而来的。虽然已经实现了承诺但是,直接定向预测仍然存在损失的不连续性和回归不一致性等问题。这主要是由于角方向的有界周期性和旋转边界框的方向定义所致。尽管它们的定位结果很有吸引力,但基于取向回归的探测器可能不能准确地预测取向,如图1-(A)所示。

直接方向回归方法在这一研究领域占据主导地位,它是由带有额外取向参数的普通香草检测器衍生而来的。虽然已经实现了承诺但是,直接定向预测仍然存在损失的不连续性和回归不一致性等问题。这主要是由于角方向的有界周期性和旋转边界框的方向定义所致。尽管它们的定位结果很有吸引力,但基于取向回归的探测器可能不能准确地预测取向,如图1-(A)所示。

为了有效地解决上述问题,我们重新审视了空中目标的表示,以避免敏感的方向估计。作为一种细粒度的对象表示,点集显示出在传统的通用检测器(如 RepPoints )中捕获关键语义特征的巨大潜力。然而,其简单的转换函数只产生竖直、水平边界框,不能精确估计空中目标的方位。此外,RepPoints只根据语义特征对关键点进行回归,而忽略了有效衡量学习点的质量。这可能会导致航空图像中分布密集、场景复杂的非轴对准目标的性能较差。

在这项工作中,我们提出了一种面向航空图像的目标检测器,称为Oriented RepPoints,它引入了对不同方向、形状和姿势的自适应点表示。与传统的定向回归方法相比,我们提出的方法不仅实现了精确定向的空中探测,而且捕捉到了任意定向空中实例的基本几何结构,如图1所示。具体地说,从中心点生成初始自适应点,并对其进行进一步细化以适应空中目标。为了得到有向包围盒,根据学习点的布局,提出了三个方向转换函数。此外,还提出了一种有效的自适应点集评估和分配(APAA)方案,该方案不仅从分类、局部化方面衡量定向重复点的质量,而且还从它们在训练过程中的定向和逐点特征关系来衡量定向重复点的质量。这样的方案使得检测器能够从相邻目标或背景噪声中捕获非轴对齐的特征,从而分配具有代表性的定向重复点样本。此外,还提出了一种空间约束,以便于易受攻击的点从空中场景中的复杂上下文中找到它们的实例所有者。与基于方向回归的方法相比,我们的框架在精确定位的情况下获得了更精确的检测性能。

综上所述,本文的主要贡献有:(1)提出了一种有效的空中目标检测方法–定向Rep-Points,其中引入了灵活的自适应点作为面向目标检测的表示;(2)提出了一种新的自适应点学习质量评估和样本分配方案,它不仅从分类、定位而且从定向、点特征关联中选择点样本;(3)在四个具有挑战性的数据集上进行了大量的实验,取得了良好的定性和定量结果。

2. Related Work

与大多数具有水平包围盒的通用目标探测器不同,航空图像中的目标往往是任意方向的、密集分布的。我们将在下面讨论相关工作。

2.1. Oriented Object detection

目前的空中目标检测方法主要是在经典目标检测器的基础上引入方向回归。SCRDet、CAD-Net、DRN、R3Det、REDET和Oriented R-CNN通过预测获得了良好的性能 边界框的旋转角度。Gliding Vertex和RSDet通过重新划分四边形提高了检测结果。为了解决基于角度的方位估计中的边界不连续性问题,Yang等人提出了一种新的方向估计方法。将角度回归转化为角度分类。后来,Yang等人提出了自己的观点。将旋转包围盒的参数化为二维高斯分布,从而获得更稳健的定向目标检测结果。这些方法致力于改进使用旋转角度表示的方向估计。此外,本文还介绍了一种更有效的使用自适应点表示的方法。

2.2. Non-axis Aligned Features Learning

传统的目标检测方法大多着眼于直立目标或轴向目标,这对检测复杂背景中密集分布的非轴向目标可能有一定的困难。为了解决这一问题,Ding等人采用轴对齐感兴趣区的空间变换,并在定向边界框的监督下学习非轴对齐表示。SCRDet++增强了非轴对齐特征并为训练带来了更高的对象响应网络。Han等人设计了特征对齐模块,以缓解轴向卷积特征与任意定向对象之间的对准问题。DRN提出了特征选择模块来聚合不同核大小、形状和方向的非轴对齐信息,并利用动态滤波生成器进行进一步的回归。Guo等人采用凸表示来学习不规则形状和布局,旨在通过可学习的特征自适应来避免特征混叠。我们提出了基于点集的方法适用于捕获非轴对齐空中物体的关键特征。

2.3. Samples Assignment for Object Detection

大量的检测方法采用简单的设置IOU阈值来选择正样本,但是由于潜在的噪声和困难情况,这种方案不能保证训练样本的整体质量。最近在一般目标检测中的一些样本分配方法,如ATSS、Free An-chor、PAA和OTA,采用学习匹配优化策略来选择高质量的样本。在航空场景中,由于方向的多样性和密集的分布,选择高质量的样本对定向检测器的学习至关重要。Ming等人提出了一种基于定向锚点的匹配度评价方法,该方法利用匹配敏感度损失来增强分类与定向定位之间的相关性。在这项工作中,我们提出了一种有效的质量评估和样本发送方案来选择正点样本。

3. Oriented RepPoints

3.1. Overview

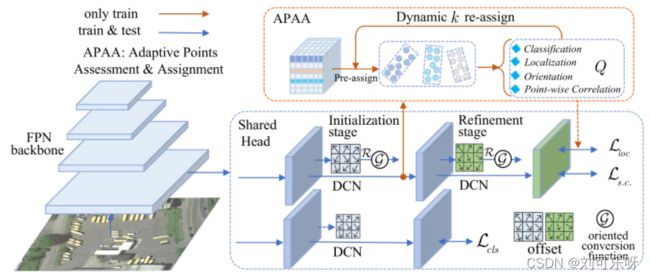

我们没有像传统的方法那样直接回归方向,而是利用自适应点集作为细粒度表示,能够捕捉复杂环境中方向变化剧烈的空中目标的几何结构。为此,我们引入了不同的转换函数,其中代表点被驱动以自适应地移动到定向对象上的适当位置。为了在没有直接点到点监督的情况下有效地学习高质量的适应点,我们提出了在培训阶段选择高质量的导向点的质量测量方案。为了便于稳健的自适应点学习,利用空间约束来惩罚易受攻击的离群点,并从复杂的空中环境中找到它们的实例所有者。图2显示了我们提出的面向Reppoint的方法的概述。

3.2. Adaptive Points Learning with Orientation

为了便于使用点集表示的方向检测器,引入转换函数将自适应点转换为有向包围盒。设G表示定向转换函数,如下所示:

O B = g ( R ) (1) OB=g(R)\tag{1} OB=g(R)(1)

其中 O B OB OB表示从学习点集 R R R转换而来的有向盒。在本文中,我们考察三个有向转换函数:

- M i n A e r a R e c t MinAeraRect MinAeraRect的目的是在有向对象上找到从学习点集合开始具有最小面积的旋转矩形。

- N e a r e s t G T C o r n e r NearestGTCorner NearestGTCorner使用了基本事实表示法。对于每个角点,我们从学习点集合中找出最近的点作为预测角点,其中所选择的角点被用来构建一个四边形作为定向边界框。

- C o n v e x H u l l ConvexHull ConvexHull.有向实例多边形可以定义为由JarvisMarch算法驱动的一组点的凸壳,该算法被许多基于轮廓的方法所使用。

注意, N e a r e s t G T C o r n e r NearestGTCorner NearestGTCorner和 C o n v e x H u l l ConvexHull ConvexHull是可区分的函数,而 M i n A e r a R e c t MinAeraRect MinAeraRect不是。因此,我们在后处理中使用 M i n A e r a R e c t MinAeraRect MinAeraRect来得到标准的旋转矩形预测,并在训练过程中使用另外两个不同的函数来优化自适应点学习。在面向地物标注的监督下,点在分类损失和局部损失的共同驱动下,自适应地向每个对象的语义关键和几何特征移动。

提议的框架包括两个阶段。初始化阶段通过从对象中心点(特征映射箱)进行细化来生成自适应点集。细化阶段通过如下最小化损失函数来进一步获得准确的调整:

L = L c l s + λ 1 L s 1 + λ 2 L s 2 (2) \mathcal{L}=\mathcal{L}_{cls}+\lambda_1\mathcal{L}_{s1}+\lambda_2\mathcal{L}_{s2}\tag{2} L=Lcls+λ1Ls1+λ2Ls2(2) 其中 λ 1 \lambda_1 λ1和 λ 2 \lambda_2 λ2是平衡权重。 L c l s \mathcal{L}_{cls} Lcls表示对象分类损失:

L c l s = 1 N c l s ∑ i F c l s ( R i c l s ( θ ) , b i c l s ) (3) \mathcal{L}_{cls}=\frac{1}{N_{cls}}\sum_{i}\mathcal{F}_{cls}(\mathcal{R}^{cls}_{i}(\theta),{b}^{cls}_{i})\tag{3} Lcls=Ncls1i∑Fcls(Ricls(θ),bicls)(3)其中 R i c l s ( θ ) \mathcal{R}^{cls}_{i}(\theta) Ricls(θ)表示基于所学习的点的预测类置信度,而 b i c l s {b}^{cls}_{i} bicls是所分配的地面真实类。 F c l s \mathcal{F}_{cls} Fcls是焦点丢失。 N c l s N_{cls} Ncls表示点集的总数。 L s 1 \mathcal{L}_{s1} Ls1和 L s 2 \mathcal{L}_{s2} Ls2分别表示初始化和精化阶段的空间局部化损失。对于每个阶段, L s \mathcal{L}_{s} Ls可表示如下:

L s = L l o c + L s . c . (4) \mathcal{L}_{s}=\mathcal{L}_{loc}+\mathcal{L}_{s.c.}\tag{4} Ls=Lloc+Ls.c.(4)其中, L l o c \mathcal{L}_{loc} Lloc是基于转换的定向框的定位损失,而 L s . c . \mathcal{L}_{s.c.} Ls.c.表示空间约束损失。

设 N l o c {N}_{loc} Nloc表示正点集样本的总数。 b j l o c {b}^{loc}_{j} bjloc表示地面实况框的位置。因此, L l o c \mathcal{L}_{loc} Lloc的定义如下:

L l o c = 1 N l o c ∑ i [ b j c l s ≥ 1 ] F l o c ( O B i l o c ( θ ) , b j l o c ) (5) \mathcal{L}_{loc}=\frac{1}{N_{loc}}\sum_{i}[{b}^{cls}_{j}\ge1]\mathcal{F}_{loc}(O{B}^{loc}_{i}(\theta),{b}^{loc}_{j})\tag{5} Lloc=Nloc1i∑[bjcls≥1]Floc(OBiloc(θ),bjloc)(5)其中, F l o c \mathcal{F}_{loc} Floc是定向多边形的GIoU损失。

由于航空图像中不同类别的多样性和杂乱的背景,一部分学习点容易受到背景或关键特征较强的相邻目标的影响,这些目标可能会移动到地面真值框之外。为了便于易受攻击点捕捉其实例所有者的几何特征,我们引入了一个有效的空间约束来惩罚包围盒外的自适应点。设 ρ i j \rho_{ij} ρij表示惩罚函数。空间损耗 L s . c . \mathcal{L}_{s.c.} Ls.c.对于每个面向对象的定义如下:

L s . c . = 1 N a 1 N o ∑ i = 1 ∑ j = 1 ρ i j (6) \mathcal{L}_{s.c.}=\frac{1}{N_{a}}\frac{1}{N_{o}}\sum_{i=1}\sum_{j=1}\rho_{ij}\tag{6} Ls.c.=Na1No1i=1∑j=1∑ρij(6)其中, N a N_{a} Na表示为每个对象分配的正点集采样的数量。 N o N_{o} No是每个点集中GT框外的点数。

用 P c {P}_{c} Pc表示地面真实边界框的几何中心。给定界外框外的采样点 P o {P}_{o} Po,惩罚项定义如下:

ρ = { ∥ P o − P c ∥ , P o is outside GT 0 , otherwise (7) \rho=\begin{cases}\lVert{P}_{o}-{P}_{c}\rVert, & \text{P}_{o}\text{ is outside GT} \\0, & \text{otherwise}\end{cases}\tag{7} ρ={∥Po−Pc∥,0,Po is outside GTotherwise(7)其中GT表示真值框。

3.3. Adaptive Points Assessment and Assignment

由于缺乏直接的监督,对于密集和任意方向的航空图像目标。学习高质量的点对于自适应地捕捉几何特征是必不可少的。为此,我们提出了一种有效的衡量学习点质量的评估和分配方案,即在训练阶段将适应点的代表性样本分配为正样本。

对于适应点的质量度量。 首先,我们定义了一个质量度量 Q Q Q来评估学习的适应点,包括分类和可定位 Q c l s Q_{cls} Qcls、 Q l o c Q_{loc} Qloc、定向排列 Q o r i Q_{ori} Qori和每个定向点集的逐点相关 Q p o c Q_{poc} Qpoc。因此, Q Q Q的派生如下:

Q = Q c l s + μ 1 Q l o c + μ 2 Q o r i + μ 3 Q p o c (8) Q=Q_{cls}+\mu_{1}Q_{loc}+\mu_{2}Q_{ori}+\mu_{3}Q_{poc}\tag{8} Q=Qcls+μ1Qloc+μ2Qori+μ3Qpoc(8)点集 R i R_{i} Ri的分类能力 Q c l s Q_{cls} Qcls直接反映了它的分类置信度 R i c l s ( θ ) \mathcal{R}^{cls}_{i}(\theta) Ricls(θ),相应的分类损失 L c l s \mathcal{L}_{cls} Lcls衡量了点特征与地面真实分类标签 b j c l s {b}^{cls}_{j} bjcls的兼容性。我们对 Q c l s Q_{cls} Qcls的定义如下:

Q c l s ( R i , b j ) = L c l s ( R i c l s ( θ ) , b j c l s ) (9) Q_{cls}(\mathcal{R}_{i},b_{j})=\mathcal{L}_{cls}(\mathcal{R}^{cls}_{i}(\theta),{b}^{cls}_{j})\tag{9} Qcls(Ri,bj)=Lcls(Ricls(θ),bjcls)(9)为了评价点位置与真值 b j l o c {b}^{loc}_{j} bjloc的兼容性,我们采用了基于IoU变换的定位损失作为质量评估指标。表示点集中心靠近对象几何中心时的空间对齐。因此, Q l o c Q_{loc} Qloc定义如下:

Q l o c ( R i , b j ) = L l o c ( O B i l o c ( θ ) , b j l o c ) (10) Q_{loc}(\mathcal{R}_{i},b_{j})=\mathcal{L}_{loc}(O{B}^{loc}_{i}(\theta),{b}^{loc}_{j})\tag{10} Qloc(Ri,bj)=Lloc(OBiloc(θ),bjloc)(10)由于 Q l o c Q_{loc} Qloc可以看作是空间位置距离的一种度量,它对方位变化不敏感,特别是对于航空图像中的正方形物体。为了考虑方位对准,我们使用倒角距离来评价空间位置距离之间的方位差异预测点集和地面实况框轮廓点。我们首先采用 M i n A e r a R e c t MinAeraRect MinAeraRect转换函数从学习的点集中获得四个空间角点{v1,v2,v3,v4}。然后,从两个相邻的角点以相等的间隔对有序的点 R v \mathcal{R}^{v} Rv(默认为40点)进行采样。类似地,针对地面真实角点{g1,g2,g3,g4}生成点 R g \mathcal{R}^{g} Rg。因此, Q o r i Q_{ori} Qori的定义如下:

Q o r i ( R i , b j ) = C D ( R i v ( θ ) , R b j g ) (11) Q_{ori}(\mathcal{R}_{i},b_{j})=\mathcal{CD}(\mathcal{R}^{v}_{i}(\theta),\mathcal{R}^{g}_{b_{j}})\tag{11} Qori(Ri,bj)=CD(Riv(θ),Rbjg)(11)其中, C D \mathcal{CD} CD表示上述两组采样点之间的倒角距离:

C D ( R v , R g ) = 1 2 n ∑ i = 1 n min j ∥ ( x i v , y j v ) − ( x i g , y j g ) ∥ 2 + 1 2 n ∑ j = 1 n min i ∥ ( x i v , y j v ) − ( x i g , y j g ) ∥ 2 (12) \mathcal{CD}(\mathcal{R}^{v},\mathcal{R}^{g})=\frac{1}{2n}\sum_{i=1}^{n}\underset{j}{\min}\lVert(x^v_i,y^v_j)-(x^g_i,y^g_j)\rVert_2\\+\frac{1}{2n}\sum_{j=1}^{n}\underset{i}{\min}\lVert(x^v_i,y^v_j)-(x^g_i,y^g_j)\rVert_2\tag{12} CD(Rv,Rg)=2n1i=1∑njmin∥(xiv,yjv)−(xig,yjg)∥2+2n1j=1∑nimin∥(xiv,yjv)−(xig,yjg)∥2(12) ( x i v , y j v ) ∈ R v (x^v_i,y^v_j)\in\mathcal{R}^{v} (xiv,yjv)∈Rv表示预测空间角点的采样点, ( x i g , y j g ) ∈ R g (x^g_i,y^g_j)\in\mathcal{R}^{g} (xig,yjg)∈Rg表示由地面真实角点生成的采样点。

为了度量面向对象在点集上的逐点关联,我们提取逐点特征,并使用特征向量之间的余弦相似性作为学习自适应点的相关性度量 Q p o c Q_{poc} Qpoc。设 e i , k e_{i,k} ei,k表示第i自适应点集的第k个逐点特征向量。 e i , k ∗ e^*_{i,k} ei,k∗和 e i ∗ e^*_i ei∗表示来自i点集合的归一化嵌入特征向量及其平均值:

e i , k ∗ = e i , k ∥ e i , k ∥ 2 (13) e^*_{i,k}=\frac{e_{i,k}}{\lVert e_{i,k}\rVert_2}\tag{13} ei,k∗=∥ei,k∥2ei,k(13) e i ∗ = 1 N p ∑ k = 1 e i , k ∗ (14) e^*_i=\frac{1}{{N}_{p}}\sum_{k=1}e^*_{i,k}\tag{14} ei∗=Np1k=1∑ei,k∗(14)其中 N p {N}_{p} Np表示点集合中的点数。默认设置为9。基于上述表示法,第i点集的 Q p o c Q_{poc} Qpoc可表示为点特征多样性,如下所示:

Q p o c = 1 − 1 N p ∑ k cos < e i , k ∗ , e i ∗ > = 1 − 1 N p ∑ k e i , k ∗ ⋅ e i ∗ ∥ e i , k ∗ ∥ × ∥ e i ∗ ∥ (15) Q_{poc}=1-\frac{1}{{N}_{p}}\sum_{k}\cos

k = σ ∗ N t (16) k=\sigma*N_t\tag{16} k=σ∗Nt(16)其中 N t N_t Nt表示每个定向对象在初始化阶段的点集样本的总数。

在训练过程中,点分配器用于在初始化阶段获得中心点的样本分配。在调整精确度阶段,提出的自适应点评估和分配(APAA)方案根据质量度量 Q Q Q来选择高质量的点样本,只有选择的正点集才会被分配目标的地面真实边界框。如图3所示,APAA方案使检测器能够预测高质量的定向重复点,以提高分类置信度和定位分数。值得一提的是,该方案仅用于训练,在推理阶段不会产生计算量。

4. Experiments

4.1. Evaluation Testbed

DOTA是一个用于评估航空图像中定向目标检测性能的大规模数据集,包含2806幅图像、188,282个实例和15个具有不同方向、尺度和形状的类别。训练集有1411幅图像,而验证集有458幅图像。测试集由937幅图像组成。图像大小从800×800到4000×4000不等。在我们的实验中,训练集和验证集都被用来训练所提出的检测器,而没有注释的测试集被用来进行评估。在训练阶段,我们将原始图像裁剪成1024×1024的块,步长为824。在训练阶段,我们随机地调整图像的大小并进行翻转,以避免过拟合。

HRSC2016包含了从几个著名港口收集的大量外观各异的条状目标对象,用于船舶识别。为了公平比较,训练集(436幅)和验证集(181幅)用于训练,测试集(444幅)用于评估。

UCAS-AOD有1510幅图像,其中有510幅汽车图像和1000幅飞机图像。总共有14,596个实例。整个数据集随机分为755幅图像用于训练,302幅图像用于验证,453幅图像用于测试,比例为5:2:3。所有图像的大小约为1280×659。

Dior-R为定向检测任务给出了基于Dior数据集的定向边界框注释。共有23,463张图片,大小为800×800,192,518个实例,覆盖20个对象类。

4.2. Implementation Details

我们基于ResNet-50和ResNet-101骨干网络实现了我们的方法,在我们的工作中,FPN由 P 3 P_3 P3到 P 7 P_7 P7金字塔层级组成,训练中使用了随机梯度下降(SGD)优化器。初始学习率设置为0.008,预热500次,每衰减一步,学习率降低0.1%。分别用40次迭代、40次迭代、120次迭代和120次迭代对DOTA、DIOR、HRSC2016和UCAS−AOD模型进行训练。在训练阶段采用比例抖动。焦距损失的超参数设置为 α = 0.25 α=0.25 α=0.25和 γ = 2.0 γ=2.0 γ=2.0。在等式中(2)经验性地设定了各阶段的平衡权重 λ 1 = 0.3 λ_1=0.3 λ1=0.3和 λ 2 = 1 λ_2=1 λ2=1。我们将 μ 1 = 1.0 μ_1=1.0 μ1=1.0、 μ 2 = 0.3 μ_2=0.3 μ2=0.3和 μ 3 = 0.1 μ_3=0.1 μ3=0.1设置为质量评价 Q Q Q在等式(8)。进行了几个实验,以选择表6中的采样率 σ σ σ的适当值。

我们在4个RTX2080Ti GPU的服务器上进行了实验,batch size为8(每个GPU 2个图像)用于训练,同时使用单个RTX 2080Ti GPU进行推理.

4.3. Ablation Study

利用ResNet-50-FPN在DOTA数据集上进行了一系列的消融实验,以检验我们所提出的框架中各组件的有效性。

定向转换函数的评价。 传统的基于点集的物体检测器RepPoints通过像最小-最大函数一样的平方转换函数来获得直立的边界框,这不能处理具有任意方向的空中物体。为了建立一个合理的基线,我们比较了不同的转换函数,在训练和后处理过程中将自适应点映射到有向框中。表1显示了实验结果。在原有RepPoints的基础上,通过训练和后处理,均可获得49.69%的mAP。利用所提出的 O r i e n t e d M i n A e r a R e c t OrientedMinAeraRect OrientedMinAeraRect函数进行后处理得到旋转的矩形方框,得到了53.21%的mAP。利用可微定向 N e a r e s t G T C o r n e r NearestGTCorner NearestGTCorner函数和 C o n v e x H u l l ConvexHull ConvexHull函数,我们的定向RepPoints获得了66.97%的mAP和68.89%的mAP,这表明定向转换函数对于空中目标检测是必不可少的。

与基于角度的探测器进行比较。 为了验证自适应点表示的有效性,我们在基于锚点的检测器上将我们的方法与基于角度的方向回归方法进行了比较。与 S 2 A − N E T S^2A-NET S2A−NET一样,基于角度的检测器在初始化阶段为每个特征地图位置预先设置一个平方锚点,其中预测的基于角度的框被视为下一阶段的精化锚点,以获得定向边界框。表2显示了两个具有不同骨架的检测器的结果。使用ResNet-50-FPN和ResNet-101-FPN的骨干网络,定向RepPoints的mAP改善率分别为+1.39%和+1.46%,优于基于角度的定向回归。

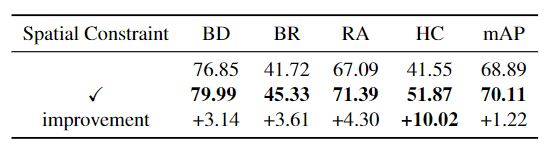

对空间约束的评价。 为了考察空间约束的有效性,我们将其与不使用空间约束的基线方法进行了比较。表3显示了实验结果。可以看出,我们提出的空间约束是非常有效的,特别是对于特征表示弱的空中物体,如HC(直升机),以及类似背景的物体,如BD(棒球厂),BR(桥梁)和RA(环形交叉口)。这是因为空间约束在其所有者实例对象上强制自适应点。

一种自适应点学习的APAA方案。 为了研究所提出的自适应点学习的APAA方案,我们首先逐项报告质量度量的性能。表5给出了不同设置对质量评估指标Q的检测结果。检测结果得到了渐进的改进,所提出的方法获得了最好的性能,MAP为75.97%,四项都有+5.86%的收益。结果表明,该质量评估方法能有效地反映空中目标检测适配点的质量。在APAA方案中,分配的自适应点数由采样率σ决定。如表6所示,当 σ = 0.4 σ=0.4 σ=0.4时,该模型的性能最好。此外,我们将我们的PAA方案与用于训练所提出的检测器的其他样本分配方案进行了比较,包括Max-IOU、ATSS、PAA和CFA。如表7所示,在没有复杂运算的情况下,我们的APAA方案取得了最好的性能,这表明我们提出的APAA方案对于自适应点学习是有效的。

4.4. Comparison with the State-of-the-art methods

关于DOTA的结果。 我们报告了单尺度的完整实验结果,以便与以前的方法在DOTA数据集上进行公平的比较。以ResNet-50-FPN和ResNet-101-FPN为骨干,我们的方法分别获得了75.97%和76.52%的mAP。它的性能优于其他具有相应主干的方法。使用Swin-Transformer的微型版本(Swin-T-FPN)作为主干,采用随机旋转和HSV变换,获得了77.63%mAP的最佳性能。图4给出了在DOTA测试集上的一些可视化结果。

关于HRSC2016的结果。 为了对HRSC2016进行全面的比较,我们提供了VOC2007和VOC2012两个指标的结果。表8显示了实验结果。我们的定向RepPoints在使用ResNet-50-FPN主干网的VOC2012指标下获得最佳性能,在VOC2007指标下获得第二好的性能。

UCAS-AOD检查结果。 UCAS-AOD数据集包含大量具有复杂环境场景的小对象。表9显示了在UCAS-AOD数据集上使用最新方法的评估结果。我们提出的方法获得了90.11%的最优mAP性能。

关于Dior-R的结果。 Dior-R数据集由20类航空目标组成。与最近在该数据集上的方法相比,我们获得了66.71%的MAP的最好性能,并且优于其他方法,如表10所示。

4.5. Evaluation on Orientation Accuracy

在此基础上,利用ResNet-50-FPN骨干网对定向探测器在DOTA数据集上的定位精度进行了实验评估。我们使用所有类别的平均平均定向误差( M A O E o MAOE^o MAOEo)作为评估度量。如表11所示,我们提出的方法获得了最小的方向误差,这表明我们的基于点集的方法与传统的基于方向回归的方法相比,对于精确的有向目标检测是有效的。

5. Conclusion

本文提出了一种有效的空中目标检测器,它利用自适应点作为细粒度表示,能够捕获任意方向、杂波和非轴向目标的关键几何特征。为了有效地学习自适应点,我们引入了质量评估和样本分配方案来度量和选择高质量的点样本进行训练。此外,利用空间约束来惩罚定向框外的点,以实现鲁棒自适应的点学习。在四个实验台上进行了大量的实验,实验结果证明了我们所提出的方法的有效性。