EMNLP 2022 最佳论文揭晓!这脑洞绝了….

文 | 付奶茶

编 | ZenMoore

前言

前言

读文章之前,我们先来思考人工智能中一个核心而底层的问题:什么是抽象以及它能够给我们带来什么?

我们这里说的“抽象”是一个认知学上的概念,著名学者 ChatGPT 说:“抽象是指不依赖于具体事物或实例,而是指抽取共同点或基本特征的思维过程。”

在人类智能中,抽象是一个很底层很基本的能力,在某种程度上,可以认为是人类智能的源头之一。因为人在对主客观世界进行观察的过程中,抽象出了无数种概念(concept),对这些概念的模块化(modularity)、组合式(compositionality)的理解,很大程度上刺激了人类语言的诞生,从而最终导致了人类智能、人类文明的产生。

举个例子,万年前的“猴子们”观察了大量的物理对象(object)、实体(entity)以及他们之间的关系(relation)等,逐渐在脑子里面形成了“石头”、“家庭”、“在...之间”、“因果”等概念,经过很长一段时间之后,“猴子们”把这些存在脑海里面的概念用“字”和“词”表示了出来,这些蕴含着抽象概念的字和词经过复杂的、有规则的组合,形成了各种各样的语言,而语言能够表达、演绎、推理一切!就这样,人类智能诞生了~

在认知科学上,七巧板就是这个智能过程的一个简单的重现:七巧板的每个板板就是上面说的一个类似“概念”的存在, 这些代表“概念”的板板模块经过组合,形成了多种多样的形状(shape),而人类如何理解这些形状,又如何理解这些板板,在某种程度上,就是某个人抽象能力的衡量。而抽象能力,就是人类进行推理(reasoning)以及泛化(generalization)的底层能力。

今天介绍的这篇文章荣获了EMNLP 2022 Best Long Paper, 巧妙地借鉴了七巧板这个童年游戏,评估了当前多模态模型的抽象理解能力。可以说,至少在人类级别智能的评测上,推进了一步!

论文标题:

Abstract Visual Reasoning with Tangram Shapes

论文链接:

https://arxiv.org/pdf/2211.16492.pdf

数据集的构建

数据集的构建

一套七巧板由 7 个颜色各异的板板组成,可以根据想法自由组合成各种各种的形状。

这篇论文首先收集了 1004 个七巧板图像,又从七巧板的研究文献中找了另外12种将其扩充到了 1016 个,然后在 Amazon Mechanical Turk 平台上雇了 297 个数据标注员,花了两千多美刀让他们标注了这么两个任务:

七巧板整体形状的预测:这部分数据集叫做 FULL “This shape as whole looks like ___”

部分预测:形容某个单独的部分是干啥的,因为细节标注比较密,所以把这部分数据集叫做 DENSE "The part you selected looks like___"

作者还从 DENSE 里面挑出来一些标注不那么密的子集,叫做 DENSE10.

在这个数据集当中,包含了类人形状(比如舞者)、动物形状(比如狗狗)还有物体形状(比如房屋)等等。可以从下面两张图中大概了解长什么样儿~

▲“头”用七巧板可以怎么展现

▲“头”用七巧板可以怎么展现

数据集质量衡量

数据集质量衡量

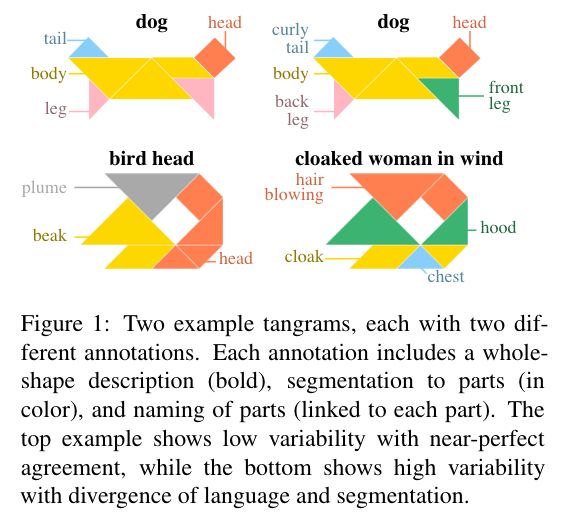

看了这些图,不难发现七巧板这个任务过于抽象,对人工数据集构建来说,这就导致了一个关键的问题:不同标注员之间存在较大的主观差异,“你说这是个鸟头,我却说那是个风中的美女头巾”(参考 Figure 1),这样数据集不就乱套了吗?好在作者给出了衡量这类数据集质量的三种指标:

形状命名差异(shape naming divergence,SND):用来衡量不同标注员进行不同七巧板图像的形状标注时的总体差异;

部分命名差异(part naming divergence PND):用来衡量不同标注员进行不同七巧板图像的局部标注时的总体差异,计算方式和 SND 大致相同;

分块分割一致性(part segmentation agreement,PSA):用来衡量不同标注员划分局部时的总体差异,也就是不同的人可能将不同的板板组合划分成某个部分。作者把这个看作是“使用最大权重匹配的线性和分配问题”,并使用成本矩阵计算(快去复习算法[旺柴])

总之这么衡量下来,数据集质量还是不错滴~ 符合真实分布~

具体的计算公式以及得到结论的细节,感兴趣的读者可以移步原文~

多模态模型有抽象能力吗?

多模态模型有抽象能力吗?

作者把构建的数据集叫做 KILOGRAM,主要衡量了两类代表性多模态模型的视觉抽象能力:

以 CLIP 为代表的双塔模型:视觉和语言模态采用不同的 encoder;

以 ViLT 为代表的单塔模型:视觉和语言拼接成一长串输入,喂给同一个 encoder.

1. 任务形式化

给定一个文本描述 和对应的 张图像 , 这个任务是从这些图像当中选择和文本描述相匹配的那一张, . 其中, 是指相似度。

因此总的来说,这就是一个简单的文图匹配(ITM, image-text matching)或分类任务。

2. 输入和输出

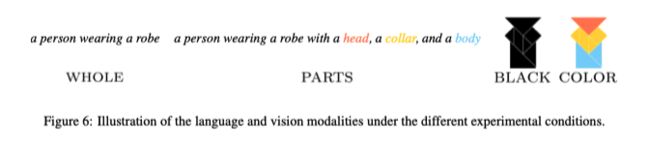

图像分成两种形式:作为整体的 "BLACK" 以及局部标注的 "COLOR"

文本分成两种形式:作为整体的 "WHOLE" 以及局部标注的 "PARTS".

然后还可以采用一些数据增强的手段:"AUG"

这样,不同的图像-文本形式组合就代表了不同粒度的抽象理解能力。

3. 模型训练

一共有两种主要的实验设定:

PT: 仅使用预训练模型,不精调,以 zero-shot 的方式在 KILOGRAM 上测试;

FT: 使用预训练模型,并使用对比训练在 KILOGRAM 精调并测试。

在精调的基础上,还可以进行上文提到的数据增强(AUG)

4. 实验结果

仅仅看 zero-shot (i.e., PT)的表现,CLIP略优于ViLT;

添加局部信息并没有太大的作用,说明预训练模型并不能很好地推理文本和七巧板局部之间的关联;

WHOLE+BLACK 上的 zero-shot 的实验表现说明,预训练模型并不能很好地将熟悉的概念泛化到抽象的形状当中去(它知道现实世界中狗狗是什么样子的,但是并不能将七巧板抽象狗和真实狗狗联系在一起)

精调可以大幅改进性能;

在精调设定下,在文本描述中添加局部信息可以提升性能,但是在七巧板图像中添加局部信息并没有用;当两者都提供时,改善很明显。

在精调设定下的实验结果与人工评测结果规律相似;

数据增强只对 CLIP 有用,但对 ViLT 没用;

在PARTS+COLOR条件下,ViLT的表现明显优于人类的平均表现。

一点碎碎念

一点碎碎念

本篇工作中将传统的童年玩具“七巧板”的概念与多模态模型巧妙关联,用模型理解文本与七巧板图案局部、整体之间的关联,来评估模型的视觉抽象能力。七巧板作为童年益智启蒙玩具,是在人类在视觉认知上对图块与图案之间的分割、组合能力的体现,也正是本文开头提到的认知科学上智能过程中人类进行推理、泛化的底层能力。作为Best Paper,本篇论文无论是从数据集的构建还是实验设计来看,都是非常创新且具备很高的研究价值的工作,也对模型能力在人类智能上的评估有很强的指导意义。

卖萌屋作者:付奶茶

新媒体交叉学科在读Phd,卖萌屋十级粉丝修炼上任小编,目前深耕多模态,希望可以和大家一起认真科研,快乐生活!

作品推荐

1.在斯坦福,做 Manning 的 phd 要有多强?

2.史上最大多模态图文数据集发布!

3.MSRA-万字综述 直击多模态文档理解

4.ICLR’22 最佳脑洞奖提名:《GPT 如何进行布朗运动?》

5.大模型时代,我们真的不再需要分词了吗

6.Batch size 没必要设为2的次方!?

加入卖萌屋NLP、CV、搜推广与求职讨论群