机器学习Sklearn——红酒分类案例详解决策树模型参数

目录

1 分类树

1.1 红酒分类案例

1.1.1 导入包

1.1.2 观察、分割数据

1.1.3 三段论

2 参数介绍

2.1 重要参数

2.2 控制随机选项参数

2.3 剪枝参数

3 批量测试合适参数并画图

4 graphviz如何将dot文件转为png,pdf的方法

我们这里使用的是python库的sklearn机器学习库,这里面涵盖了几乎所有主流机器学习算法。之前的blog理论较多,实际案例做出来就行。参数讲解得不是很细,如今专门讲解sklearn,更细节些。

1 分类树

概念之前已经讲过了,在jupyter lab这个开发环境进行实验机器学习基础——分类算法之决策树、随机森林、Titanic乘客生存分类_chelsea_tongtong的博客-CSDN博客

我们直接上案例吧。

1.1 红酒分类案例

1.1.1 导入包

from sklearn import tree

from sklearn.datasets import load_wine

from sklearn.model_selection import train_test_split1.1.2 观察、分割数据

- 数据是字典,我们用pd.concat将其转换成列表

- 178行,13列,说明特征值有13个

- 目标值是有3个,说明分成3类

array(['class_0', 'class_1', 'class_2'], dtype='

wine=load_wine()

wine

import pandas as pd

pd.concat([pd.DataFrame(wine.data),pd.DataFrame(wine.target)],axis=1)

#CONCAT 函数 是用来将不同单元格里的文本等内容组合起来,但不会出现间隔符号的函数。

wine.feature_names

wine.targret_names1.1.3 三段论

- 三段论就是分类器建立、拟合模型、评估模型准确率

- 建立树之前要下载graphviz这个模块

- tree.export_graphviz()函数里面的参数filled是颜色,rouded是框框是圆还是方

clf = tree.DecisionTreeClassifier(criterion="entropy"

,max_depth=3

#,min_samples_leaf=11

#,min_samples_split=5)

clf = clf.fit(Xtrain,Ytrain)

feature_name = ['酒精','苹果酸','灰','灰的碱性','镁','总酚','类黄酮','非黄烷类酚类','花青素','颜色强度','色调','od280/od315稀释葡萄酒','脯氨酸']

import graphviz

dot_data=tree.export_graphviz(clf

,feature_names=feature_name

,class_names=["琴酒","雪莉","贝尔摩德"]

,filled=True

,rounded=True)

graph=graphviz.Source(dot_data)

graph

score = clf.score(Xtest,Ytest)

score- *zip(,)这一步是将每个特征和特征的贡献率以数据的形式结合起来

[*zip(feature_name,clf.feature_importances_)]

[('酒精', 0.0),

('苹果酸', 0.0),

('灰', 0.0),

('灰的碱性', 0.0),

('镁', 0.0),

('总酚', 0.0),

('类黄酮', 0.5132554807387111),

('非黄烷类酚类', 0.0),

('花青素', 0.023197838342593743),

('颜色强度', 0.31032151681648745),

('色调', 0.016620488684869157),

('od280/od315稀释葡萄酒', 0.0),

('脯氨酸', 0.1366046754173385)]

2 参数介绍

tree.DecisionTreeClassifier()其中这个就是建立模型的方法

2.1 重要参数

为了要将表格转化为一棵树,决策树需要找出最佳节点和最佳的分枝方法,对分类树来说,衡量这个“最佳”的指标叫做“不纯度”。通常来说,不纯度越低,决策树对训练集的拟合越好。现在使用的决策树算法在分枝方法上的核心大多是围绕在对某个不纯度相关指标的最优化上。不纯度基于节点来计算,树中的每个节点都会有一个不纯度,并且子节点的不纯度一定是低于父节点的,也就是说,在同一棵决策树上,叶子节点的不纯度一定是最低的。

Criterion这个参数正是用来决定不纯度的计算方法的。sklearn提供了两种选择:

1)输入”entropy“,使用信息熵(Entropy)

2)输入”gini“,使用基尼系数(Gini Impurity)

平常我们如何选择呢

1:通常就使用基尼系数

2:数据维度很大,噪音很大时使用基尼系数

3:维度低,数据比较清晰的时候,信息熵和基尼系数没区别

4:当决策树的拟合程度不够的时候,使用信息熵

简单粗暴就是,两个都试试,不好就换另外一个

2.2 控制随机选项参数

如果没有随机参数,准确率在每次运行的时候都会变化,可能变化的幅度比较大,影响模型评估,所以我们要控制随机参数。

- random_state用来设置分枝中的随机模式的参数,默认None,在高维度时随机性会表现更明显,低维度的数据(比如鸢尾花数据集),随机性几乎不会显现。输入任意整数,会一直长出同一棵树,让模型稳定下来。

- splitter也是用来控制决策树中的随机选项的,有两种输入值,输入”best",决策树在分枝时虽然随机,但是还是会优先选择更重要的特征进行分枝(重要性可以通过属性feature_importances_查看),输入“random",决策树在分枝时会更加随机,树会因为含有更多的不必要信息而更深更大,并因这些不必要信息而降低对训练集的拟合。这也是防止过拟合的一种方式。当你预测到你的模型会过拟合,用这两个参数来帮助你降低树建成之后过拟合的可能性。当然,树一旦建成,我们依然是使用剪枝参数来防止过拟合。

2.3 剪枝参数

当训练集准确率很高,但测试集准确率很低的时候我们需要剪枝,平常使用max_depth就可以,但是又新增加了两个参数,具体的数据我们需要通过计算准确率来不停实验。

- 剪枝参数max_depth。限制树的最大深度,超过设定深度的树枝全部剪掉这是用得最广泛的剪枝参数,在高维度低样本量时非常有效。决策树多生长一层,对样本量的需求会增加一倍,所以限制树深度能够有效地限制过拟合。在集成算法中也非常实用。实际使用时,建议从=3开始尝试,看看拟合的效果再决定是否增加设定深度。

- min_samples_leaf限定。一个节点在分枝后的每个子节点都必须包含至少min_samples_leaf个训练样本,否则分枝就不会发生,或者,分枝会朝着满足每个子节点都包min_samples_leaf个样本的方向去发生一般max_depth使用,在回归树中有神奇的效果,可以让模型变得更加平滑。这个参数的数量设置得太小会引起过拟合,设置得太大就会阻止模型学习数据。一般来说,建议从=5开始使用。如果叶节点中含有的样本量变化很大,建议输入浮点数作为样本量的百分比来使用。同时,这个参数可以保证每个叶子的最小尺寸,可以在回归问题中避免低方差,过拟合的叶子节点出现。对于类别不多的分类问题,=1通常就是最佳选择。

- min_samples_split限定。一个节点必须要包含至少min_samples_split个训练样本,这个节点才允许被分枝,否则分枝就不会发生。

clf = tree.DecisionTreeClassifier(criterion="entropy"

,max_depth=3

#,min_samples_leaf=11

#,min_samples_split=5)

clf = clf.fit(Xtrain,Ytrain)

#我们的树对测试集的拟合程度怎么样?

score = clf.score(Xtest,Ytest)

score3 批量测试合适参数并画图

import matplotlib.pyplot as plt

test = []

for i in range(10):

clf = tree.DecisionTreeClassifier(max_depth=i+1

,criterion="entropy"

,random_state=30

,splitter="random"

)

clf = clf.fit(Xtrain, Ytrain)

score = clf.score(Xtest, Ytest)

test.append(score)

plt.plot(range(1,11),test,color="red",label="max_depth")

plt.legend()

plt.show()

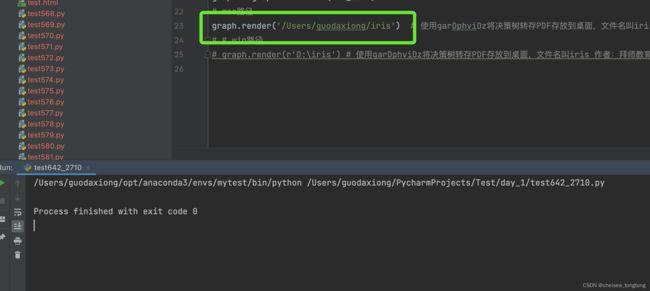

4 graphviz如何将dot文件转为png,pdf的方法

第一步:运行graphviz那个代码,搞到D盘里面有个iris文件夹里

第二步:通过cmd切换到你对应的运行目录下,然后执行命令

dot -Tpng dtc.dot -o dtc.png第三步:生成的png就在对应的目录下