Python 数据分析——教育平台的线上课程智能推荐策略

如何根据教育平台的线上用户信息和学习信息,通过数据分析为教育平台和用户 提供精准的课程推荐服务就成为线上教育的热点问题。

users.csv ( 用 户 信 息 表 )、 study_information.csv(学习详情表)和 login.csv(登录详情表),它们的数据说明 分别如表 1、表 2 和表 3 所示。

| 字段名 | 描述 |

| user_id | 用户 id |

| registration_time | 注册时间 |

| recently_logged | 最近访问时间 |

| learn_time | 学习时长(分) |

| number_of_classes_join | 加入班级数 |

| number_of_classes_out | 退出班级数 |

| school | 用户所属学校 |

| 字段名 | 描述 |

| user_id | 用户 id |

| course_id | 课程 id |

| course_join_time | 加入课程的时间 |

| learn_process | 学习进度 |

| price | 课程单价 |

| 字段名 | 描述 |

| user_id | 用户 id |

| login_time | 登录时间 |

| login_place | 登录地址 |

1 导入库与数据

import pandas as pd

import matplotlib.pyplot as plt

import numpy as np

#中文乱码与坐标轴负号处理

plt.rcParams['font.sans-serif'] = ['Microsoft Yahei']

plt.rcParams['axes.unicode_minus'] = False

Login = pd.read_csv('Login.csv') #登录详情表

study_information = pd.read_csv('study_information.csv') #学习详情表

users = pd.read_csv('users.csv') #用 户 信 息 表

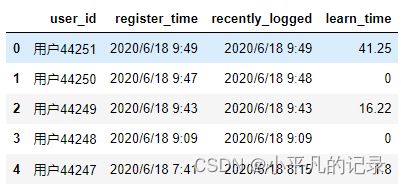

users1 = users[['user_id','register_time','recently_logged','learn_time']]1 任务一 数据预处理

1.1 任务1.1

对照附录 1,理解各字段的含义,进行缺失值、重复值等方面的必要处理,将处理结果保存“task1_1_X.csv”(如果包含多张数据表,X 可从 1 开始往后编号),并在报告中描述处理过程。

1.1.1 缺失值处理

——缺失率统计

Login.isnull().mean() # 登录详情表

study_information.isnull().mean() #学习详情表

users1.isnull().mean() #用户信息表user_id 0.0

login_time 0.0

login_place 0.0

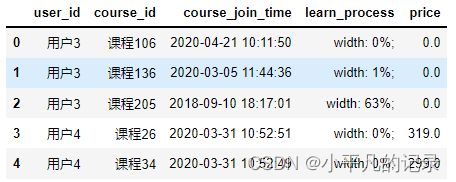

dtype: float64user_id 0.000000

course_id 0.000000

course_join_time 0.000000

learn_process 0.000000

price 0.021736

dtype: float64user_id 0.001523

register_time 0.000000

recently_logged 0.000000

learn_time 0.000000

dtype: float64删除price的缺失,认0为免费课程

study_information = study_information.dropna(subset=['price'])

study_information.head()数据缺失情况不明显,对user_id缺失进行删除

users1 = users.dropna(subset=['user_id'])

users1.head()1.1.2 异常值处理“--”

#excel表格处理

users1.to_csv('new_users1.csv')

new_users1 = pd.read_csv('new_users.csv')

new_users1.columns

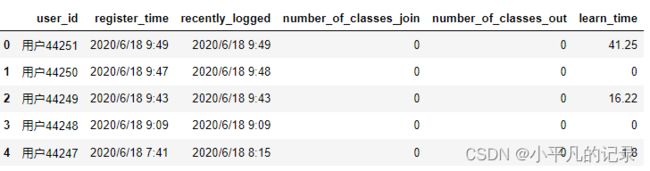

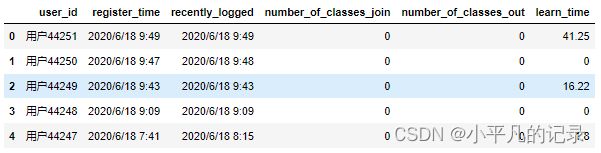

new_users = new_users1[[ 'user_id', 'register_time', 'recently_logged', 'number_of_classes_join','number_of_classes_out','learn_time']]

new_users.head()1.2 任务 1.2

1.2.1 重复值处理——每一行中完全相同的数据进行删除处理

print("Login表存在重复值:",any(Login.duplicated()))

print("study_information表存在重复值:",any(study_information.duplicated()))

print("users表存在重复值:",any(new_users.duplicated()))Login表存在重复值: False

study_information表存在重复值: False

users表存在重复值: Truenew_users.drop_duplicates(inplace=True)

new_users.head()2 任务二 平台用户活跃度分析

2.1 任务 2.1

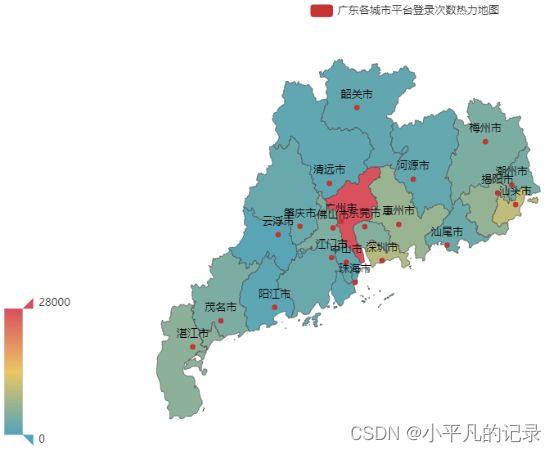

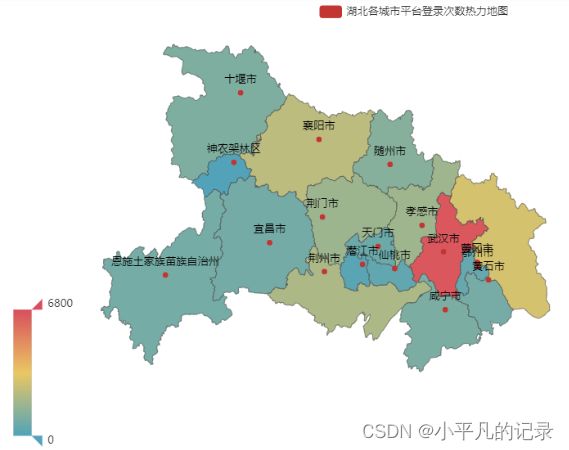

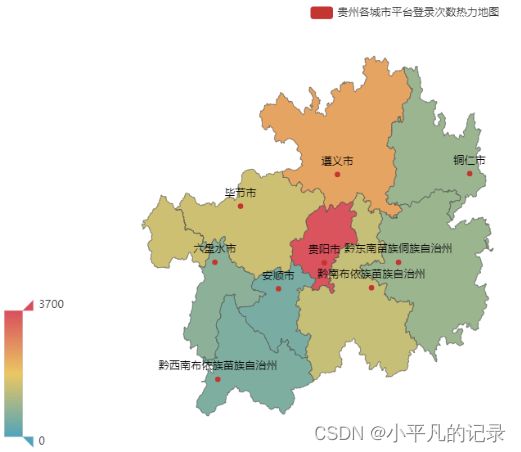

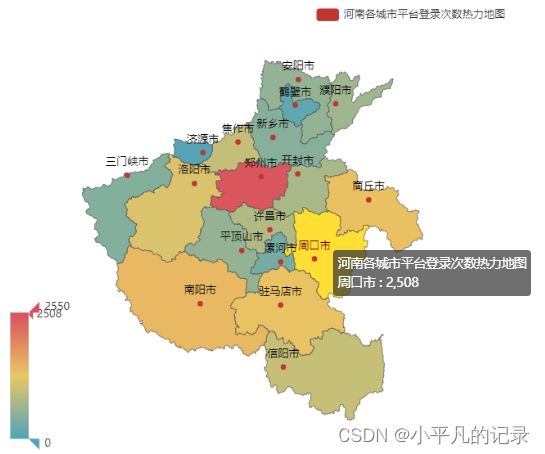

分别绘制各省份与各城市平台登录次数热力地图,并分析用户分布情况。

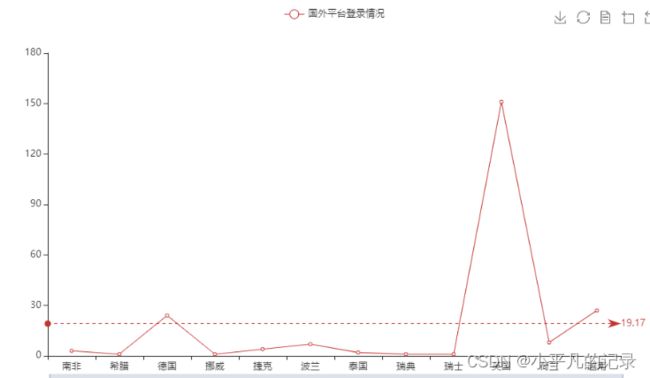

——国外

#各国登录统计

Login_he2 = Login_he.groupby(by='guobie',as_index=False).count()

#不包括中国

Login_he3 = Login_he2[~Login_he2['guobie'].isin(["中国"])]

Login_he3from pyecharts.charts import Line

from pyecharts import options as opts

x_data = list(Login_he3['guobie'])

#['South Africa','Greece','Germany','Norway','Czech Rep.','Poland','Thailand',

# 'Sweden','Switzerland','United Kingdom','Netherlands','Vietnam']

y_data = Login_he3['user_id']

# 特殊值标记

line = (Line()

.add_xaxis(x_data)

.add_yaxis("国外平台登录情况",y_data)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False),

markline_opts=opts.MarkLineOpts(

data=[

opts.MarkLineItem(type_="average", name="平均值")

]))

.set_global_opts(

#title_opts=opts.TitleOpts(title="国内平台登录次数", subtitle="副标题"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

)

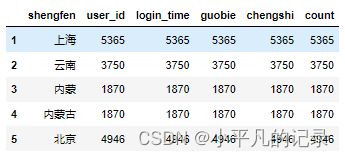

line.render_notebook()——国内

:提取省市名

Login['guobie'] = Login['login_place'].apply(lambda x:x[0:2]).tolist()

Login.head(5)Login_nei = Login.loc[Login['login_place'].str.contains("内蒙古")]

Login_nei['shengfen'] = Login_nei['login_place'].apply(lambda x:x[2:5]).tolist()

Login_nei['chengshi'] = Login_nei['login_place'].apply(lambda x:x[5:]).tolist()

Login_nei.head()Login_hei = Login.loc[Login['login_place'].str.contains("黑龙江")]

Login_hei['shengfen'] = Login_hei['login_place'].apply(lambda x:x[2:5]).tolist()

Login_hei['chengshi'] = Login_hei['login_place'].apply(lambda x:x[5:]).tolist()

Login_hei.head()#不包括内蒙古、黑龙江

Login2 = Login[~Login['login_place'].isin(["内蒙古",'黑龙江'])]

Login2['shengfen'] = Login2['login_place'].apply(lambda x:x[2:4]).tolist()

Login2['chengshi'] = Login2['login_place'].apply(lambda x:x[4:]).tolist()

Login2.head(5)Login_he1 = Login_nei.append(Login2)

Login_he2 = Login_he1.append(Login_hei)

Login_he = Login_he2[['user_id','login_time','guobie','shengfen','chengshi']]

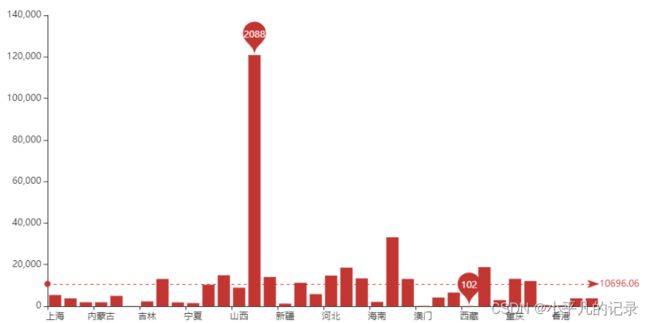

Login_he.head()2.1.1 各省份平台登录次数热力地图

#不包括国外

Login_china = Login_he[Login_he['guobie'].isin(["中国"])]

Login_china2 = Login_china.groupby(by='shengfen',as_index=False).count()

Login_china3 = Login_china2.iloc[1:,]

Login_china3['count'] = Login_china3['user_id']

Login_china3.head()type(y_data.values)numpy.ndarray——全国省份用户登录人数分布

from pyecharts.charts import Line

from pyecharts import options as opts

x_data = list(Login_he3['guobie'])

#['South Africa','Greece','Germany','Norway','Czech Rep.','Poland','Thailand',

# 'Sweden','Switzerland','United Kingdom','Netherlands','Vietnam']

y_data = Login_he3['user_id']

# 特殊值标记

line = (Line()

.add_xaxis(x_data)

.add_yaxis("国外平台登录情况",y_data)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False),

markline_opts=opts.MarkLineOpts(

data=[

opts.MarkLineItem(type_="average", name="平均值")

]))

.set_global_opts(

#title_opts=opts.TitleOpts(title="国内平台登录次数", subtitle="副标题"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

)

line.render_notebook()——省份用户分布情况分析——基于热力图

from pyecharts.charts import Map

province = ['北京市','天津市','河北省','山西省','内蒙古自治区','辽宁省','吉林省','黑龙江省',

'上海市','江苏省','浙江省','安徽省','福建省','江西省','山东省','河南省','湖北省','湖南省',

'广东省','广西壮族自治区','海南省','重庆市','四川省','贵州省','云南省','陕西省','甘肃省',

'青海省','宁夏回族自治区','新疆维吾尔自治区']

values = list(Login_china3['count'])

data = [[province[i],values[i]] for i in range(len(province))]

map = (

Map()

.add("中国各省平台登录次数",data,'china')

)

map.set_global_opts(

visualmap_opts=opts.VisualMapOpts(max_=125000), # 最大数据范围

toolbox_opts=opts.ToolboxOpts() # 工具箱

)

map.render_notebook()

2.1.2 各城市平台登录次数热力地图

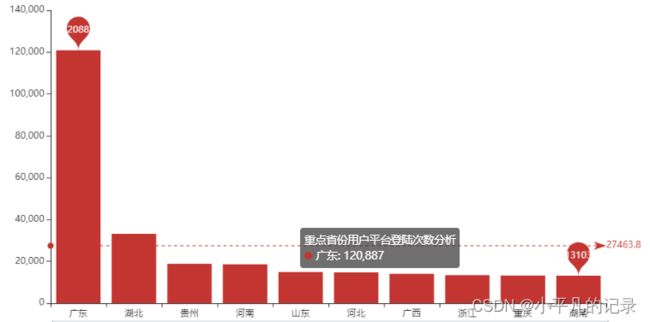

——重点省份用户平台登陆次数分析

#重点省份用户平台登陆次数分析

Login_china4 = Login_china3.sort_values(by='count',ascending=False)

Login_china5 = Login_china4.iloc[0:10,:]

x_data = list(Login_china5['shengfen'])

y_data = list(Login_china5['count'])

bar = (Bar()

.add_xaxis(x_data)

.add_yaxis('重点省份用户平台登陆次数分析', y_data)

.set_series_opts(

markpoint_opts=opts.MarkPointOpts(

data=[

opts.MarkPointItem(type_="max", name="最大值"),

opts.MarkPointItem(type_="min", name="最小值"),

]))

.set_global_opts(

title_opts=opts.TitleOpts(title="国内平台登录次数", subtitle="副标题"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False),

markline_opts=opts.MarkLineOpts(

data=[

opts.MarkLineItem(type_="average", name="平均值")

]))

)

bar.render_notebook()——重点省份用户分布情况分析

#广东

Login_guangdong1 = Login_he[Login_he['shengfen'].isin(["广东"])]

Login_guangdong2 = Login_guangdong1.groupby(by='chengshi',as_index=False).count()

Login_guangdong = Login_guangdong2.iloc[1:,]

Login_guangdong["new_chengshi"] = Login_guangdong['chengshi']+'市'

x_data = list(Login_guangdong['user_id'])

y_data = list(Login_guangdong['new_chengshi'])

data = [[y_data[i],x_data[i]] for i in range(len(y_data))]

map = (

Map()

.add("广东各城市平台登录次数热力地图",data,'广东')

)

map.set_global_opts(

visualmap_opts=opts.VisualMapOpts(max_=28000), #最大数据范围

toolbox_opts=opts.ToolboxOpts() # 工具箱

)

map.render_notebook()#湖北

Login_hubei1 = Login_he[Login_he['shengfen'].isin(["湖北"])]

Login_hubei2 = Login_hubei1.groupby(by='chengshi',as_index=False).count()

Login_hubei = Login_hubei2.iloc[1:,]

Login_hubei["new_chengshi"] = Login_hubei['chengshi']+'市'

Login_hubei.loc[Login_hubei['new_chengshi']== '恩施土家族苗族自治州市','new_chengshi']= '恩施土家族苗族自治州'

Login_hubei.loc[Login_hubei['new_chengshi']== '神农架林区市','new_chengshi']= '神农架林区'

x_data = list(Login_hubei['user_id'])

y_data = list(Login_hubei['new_chengshi'])

data = [[y_data[i],x_data[i]] for i in range(len(y_data))]

map = (

Map()

.add("湖北各城市平台登录次数热力地图",data,'湖北')

)

map.set_global_opts(

visualmap_opts=opts.VisualMapOpts(max_=6800), #最大数据范围

toolbox_opts=opts.ToolboxOpts() # 工具箱

)

map.render_notebook()#贵州

Login_guizhou1 = Login_he[Login_he['shengfen'].isin(["贵州"])]

Login_guizhou2 = Login_guizhou1.groupby(by='chengshi',as_index=False).count()

Login_guizhou = Login_guizhou2.iloc[1:,]

Login_guizhou["new_chengshi"] = Login_guizhou['chengshi']+'市'

Login_guizhou.loc[Login_guizhou['new_chengshi']== '黔东南苗族侗族自治州市','new_chengshi']= '黔东南苗族侗族自治州'

Login_guizhou.loc[Login_guizhou['new_chengshi']== '黔南布依族苗族自治州市','new_chengshi']= '黔南布依族苗族自治州'

Login_guizhou.loc[Login_guizhou['new_chengshi']== '黔西南布依族苗族自治州市','new_chengshi']= '黔西南布依族苗族自治州'

x_data = list(Login_guizhou['user_id'])

y_data = list(Login_guizhou['new_chengshi'])

data = [[y_data[i],x_data[i]] for i in range(len(y_data))]

map = (

Map()

.add("贵州各城市平台登录次数热力地图",data,'贵州')

)

map.set_global_opts(

visualmap_opts=opts.VisualMapOpts(max_=3700), #最大数据范围

toolbox_opts=opts.ToolboxOpts() # 工具箱

)

map.render_notebook()#河南

Login_henan1 = Login_he[Login_he['shengfen'].isin(["河南"])]

Login_henan2 = Login_henan1.groupby(by='chengshi',as_index=False).count()

Login_henan = Login_henan2.iloc[1:,]

Login_henan["new_chengshi"] = Login_henan['chengshi']+'市'

x_data = list(Login_henan['user_id'])

y_data = list(Login_henan['new_chengshi'])

data = [[y_data[i],x_data[i]] for i in range(len(y_data))]

map = (

Map()

.add("河南各城市平台登录次数热力地图",data,'河南')

)

map.set_global_opts(

visualmap_opts=opts.VisualMapOpts(max_=2550), #最大数据范围

toolbox_opts=opts.ToolboxOpts() # 工具箱

)

map.render_notebook()2.2 任务 2.2

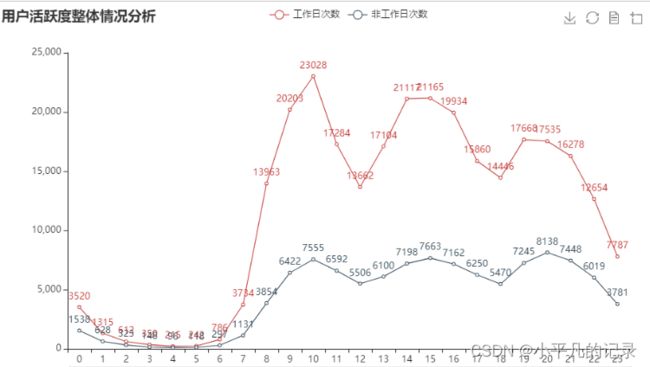

分别绘制工作日与非工作日各时段的用户登录次数柱状图,并分析用户活跃的主要时间段。

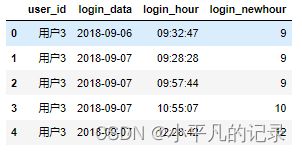

#将日期与时间分割

Login1 = Login["login_time"].str.split(" ",expand=True).fillna("")

Login1['login_data'] = Login1[0]

Login1['login_hour'] = Login1[1]

Login1['user_id'] = Login['user_id']

Login2 = Login1[['user_id','login_data','login_hour']]

Login2.head()2.2.1 工作日分析

import datetime

import chinese_calendar

start_time = datetime.datetime(2018, 9, 6)

end_time = datetime.datetime(2020, 6, 18)

#获取工作日时期

a = chinese_calendar.get_workdays(start_time,end_time)

#chinese_calendar.get_holidays(start_time,end_time)

#转换为日期列表

date_string = [d.strftime('%Y-%m-%d') for d in a]

#筛选工作日所含数据

Login3 = Login2[Login2['login_data'].isin(date_string)]

#将小时取整

x = Login3['login_hour']

Login3['login_newhour'] = Login3['login_hour'].apply(lambda x: int(x[0:2]))

Login3.head()gongzuori = Login3.groupby(by=Login3['login_newhour'],as_index=False)['user_id'].count()

gongzuori['gongzuori'] = gongzuori['user_id']

gongzuori = gongzuori[['login_newhour','gongzuori']]

gongzuori.head()2.2.2 非工作日分析

import datetime

import chinese_calendar

start_time = datetime.datetime(2018, 9, 6)

end_time = datetime.datetime(2020, 6, 18)

#获取工作日时期

a = chinese_calendar.get_holidays(start_time,end_time)

#chinese_calendar.get_holidays(start_time,end_time)

#转换为日期列表

date_string = [d.strftime('%Y-%m-%d') for d in a]

#筛选工作日所含数据

Login4 = Login2[Login2['login_data'].isin(date_string)]

#将小时取整

x = Login4['login_hour']

Login4['login_newhour'] = Login4['login_hour'].apply(lambda x: int(x[0:2]))

Login4.head()holidays = Login4.groupby(by=Login4['login_newhour'],as_index=False)['user_id'].count()

holidays['holidays'] = holidays['user_id']

holidays = holidays[['login_newhour','holidays']]

holidays.head()from pyecharts.charts import Line

attr = list(gongzuori['login_newhour'])

v1 = list(gongzuori['gongzuori'])

v2 = list(holidays['holidays'])

line = (Line()

.add_xaxis(attr)

.add_yaxis('工作日次数', v1)

.add_yaxis('非工作日次数',v2)

.set_global_opts(

title_opts=opts.TitleOpts(title="用户活跃度整体情况分析"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

)

line.render_notebook()2.3 任务 2.3

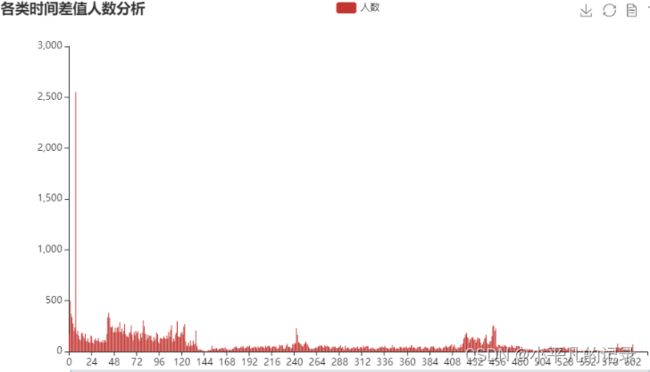

记end为数据观察窗口截止时间(如:赛题数据的采集截止时间为2020 年 6 月 18 日),为用户 i 的最近访问时间, = end − ,若 > 90天,则称用户 i 为流失用户。根据该定义计算平台用户的流失率。

2.3.1 用户总体情况分析

Tend = pd.date_range('20200618235959',periods=1)

new_users.drop_duplicates(inplace=True)

new_users['Tend'] = list(Tend)*43909

new_users['longtime'] = (pd.to_datetime(new_users['Tend']) - pd.to_datetime(new_users['recently_logged'])).map(lambda x:x.days)

#new_users['longtime'] = new_users['longtime'].astype(str)

new_users3 = new_users.dropna()

#new_users['longtime'].str.split("",expand=True).fillna("")

new_users3.head()new_users3['longtime'].describe()count 43717.000000

mean 190.146259

std 170.868948

min 0.000000

25% 49.000000

50% 115.000000

75% 343.000000

max 646.000000

Name: longtime, dtype: float64new_users4 = new_users3.groupby(by='longtime',as_index=False).count()

x_data = list(new_users4['longtime'])

y_data = list(new_users4['user_id'])

bar = (Bar()

.add_xaxis(x_data)

.add_yaxis('人数', y_data)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False))

.set_global_opts(

title_opts=opts.TitleOpts(title="各类时间差值人数分析"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

)

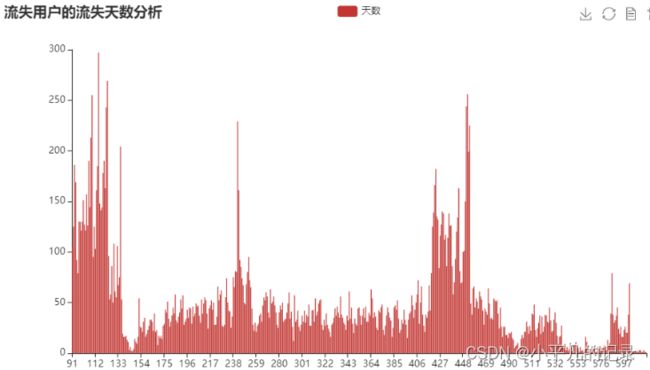

bar.render_notebook()2.3.2 流失天数及流失率分析

new_users5 = new_users3[new_users3['longtime'] >90]

new_users6 = new_users5.groupby(by='longtime',as_index=False).count()

x_data = list(new_users6['longtime'])

y_data = list(new_users6['user_id'])

bar = (Bar()

.add_xaxis(x_data)

.add_yaxis('天数', y_data)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False))

.set_global_opts(

title_opts=opts.TitleOpts(title="流失用户的流失天数分析"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

)

bar.render_notebook()

print('流失率:',new_users5['longtime'].count()/43717)

print('流失人数:',new_users5['longtime'].count())流失率: 0.5796143376718439

流失人数: 253392.3.3 未流失客户流失风险等级分类分析

潜水用户:小于 90 天且大于 60 天

活跃用户:小于 60 天

高活跃用户:小于 30 天

低活跃用户:小于 60 天且大于 30 天

qianshui = new_users3[(new_users3.longtime > 60) & (new_users3.longtime < 90)]['longtime'].count()

print('潜水用户:',qianshui)

print('潜水用户占比:',qianshui/(43717-25339))

gao_huoyue = new_users3[new_users3.longtime < 30]['longtime'].count()

print('高活跃用户:',gao_huoyue)

print('高活跃用户占比:',gao_huoyue/(43717-25339))

di_huoyue = new_users3[(new_users3.longtime > 30) & (new_users3.longtime < 60)]['longtime'].count()

print('低活跃用户:',di_huoyue)

print('低活跃用户占比:',di_huoyue/(43717-25339))潜水用户: 4796

潜水用户占比: 0.260964196321689

高活跃用户: 7516

高活跃用户占比: 0.40896724344324736

低活跃用户: 5647

低活跃用户占比: 0.30726956143214712.4 任务 2.4

根据任务 2.1 至任务 2.3,分析平台用户的活跃度,为该教育平台 的线上管理决策提供建议。

3 任务 3 线上课程推荐

3.1 任务 3.1

根据用户参与学习的记录,统计每门课程的参与人数,计算每门课程的受欢迎程度,列出最受欢迎的前 10 门课程,并绘制相应的柱图。

study_information1= study_information.groupby(by='course_id',as_index=False)['user_id'].count()

study_information1['num'] = study_information1['user_id']

study_information2 = study_information1[['course_id','num']]

study_information2.head()3.1.1 选课人数分析

study_information2['num'].sum()190736num1 = study_information2[(study_information2.num > 10000)]['num'].sum()

print('选课人数10000以上:',num1)

print('选课人数占比:',num1/190736)

num2 = study_information2[(study_information2.num > 5000) & (study_information2.num < 10000)]['num'].sum()

print('选课人数5000-10000:',num2)

print('选课人数占比:',num2/190736)

num3 = study_information2[(study_information2.num > 1000) & (study_information2.num < 5000)]['num'].sum()

print('选课人数1000-5000:',num3)

print('选课人数占比:',num3/190736)

num4 = study_information2[(study_information2.num > 500) & (study_information2.num < 1000)]['num'].sum()

print('选课人数500-1000:',num4)

print('选课人数占比:',num4/190736)

num5 = study_information2[(study_information2.num > 100) & (study_information2.num < 500)]['num'].sum()

print('选课人数100-500:',num5)

print('选课人数占比:',num5/190736)

num6 = study_information2[(study_information2.num < 100)]['num'].sum()

print('选课人数100以下:',num6)

print('选课人数占比:',num6/190736)选课人数10000以上: 13265

选课人数占比: 0.06954638872577804

选课人数5000-10000: 53968

选课人数占比: 0.2829460615720158

选课人数1000-5000: 89075

选课人数占比: 0.4670067527891955

选课人数500-1000: 13057

选课人数占比: 0.06845587618488382

选课人数100-500: 18819

选课人数占比: 0.09866517070715544

选课人数100以下: 2552

选课人数占比: 0.013379750020971396from pyecharts.charts import Pie

x_data = ["选课人数10000以上", "选课人数5000-10000", "选课人数1000-5000", "选课人数500-1000", "选课人数100-500","选课人数100以下"]

y_data = [13265, 53968, 89075, 13057, 18819,2552]

c = (

Pie()

.add("", [list(z) for z in zip(x_data, y_data)],radius=["30%", "70%"]) # zip函数两个部分组合在一起list(zip(x,y))-----> [(x,y)]

.set_global_opts(

title_opts=opts.TitleOpts(title="课程参与人数分析"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

legend_opts=opts.LegendOpts(orient="vertical", pos_top="10%", pos_left="80%")) #图例设置

.set_series_opts(label_opts=opts.LabelOpts(formatter="{b}: {c}")) # 数据标签设置

)

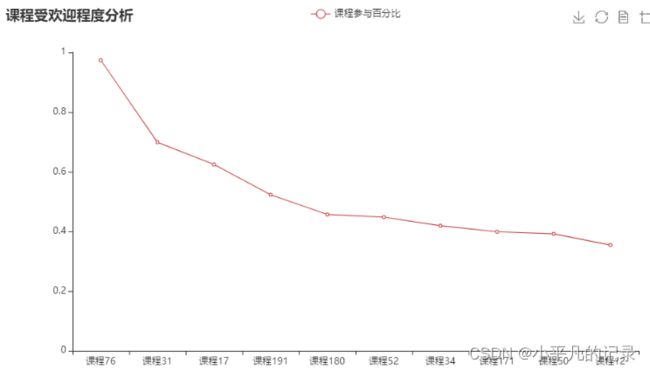

c.render_notebook()3.1.2 课程受欢迎程度分析

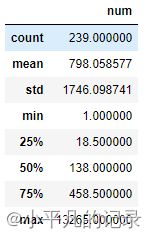

study_information2.describe()

study_information2['y'] = (study_information2['num']-1)/13624

study_information2 = study_information2.sort_values(by='y',ascending=False)

study_information3 = study_information2.iloc[0:10,:]

study_information3 x_data = list(study_information3['course_id'])

y_data_line = list(study_information3['y'])

line = (Line()

.add_xaxis(x_data)

.add_yaxis('课程参与百分比', y_data_line)

.set_global_opts(

title_opts=opts.TitleOpts(title="课程受欢迎程度分析"), # 标题

toolbox_opts=opts.ToolboxOpts() # 工具箱

)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False))

)

line.render_notebook()x_data = list(study_information3['course_id'])

y_data_line = list(round(study_information3['y'],2))

c = (

Pie()

.add("", [list(z) for z in zip(x_data, y_data_line)],

center=['45%', '55%'],radius=["25%", "70%"],rosetype="area") # zip函数两个部分组合在一起list(zip(x,y))-----> [(x,y)]

.set_global_opts(

title_opts=opts.TitleOpts(title="课程受欢迎程度分析"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

legend_opts=opts.LegendOpts(orient="vertical", pos_top="10%", pos_left="80%")) #图例设置

.set_series_opts(label_opts=opts.LabelOpts(formatter="{b}:{c}")) # 数据标签设置

)

c.render_notebook()3.2 任务 3.2

根据用户选择课程情况,构建用户和课程的关系表(二元矩阵),使用基于物品的协同过滤算法计算课程之间的相似度,并结合用户已选课程的记录,为总学习进度最高的 5 名用户推荐 3 门课程。

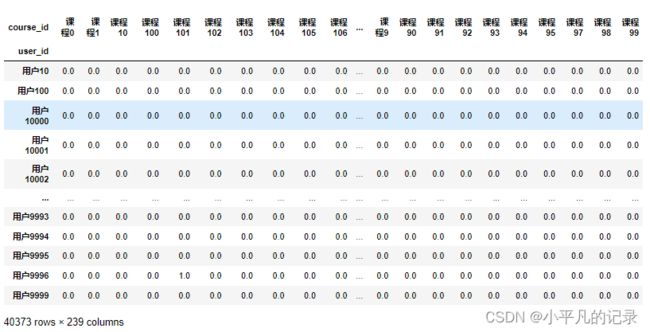

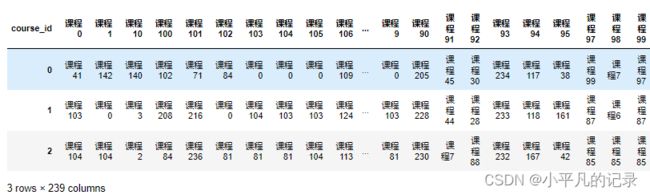

3.2.1 构建用户和课程的关系表(二元矩阵)

若用户选择了相关课程,则对应显示为 1;反之,若用户没有选择该课程,则对应显示为 0。

study_information['num'] =1

study_information4 = study_information[['user_id','course_id','num']]

study_information5 = study_information4.pivot(index='user_id',columns='course_id',values='num').fillna(0)

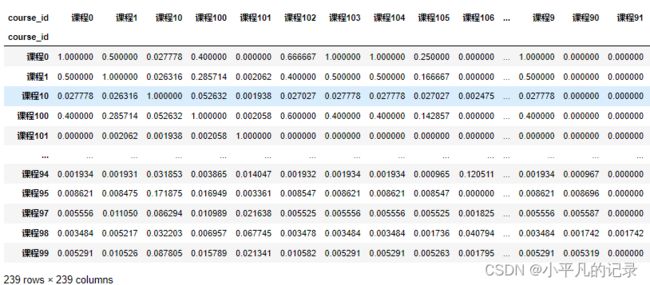

study_information53.2.2 物品的协同过滤算法

基于物品的协同过滤算法就是给用户推荐那些和他们之前喜欢的物品相似的物品。在计算邻居时采用物品本身,是基于用户对物品的偏好找到相似的物品,然后根据用户的历史偏好,推荐相似的物品给用户。从计算的角度看,就是将所有用户对某个物品的偏好作为一个向量来计算物品之间的相似度,得到物品的相似物品后,根据用户历史的偏好预测当前用户还没有表示偏好的物品,计算得到 一个排序的物品列表作为推荐。如下图所示,对于物品 A,根据所有用户的历史 偏好,喜欢物品 A 的用户都喜欢物品 C,得出物品 A 和物品 C 比较相似,而 用户 C 喜欢物品 A,那么可以推断出用户 C 可能也喜欢物品C 。

from sklearn.metrics import jaccard_score

items = study_information5.columns

from sklearn.metrics.pairwise import pairwise_distances

# 计算课程间相似度

course_similar = 1 - pairwise_distances(study_information5.T.values,metric="jaccard")

course_similar = pd.DataFrame(course_similar, columns=items, index=items)

course_similartopN_items = {}

# 遍历每一行数据

for i in course_similar.index:

# 取出每一列数据,并删除自身,然后排序数据

_df = course_similar.loc[i].drop([i])

_df_sorted = _df.sort_values(ascending=False)

top2 = list(_df_sorted.index[:3])

topN_items[i] = top2

topN_items = pd.DataFrame(topN_items,columns=items)

topN_itemsrs_results = {}

# 构建推荐结果

for user in study_information5.index: # 遍历所有用户

rs_result = set()

for item in study_information5.loc[user].replace(0,np.nan).dropna().index: # 取出每个用户当前已购物品列表

# 根据每个物品找出最相似的TOP-N物品,构建初始推荐结果

rs_result = rs_result.union(topN_items[item])

# 过滤掉用户已购的物品

rs_result = list(study_information5.loc[user].replace(0,np.nan).dropna().index)

# 添加到结果中

rs_results[user] = rs_result

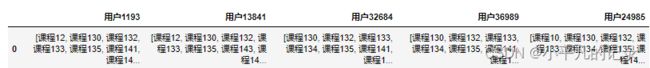

rs_results1 = pd.DataFrame.from_dict([rs_results])

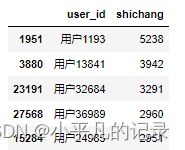

rs_results13.2.3 为总学习进度最高的 5 名用户推荐 3 门课程

study_information['shichang'] = study_information['learn_process'].str.replace(r'[^0-9]', '')

study_information['shichang'] = pd.to_numeric(study_information['shichang'],errors='coerce')

study_information.head()#study_information1 = study_information.groupby(by='user_id',as_index=False)['shichang'].mean()

study_information6 = study_information.groupby(by='user_id',as_index=False)['shichang'].sum()

study_information7 = study_information6.sort_values(by='shichang',ascending=False)

study_information7.head(5)user_tuijian = rs_results1[['用户1193','用户13841','用户32684','用户36989','用户24985']]

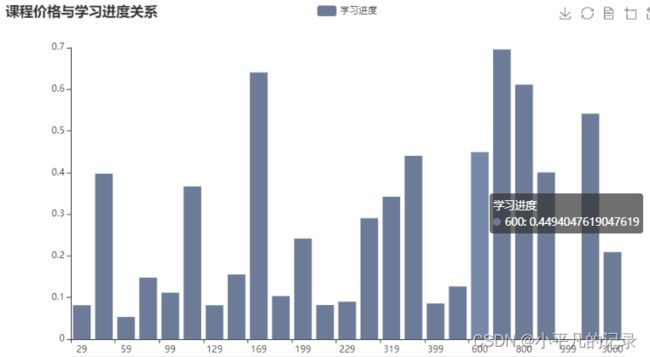

user_tuijian3.3 任务 3.3

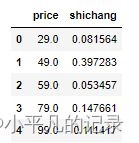

在任务 3.1 和任务 3.2 的基础上,结合用户学习进度数据,分析付费课程和免费课程的差异,给出线上课程的综合推荐策略。

study_information_shichang = study_information.groupby(by='course_id',as_index=False)['shichang'].mean()

study_information_shichang['shichang'] = study_information_shichang['shichang']/100

study_information_price = study_information.groupby(by='course_id',as_index=False)['price'].mean()

study_information_price2 = study_information_price.sort_values(by='price',ascending=True)

study_information_price2 = study_information_price2[study_information_price2['price']>0]

result = pd.merge(study_information_price2, study_information_shichang,on='course_id')

result = result.groupby(by='price',as_index=False)['shichang'].mean()

result.head()from pyecharts.globals import ThemeType

x_data = list(result['price'])

y_data = list(result['shichang'])

bar = (Bar()

#init_opts=opts.InitOpts(theme=ThemeType.VINTAGE)) # 设置主题

.add_xaxis(x_data)

.add_yaxis('学习进度', y_data)

.set_colors(["#6C7C98"]) # 柱子的颜色

#.reversal_axis() # xy轴交换

.set_global_opts(

title_opts=opts.TitleOpts(title="课程价格与学习进度关系"), # 标题

toolbox_opts=opts.ToolboxOpts(), # 工具箱

datazoom_opts=opts.DataZoomOpts(range_start=0,range_end=100) # 横轴缩放

)

.set_series_opts(

# 为了不影响标记点,这里把标签关掉

label_opts=opts.LabelOpts(is_show=False))

)

bar.render_notebook()