多模态文本分类技术

多模态文本分类技术

- 多模态简介

-

- 什么是多模态

- 多模态的技术点

-

- 多模态表示学习Representation

- 模态转化Translation

- 模态对齐Alignment

- 多模态融合Fusion

- 协同学习Co-learning

- 多模态在文本分类的应用

-

- 讽刺检测

- 情感分类

- 情感分析

- 假新闻识别

- 商品分类

写在前面:仅用于记录自己学习

观看的视频

摘抄的笔记

一篇多模态综述

多模态简介

什么是多模态

Multimodal Machine Learning(MMML),旨在用机器学习的方法实现处理和理解多模态信息的能力。比如:图像、音频、视频、语义之间的多模态学习。

模态:每一种信息来源或者形式,都可以称之为一种模态。

多模态的技术点

多模态表示学习Representation

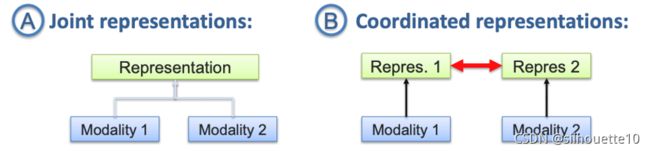

联合表示

将多个模态的信息一起映射到一个统一的多模态向量空间。

论文:Multimodal learning with deep boltzmann machines, NIPS 2014 信息检索领域。

协同表示

将多模态中的每个模态分别映射到各自的表示空间,但映射后的向量之间满足一定的相关性约束,比如线性相关等。

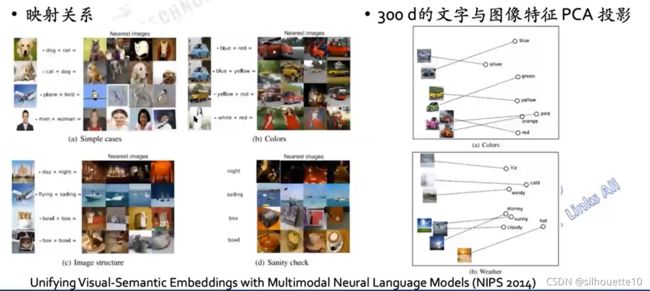

论文:Unifying Visual-Semantic Embeddings with Multimodal Neural Language Models (NIPS 2014)

协同学习的向量满足一定的约束关系,比如上图的加减关系。如:狗的图片特征向量-狗的文本向量+猫的文本向量=猫的图片向量。(根据最近邻距离检索猫的图片)

表示学习难点

如何处理不同级别的噪音(文字是字符级的,图片是三维RGB的等…)以及如何处理缺失数据的问题。

模态转化Translation

多模态转化也可称为映射 (Mapping),主要是将一个模态的信息转化或映射为另一个模态的信息。

应用:

机器翻译(Machine Translation) 、唇读(Lip Reading)和语音翻译 (Speech Translation)

图片描述 (Image Captioning)与视频描述(Video Captioning)

语音合成(Speech Synthesis)

难点:

未知结束位(比如:同声翻译的时候不知道什么时候结束)以及主观判断性(每个人对图片描述都不相同,损失函数的定义主观)

模态对齐Alignment

从来自同一个实例的两个甚至多个模态中寻找子成份之间的关系和联系。

研究方向:

显式对齐:无监督或弱监督的方式

隐式对齐:图模型(图神经网络)

难点:

若是无监督,需要大量数据;建模的时候,模态之间的相似度评判距离标准如何定义;并不是其中一个模态中的元素我都能在另一个模态中找到一个元素与其对应。

相关任务:

给定一张图片和图片的描述,找到图中的某个区域以及这个区域在描述中对应的表述;

图像语义分割(Image Semantic Segmentation)

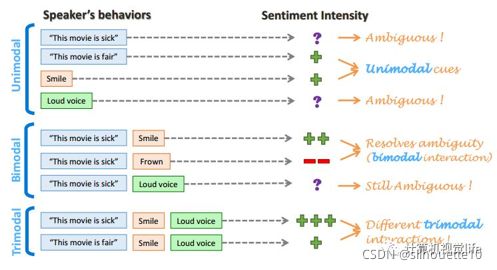

多模态融合Fusion

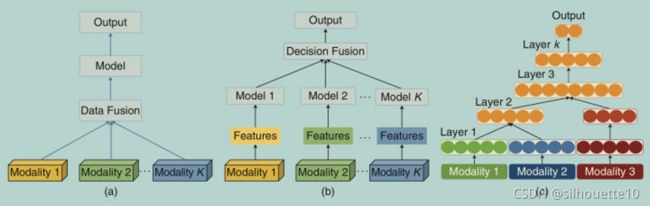

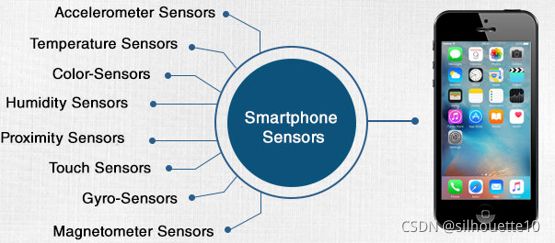

联合多个模态的信息,进行目标预测(分类或者回归),属于 MMML 最早的研究方向之一,也是目前应用最广的方向,它还存在其他常见的别名,例如多源信息融合(Multi-source Information Fusion)、多传感器融合(Multi-sensor Fusion)。

分类:

Pixel level

Feature level

Decision level

按照融合的类型分类:

数据级别融合

判定级别融合

组合融合

相关任务:

视觉-音频识别(Visual-Audio Recognition)

多模态情感分析(Multimodal sentiment analysis)

手机身份认证(Mobile Identity Authentication)(比较成熟)

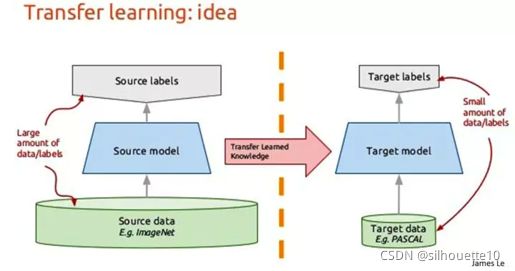

协同学习Co-learning

通过利用资源丰富(比如数据量大)的模态的知识来辅助资源稀缺(比如较小数据)的模态建立模型。

根据数据形式划分:

Parallel(数据并行): Co-training, Transfer learning(预训练模型)

Non-parallel(数据不并行): Transfer learning, Concept grounding, Zero-shot learning

Hybrid: Bridging

多模态在文本分类的应用

讽刺检测

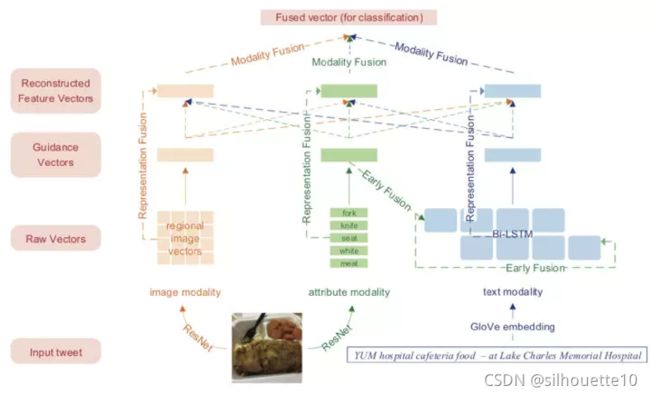

1、Multi-Modal Sarcasm Detection in Twitter with Hierarchical Fusion Model. ACL 2019

论文来源:ACL 2019

论文链接:https://www.aclweb.org/anthology/P19-1239/

关键词:情感分析;图文;反讽刺识别

论文解读:https://www.pianshen.com/article/35901009638/

2、Towards Multimodal Sarcasm Detection (An Obviously Perfect Paper)

论文来源:ACL 2019

论文链接:https://arxiv.org/pdf/1906.01815v1.pdf

github地址:https://github.com/soujanyaporia/MUStARD

关键词:反讽刺识别

论文解读:https://zhuanlan.zhihu.com/p/93626115

情感分类

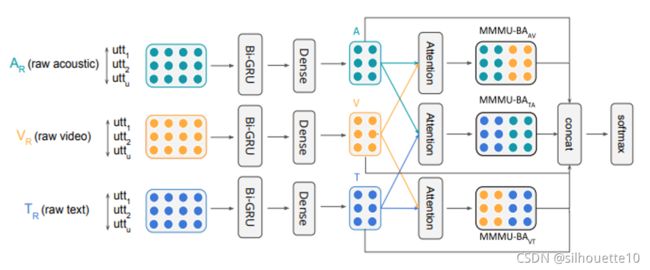

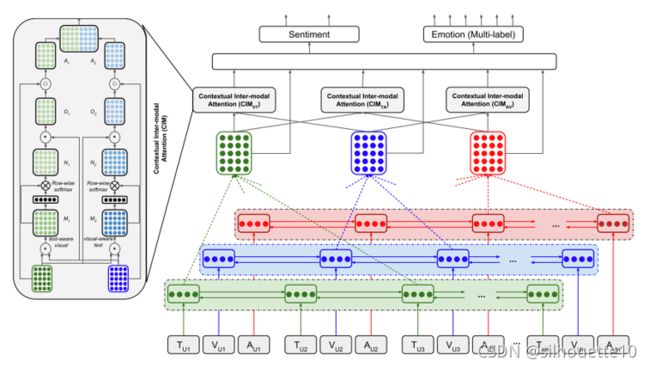

Contextual Inter-modal Attention for Multi-modal Sentiment Analysis. ACL 2018

github地址:https://github.com/soujanyaporia/contextual-multimodal-fusion

链接:https://pan.baidu.com/s/1bNsgWInUlG2-M88PSXGcPQ

提取码:uk6m

论文解读https://blog.csdn.net/ningmengshuxiawo/article/details/109141253

情感分析

Multi-task Learning for Multi-modal Emotion Recognition and Sentiment Analysis. NAACL 2019

论文解析https://www.cnblogs.com/taaccoo/p/13662595.html

假新闻识别

1、Exploiting Multi-domain Visual Information for Fake News Detection. ICDM 2019

论文来源:ICDM 2019

论文链接:https://arxiv.org/abs/1908.04472

关键词:假新闻检测;图像;频域;像素域;CNN;RNN;attention

论文解读:https://www.pianshen.com/article/19361581000/

2、EANN: Event Adversarial Neural Networks for Multi-Modal Fake News Detection. KDD 2018

论文来源:KDD 2018

论文链接:https://doi.org/10.1145/3219819.3219903

代码链接:https://github.com/yaqingwang/EANN-KDD18

关键词:多模态(图像+文本);对抗神经网络;假新闻检测

论文解读:https://www.pianshen.com/article/57871580780/

商品分类

Is a Picture Worth a Thousand Words? A Deep Multi-Modal Architecture for Product Classification in E-Commerce. AAAI 2018.