深度学习——长短期记忆网络LSTM(笔记)

长短期记忆网络LSTM:

①隐变量模型存在长期信息保存和短期输入缺失问题,解决方法是LSTM

②发明于90年代

③使用效果和GRU差别不大,但是实现起来复杂

1.长短期记忆网络

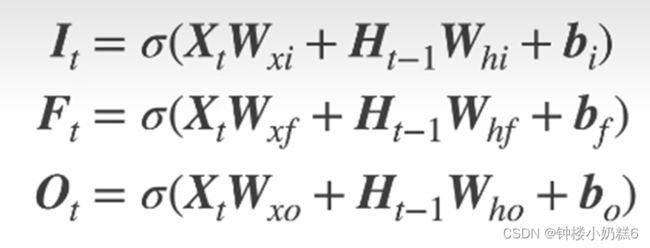

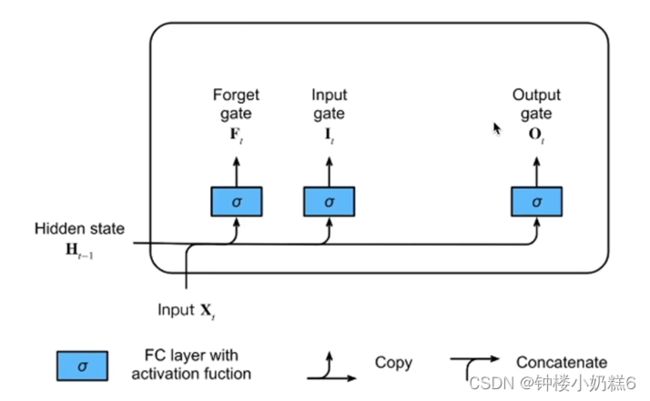

①忘记门Ft:将值朝0减少

②输入门It:是否忽略输入数据

③输出门Ot:是否使用隐状态

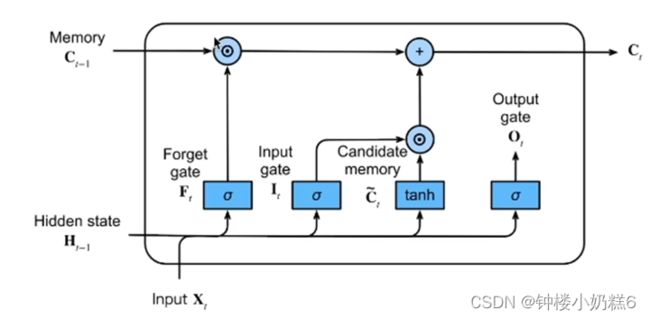

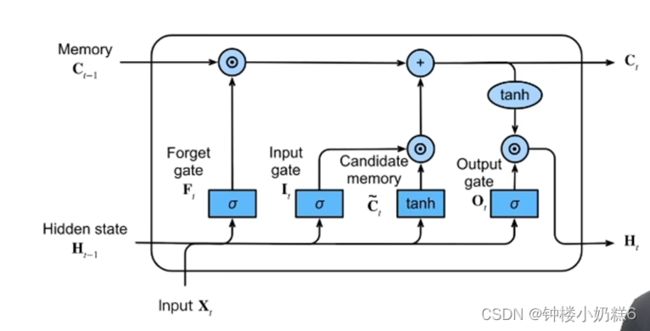

2.门

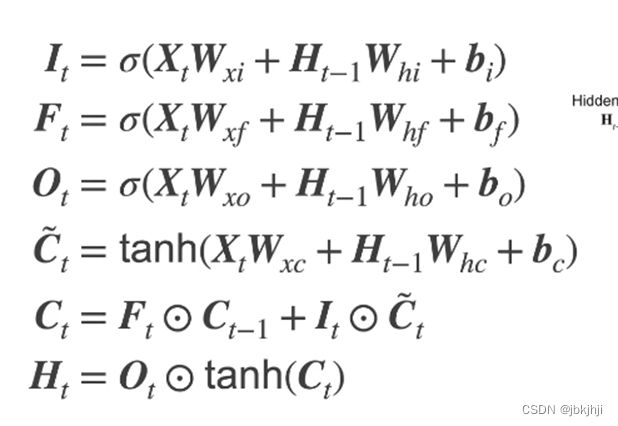

类似于GRU,当前时间步的输入和前一个时间步的隐状态作为数据送入LSTM中。由三个具有sigmoid激活函数的全连接层处理,计算输入门,遗忘门,输出门的值(三个门的值在0~1)

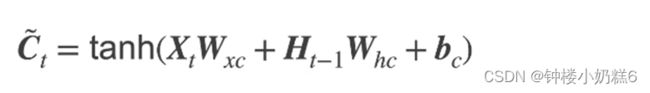

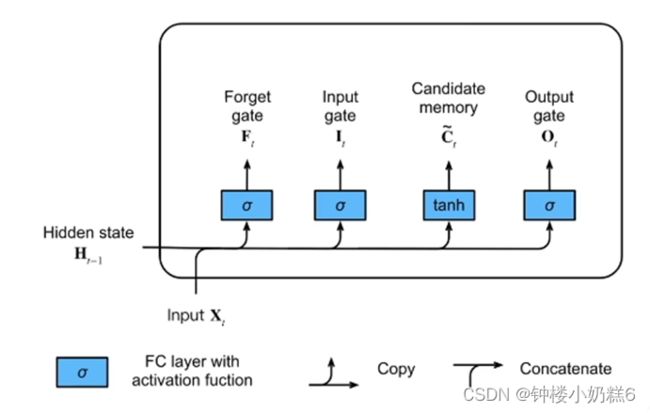

3.候选记忆单元

使用tanh函数作为激活函数,函数值在-1~1之间

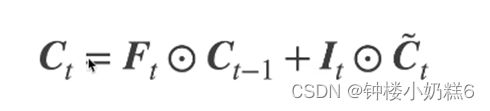

4.记忆单元

①在LSTM中,通过输入门和遗忘门控制输入和遗忘:输入门lt控制采用多少来自Ct的新数据,遗忘门控制保留过去多少记忆元C(t-1)的内容

②遗忘门是1输入门是0,过去的记忆元C(t-1)传递当前时间步

③上一时刻的记忆单元作为状态输入到模型

③LSTM由两个状态:H和C

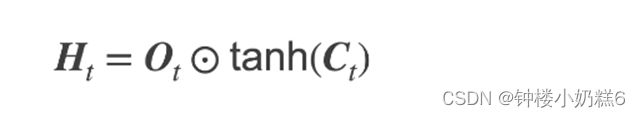

5.隐状态

①在LSTM中,tanh的作用是将Ct的值限制在-1~1之间

②Ot为1的时候有效地将所有记忆信息传递给预测部分。Ot为0丢弃当前的 Xt 和过去所有的信息,只保留记忆元内的所有信息,而不需要更新隐状态

【总结】

1 LSTM 和 GRU 所想要实现的效果是差不多的,但是结构更加复杂

C :一个数值可能比较大的辅助记忆单元

C 中包含两项: 当前的 Xt 和过去的状态(在 GRU 中只能二选一,这里可以实现两个都选)

2 长短期记忆网络包含三种类型的门:输入门、遗忘门和输出门

3 长短期记忆网络的隐藏层输出包括“隐状态”和“记忆元”。只有隐状态会传递到输出层,而记忆元完全属于内部信息

4 长短期记忆网络可以缓解梯度消失和梯度爆炸

5 长短期记忆网络是典型的具有重要状态控制的隐变量自回归模型

【代码】

# 加载《时光机器》数据集

import torch

from torch import nn

from d2l import torch as d2l

# 加载《时光机器》数据集

batch_size, num_steps = 32, 35

train_iter, vocab = d2l.load_data_time_machine(batch_size, num_steps)

# 初始化模型参数

def get_lstm_params(vocab_size, num_hiddens, device):

num_inputs = num_outputs = vocab_size

def normal(shape):

return torch.randn(size=shape, device=device) * 0.01 # 标准差为的高斯分布中提取权重

def three():

return (normal((num_inputs, num_hiddens)),

normal((num_hiddens, num_hiddens)),

torch.zeros(num_hiddens, device=device))

W_xi, W_hi, b_i = three() # 输入门参数

W_xf, W_hf, b_f = three() # 遗忘门参数

W_xo, W_ho, b_o = three() # 输出门参数

W_xc, W_hc, b_c = three() # 候选记忆元参数

# 输出层参数

W_hq = normal((num_hiddens, num_outputs))

b_q = torch.zeros(num_outputs, device=device)

# 附加梯度

params = [W_xi, W_hi, b_i, W_xf, W_hf, b_f, W_xo, W_ho, b_o, W_xc, W_hc,

b_c, W_hq, b_q]

for param in params:

param.requires_grad_(True)

return params# 定义模型

def init_lstm_state(batch_size, num_hiddens, device):

return (torch.zeros((batch_size, num_hiddens), device=device),

torch.zeros((batch_size, num_hiddens), device=device)

)

def lstm(inputs, state, params):

[W_xi, W_hi, b_i, W_xf, W_hf, b_f, W_xo, W_ho, b_o, W_xc, W_hc, b_c,

W_hq, b_q] = params

(H, C) = state

outputs = []

for X in inputs:

I = torch.sigmoid((X @ W_xi) + (H @ W_hi) + b_i)

F = torch.sigmoid((X @ W_xf) + (H @ W_hf) + b_f)

O = torch.sigmoid((X @ W_xo) + (H @ W_ho) + b_o)

C_tilda = torch.tanh((X @ W_xc) + (H @ W_hc) + b_c)

C = F * C + I * C_tilda

H = O * torch.tanh(C)

Y = (H @ W_hq) + b_q

outputs.append(Y)

return torch.cat(outputs, dim=0), (H, C)# 训练和预测

vocab_size, num_hiddens, device = len(vocab), 256, d2l.try_gpu()

num_epochs, lr = 500, 1

model = d2l.RNNModelScratch(len(vocab), num_hiddens, device, get_lstm_params, init_lstm_state, lstm)

d2l.train_ch8(model, train_iter, vocab, lr, num_epochs, device)

d2l.plt.show()# 简洁实现

num_inputs = vocab_size

lstm_layer = nn.LSTM(num_inputs, num_hiddens)

model = d2l.RNNModel(lstm_layer, len(vocab))

model = model.to(device)

d2l.train_ch8(model, train_iter, vocab, lr, num_epochs, device)