动手学深度学习笔记day7

实战:预测房价

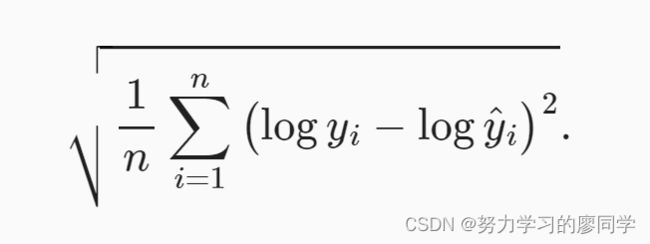

预测价格的对数与真实标签价格的对数之间出现以下均方根误差:

1、调用库函数

import hashlib

import os

import tarfile

import zipfile

import requests# 如果你没有安装pandas,请取消下一行的注释

# !pip install pandas%matplotlib inline

import numpy as np

import pandas as pd

import torch

from torch import nn

from d2l import torch as d2l

2、下载数据集

assert语法,name不在DATA_HUB中,执行f"{name} 不存在于 {DATA_HUB}"

assert 1==2, '1 不等于 2' AssertionError: 1 不等于 2

#@save

DATA_HUB = dict() #创建空字典DATA_HUB ={}

DATA_URL = 'http://d2l-data.s3-accelerate.amazonaws.com/'def download(name, cache_dir=os.path.join('..', 'data')): #@save

"""下载一个DATA_HUB中的文件,返回本地文件名"""

assert name in DATA_HUB, f"{name} 不存在于 {DATA_HUB}"

url, sha1_hash = DATA_HUB[name]os.makedirs(cache_dir, exist_ok=True)#目标目录已存在的情况下不会触发异常。

fname = os.path.join(cache_dir, url.split('/')[-1]) #'kaggle_house_pred_train.csv'

if os.path.exists(fname):

sha1 = hashlib.sha1()

with open(fname, 'rb') as f:

while True:

data = f.read(1048576)

if not data:

break

sha1.update(data)

if sha1.hexdigest() == sha1_hash:

return fname # 命中缓存

print(f'正在从{url}下载{fname}...') #fname=../data/kaggle_house_pred_train.csv

r = requests.get(url, stream=True, verify=True)

with open(fname, 'wb') as f:

f.write(r.content)

return fname

3、下载并解压缩一个zip或tar文件

def download_extract(name, folder=None): #@save

"""下载并解压zip/tar文件"""

fname = download(name)

base_dir = os.path.dirname(fname) #kaggle_house_pred_train.csv去掉文件名,返回目录,

#例如print(os.path.dirname("E:/Read_File/read_yaml.py"))

#结果:E:/Read_File

data_dir, ext = os.path.splitext(fname) # 分离文件名与扩展名

if ext == '.zip':

fp = zipfile.ZipFile(fname, 'r')

elif ext in ('.tar', '.gz'):

fp = tarfile.open(fname, 'r')

else:

assert False, '只有zip/tar文件可以被解压缩'

fp.extractall(base_dir) #解压文件名

return os.path.join(base_dir, folder) if folder else data_dir

#返回data_dirdef download_all(): #@save

"""下载DATA_HUB中的所有文件"""

for name in DATA_HUB:

download(name)

4、访问和读取数据集

DATA_HUB['kaggle_house_train'] = ( #@save

DATA_URL + 'kaggle_house_pred_train.csv',

'585e9cc93e70b39160e7921475f9bcd7d31219ce')DATA_HUB['kaggle_house_test'] = ( #@save

DATA_URL + 'kaggle_house_pred_test.csv',

'fa19780a7b011d9b009e8bff8e99922a8ee2eb90')train_data = pd.read_csv(download('kaggle_house_train'))

test_data = pd.read_csv(download('kaggle_house_test'))#第一个特征是ID不携带任何用于预测的信息。要将其从数据集中删除。

all_features = pd.concat((train_data.iloc[:, 1:-1], test_data.iloc[:, 1:]))

5、数据预处理

将所有缺失的值替换为相应特征的平均值,通过将特征重新缩放到零均值和单位方差来标准化数据

若无法获得测试数据,则可根据训练数据计算均值和标准差

numeric_features = all_features.dtypes[all_features.dtypes != 'object'].index#!= 'object' #假设如果这个数据类型不是object的话,那就是数值

all_features[numeric_features] = all_features[numeric_features].apply(

lambda x: (x - x.mean()) / (x.std()))

#lambda x简单定义关于x的函数:对数值特征的话,把它这一列减去它的均值,除以它的方差all_features[numeric_features] = all_features[numeric_features].fillna(0)

# 在标准化数据之后,所有均值消失,因此我们可以将缺失值设置为0#处理离散值(内容是字符串),我们用独热编码替换它们

all_features = pd.get_dummies(all_features, dummy_na=True)

# “Dummy_na=True”将“na”(缺失值)视为有效的特征值,并为其创建指示符特征

all_features.shape #(2919, 331)可以看到,此转换会将特征的总数量从79个增加到331个。#通过values属性,可以 从pandas格式中提取NumPy格式,并将其转换为张量表示用于训练

n_train = train_data.shape[0]

train_features = torch.tensor(all_features[:n_train].values, dtype=torch.float32)

test_features = torch.tensor(all_features[n_train:].values, dtype=torch.float32)

train_labels = torch.tensor(

train_data.SalePrice.values.reshape(-1, 1), dtype=torch.float32)

6、训练

loss = nn.MSELoss()

in_features = train_features.shape[1]#331def get_net():

net = nn.Sequential(nn.Linear(in_features,1))#线性回归

return netdef log_rmse(net, features, labels):

# 为了在取对数时进一步稳定该值,将小于1的值设置为1

clipped_preds = torch.clamp(net(features), 1, float('inf'))

# clamp()函数的功能将输入input张量每个元素的值压缩到区间 [min,max],并返回结果到一个新张量。#torch.clamp(input, min, max, out=None) → Tensorrmse = torch.sqrt(loss(torch.log(clipped_preds),

torch.log(labels)))

return rmse.item()def train(net, train_features, train_labels, test_features, test_labels,

num_epochs, learning_rate, weight_decay, batch_size):

train_ls, test_ls = [], []

train_iter = d2l.load_array((train_features, train_labels), batch_size)

# 这里使用的是Adam优化算法

optimizer = torch.optim.Adam(net.parameters(),

lr = learning_rate,

weight_decay = weight_decay) #weight decay(权值衰减)

for epoch in range(num_epochs):

for X, y in train_iter:

optimizer.zero_grad()

l = loss(net(X), y)

l.backward()

optimizer.step()

train_ls.append(log_rmse(net, train_features, train_labels))

if test_labels is not None:

test_ls.append(log_rmse(net, test_features, test_labels))

return train_ls, test_ls

7、折交叉验证

需要定义一个函数,在折交叉验证过程中返回第折的数据。

def get_k_fold_data(k, i, X, y):#给定k,给定第几折,给定训练数据在里面

assert k > 1#首先k肯定要大于1

fold_size = X.shape[0] // k#每一折的大小就是样本数除以k

X_train, y_train = None, None

for j in range(k):

idx = slice(j * fold_size, (j + 1) * fold_size)

X_part, y_part = X[idx, :], y[idx]

if j == i:

X_valid, y_valid = X_part, y_part

elif X_train is None:

X_train, y_train = X_part, y_part

else:

X_train = torch.cat([X_train, X_part], 0)

y_train = torch.cat([y_train, y_part], 0)

return X_train, y_train, X_valid, y_valid#当我们在折交叉验证中训练次后,返回训练和验证误差的平均值。

def k_fold(k, X_train, y_train, num_epochs, learning_rate, weight_decay,

batch_size):

train_l_sum, valid_l_sum = 0, 0

for i in range(k):

data = get_k_fold_data(k, i, X_train, y_train)

net = get_net()

train_ls, valid_ls = train(net, *data, num_epochs, learning_rate,

weight_decay, batch_size)

train_l_sum += train_ls[-1]

valid_l_sum += valid_ls[-1]

if i == 0:

d2l.plot(list(range(1, num_epochs + 1)), [train_ls, valid_ls],

xlabel='epoch', ylabel='rmse', xlim=[1, num_epochs],

legend=['train', 'valid'], yscale='log')

print(f'折{i + 1},训练log rmse{float(train_ls[-1]):f}, '

f'验证log rmse{float(valid_ls[-1]):f}')

return train_l_sum / k, valid_l_sum / k

8、模型选择

k, num_epochs, lr, weight_decay, batch_size = 5, 100, 5, 0, 64

train_l, valid_l = k_fold(k, train_features, train_labels, num_epochs, lr,

weight_decay, batch_size)

print(f'{k}-折验证: 平均训练log rmse: {float(train_l):f}, '

f'平均验证log rmse: {float(valid_l):f}')

9、Kaggle预测

def train_and_pred(train_features, test_features, train_labels, test_data,

num_epochs, lr, weight_decay, batch_size):

net = get_net()

train_ls, _ = train(net, train_features, train_labels, None, None,

num_epochs, lr, weight_decay, batch_size)

d2l.plot(np.arange(1, num_epochs + 1), [train_ls], xlabel='epoch',

ylabel='log rmse', xlim=[1, num_epochs], yscale='log')

print(f'训练log rmse:{float(train_ls[-1]):f}')

# 将网络应用于测试集。

preds = net(test_features).detach().numpy()

# 将其重新格式化以导出到Kaggle

test_data['SalePrice'] = pd.Series(preds.reshape(1, -1)[0])

submission = pd.concat([test_data['Id'], test_data['SalePrice']], axis=1)

submission.to_csv('submission.csv', index=False)

小结

-

真实数据通常混合了不同的数据类型,需要进行预处理。

-

常用的预处理方法:将实值数据重新缩放为零均值和单位方法;用均值替换缺失值。

-

将类别特征转化为指标特征,可以使我们把这个特征当作一个独热向量来对待。

-

我们可以使用K折交叉验证来选择模型并调整超参数。

-

对数对于相对误差很有用。

笔记来源:动手学深度学习