Flume简介和架构安装配置详解

flume简介

Flume 是 Cloudera 提供的一个高可用的,高可靠的,分布式的海量日志采集、聚合和传输的软件。

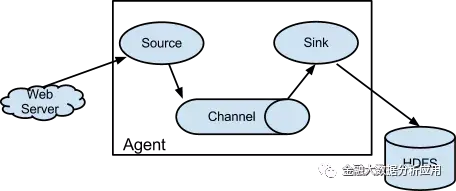

Flume 的核心是把数据从数据源(source)收集过来,再将收集到的数据送到指定的目的地(sink)。为了保证输送的过程一定成功,在送到目的地(sink)之前,会先缓存数据(channel),待数据真正到达目的地(sink)后,flume 在删除自己缓存的数据。

Flume 支持定制各类数据发送方,用于收集各类型数据;同时,Flume 支持定制各种数据接受方,用于最终存储数据。一般的采集需求,通过对 flume 的简单配置即可实现。大数据培训针对特殊场景也具备良好的自定义扩展能力。因此,flume 可以适用于大部分的日常数据采集场景

# 运行机制

单个 agent 采集数据

Agent是Flume的一个JVM进程,其中包含Source、Channel、Sink三个组件,要采集的数据经过定制化的Source缓存到Channel,Channel是一个队列,Source向里面插入数据,Sink从里面取数据,当Sink确认数据被下一跳Agent或者DB等接收后会将数据从Channel删除。

source采集源,可以接收外部源发送过来的数据。不同的source,可以接受不同的数据格式。比如有目录池(spooling directory)数据源,可以监控指定文件夹中的新文件变化,如果目录中有文件产生,就会立刻读取其内容。

channel是一个存储地,接收source的输出,直到有sink消费掉channel中的数据。channel中的数据直到进入到下一个channel中或者进入终端才会被删除。当sink写入失败后,可以自动重启,不会造成数据丢失,因此很可靠。

sink会消费channel中的数据,然后送给外部源或者其他source。如数据可以写入到HDFS或者HBase中。

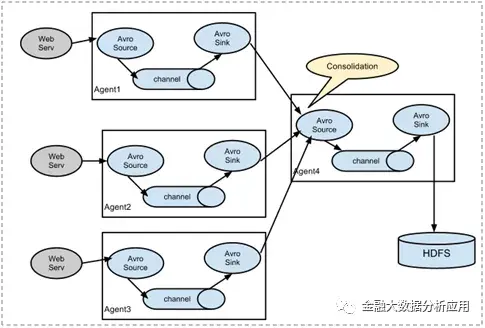

flume允许多个agent连在一起,形成前后相连的多级跳。

多个agent之间串联:

Flume 系统中核心的角色是 agent,agent 本身是一个 Java 进程,一般运行在日志收集节点。

每一个 agent 相当于一个数据传递员,内部有三个组件:

Source:采集源,用于跟数据源对接,以获取数据;

Sink:下沉地,采集数据的传送目的,用于往下一级 agent 传递数据或者往最终存储系统传递数据;

Channel:agent 内部的数据传输通道,用于从 source 将数据传递到 sink;

在整个数据的传输的过程中,流动的是 event,它是 Flume 内部数据传输的最基本单元。event 将传输的数据进行封装。如果是文本文件,通常是一行记录,event 也是事务的基本单位。event 从 source,流向 channel,再到 sink,本身为一个字节数组,并可携带 headers(头信息)信息。event 代表着一个数据的最小完整单元,从外部数据源来,向外部的目的地去。

一个完整的 event 包括:event headers、event body、event 信息,其event 信息就是 flume 收集到的日记记录。

二、安装配置使用flume

系统环境:centos7.5 64位系统

1.下载安装包

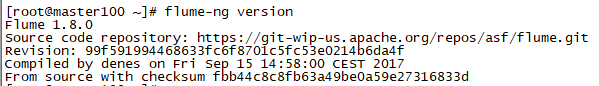

官网下载离线安装包:apache-flume-1.8.0-bin.tar.gz

也可以使用linux命令下载:

wget -c http://mirrors.tuna.tsinghua.edu.cn/apache/flume/1.8.0/apache-flume-1.8.0-bin.tar.gz

2.解压

解压压缩包并放至指定目录,我这里的完整目录是:/home/hadoop/runtime/apache-flume-1.8.0-bin/

3.配置环境变量

vi /etc/profile 打开profile文件,追加如下文本

#FLUME WARIABLES START export FLUME_HOME=/home/hadoop/runtime/apache-flume-1.8.0-bin export PATH=$PATH:$FLUME_HOME/bin #FLUME WARIABLES END

source /etc/profile

4.输入如下命令查看版本

flume-ng version

如果看到如下输出信息表示安装成功:

简单示例cd /usr/local/flume/

tar -xzvf apache-flume-1.6.0-bin.tar.gz

cd /usr/local/flume/apache-flume-1.6.0-bin/conf

cp flume-env.sh.template flume-env.sh

vim flume-env.sh

export JAVA_HOME=${JAVA_HOME}先在flume的conf目录下新建一个文件,指定flume我们所描述的采集方案

vim netcat-logger.conf

#定义agent中各组件的名字

a1.sources = r1

a1.sinks = k1

a1.channels = c1

#描述和配置source组件:r1

a1.sources.r1.type = netcat

a1.sources.r1.bind = localhost

a1.sources.r1.port = 44444

#描述和配置sink组件:k1

a1.sinks.k1.type = logger

#描述和配置channel组件,此处使用是内存缓存的方式

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

#描述和配置source channel sink之间的连接关系

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1#启动agent去采集数据

cd /usr/local/flume/apache-flume-1.6.0-bin

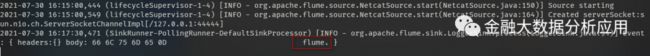

bin/flume-ng agent -c conf -f conf/netcat-logger.conf -n a1 -Dflume.root.logger=INFO,console启动成功

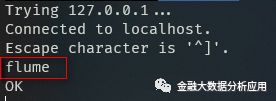

测试,先要往agent采集监听的端口上发送数据,让agent有数据可采集。telnet localhost 44444

另外一个窗口就会采集过来输入flume数据: