讯飞语音识别SDK集成 语音识别 语音合成 讯飞英语识别

最近项目集成了讯飞语音识别功能,由此记录简单的集成流程

demo效果(logcat)

资源下载

https://download.csdn.net/download/qq_38355313/10358546

1、首先用as建一个model (这个不用介绍)

2、登录讯飞开发者平台,进入控制台,创建应用生成appid

1、 创建应用

2、生成appid

3、下载SDK(非常重要,必须下载,因为每个appid和so和jar一一相对,所以要下载sdk拿到相应的so文件和jar文件,使用别人的是不行的哦,除非使用对应的appid)

1、下载SDK;

2、添加需要的功能

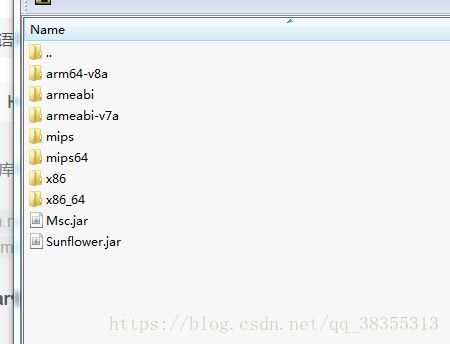

3、sdk文档(libs文件夹下是需要的so库和jar包,smaple文件夹下是官方demo)

4、复制lib文件夹下的so库和jar包到demo中(so放在libs下记得builder中添加引用)

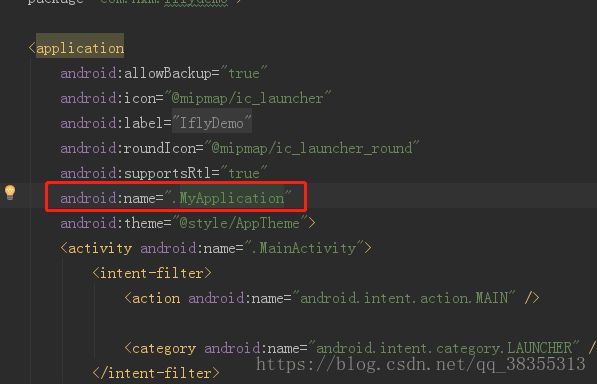

5、初始化讯飞(新建一个application 在OnCreate()中配置就好)

6、前期sdk集成工作已经完成,好了,开始愉快的引用了(下面是小木子写的简单识别功能,同时能切换英语识别,顺便吐槽下自己的英语,着实烂)

1、添加权限(测试的时候记得给权限)

<uses-permission android:name="android.permission.RECORD_AUDIO" />

<uses-permission android:name="android.permission.INTERNET" />

<uses-permission android:name="android.permission.ACCESS_NETWORK_STATE" />

<uses-permission android:name="android.permission.ACCESS_WIFI_STATE" />

<uses-permission android:name="android.permission.CHANGE_NETWORK_STATE" />

<uses-permission android:name="android.permission.READ_PHONE_STATE" />

<uses-permission android:name="android.permission.ACCESS_FINE_LOCATION" />

<uses-permission android:name="android.permission.READ_CONTACTS" />

<uses-permission android:name="android.permission.WRITE_EXTERNAL_STORAGE" />

<uses-permission android:name="android.permission.WRITE_SETTINGS" />

<uses-permission android:name="android.permission.READ_EXTERNAL_STORAGE" />

<uses-permission android:name="android.permission.ACCESS_FINE_LOCATION" />

<uses-permission android:name="android.permission.ACCESS_COARSE_LOCATION" />2、acticity中的代码:

public class MainActivity extends AppCompatActivity implements InitListener {

private static final String TAG = "MainActivity";

// 语音听写对象

private SpeechRecognizer mIat;

private HashMap mIatResults = new LinkedHashMap();

// 引擎类型

private String mEngineType = SpeechConstant.TYPE_CLOUD;

int ret = 0; // 函数调用返回值

private static String LANGUAGE_E = "en_us";

private static String LANGUAGE_C = "zh_cn";

private String currLanguage = LANGUAGE_C;

private TextView text_result;

@Override

protected void onCreate(Bundle savedInstanceState) {

super.onCreate(savedInstanceState);

setContentView(R.layout.activity_main);

text_result = findViewById(R.id.text_result);

initDtat();

findViewById(R.id.start).setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View v) {

startIflySpeechRecognize(LANGUAGE_C);

}

});

findViewById(R.id.language).setOnClickListener(new View.OnClickListener() {

@Override

public void onClick(View v) {

if (currLanguage.equals(LANGUAGE_C)) {

currLanguage = LANGUAGE_E;

}

}

});

}

private void initDtat() {

mIat = SpeechRecognizer.createRecognizer(this, this);

}

/**

* SpeechRecognizer 初始化监听

*

* @param code

*/

@Override

public void onInit(int code) {

Log.d(TAG, "SpeechRecognizer init() code = " + code);

if (code != ErrorCode.SUCCESS) {

Log.d(TAG, "初始化失败,错误码: " + code);

}

}

/**

* 开始讯飞语音识别

*/

private void startIflySpeechRecognize(String language) {

if (null == mIat) {

// 创建单例失败,与 21001 错误为同样原因,参考 http://bbs.xfyun.cn/forum.php?mod=viewthread&tid=9688

Log.d(TAG, "创建对象失败,请确认 libmsc.so 放置正确,且有调用 createUtility 进行初始化");

return;

}

// 移动数据分析,收集开始听写事件

FlowerCollector.onEvent(this, "iat_recognize");

mIatResults.clear();

// 设置参数

setParam(language);

// 不显示听写对话框

ret = mIat.startListening(mRecognizerListener);

if (ret != ErrorCode.SUCCESS)

Log.d(TAG, "听写失败,错误码:" + ret);

}

/**

* 参数设置

*

* @return

*/

public void setParam(String language) {

// 清空参数

mIat.setParameter(SpeechConstant.PARAMS, null);

// 设置听写引擎

mIat.setParameter(SpeechConstant.ENGINE_TYPE, mEngineType);

// 设置返回结果格式

mIat.setParameter(SpeechConstant.RESULT_TYPE, "json");

if (language.equals("en_us")) {

// 设置语言

mIat.setParameter(SpeechConstant.LANGUAGE, "en_us");

mIat.setParameter(SpeechConstant.ACCENT, null);

//Log.d(TAG, "设置语言-英文");

} else {

// 设置语言

mIat.setParameter(SpeechConstant.LANGUAGE, "zh_cn");

// 设置语言区域

mIat.setParameter(SpeechConstant.ACCENT, "mandarin");

//Log.d(TAG, "设置语言-中文");

}

// 设置语音前端点:静音超时时间,即用户多长时间不说话则当做超时处理

mIat.setParameter(SpeechConstant.VAD_BOS, "8000");

// 设置语音后端点:后端点静音检测时间,即用户停止说话多长时间内即认为不再输入, 自动停止录音

mIat.setParameter(SpeechConstant.VAD_EOS, "1000");

// 设置标点符号,设置为"0"返回结果无标点,设置为"1"返回结果有标点

mIat.setParameter(SpeechConstant.ASR_PTT, "1");

// 设置音频保存路径,保存音频格式支持pcm、wav,设置路径为sd卡请注意WRITE_EXTERNAL_STORAGE权限

// 注:AUDIO_FORMAT参数语记需要更新版本才能生效

mIat.setParameter(SpeechConstant.AUDIO_FORMAT, "wav");

mIat.setParameter(SpeechConstant.ASR_AUDIO_PATH, Environment.getExternalStorageDirectory() + "/msc/iat.wav");

}

/**

* 听写监听器。

*/

private RecognizerListener mRecognizerListener = new RecognizerListener() {

@Override

public void onBeginOfSpeech() {

// 此回调表示:sdk内部录音机已经准备好了,用户可以开始语音输入

Log.d(TAG, "开始说话");

}

@Override

public void onError(SpeechError error) {

// Tips:

// 错误码:10118(您没有说话),可能是录音机权限被禁,需要提示用户打开应用的录音权限。

if (error.getErrorCode() == 14002) {

// Log.d(TAG, error.getPlainDescription(true) + "\n请确认是否已开通翻译功能");

} else {

// Log.d(TAG, error.getPlainDescription(true));

}

// TODO 重新开启语音识别监听

startIflySpeechRecognize(currLanguage);

}

@Override

public void onEndOfSpeech() {

// 此回调表示:检测到了语音的尾端点,已经进入识别过程,不再接受语音输入

Log.d(TAG, "结束说话");

}

@Override

public void onResult(RecognizerResult results, boolean isLast) {

// Log.d(TAG, "**********************" + results.getResultString());

printResult(results);

}

@Override

public void onVolumeChanged(int volume, byte[] data) {

}

@Override

public void onEvent(int eventType, int arg1, int arg2, Bundle obj) {

// 以下代码用于获取与云端的会话id,当业务出错时将会话id提供给技术支持人员,可用于查询会话日志,定位出错原因

// 若使用本地能力,会话id为null

if (SpeechEvent.EVENT_SESSION_ID == eventType) {

String sid = obj.getString(SpeechEvent.KEY_EVENT_SESSION_ID);

// Log.d(TAG, "session id =" + sid);

}

// TODO 重新开启语音识别监听

}

};

/**

* 处理结果

*

* @param results

*/

private void printResult(RecognizerResult results) {

String text = JsonParser.parseIatResult(results.getResultString());

String sn = null;

// 读取json结果中的sn字段

try {

JSONObject resultJson = new JSONObject(results.getResultString());

sn = resultJson.optString("sn");

} catch (JSONException e) {

e.printStackTrace();

}

mIatResults.put(sn, text);

StringBuffer resultBuffer = new StringBuffer();

for (String key : mIatResults.keySet()) {

resultBuffer.append(mIatResults.get(key));

}

String result = resultBuffer.toString();

text_result.setText(result);

Log.d(TAG, "结果:" + result);

// if (mIFlyTTS != null)

// mIFlyTTS.playText(result);

// TODO 处理结果 然后重新开启

startIflySpeechRecognize(currLanguage);

}

} 资源下载

https://download.csdn.net/download/qq_38355313/10358546