redis的三大模式主从,哨兵和集群

- 一、前言

- 二、redis主从复制

-

- 1、主从复制的作用:

- 2、主从复制的流程

- 3、搭建主从复制

-

- 3.1、搭建环境

- 3.2、安装redis

- 3.3、主服务器配置查看以下行

- 3.4、从服务器配置查看以下行

- 3.5、检测成果

- 二、哨兵模式

-

- 1、哨兵模式原理:

- 2、哨兵模式作用

- 3、哨兵结构组成

- 4、故障转移机制

- 5、搭建哨兵模式

-

- 5.1、搭建环境

- 5.2、验证:

- 三、集群模式

-

- 1、基础

-

- 1.1、Redis集群的数据分片:

- 1.2、Redis Cluster 工作原理

- 1.3、Redis cluster基本架构

- 2、搭建集群

-

- 2.1、多实用实现

-

- 2.1.1、验证

- 2.2、分布式搭建

-

- 2.2.1、报错1

- 2.2.2、报错2

- 2.2.3、报错3

一、前言

虽然Redis可以实现单机的数据持久化,但无论是RDB也好或者AOF也好,都解决不了单点宕机问题,即一旦单台 redis服务器本身出现系统故障、硬件故障等问题后,就会直接造成数据的丢失,此外单机的性能也是有极限的,因此需要使用另外的技术来解决单点故障和性能扩展的问题。

- 主从复制:主从复制是高可用Redis的基础,哨兵和集群都是在主从复制基础上实现高可用的。主从复制主要实现了数据的多机备份,以及对于读操作的负载均衡和简单的故障恢复。缺陷:故障恢复无法自动化;写操作无法负载均衡;存储能力受到单机的限制。

- 哨兵:在主从复制的基础上,哨兵实现了自动化的故障恢复。缺陷:写操作无法负载均衡:存储能力受到单机的限制;哨兵无法对从节点进行自动故障转移,在读写分离场景下,从节点故障会导致读服务不可用,需要对从节点做额外的监控、切换操作。

- 集群:通过集群,Redis解决了写操作无法负载均衡,以及存储能力受到单机限制的问题,实现了较为完善的高可用方案。

二、redis主从复制

主从复制,是指将一台redis服务器的数据,复制到其他的redis服务器。前者称为主节点(master),后者称为从节点(slave);数据复制是单向的,只能由主节点到从节点。

默认情况下,每台redis服务器都是主节点;且一个主节点可以有多个从节点(或者没有从节点),但是每一个从节点只能有一个主节点。

1、主从复制的作用:

- 数据冗余:主从复制实现了数据的热备份,是持久化之外的一种数据冗余方式。

- 故障恢复:当主节点出现问题时,可以由从节点提供服务,实现快速的故障恢复;实际上是一种服务的冗余。

- 负载均衡:在主从复制的基础.上,配合读写分离,可以让主节点提供写服务,由从节点提供读服务〈即写Redis数据时应用连接主节点,读Redis数据时应用连接从节点),分担服务器负载;尤其是在写少读多的场景下,通过多个从节点分担读负载,可以大大提高Redis服务器的并发量。

- 高可用基石:除了上述作用以外,主从复制还是哨兵和集群能够实施的基础,因此说主从复制是Redis高可用的基础。

2、主从复制的流程

- 若启动一个Slave机器,则它会向Master机器发送一个"sync command"命令,请求同步连接。从发给主

- 无论是第一次连接还是重新连接,Master机器都会启动一个后台进程,将数据快照保存到数据文件中(执行rdb操作),同时Master还会记录修改数据的所有命令并缓存在数据文件中。

- 后台进程完成缓存操作之后,Master机器就会向Slave机器发送数据文件存储,接着Master机器就会将修改数据的所有操作一并(AOF)发送给Slave端机器。若slave出现故障导致宕机,则恢复正常后会自动重新连接。

- Master机器收到Slave端机器的连接后,将其完整的数据文件发送给slave端机器,如果Master同时收到多个slave发来的同步请求,则Master会在后台启动一个进程以保存数据文件,然后将其发送给所有的Slave端机器,确保所有的Slave端机器都正常。

3、搭建主从复制

3.1、搭建环境

master 192.168.133.50

clave1 192.168.133.75

clave2 192.168.133.100

systemctl stop firewalld

setenforce 0

3.2、安装redis

以下命令所有服务器都执行

yum install -y gcc gcc-c++ make

tar zxvf redis-5.0.7.tar.gz -C /opt/

cd /opt/redis-5.0.7/

make

make PREFIX=/usr/local/redis install

cd /opt/redis-5.0.7/utils

./install_server.sh

ss -natp |grep redis

ln -s /usr/local/redis/bin/* /usr/local/bin/

3.3、主服务器配置查看以下行

[root@master utils]# vim /etc/redis/6379.conf

监听端口改为任意端口

70 bind 127.0.0.1

改

70 bind 0.0.0.0

开启守护进程

![]()

指定日志文件目录

![]()

指定工作目录

![]()

开启AOF持久化功能

700 appendonly no

改

700 appendonly yes

[root@master utils]# /etc/init.d/redis_6379 restart

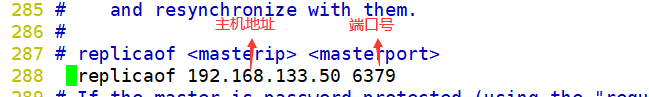

3.4、从服务器配置查看以下行

[root@master utils]# vim /etc/redis/6379.conf

将监听端口改为任意端口

70 bind 127.0.0.1

改

70 bind 0.0.0.0

开启守护进程

![]()

指定日志文件目录

![]()

指定工作目录

![]()

指定主节点的ip 和端口

开启 AOF持久化

700 appendonly no

改

700 appendonly yes

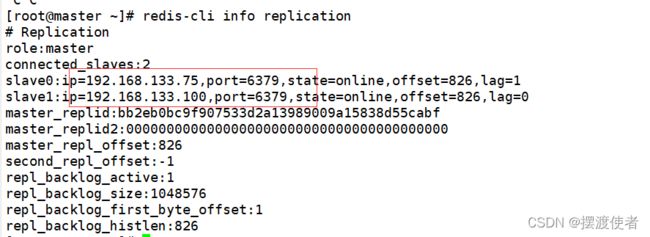

3.5、检测成果

主服务器上查看

[root@master ~]# ss -natp|grep redis

![]()

从服务器上查看

![]()

![]()

主服务上开启日志,可以看到两台从服务器已经成功设置

[root@master ~]# tail -f /var/log/redis_6379.log

[root@master ~]# redis-cli info replication

[root@master ~]# vim redis.sh

#!/bin/bash

num=10

for i in `seq $num`

do

redis-cli set zy$i $i

done

[root@master ~]# bash redis.sh

OK

OK

OK

OK

OK

OK

OK

OK

OK

OK

[root@master ~]# redis-cli

127.0.0.1:6379> keys *

1) "zy4"

2) "zy9"

3) "zy3"

4) "zy1"

5) "zy6"

6) "zy5"

7) "zy7"

8) "zy8"

9) "zy10"

10) "zy2"

二、哨兵模式

哨兵的核心功能:在主从复制的基础上,哨兵引入了主节点的自动故障转移。

1、哨兵模式原理:

哨兵(sentinel):是一个分布式系统,用于对主从结构中的每台服务器进行监控,当出现故障时通过投票机制选择新的Master并将所有Slave连接到新的 Master。所以整个运行哨兵的集群的数量不得少于3个节点。

首先主节点的信息是配置在哨兵(Sentinel)的配置文件中

哨兵节点会和配置的主节点建立起命令连接和订阅连接

PS:Redis发布订阅(pub/sub)是一种消息通信模式:发送者(pub)发送消息,订阅者(sub)接收消息。

哨兵会向主服务器通过命令连接每10s发送一次INFO命令,通过INFO命令,主节点会返回自己的run_id和自己的从节点位置信息哨兵会对这些从节点也建立命令连接和订阅连接

哨兵通过命令连接向从节点发送INFO命令,获取到他的一些信息:

run id(redis服务器id)

role(职能)

从服务器的复制偏移量offset

其他

通过命令连接向服务器的sentinel:hello频道发送一条消息,内容包括自己的ip端口、run id、配置(后续投票的时候会用到)等

通过订阅连接对服务器的sentinel:hello频道做了监听,所以所有的向该频道发送的哨兵的消息都能被接受到

解析监听到的消息,进行分析提取,就可以知道还有那些别的哨兵服务节点也在监听这些主从节点了,更新结构体将这些哨兵节点记录下来

向观察到的其他的哨兵节点建立命令连接----没有订阅连接

2、哨兵模式作用

- 监控:哨兵会不断地检查主节点和从节点是否运作正常。

- 自动故障转移:当主节点不能正常工作时,哨兵会开始自动故障转移操作,它会将失效主节点的其中一个从节点升级为新的主节点,并让其他从节点改为复制新的主节点。

- 通知提醒:哨兵可以将故障转移的结果发送给客户端。

3、哨兵结构组成

- 哨兵节点:哨兵系统由一个或多个哨兵节点组成,哨兵节点就是特殊的redis节点,不存储数据

- 数据节点:主节点和从节点都是数据节点。

哨兵的启动依赖于主从模式,所以须把主从模式安装好的情况下再去做哨兵模式,所有节点上.都需要部署哨兵模式,哨兵模式会监控所有的Redis工作节点是否正常,当Master出现问题的时候,因为其他节点与主节点失去联系,因此会投票,投票过半就认为这个Master的确出现问题,然后会通知哨兵间,然后从Slaves中选取一个作为新的 Master。

需要特别注意的是,客观下线是主节点才有的概念:如果从节点和哨兵节点发生故障,被哨兵主观下线后,不会再有后续的客观下线和故障转移操作。

4、故障转移机制

1.由哨兵节点定期监控发现主节点是否出现了故障,每个哨兵节点每隔1秒会向主节点、从节点及其它哨兵节点发送一次ping命令做一次心跳检测。如果主节点在一定时间范围内不回复或者是回复一个错误消息,那么这个哨兵就会认为这个主节点主观下线了(单方面的),当超过半数哨兵节点认为该主节点下线了,这样就客观下线了。

2.当主节点出现故障,此时哨兵节点会通过Raft算法〈选举算法)实现选举机制共同选举出一个哨兵节点为leader,来负责处理主节点的故障转移和通知。所以整个运行哨兵的集群的数量不得少于3个节点。

3.由leader哨兵节点执行故障转移,过程如下:

●将某一个从节点升级为新的主节点,让其它从节点指向新的主节点;

●若原主节点恢复也变成从节点,并指向新的主节点;

●通知客户端主节点已经更换。

需要特别注意的是,客观下线是主节点才有的概念:如果从节点和哨兵节点发生故障,被哨兵主观下线后,不会再有后续的客观线和故障转移操作

主节点的选举:

1过滤掉不健康的(已下线的),没有回复哨兵ping响应的从节点

2选择配置文件中从节点优先级最高的(replication-priority,默认值为100)

3选择复制偏移量最大的,也就是复制最完整的从节点。

sentinel中的三个定时任务

- 每10秒每个sentinel对master和slave执行info发现slave节点

- 每2秒确认主从关系:每2秒每个sentinel通过master节点的channel交换信息(pub/sub)通过sentinel__:hello频道交互交互对节点的“看法”和自身信息

- 每1秒每个sentinel对其他sentinel和redis执行ping

Sentinel 进程是用于监控redis集群中Master主服务器工作的状态,在Master主服务器发生故障的时候,可以实现Master和Slave服务器的切换,

哨兵(Sentinel) 是一个分布式系统,可以在一个架构中运行多个哨兵(sentinel) 进程,这些进程使用流言协议(gossip protocols)来接收关于Master主服务器是否下线的信息,并使用投票协议(Agreement Protocols)来决定是否执行自动故障迁移,以及选择哪个Slave作为新的Master。

有主观宕机,对应的有客观宕机。当“哨兵群”中的多数Sentinel进程在对Master主服务器做出SDOWN 的判断,并且通过 SENTINEL is-master-down-by-addr 命令互相交流之后,得出的Master Server下线判断,这种方式就是“客观宕机”(客观:是不依赖于某种意识而已经实际存在的一切事物),英文名称是:Objectively Down, 简称 ODOWN通过一定的vote算法,从剩下的slave从服务器节点中,选一台提升为Master服务器节点,然后自动修改相关配置,并开启故障转移(failover)Sentinel 机制可以解决master和slave角色的自动切换问题,但单个 Master 的性能瓶颈问题无法解决,类似于MySQL中的MHA功能Redis Sentinel中的Sentinel节点个数应该为大于等于3且最好为奇数客户端初始化时连接的是Sentinel节点集合,不再是具体的Redis节点,但Sentinel只是配置中心不是代理。Redis Sentinel 节点与普通redis 没有区别,要实现读写分离依赖于客户端程序redis 3.0 之前版本中,生产环境一般使用哨兵模式,但3.0后推出redis cluster功能后,可以支持更大规模的生产环境

5、搭建哨兵模式

5.1、搭建环境

master 192.168.133.50

clave1 192.168.133.75

clave2 192.168.133.100

systemctl stop firewalld

setenforce 0

修改哨兵模式的配置文件(所有服务器操作)

vim /opt/redis-5.0.7/sentinel.conf

关闭保护模式

![]()

端口号 26379

![]()

开启后台运行

26 daemonize no

改

26 daemonize yes

指定日志目录

36 logfile ""

改

36 logfile "/var/log/sentinel.log" 可以自己设定

数据文件

65 dir /tmp

改

65 dir /var/lib/redis/6379 可以自己设定

改变master节点地址

84 sentinel monitor mymaster 127.0.0.1 6379 2

改

84 sentinel monitor mymaster 192.168.133.50 6379 2

可以修改时间

![]()

故障切换时间

![]()

启动时先启动主服务器 再启动从服务器

cd /opt/redis-5.0.7/

redis-sentinel sentinel.conf &

ss -ntap |grep 26379

vim /opt/redis-5.0.7/redis.conf

10,25,100,数值越大优先级越高,自动选择优先级大的。

如果优先级相同,看偏移量,偏移量小的说明数据新,自动选择偏移量小的。

[root@master ~]# redis-cli -p 26379

127.0.0.1:26379> info sentinel

5.2、验证:

停掉主机服务

[root@master ~]# /etc/init.d/redis_6379 stop

Stopping ...

Waiting for Redis to shutdown ...

Redis stopped

打开从服务器上的日志文件

[root@clave1 ~]# tail -f /var/log/sentinel.log

主服务器已经从192.168.133.50换到了192.168.133.75的从服务器上

vim /opt/redis-5.0.7/sentinel.conf

三、集群模式

1、基础

集群,即Redis Cluster,是Redis 3.0开始引入的分布式存储方案。

集群由多个节点(Node)组成,Redis的数据分布在这些节点中。集群中的节点分为主节点和从节点:只有主节点负责读写请求和集群信息的维护;从节点只进行主节点数据和状态信息的复制。

集群的作用,可以归纳为两点:

(1)数据分区:数据分区(或称数据分片)是集群最核心的功能。集群将数据分散到多个节点,一方面突破了Redis单机内存大小的限制,存储容量大大增加;另一方面每个主节点都可以对外提供读服务和写服务,大大提高了集群的响应能力。Redis单机内存大小受限问题,在介绍持久化和主从复制时都有提及:例如,如果单机内存太大,bgsave和bgrewriteaof 的:保存操作可能导致主进程阻塞,主从环境下主机切换时可能导致从节点长时间无法提供服务,全量复制阶段主节点的复制缓冲区可能溢出。

(2)高可用:集群支持主从复制和主节点的自动故障转移〈与哨兵类似)﹔当任一节点发生故障时,集群仍然可以对外提供服务。

1.1、Redis集群的数据分片:

Redis集群引入了哈希槽的概念

Redis集群有16384个哈希槽(编号0-16383)集群的每个节点负责部分哈希槽

每个Key通过CRc16校验后对16384取余来决定放置哪个哈希槽,通过这个值,去找到对应的插槽所对应的节点,然后直接自动跳转到这个对应的节点上进行存取操作

#以3个节点组成的集群为例:

节点A包含0到5460号哈希槽

节点B包含5461到10922号哈希槽

节点C包含10923到16383号哈希槽

#Redis集群的主从复制模型

集群中具有A、B、C三个节点,如果节点B失败了,整个集群就会因缺少5461-10922这个范围的槽而不可以用。

为每个节点添加一个从节点A1、B1、C1整个集群便有三个Master节点和三个slave 节点组成,在节点B失败后,集群选举:一位为主节点继续服务。当B和B1都失败后,集群将不可用。

1.2、Redis Cluster 工作原理

在哨兵sentinel机制中,可以解决redis高可用问题,即当master故障后可以自动将slave提升为master,从而可以保证redis服务的正常使用,但是无法解决redis单机写入的瓶颈问题,即单机redis写入性能受限于单机的内存大小、并发数量、网卡速率等因素。

Redis Cluster特点如下:

- 所有Redis节点使用(PING机制)互联,

- 集群中某个节点的是否失效,是由整个集群中超过半数的节点监测都失效,才能算真正的失效

- 客户端不需要proxy即可直接连接redis,应用程序中需要配置有全部的redis服务器IP

- redis cluster把所有的redis node 平均映射到 0-16383个槽位(slot)上,读写需要到指定的redis node上进行操作,因此有多少个redis node相当于redis 并发扩展了多少倍,每个redis node 承 担16384/N个槽位

- Redis cluster预先分配16384个(slot)槽位,当需要在redis集群中写入一个key -value的时候,会使用CRC16(key)取余16384之后的值,决定将key写入哪一个槽位从而决定写入哪一个Redis节点上,从而有效解决单机瓶颈。

1.3、Redis cluster基本架构

假如三个主节点分别是:A, B, C 三个节点,采用哈希槽 (hash slot)的方式来分配16384个slot 的话

映射到master主机上

它们三个节点分别承担的slot 区间可以是

节点A覆盖 0-5460

节点B覆盖 5461-10922

节点C覆盖 10923-16383

Redis cluster主从架构

Redis cluster的架构虽然解决了并发的问题,但是又引入了一个新的问题,每个Redis master的高可用

如何解决?

那就是对每个master 节点都实现主从复制,从而实现 redis 高可用性

2、搭建集群

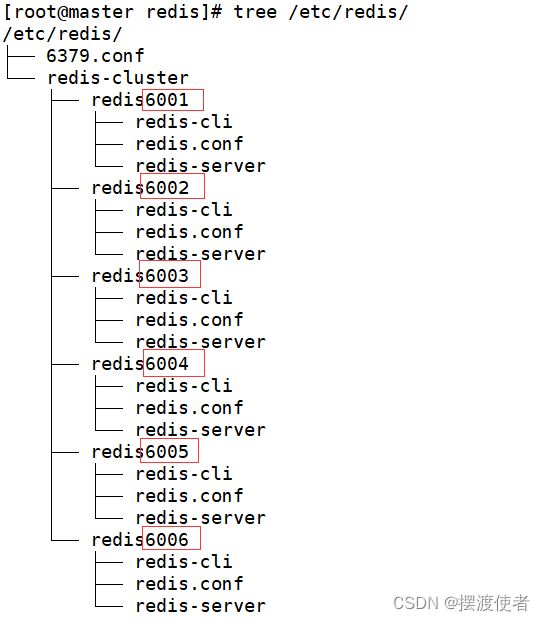

2.1、多实用实现

[root@master ~]# cd /etc/redis/

[root@master redis]# mkdir -p redis-cluster/redis600{1..6} 建立6台机器文件夹

[root@master redis]# cd /opt/redis-5.0.7/

[root@master redis-5.0.7]# for i in {1..6}; do cp redis.conf src/redis-cli src/redis-server /etc/redis/redis-cluster/redis600$i; done 拷贝3个文件到指定文件夹

[root@master redis]# tree /etc/redis/

[root@master ~]# cd /etc/redis/redis-cluster/redis6001

[root@master redis6001]# vim redis.conf

69 bind 127.0.0.1

注销

69 #bind 127.0.0.1 注释,监听所有

88 protected-mode yes

改

88 protected-mode no 关闭保护模式

92 port 6379

改

92 port 6001 修改端口为6001,后面每台机器都得改

136 daemonize no

改

136 daemonize yes 守护进程后台运行打开

699 appendonly no

改

699 appendonly yes 开启AOF

832 # cluster-enabled yes

取消注释

832 cluster-enabled yes 开启集群

840 # cluster-config-file nodes-6379.conf

取消注释并更改相对应的端口

840 cluster-config-file nodes-6001.conf 使用的 配置文件,这里每个机器都要更改

846 # cluster-node-timeout 15000

取消注释

846 cluster-node-timeout 15000 开启超时时间

把文件拷至各个服务器

[root@master redis6001]# \cp -f redis.conf ../redis6002

[root@master redis6001]# \cp -f redis.conf ../redis6003

[root@master redis6001]# \cp -f redis.conf ../redis6004

[root@master redis6001]# \cp -f redis.conf ../redis6005

[root@master redis6001]# \cp -f redis.conf ../redis6006

[root@master redis6001]# vim ../redis6002/redis.conf

[root@master redis6001]# vim ../redis6003/redis.conf

[root@master redis6001]# vim ../redis6004/redis.conf

[root@master redis6001]# vim ../redis6005/redis.conf

[root@master redis6001]# vim ../redis6006/redis.conf

[root@master redis6001]# for i in {1..6} 在此目录下开启redis

> do

> cd /etc/redis/redis-cluster/redis600$i

> ./redis-server redis.conf

> done

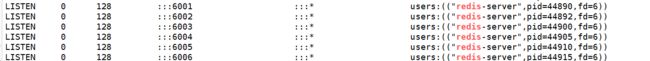

[root@master redis6006]# ss -natp |grep redis

ln -s /usr/local/redis/bin/* /usr/local/bin/

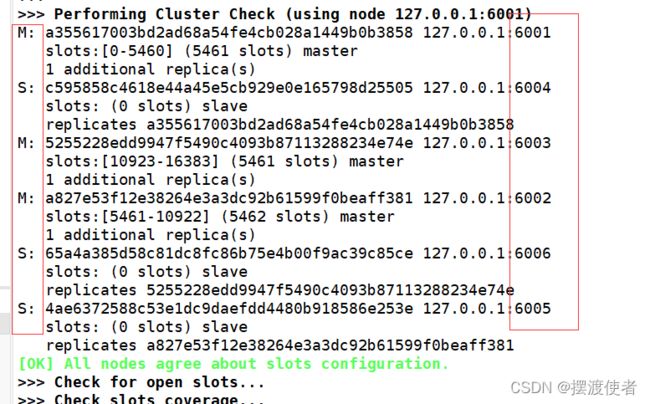

[root@master ~]# redis-cli --cluster create 127.0.0.1:6001 127.0.0.1:6002 127.0.0.1:6003 127.0.0.1:6004 127.0.0.1:6005 127.0.0.1:6006 --cluster-replicas 1

2.1.1、验证

[root@master ~]# redis-cli -p 6001 -c

127.0.0.1:6001> CLUSTER SLOTS

127.0.0.1:6001> set class sanguo 设个键值

-> Redirected to slot [7755] located at 127.0.0.1:6002 通过算法已转移到了6002上

OK

127.0.0.1:6002>

127.0.0.1:6006> get class 从其他从服务器上取值

-> Redirected to slot [7755] located at 127.0.0.1:6002 会直接跳到该值所在的服务器上

"sanguo"

2.2、分布式搭建

基本一样

不过有几个设置不一样 端口号不能设6379,我设的是6+机器ip最后1位,不足补0,凑成4位端口

启动时会有报错

2.2.1、报错1

7110:M 12 Dec 2021 17:12:23.725 # WARNING: The TCP backlog setting of 511 cannot be enforced because /proc/sys/net/core/somaxconn is set to the lower value of 128.

对一个高负载的环境来说tcp设置128这个值,太小了。然后我们可以手动设置,或者设置永久值.所以执行:

echo 511 > /proc/sys/net/core/somaxconn

或者

vim /etc/sysctl.conf

net.core.somaxconn= 1024

sysctl -p

2.2.2、报错2

WARNING you have Transparent Huge Pages (THP) support enabled in your kernel. This will create latency and memory usage issues with Redis. To fix this issue run the command 'echo never > /sys/kernel/mm/transparent_hugepage/enabled' as root, and add it to your /etc/rc.local in order to retain the setting after a reboot. Redis must be restarted after THP is disabled.

翻译为:警告您的内核中启用了透明大页面(THP)支持。这将导致Redis的延迟和内存使用问题。要解决此问题,请以root用户身份运行命令“echo never>/sys/kernel/mm/transparent_hugepage/enabled”,并将其添加到/etc/rc.local中,以便在重新启动后保留设置。禁用THP后,必须重新启动Redis

解决:

vi /etc/rc.local

添加代码:

if test -f /sys/kernel/mm/redhat_transparent_hugepage/enabled; then

echo never > /sys/kernel/mm/redhat_transparent_hugepage/enabled

fi

或者

echo never > /sys/kernel/mm/redhat_transparent_hugepage/enabled

2.2.3、报错3

WARNING overcommit_memory is set to 0! Background save may fail under low memory condition. To fix this issue add 'vm.overcommit_memory = 1' to /etc/sysctl.conf and then reboot or run the command 'sysctl vm.overcommit_memory=1' for this to take effect.

解决方法

很简单,按提示的操作(将vm.overcommit_memory 设为1)即可:

有三种方式修改内核参数,但要有root权限:

(1)编辑/etc/sysctl.conf ,改vm.overcommit_memory=1,然后sysctl -p 使配置文件生效

(2)sysctl vm.overcommit_memory=1

(3)echo 1 > /proc/sys/vm/overcommit_memory

然后重启

/etc/init.d/redis_6379 restart

[root@localhost redis]# redis-cli --cluster create 192.168.133.50:6050 192.168.133.100:6100 192.168.133.75:6075 192.168.133.99:6099 192.168.133.25:6025 192.168.133.101:6101 --cluster-replicas 1

192.168.133.50:6050> set class sanguo

-> Redirected to slot [7755] located at 192.168.133.100:6100

OK

192.168.133.101:6101> get class 在非主从关系的机器上调用也能看到

-> Redirected to slot [7755] located at 192.168.133.100:6100

"sanguo"