Hive部署,hive客户端

1、Hive部署

Hive是分布式运行的框架还是单机运行的?

- Hive是单机工具,只需要部署在一台服务器即可。

- Hive虽然是单机的,但是它可以提交分布式运行的MapReduce程序运行。

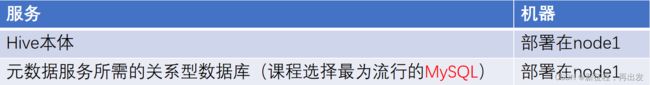

1.1、规划

我们知道Hive是单机工具后,就需要准备一台服务器供Hive使用即可。

同时Hive需要使用元数据服务,即需要提供一个关系型数据库,我们也选择一台服务器安装关系型数据库即可。

为了简单起见,都安装到node1服务器上。

1.2、步骤1:安装MySQL数据库

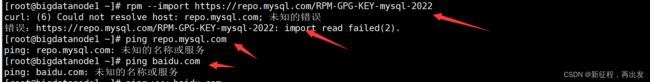

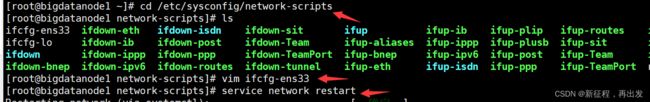

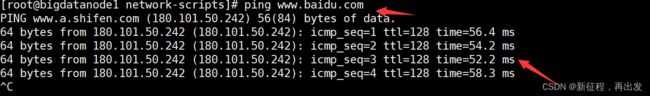

1.2.1、先联网

在ifcfg-ens33添加

DNS1=114.114.114.114

重启网络

service network restart

1.2.3、安装mysql

# 更新密钥

rpm --import https://repo.mysql.com/RPM-GPG-KEY-mysql-2022

# 安装Mysql yum库

rpm -Uvh http://repo.mysql.com//mysql57-community-release-el7-7.noarch.rpm

# yum安装Mysql

yum -y install mysql-community-server

# 启动Mysql设置开机启动

systemctl start mysqld

systemctl enable mysqld

# 检查Mysql服务状态

systemctl status mysqld

# 第一次启动mysql,会在日志文件中生成root用户的一个随机密码,使用下面命令查看该密码

grep 'temporary password' /var/log/mysqld.log

# 修改root用户密码

mysql -u root -p -h localhost

Enter password:

# 如果你想设置简单密码,需要降低Mysql的密码安全级别

set global validate_password_policy=LOW; # 密码安全级别低

set global validate_password_length=4; # 密码长度最低4位即可

# 然后就可以用简单密码了(课程中使用简单密码,为了方便,生产中不要这样)

ALTER USER 'root'@'localhost' IDENTIFIED BY 'root';

# 设置远程登录

grant all privileges on *.* to root@"%" identified by 'root' with grant option;

# 刷新

flush privileges;

1.3、步骤2:配置Hadoop

Hive的运行依赖于Hadoop(HDFS、MapReduce、YARN都依赖)。

同时涉及到HDFS文件系统的访问,所以需要配置Hadoop的代理用户。

即设置hadoop用户允许代理(模拟)其它用户。

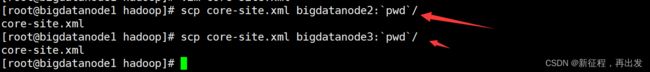

配置如下内容在Hadoop的core-site.xml中,并分发到其它节点,且重启HDFS集群

- 配置

<property>

<name>hadoop.proxyuser.hadoop.hostsname>

<value>*value>

property>

<property>

<name>hadoop.proxyuser.hadoop.groupsname>

<value>*value>

property>

stop-dfs.sh

start-dfs.sh

1.4、步骤3:下载解压Hive

- 切换到hadoop用户

su - hadoop

- 下载Hive安装包:

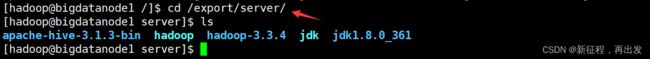

http://archive.apache.org/dist/hive/hive-3.1.3/apache-hive-3.1.3-bin.tar.gz - 解压到node1服务器的:/export/server/内

tar -zxvf apache-hive-3.1.3-bin.tar.gz -C /export/server/

- 设置软连接

ln -s /export/server/apache-hive-3.1.3-bin /export/server/hive

1.5、步骤4:提供MySQL Driver包

- 下载MySQL驱动包:

https://repo1.maven.org/maven2/mysql/mysql-connector-java/5.1.34/mysql-connector-java-5.1.34.jar - 将下载好的驱动jar包,放入:Hive安装文件夹的lib目录内

mv mysql-connector-java-5.1.34.jar /export/server/hive/lib/

1.6、步骤5:配置Hive

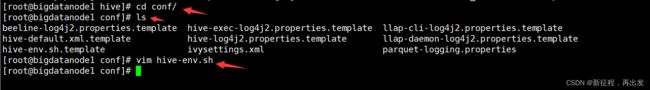

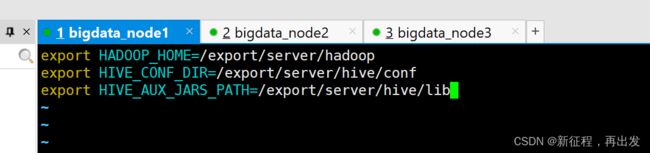

1.6.1、hive-env.sh文件

在Hive的conf目录内,新建hive-env.sh文件,填入以下环境变量内容:

export HADOOP_HOME=/export/server/hadoop

export HIVE_CONF_DIR=/export/server/hive/conf

export HIVE_AUX_JARS_PATH=/export/server/hive/lib

1.6.2、hive-site.xml

在Hive的conf目录内,新建hive-site.xml文件,填入以下内容:

连接数据库时,用户名和密码要对应自己mysql设置的

<configuration>

<property>

<name>javax.jdo.option.ConnectionURLname>

<value>jdbc:mysql://bigdatanode1:3306/hive?createDatabaseIfNotExist=true&useSSL=false&useUnicode=true&characterEncoding=UTF-8value>

property>

<property>

<name>javax.jdo.option.ConnectionDriverNamename>

<value>com.mysql.jdbc.Drivervalue>

property>

<property>

<name>javax.jdo.option.ConnectionUserNamename>

<value>rootvalue>

property>

<property>

<name>javax.jdo.option.ConnectionPasswordname>

<value>rootvalue>

property>

<property>

<name>hive.server2.thrift.bind.hostname>

<value>bigdatanode1value>

property>

<property>

<name>hive.metastore.urisname>

<value>thrift://bigdatanode1:9083value>

property>

<property>

<name>hive.metastore.event.db.notification.api.authname>

<value>falsevalue>

property>

configuration>

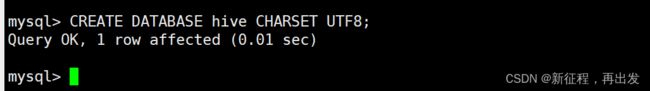

1.7、步骤6:初始化元数据库

支持Hive的配置已经完成,现在在启动Hive前,需要先初始化Hive所需的元数据库。

- 在MySQL中新建数据库:hive

CREATE DATABASE hive CHARSET UTF8;

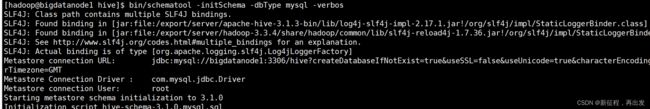

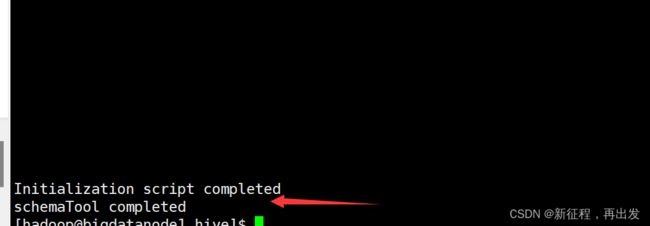

- 执行元数据库初始化命令:

cd /export/server/hive

bin/schematool -initSchema -dbType mysql -verbos

初始化成功后,会在MySQL的hive库中新建74张元数据管理的表。

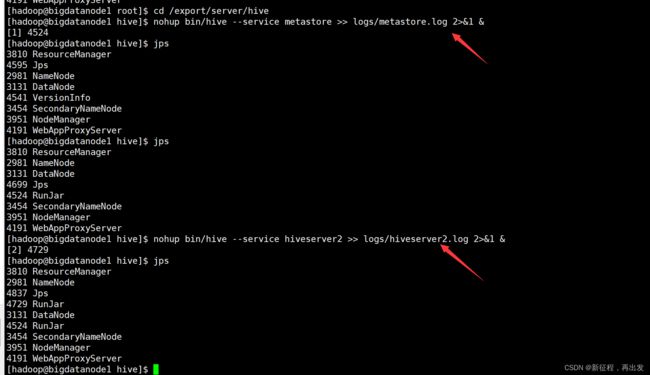

1.8、步骤7:启动Hive(使用Hadoop用户)

必须先启动hdfs和yarn

start-dfs.sh

start-yarn.sh

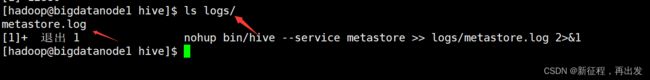

mkdir /export/server/hive/logs

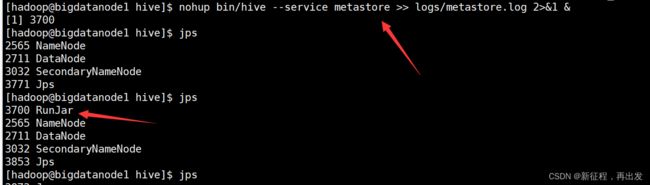

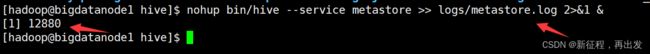

启动元数据管理服务(必须启动,否则无法工作)

- 前台启动:bin/hive --service metastore

- 后台启动:nohup bin/hive --service metastore >> logs/metastore.log 2>&1 &

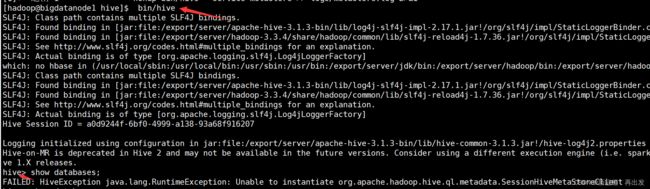

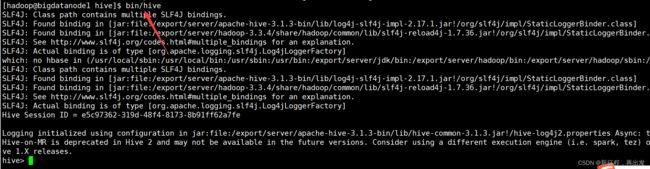

启动客户端,二选一(当前先选择Hive Shell方式)

- Hive Shell方式(可以直接写SQL): bin/hive

bin/hive

- Hive ThriftServer方式(不可直接写SQL,需要外部客户端链接使用): bin/hive --service hiveserver2

2、Hive体验

可以执行:bin/hive,进入到Hive Shell环境中,可以直接执行SQL语句。

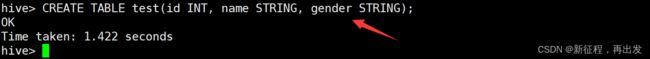

2.1、创建表

CREATE TABLE test(id INT, name STRING, gender STRING);

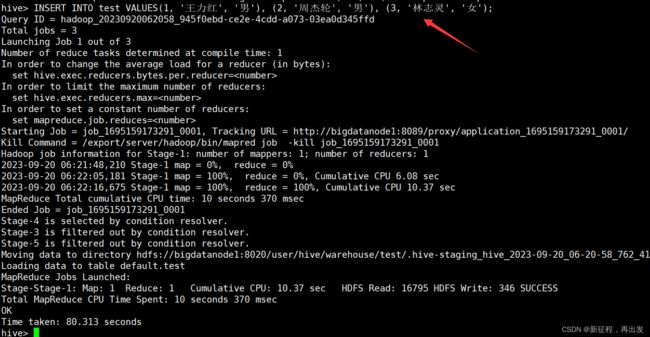

2.2、插入数据

INSERT INTO test VALUES(1, '王力红', '男'), (2, '周杰轮', '男'), (3, '林志灵', '女');

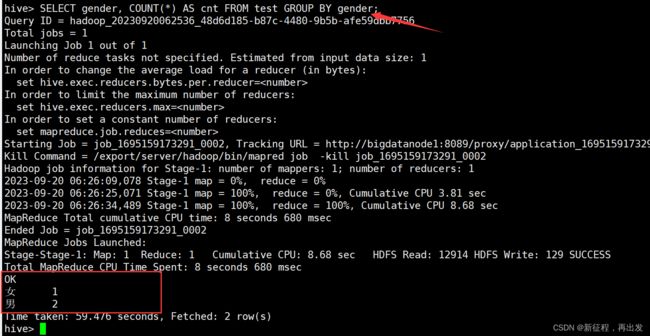

2.3、查询数据

SELECT gender, COUNT(*) AS cnt FROM test GROUP BY gender;

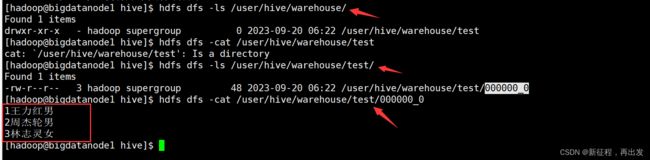

2.4、验证Hive的数据存储

Hive的数据存储在HDFS的:/user/hive/warehouse中

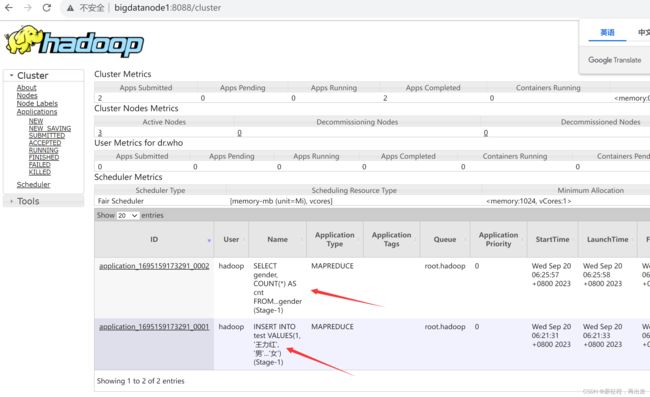

2.5、验证SQL语句启动的MapReduce程序

打开YARN的WEB UI页面查看任务情况:http://bigdatanode1:8088

3、hive客户端

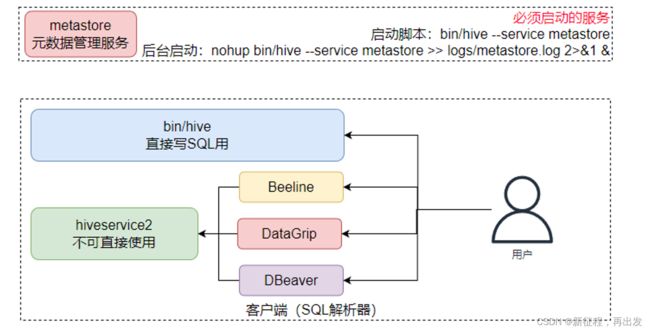

3.1、HiveServer2 & Beeline

3.1.1、HiveServer2服务

在启动Hive的时候,除了必备的Metastore服务外,有2种方式使用Hive:

- 方式1: bin/hive 即Hive的Shell客户端,可以直接写SQL

- 方式2: bin/hive --service hiveserver2

后台执行脚本:nohup bin/hive --service hiveserver2 >> logs/hiveserver2.log 2>&1 &

bin/hive --service metastore,启动的是元数据管理服务

bin/hive --service hiveserver2,启动的是HiveServer2服务

HiveServer2是Hive内置的一个ThriftServer服务,提供Thrift端口供其它客户端链接

可以连接ThriftServer的客户端有:

- Hive内置的 beeline客户端工具(命令行工具)

- 第三方的图形化SQL工具,如DataGrip、DBeaver、Navicat等

- 启动

在hive安装的服务器上,首先启动metastore服务,然后启动hiveserver2服务。

nohup bin/hive --service metastore >> logs/metastore.log 2>&1 &

nohup bin/hive --service hiveserver2 >> logs/hiveserver2.log 2>&1 &

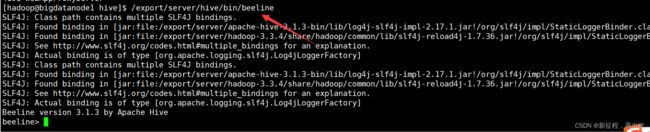

3.1.2、beeline

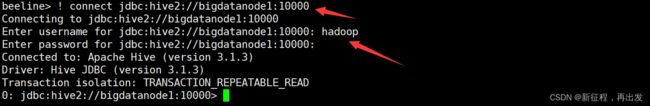

- 在node1上使用beeline客户端进行连接访问。需要注意hiveserver2服务启动之后需要稍等一会才可以对外提供服务。

- Beeline是JDBC的客户端,通过JDBC协议和Hiveserver2服务进行通信,协议的地址是:jdbc:hive2://node1:10000

/export/server/hive/bin/beeline

! connect jdbc:hive2://bigdatanode1:10000

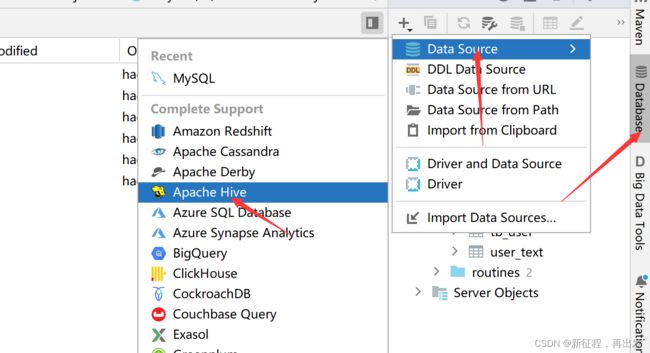

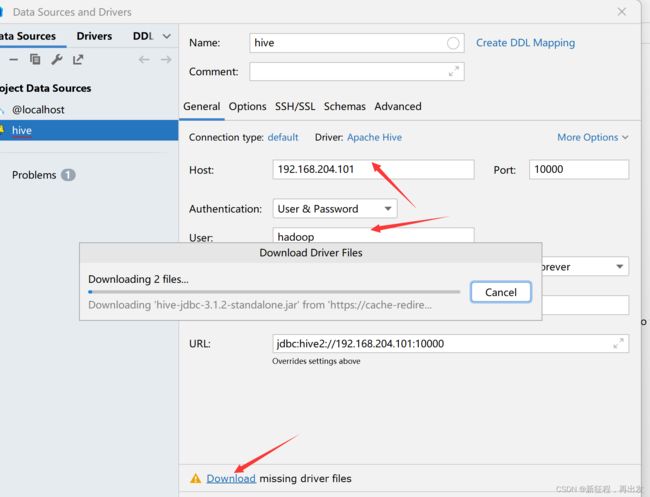

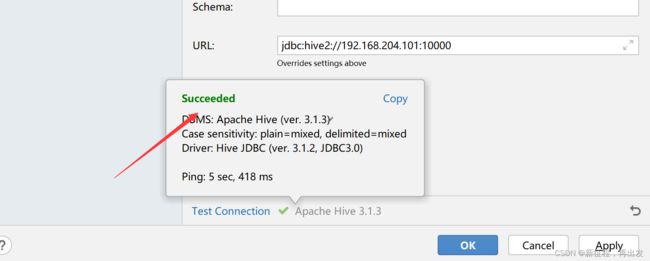

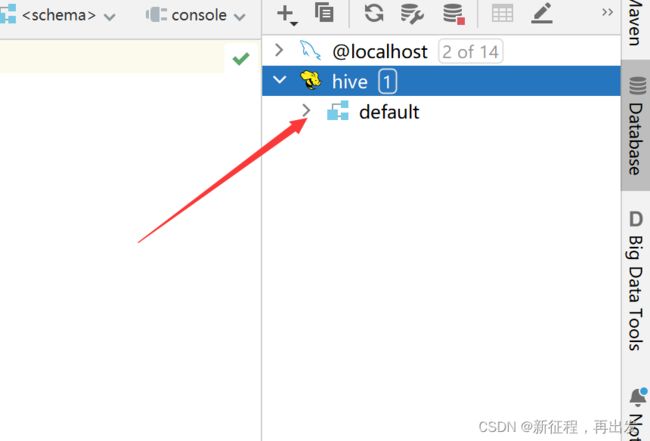

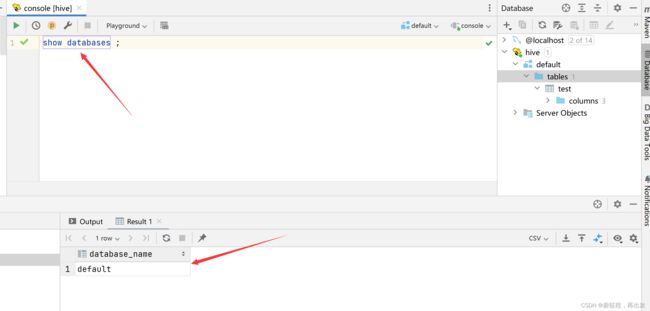

3.2、DataGrip & DBeaver

我这里用idea连接数据库

3.2.1、idea

3.2.2、DBeaver

DBeaver的连接都是差不多的,注意的是DBeaver的hive驱动要自己下载并引入,默认提供的不能用。

结束!!!!

hy:41

人所有的拖沓都是代表他并非真正热爱。