大数据技术——Hadoop3.X入门搭建+安装调优(2.HDFS)

文章目录

- 一、HDFS概述

-

- 1.1 HDFS产出背景及定义

- 1.2 HDFS优缺点

- 1.3 HDFS组成架构

- 1.4 HDFS文件块大小(面试重点)

- 二、HDFS的Shell操作(开发重点)

-

- 2.1 基本语法

- 2.2 命令大全

- 2.3 常用命令实操

-

- 2.3.1 准备工作

- 2.3.2 上传

- 2.3.3 下载

- 2.3.4 HDFS直接操作

- 三、HDFS的API操作

-

- 3.1 客户端环境准备

- 3.2 HDFS的API案例实操

-

- 3.2.1 HDFS文件上传(测试参数优先级)

- 3.2.2 HDFS文件下载

- 3.2.3 HDFS文件更名和移动

- 3.2.4 HDFS删除文件和目录

- 3.2.5 HDFS文件详情查看

- 3.2.6 HDFS文件和文件夹判断

- 3.2.7 封装之后的代码

- 四、HDFS的读写流程(面试重点)

-

- 4.1 HDFS写数据流程

-

- 4.1.1 剖析文件写入

- 4.1.2 网络拓扑-节点距离计算

- 4.1.3 机架感知(副本存储节点选择)

- 4.2 HDFS读数据流程

- 五、NameNode和SecondaryNameNode

-

- 5.1 NN和2NN工作机制

- 5.2 Fsimage和Edits解析

- 5.3 CheckPoint时间设置

- 六、DataNode

-

- 6.1 DataNode工作机制

- 6.2 数据完整性

- 6.3 掉线时限参数设置

一、HDFS概述

1.1 HDFS产出背景及定义

1 )HDFS 产生背景

随着数据量越来越大,在一个操作系统存不下所有的数据,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,迫切需要一种系统来管理多台机器上的文件,这就是分布式文件管理系统。HDFS 只是分布式文件管理系统中的一种。

2 )HDFS 定义

HDFS(Hadoop Distributed File System),它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

HDFS 的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。

1.2 HDFS优缺点

HDFS优点

1)高容错性

➢ 数据自动保存多个副本。它通过增加副本的形式,提高容错性。

2)适合处理大数据

➢ 数据规模:能够处理数据规模达到GB、TB、甚至PB级别的数据;

➢ 文件规模:能够处理百万规模以上的文件数量,数量相当之大。

3)可构建在廉价机器上,通过多副本机制,提高可靠性。

HDFS缺点

1)不适合低延时数据访问,比如毫秒级的存储数据,是做不到的。

2)无法高效的对大量小文件进行存储。

➢ 存储大量小文件的话,它会占用NameNode大量的内存来存储文件目录和

块信息。这样是不可取的,因为NameNode的内存总是有限的;

➢ 小文件存储的寻址时间会超过读取时间,它违反了HDFS的设计目标。

3)不支持并发写入、文件随机修改。

➢ 一个文件只能有一个写,不允许多个线程同时写;

➢ 仅支持数据append(追加),不支持文件的随机修改。

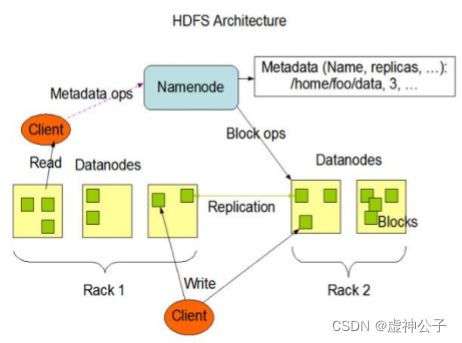

1.3 HDFS组成架构

1)NameNode(nn):就是Master,它是一个主管、管理者。

(1)管理HDFS的名称空间;

(2)配置副本策略;

(3)管理数据块(Block)映射信息;

(4)处理客户端读写请求。

2)DataNode:就是Slave。NameNode下达命令,DataNode执行实际的操作。

(1)存储实际的数据块;

(2)执行数据块的读/写操作。

3)Client:就是客户端。

(1)文件切分。文件上传HDFS的时候,Client将文件切分成一个一个的Block,然后进行上传;

(2)与NameNode交互,获取文件的位置信息;

(3)与DataNode交互,读取或者写入数据;

(4)Client提供一些命令来管理HDFS,比如NameNode格式化;

(5)Client可以通过一些命令来访问HDFS,比如对HDFS增删查改操作;

4)Secondary NameNode:并非NameNode的热备。当NameNode挂掉的时候,它并不能马上替NameNode并提供服务。

(1)辅助NameNode,分担其工作量,比如定期合并Fsimage和Edits,并推送给NameNode ;

(2)在紧急情况下,可辅助恢复NameNode。

1.4 HDFS文件块大小(面试重点)

HDFS中的文件在物理上是分块存储(Block),块的大小可以通过配置参数( dfs.blocksize)来规定,默认大小在Hadoop2.x/3.x版本中是128M,1.x版本中是64M。

思考:为什么块的大小不能设置太小,也不能设置太大?

(1)HDFS的块设置太小,会增加寻址时间,程序一直在找块的开始位置;

(2)如果块设置的太大,从磁盘传输数据的时间会明显大于定位这个块开始位置所需的时间。导致程序在处理这块数据时,会非常慢。

总结:HDFS块的大小设置主要取决于磁盘传输速率。

二、HDFS的Shell操作(开发重点)

2.1 基本语法

hadoop fs 具体命令 OR hdfs dfs 具体命令

两个是完全相同的。

2.2 命令大全

[xusheng@hadoop102 hadoop-3.1.3]$ bin/hadoop fs

[-appendToFile <localsrc> ... <dst>]

[-cat [-ignoreCrc] <src> ...]

[-chgrp [-R] GROUP PATH...]

[-chmod [-R] <MODE[,MODE]... | OCTALMODE> PATH...]

[-chown [-R] [OWNER][:[GROUP]] PATH...]

[-copyFromLocal [-f] [-p] <localsrc> ... <dst>]

[-copyToLocal [-p] [-ignoreCrc] [-crc] <src> ... <localdst>]

[-count [-q] <path> ...]

[-cp [-f] [-p] <src> ... <dst>]

[-df [-h] [<path> ...]]

[-du [-s] [-h] <path> ...]

[-get [-p] [-ignoreCrc] [-crc] <src> ... <localdst>]

[-getmerge [-nl] <src> <localdst>]

[-help [cmd ...]]

[-ls [-d] [-h] [-R] [<path> ...]]

[-mkdir [-p] <path> ...]

[-moveFromLocal <localsrc> ... <dst>]

[-moveToLocal <src> <localdst>]

[-mv <src> ... <dst>]

[-put [-f] [-p] <localsrc> ... <dst>]

[-rm [-f] [-r|-R] [-skipTrash] <src> ...]

[-rmdir [--ignore-fail-on-non-empty] <dir> ...]

<acl_spec> <path>]]

[-setrep [-R] [-w] <rep> <path> ...]

[-stat [format] <path> ...]

[-tail [-f] <file>]

[-test -[defsz] <path>]

[-text [-ignoreCrc] <src> ...]

2.3 常用命令实操

2.3.1 准备工作

1)启动 Hadoop 集群(方便后续的测试)

[xusheng@hadoop102 hadoop-3.1.3]$ sbin/start-dfs.sh

[xusheng@hadoop103 hadoop-3.1.3]$ sbin/start-yarn.sh

2)-help:输出这个命令参数

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -help rm

3)创建/sanguo 文件夹

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -mkdir /sanguo

2.3.2 上传

1)-moveFromLocal:从本地剪切粘贴到 HDFS

[xusheng@hadoop102 hadoop-3.1.3]$ vim shuguo.txt

输入:

shuguo

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -moveFromLocal ./shuguo.txt /sanguo

2)-copyFromLocal:从本地文件系统中拷贝文件到 HDFS 路径去

[xusheng@hadoop102 hadoop-3.1.3]$ vim weiguo.txt

输入:

weiguo

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -copyFromLocal weiguo.txt /sanguo

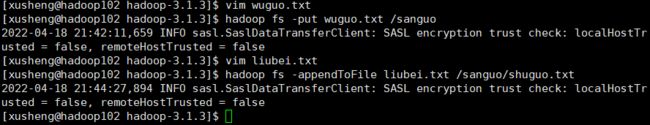

3)-put:等同于 copyFromLocal,生产环境更习惯用 put

[xusheng@hadoop102 hadoop-3.1.3]$ vim wuguo.txt

输入:

wuguo

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -put ./wuguo.txt /sanguo

4)-appendToFile:追加一个文件到已经存在的文件末尾

[xusheng@hadoop102 hadoop-3.1.3]$ vim liubei.txt

输入:

liubei

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -appendToFile liubei.txt /sanguo/shuguo.txt

2.3.3 下载

1)-copyToLocal:从 HDFS 拷贝到本地

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -copyToLocal /sanguo/shuguo.txt ./

2)-get:等同于 copyToLocal,生产环境更习惯用 get

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -get /sanguo/shuguo.txt ./shuguo2.txt

2.3.4 HDFS直接操作

1)-ls: 显示目录信息

[xusheng@hadoop102 hadoop-3.1.3]$ hadoop fs -ls /sanguo

2)-cat:显示文件内容

[xusheng@hadoop102 hadoop-3.1.3]$