Docker网络与资源控制

Docker网络与资源控制

- 一、Docker网络模式

-

- 1.1、Docker网络实现原理

- 1.2、Docker的网络模式

-

- 1.2.1、host模式

- 1.2.2、Container模式

- 1.2.3、None模式

- 1.2.4、 Bridge模式

- 1.2.5、自定义网络

- 二、资源控制

-

- 2.1、CPU 资源控制

-

- 2.1.1、设置CPU使用率上限

- 2.1.2、进行CPU压力测试

- 2.1.3、设置CPU资源占用比(设置多个容器时才有效)

- 2.1.4、设置容器绑定指定的CPU

- 2.2、对内存使用的限制

- 2.3、限制可用的 swap 大小, --memory-swap

- 2.4、对磁盘IO配额控制(blkio)的限制

一、Docker网络模式

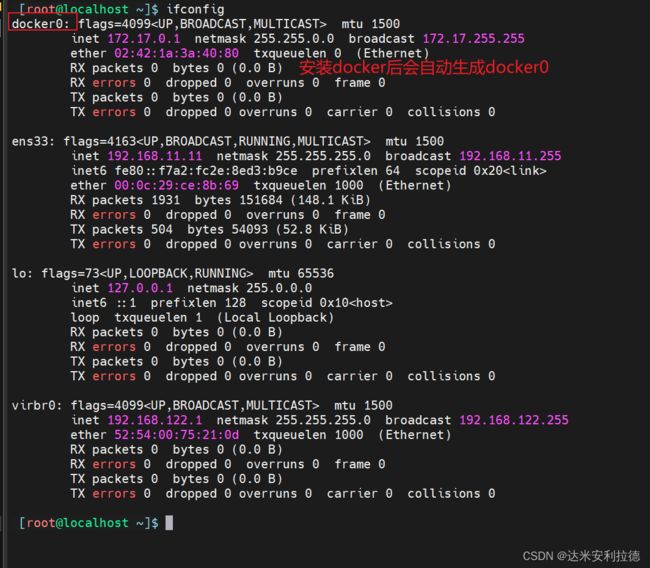

1.1、Docker网络实现原理

-

Docker使用Linux桥接,在宿主机虚拟一个Docker容器网桥(docker0,网桥就是交换机), Docker启动一个容器时会根据Docker网桥的网段分配给容器一个IP地址,称为Container-IP,同时Docker网桥是每个容器的默认网关。

-

因为在同一宿主机内的容器都接入同一个网桥,这样容器之间就能够通过容器的 Container-IP 直接通信。

-

Docker网桥是宿主机虚拟出来的,并不是真实存在的网络设备,外部网络是无法寻址到的,这也意味着外部网络无法直接通过 Container-IP 访问到容器。

-

如果容器希望外部访问能够访问到,可以通过映射容器端口到宿主主机(端口映射),即 docker run 创建容器时候通过 -p 或 -P 参数来启用,访问容器的时候就通过[宿主机IP]:[容器端口]访问容器。

1.2、Docker的网络模式

1.2.1、host模式

容器将不会虚拟出自己的网卡,配置自己的IP等,而是使用宿主机的IP和端口。

1.2.2、Container模式

Container:创建的容器不会创建自己的网卡,配置自己的IP,而是和一个指定的容器共享IP、端口范围。

1.2.3、None模式

该模式关闭了容器的网络功能。

1.2.4、 Bridge模式

docker默认为该模式,此模式会为每一个容器分配、设置IP等,并将容器连接到一个docker0虚拟网桥,通过docker0网桥以及iptables nat 表配置与宿主机通信。

1.2.5、自定义网络

可以自定义创建一个网段、网桥、网络模式,从而可自定义容器IP来创建容器

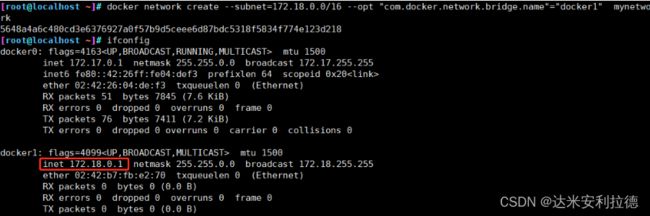

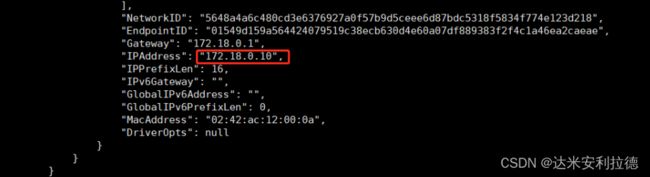

```dart

docker network create --subnet=172.18.0.0/16 --opt "com.docker.network.bridge.name"="docker1" mynetwork

docker network create --subnet=新IP网段 --opt "com.docker.network.bridqe.name"="新网桥名称” 新网络模式名称

docker1 为执行 ifconfig -a 命令时,显示的网卡名,如果不使用 --opt 参数指定此名称,那你在使用 ifconfig -a 命令查看网络信息时,看到的是类似 br-110eb56a0b22 这样的名字,这显然不怎么好记。

mynetwork 为执行 docker network list 命令时,显示的bridge网络模式名称。

docker run -itd --name c4 --net mynetwork --ip 172.18.0.10 centos:7 /bin/bash

docker run --network=新网络模式名称 --ip 自定义IP镜像:标签[启动命令]

docker inspect c4

二、资源控制

- Docker 通过 Cgroup 来控制容器使用的资源配额,包括 CPU、内存、磁盘三大方面, 基本覆盖了常见的资源配额和使用量控制。

- Cgroup 是 ControlGroups 的缩写,是 Linux 内核提供的一种可以限制、记录、隔离进程组所使用的物理资源(如 CPU、内存、磁盘 IO 等等) 的机制,被 LXC、docker 等很多项目用于实现进程资源控制。

- Cgroup 本身是提供将进程进行分组化管理的功能和接口的基础结构,I/O 或内存的分配控制等具体的资源管理是通过该功能来实现的。

2.1、CPU 资源控制

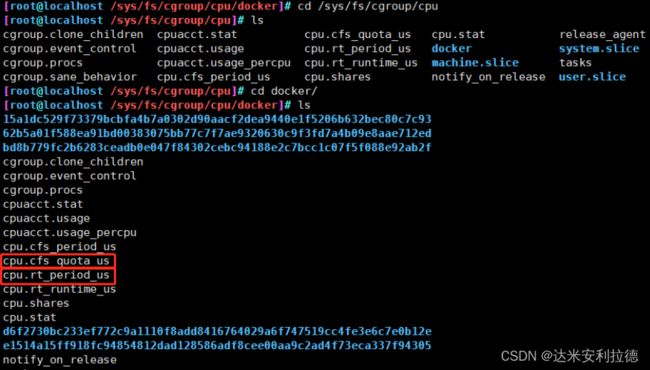

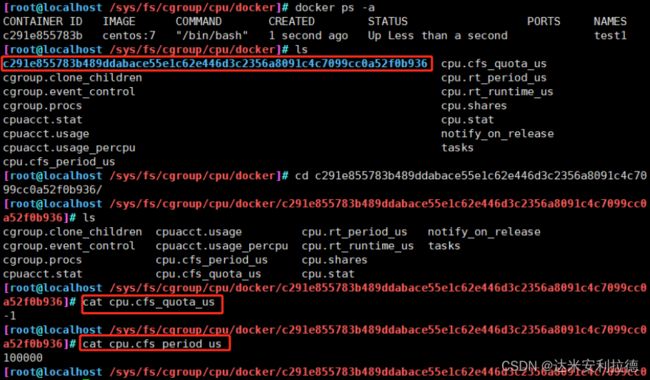

2.1.1、设置CPU使用率上限

- Linux通过CFS(Completely Fair Scheduler,完全公平调度器)来调度各个进程对CPU的使用。

- CFS默认的调度周期是100ms。

- 我们可以设置每个容器进程的调度周期,以及在这个周期内各个容器最多能使用多少 CPU 时间。

使用 --cpu-period 即可设置调度周期,使用 --cpu-quota 即可设置在每个周期内容器能使用的CPU时间。两者可以配合使用

#CFS 周期的有效范围是 1ms~1s,对应的 --cpu-period 的数值范围是 1000~1000000。

而容器的 CPU 配额必须不小于 1ms,即 --cpu-quota 的值必须 >= 1000。

#cpu.cfs_period_us:cpu分配的周期(微秒,所以文件名中用 us 表示),默认为100000。

#cpu.cfs_quota_us:表示该cgroups限制占用的时间(微秒),默认为-1,表示不限制。 如果设为50000,表示占用50000/100000=50%的CPU。

2.1.2、进行CPU压力测试

docker exec -it 3ed82355f811 /bin/bash

vim /cpu.sh

#!/bin/bash

i=0

while true

do

let i++

done

chmod +x /cpu.sh

./cpu.sh

top #可以看到这个脚本占了很多的cpu资源

#设置50%的比例分配CPU使用时间上限

docker run -itd --name test6 --cpu-quota 50000 centos:7 /bin/bash #可以重新创建一个容器并设置限额

或者

cd /sys/fs/cgroup/cpu/docker/3ed82355f81151c4568aaa6e7bc60ba6984201c119125360924bf7dfd6eaa42b/

echo 50000 > cpu.cfs_quota_us

docker exec -it 3ed82355f811 /bin/bash

./cpu.sh

top #可以看到cpu占用率接近50%,cgroups对cpu的控制起了效果

#在多核情况下,如果允许容器进程完全占用两个 CPU, 则可以将 cpu-period 设置为 100000( 即 0.1 秒), cpu-quota设置为 200000(0.2 秒)。

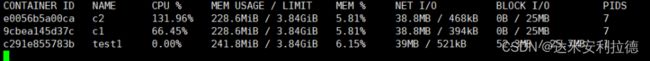

2.1.3、设置CPU资源占用比(设置多个容器时才有效)

Docker 通过 --cpu-shares 指定 CPU 份额,默认值为1024,值为1024的倍数。

创建两个容器为 c1 和 c2,若只有这两个容器,设置容器的权重,使得c1和c2的CPU资源占比为1/3和2/3

docker run -itd --name c1 --cpu-shares 512 centos:7

docker run -itd --name c2 --cpu-shares 1024 centos:7

分别进入容器,进行压力测试

yum install -y epel-release

yum install -y stress

stress -c 4 #产生四个进程,每个进程都反复不停的计算随机数的平方根

查看容器运行状态(动态更新)

docker stats

可以看到在 CPU 进行时间片分配的时候,容器 c2 比容器 c1 多一倍的机会获得 CPU 的时间片。

但分配的结果取决于当时主机和其他容器的运行状态, 实际上也无法保证容器 c1 一定能获得 CPU 时间片。

比如容器 c1 的进程一直是空闲的,那么容器 c2 是可以获取比容器 c1 更多的 CPU 时间片的。极端情况下,例如主机上只运行了一个容器,即使它的 CPU 份额只有 50,它也可以独占整个主机的 CPU 资源。

Cgroups 只在容器分配的资源紧缺时,即在需要对容器使用的资源进行限制时,才会生效。

因此,无法单纯根据某个容器的 CPU 份额来确定有多少 CPU 资源分配给它,资源分配结果取决于同时运行的其他容器的 CPU 分配和容器中进程运行情况。

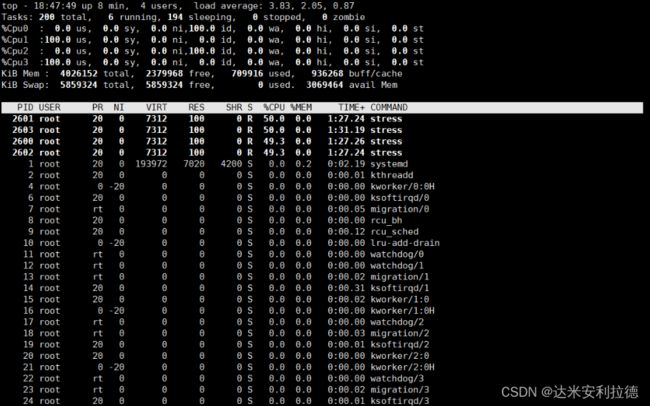

2.1.4、设置容器绑定指定的CPU

先分配虚拟机4个CPU核数

docker run -itd --name test7 --cpuset-cpus 1,3 centos:7 /bin/bash

进入容器,进行压力测试

yum install -y epel-release

yum install stress -y

stress -c 4

2.2、对内存使用的限制

#-m(--memory=) 选项用于限制容器可以使用的最大内存

docker run -itd --name test8 -m 512m centos:7 /bin/bash

docker stats

2.3、限制可用的 swap 大小, --memory-swap

强调一下,--memory-swap 是必须要与 --memory 一起使用的。

正常情况下,--memory-swap 的值包含容器可用内存和可用 swap。

所以 -m 300m --memory-swap=1g 的含义为:容器可以使用 300M 的物理内存,并且可以使用 700M(1G - 300)的 swap。

如果 --memory-swap 设置为 0 或者 不设置,则容器可以使用的 swap 大小为 -m 值的两倍。

如果 --memory-swap 的值和 -m 值相同,则容器不能使用 swap。

如果 --memory-swap 值为 -1,它表示容器程序使用的内存受限,而可以使用的 swap 空间使用不受限制(宿主机有多少 swap 容器就可以使用多少)。

2.4、对磁盘IO配额控制(blkio)的限制

--device-read-bps:限制某个设备上的读速度bps(数据量),单位可以是kb、mb(M)或者gb。

例:docker run -itd --name test9 --device-read-bps /dev/sda:1M centos:7 /bin/bash

--device-write-bps : 限制某个设备上的写速度bps(数据量),单位可以是kb、mb(M)或者gb。

例:docker run -itd --name test10 --device-write-bps /dev/sda:1mb centos:7 /bin/bash

--device-read-iops :限制读某个设备的iops(次数)

--device-write-iops :限制写入某个设备的iops(次数)

创建容器,并限制写速度

docker run -it --name test10 --device-write-bps /dev/sda:1mb centos:7 /bin/bash

通过dd来验证写速度

dd if=/dev/zero of=test.out bs=1M count=10 oflag=direct #添加oflag参数以规避掉文件系统cache

10+0 records in

10+0 records out

10485760 bytes (10 MB) copied, 10.0025 s, 1.0 MB/s

清理docker占用的磁盘空间

docker system prune -a #可以用于清理磁盘,删除关闭的容器、无用的数据卷和网络