- 开源模型应用落地-Qwen2-VL-7B-Instruct-vLLM-OpenAI API Client调用

开源技术探险家

开源大语言模型-新手试炼深度学习AI编程AIGC

一、前言学习Qwen2-VL,为我们打开了一扇通往先进人工智能技术的大门。让我们能够深入了解当今最前沿的视觉语言模型的工作原理和强大能力。这不仅拓宽了我们的知识视野,更让我们站在科技发展的潮头,紧跟时代的步伐。Qwen2-VL具有卓越的图像和视频理解能力,以及多语言支持等特性。学习它可以提升我们处理复杂视觉信息的能力,无论是在学术研究中分析图像数据、解读视频内容,还是在实际工作中进行文档处理、解决

- ChatGPT、DeepSeek、Grok 三者对比:AI 语言模型的博弈与未来

一ge科研小菜菜

人工智能人工智能

个人主页:一ge科研小菜鸡-CSDN博客期待您的关注1.引言随着人工智能技术的飞速发展,AI语言模型已经成为人机交互、内容创作、代码生成、智能问答等领域的重要工具。其中,ChatGPT(OpenAI)、DeepSeek(中国团队研发)和Grok(xAI,ElonMusk旗下公司)是当前三大具有代表性的AI语言模型。它们在技术架构、应用场景、用户体验、生态开放性等多个维度各具特色,并针对不同的用户需

- 【go从入门到精通】探秘struct结构体转json为什么需要首字母大写?

前网易架构师-高司机

golang从入门到精通golangjsongo结构体首字母大写golang从入门到精通go从入门到精通

目录作者简介:问题抛出分析结论作者简介:高科,先后在IBMPlatformComputing从事网格计算,淘米网,网易从事游戏服务器开发,拥有丰富的C++,go等语言开发经验,mysql,mongo,redis等数据库,设计模式和网络库开发经验,对战棋类,回合制,moba类页游,手游有丰富的架构设计和开发经验。并且深耕深度学习和数据集训练,提供商业化的视觉人工智能检测和预警系统(煤矿,工厂,制造业

- 【动手学深度学习】#1PyTorch基础操作

-一杯为品-

机器学习深度学习人工智能

主要参考学习资料:《动手学深度学习》阿斯顿·张等著【动手学深度学习PyTorch版】哔哩哔哩@跟李牧学AI目录1.1数据操作1.1.1入门1.1.2运算符1.1.3广播机制1.1.4索引和切片1.1.5节省内存1.1.6转换为其他Python对象1.2数据预处理1.2.1读取数据集1.2.2处理缺失值1.2.3转换为张量格式1.3线性代数1.3.1标量1.3.2向量1.3.3矩阵1.3.4张量1.

- 为什么转行大模型行业?深度解析职业变革与技术红利

大模型入门教程

大模型学习语言模型人工智能AI大模型程序员大模型入门

引言2023年ChatGPT的爆发式发展,标志着AI大模型技术正式进入大众视野。这一技术不仅重塑了人工智能的边界,更催生了全新的职业赛道。从传统算法工程师到互联网从业者,越来越多的人开始将目光投向大模型领域。本文将深入探讨这一现象背后的核心动因,并结合行业现状、技术趋势与职业发展路径,为从业者提供系统性分析。一、行业变革:传统岗位萎缩与大模型崛起传统技术岗位的困境以推荐算法为例,随着移动互联网流量

- DeepSeek 与云原生后端:AI 赋能现代应用架构

一ge科研小菜菜

后端人工智能后端

个人主页:一ge科研小菜鸡-CSDN博客期待您的关注1.引言在当今快速发展的互联网时代,云原生(CloudNative)架构已成为后端开发的主流趋势。云原生后端的核心目标是利用云计算的弹性、可扩展性和高可用性,为现代应用提供稳定可靠的后端支持。而人工智能(AI)技术的发展,使得智能化成为云原生后端的新趋势。DeepSeek作为新一代AI技术,在云原生后端的自动化运维、智能资源调度、安全增强和高效数

- 【Attention】SEAttention

shanks66

Attention各种深度学习模块人工智能深度学习python

SEAttention摘要卷积神经网络(CNNs)的核心构建模块是卷积算子,它使网络能够通过在每一层的局部感受野内融合空间和通道信息来构建有价值的特征。此前大量研究聚焦于这种关系中的空间成分,试图通过在整个特征层级中提升空间编码质量来增强CNN的表征能力。在这项工作中,我们将重点放在通道关系上,并提出一种新颖的架构单元,称为“挤压与激励”(Squeeze-and-Excitation,简称SE)模

- AI 大模型应用数据中心建设:高性能计算与存储架构

AI智能涌现深度研究

AI大模型应用入门实战与进阶javapythonjavascriptkotlingolang架构人工智能

AI大模型、数据中心、高性能计算、存储架构、分布式训练、GPU加速、数据管理1.背景介绍近年来,人工智能(AI)技术取得了飞速发展,特别是深度学习模型的突破性进展,催生了一系列基于大规模数据训练的强大AI模型,例如GPT-3、BERT、DALL-E等。这些AI大模型在自然语言处理、计算机视觉、语音识别等领域展现出强大的应用潜力,但也对计算资源和数据存储提出了极高的要求。传统的计算架构难以满足AI大

- 人工智能直通车系列24【机器学习基础】(机器学习模型评估指标(回归))

浪九天

人工智能直通车开发语言python机器学习深度学习神经网络人工智能

目录机器学习模型评估指标(回归)1.均方误差(MeanSquaredError,MSE)2.均方根误差(RootMeanSquaredError,RMSE)3.平均绝对误差(MeanAbsoluteError,MAE)4.决定系数(CoefficientofDetermination,R2)机器学习模型评估指标(回归)1.均方误差(MeanSquaredError,MSE)详细解释均方误差是回归问

- 国央企AI落地:以智能客服系统为突破口的详细实施方案探讨

数商云网络

B2B系统数字化电商平台人工智能大数据架构java微服务spring

一、引言随着人工智能(AI)技术的飞速发展和广泛应用,国央企作为国民经济的重要支柱,正积极探索AI技术在企业管理、业务运营等方面的应用。智能客服系统作为AI技术的一个重要应用领域,具有提升服务效率、增强用户体验、降低运营成本等显著优势,成为国央企AI落地的重要突破口。本文将详细探讨国央企如何以智能客服系统为突破口,实施AI技术的落地应用,并结合数商云在智能客服系统领域的实践经验,为国央企提供一套切

- CSDN社区,到底该不该用DeepSeek AI生成文章?

Small踢倒coffee_氕氘氚

python经验分享

##引言在当今数字化时代,人工智能(AI)技术正以惊人的速度发展,逐渐渗透到各个行业和领域。作为AI技术的一个重要分支,自然语言处理(NLP)在内容创作、文本生成等方面展现出了巨大的潜力。DeepSeekAI作为一款先进的AI写作工具,能够自动生成高质量的文章,极大地提高了内容创作的效率。然而,随着AI生成内容的普及,CSDN社区中的开发者、技术爱好者和内容创作者们开始思考一个问题:我们到底该不该

- AI大模型从入门到精通,2025终极指南!好卷啊,又不能躺平,只能悄悄卷你们了!

大模型教程

人工智能大模型训练LLM知识库大模型大模型入门大模型学习

什么是AI大模型?AI大模型是指使用大规模数据和强大的计算能力训练出来的人工智能模型。这些模型通常具有高度的准确性和泛化能力,可以应用于各种领域,如自然语言处理、图像识别、语音识别等。为什么要学AI大模型?2024人工智能大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用,大模型作为其中的重要组成部分,正逐渐成为推动人工智能发展的重要引擎。大模型以其强大的数据处理和模式识别能力,广泛应用于

- Transformer 架构深度剖析

时光旅人01号

人工智能技术科普transformer深度学习人工智能condaopencv计算机视觉

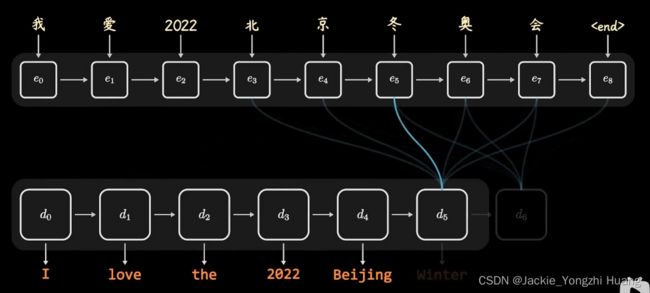

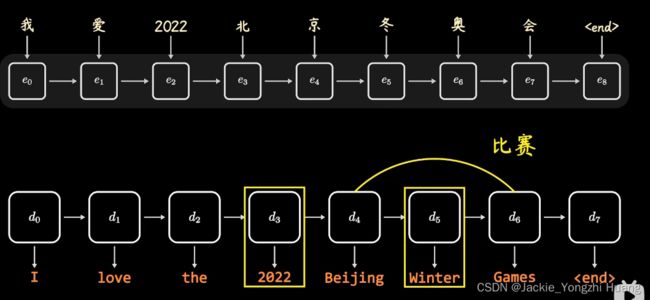

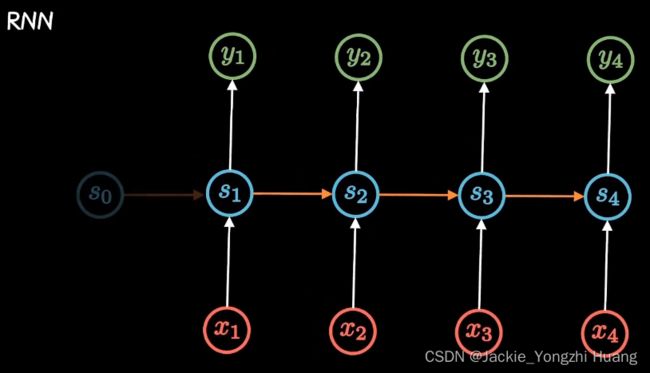

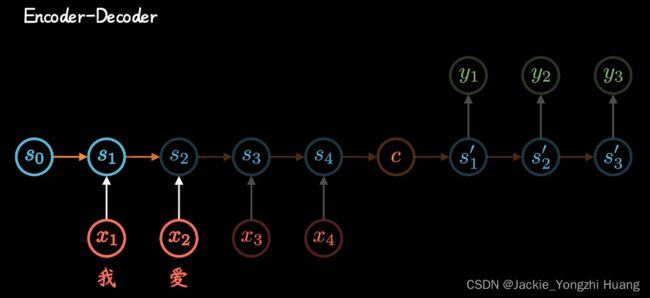

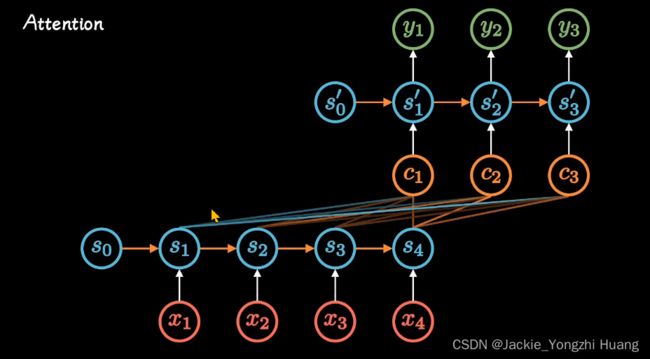

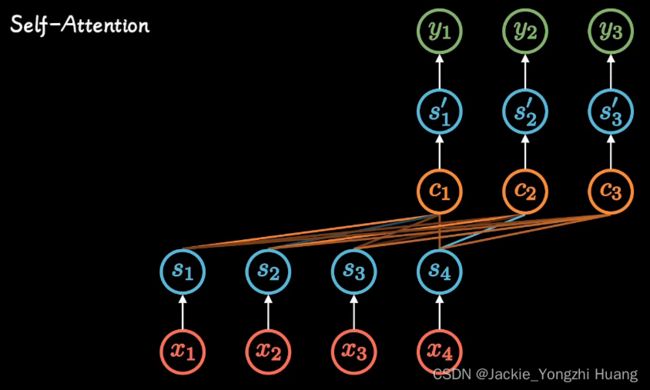

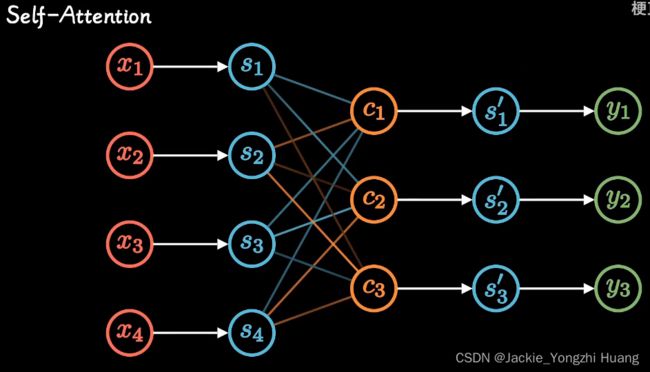

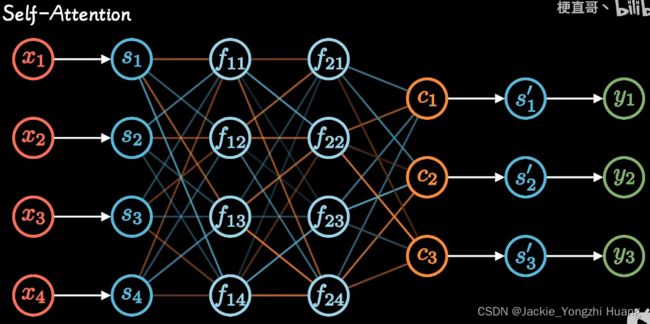

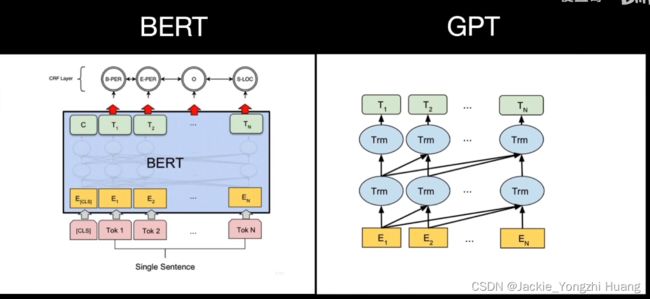

一、Transformer架构核心设计1.1整体架构Transformer由编码器(Encoder)和解码器(Decoder)堆叠而成,每个层包含:多头自注意力(Multi-HeadSelf-Attention)前馈网络(Feed-ForwardNetwork,FFN)残差连接(ResidualConnection)和层归一化(LayerNorm)关键特性:完全基于注意力机制,摒弃了循环和卷积结构

- AI大模型学习路线:从入门到精通的完整指南【2025最新】

AI大模型-大飞

人工智能学习大模型LLMAI程序员大模型学习

引言近年来,以GPT、BERT、LLaMA等为代表的AI大模型彻底改变了人工智能领域的技术格局。它们不仅在自然语言处理(NLP)任务中表现卓越,还在计算机视觉、多模态交互等领域展现出巨大潜力。本文旨在为开发者、研究者和技术爱好者提供一条清晰的学习路径,帮助读者逐步掌握大模型的核心技术并实现实际应用。一、基础阶段:构建知识体系数学与理论基础线性代数:矩阵运算、特征值与奇异值分解是大模型参数优化的基础

- Python与Web 3.0:重新定义数字身份验证的未来

Echo_Wish

Python!实战!python前端开发语言

Python与Web3.0:重新定义数字身份验证的未来随着Web3.0的迅猛发展,传统的身份验证方式正面临越来越大的挑战。从依赖中心化服务器存储用户数据,到如今去中心化、用户掌控数据的新时代,身份验证系统经历了前所未有的变革。而作为一个人工智能、区块链和Python技术的深度爱好者,我认为Python将成为构建Web3.0身份验证系统的重要工具。今天,我们就来聊聊如何结合Python与Web3.0

- 大模型和数据要素赋能实体零售行业数字化转型建设和实施方案

优享智库

大模型数据要素数据治理数据仓库主数据零售

大模型和数据要素赋能实体零售行业数字化转型建设和实施方案更多参考公众号:优享智库引言项目背景与意义数字化转型目标与期望实施方案概述零售行业现状及挑战实体零售行业现状数字化转型面临的挑战市场需求与趋势分析大模型与数据要素赋能策略大模型技术及应用场景数据要素采集、整合与治理赋能策略制定与实施路径数字化转型关键技术与解决方案人工智能技术及应用大数据分析与挖掘技术云计算、物联网等技术支持定制化解决方案设计

- 从LLM出发:由浅入深探索AI开发的全流程与简单实践(全文3w字)

码事漫谈

AI人工智能

文章目录第一部分:AI开发的背景与历史1.1人工智能的起源与发展1.2神经网络与深度学习的崛起1.3Transformer架构与LLM的兴起1.4当前AI开发的现状与趋势第二部分:AI开发的核心技术2.1机器学习:AI的基础2.1.1机器学习的类型2.1.2机器学习的流程2.2深度学习:机器学习的进阶2.2.1神经网络基础2.2.2深度学习的关键架构2.3Transformer架构:现代LLM的核

- 我们的AI人工智能,自动发布了一篇假新闻……

数据断案

数据人的故事人工智能数据库sqloracle数据分析

今天这个故事,还得从一个事故开始说起。前些日子,我们被XX公司投诉,说我们的资讯发布了关于他们公司授信额度的不实报道:告诉我们这篇资讯与他们公司最新公开披露的数据不一致,相关内容并不属实,可能对广大网友们造成严重误导,并对他们公司造成了严重负面影响……balabala一堆指责,并要求我们3小时内删除全部相关信息。然后,他们丢了2篇公告附件过来。我们对照着仔细一看,还真是我们搞错了:由于数据错误,“

- 深入解析两大AI模型的架构与功能

草莓屁屁我不吃

人工智能chatgpt

在人工智能(AI)领域,自然语言处理(NLP)一直是研究的热点之一。随着技术的不断进步,我们见证了从简单的聊天机器人到复杂语言模型的演变。其中,Google的Gemini和OpenAI的ChatGPT作为两大代表性模型,各自在技术和应用上展现出了卓越的性能。本文将详细解析Gemini和ChatGPT的系统架构、功能特性及其背后的技术原理。Gemini模型详解技术背景与架构Gemini,顾名思义,意

- 建立高质量个人数据库:解锁DeepSeek的关键

CodeJourney.

人工智能算法python

在人工智能飞速发展的时代,DeepSeek为普通人处理数据、提升工作效率带来了新的可能。然而,很多人在使用过程中存在误区,本文围绕如何正确利用DeepSeek搭建高质量个人数据库展开探讨,强调其对个人成长和发展的重要性,并通过具体实例展示其强大功能。重新理解DeepSeekDeepSeek的普及使普通人能够轻松搭建个人数据库,但不少人在使用时存在错误认知。他们将DeepSeek视为主角,把杂乱无章

- 如何减少跨团队交付摩擦?——基于 DevOps 与敏捷的最佳实践

网罗开发

实战实战源码devops运维

网罗开发(小红书、快手、视频号同名) 大家好,我是展菲,目前在上市企业从事人工智能项目研发管理工作,平时热衷于分享各种编程领域的软硬技能知识以及前沿技术,包括iOS、前端、HarmonyOS、Java、Python等方向。在移动端开发、鸿蒙开发、物联网、嵌入式、云原生、开源等领域有深厚造诣。图书作者:《ESP32-C3物联网工程开发实战》图书作者:《SwiftUI入门,进阶与实战》超级个体:CO

- java实现卷积神经网络CNN(附带源码)

Katie。

Java实战项目java

Java实现卷积神经网络(CNN)项目详解目录项目概述1.1项目背景与意义1.2什么是卷积神经网络(CNN)1.3卷积神经网络的应用场景相关知识与理论基础2.1神经网络与深度学习概述2.2卷积操作与卷积层原理2.3激活函数与池化层2.4全连接层与损失函数2.5前向传播、反向传播与梯度下降项目需求与分析3.1项目目标3.2功能需求分析3.3性能与扩展性要求3.4异常处理与鲁棒性考虑系统设计与实现思路

- 展望 AIGC 前景:通义万相 2.1 与蓝耘智算平台共筑 AI 生产力高地

accurater

AIGC人工智能神经网络深度学习

喜欢可以到主页订阅专栏引言人工智能生成内容(AIGC)技术正在重塑内容创作、影视制作、广告设计等行业的底层逻辑。作为该领域的革命性技术代表,通义万相2.1凭借其开源特性、多模态生成能力和技术突破,成为全球视频生成模型的标杆。而蓝耘智算平台则通过高性能算力支持与分布式架构优化,为AIGC技术的规模化应用提供了基础设施保障。两者的协同不仅推动了AI生产力的跃迁,更开启了从技术研发到商业落地的全链条创新

- Python编码系列—Python代码重构:提升代码质量

学步_技术

Python编码python重构开发语言

欢迎来到我的技术小筑,一个专为技术探索者打造的交流空间。在这里,我们不仅分享代码的智慧,还探讨技术的深度与广度。无论您是资深开发者还是技术新手,这里都有一片属于您的天空。让我们在知识的海洋中一起航行,共同成长,探索技术的无限可能。探索专栏:学步_技术的首页——持续学习,不断进步,让学习成为我们共同的习惯,让总结成为我们前进的动力。技术导航:人工智能:深入探讨人工智能领域核心技术。自动驾驶:分享自动

- 从0到1构建AI深度学习视频分析系统--基于YOLO 目标检测的动作序列检查系统:(2)消息队列与消息中间件

shiter

人工智能系统解决方案与技术架构人工智能深度学习音视频

文章大纲原始视频队列Python内存视频缓存优化方案(4GB以内)一、核心参数设计二、内存管理实现三、性能优化策略四、内存占用验证五、高级优化技巧六、部署建议检测结果队列YOLO检测结果队列技术方案一、技术选型矩阵二、核心实现代码三、性能优化策略四、可视化方案对比五、部署建议逻辑判定队列时间片图论时间序列大模型引入参考文献原始视频队列想要在单机内存中缓存1-5分钟的视频片段,python技术栈的话

- 【人工智能】Model Context Protocol (MCP) 是一个开放协议,标准化了应用程序向大型语言模型(LLMs)提供上下文的方式

本本本添哥

013-AIGC人工智能大模型人工智能语言模型php

一、ModelContextProtocol(MCP)概述MCP,ModelContextProtocolMCP,是一个开放协议。MCP,标准化了应用程序向大型语言模型(LLMs)提供上下文的方式。MCP,旨在标准化应用程序如何为大型语言模型(LLM)提供上下文信息。MCP,提供了一个标准的接口,使得LLM可以无缝集成各种外部数据源和工具,从而扩展其能力和应用场景。二、MCP的定义和作用MCP定

- 从零开始大模型开发与微调:PyCharm的下载与安装

AI天才研究院

AI大模型企业级应用开发实战AI大模型应用入门实战与进阶DeepSeekR1&大数据AI人工智能大模型计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

从零开始大模型开发与微调:PyCharm的下载与安装1.背景介绍随着人工智能和深度学习技术的不断发展,大型语言模型(LargeLanguageModels,LLMs)已经成为当前最引人注目的研究热点之一。LLMs能够在各种自然语言处理任务上展现出惊人的性能,例如机器翻译、文本生成、问答系统等。PyTorch和TensorFlow等深度学习框架为训练和微调大型语言模型提供了强大的支持。PyCharm

- 遗传算法与深度学习实战(2)——生命模拟及其应用

盼小辉丶

遗传算法与深度学习实战深度学习人工智能遗传算法

遗传算法与深度学习实战(2)——生命模拟及其应用0.前言1.康威生命游戏1.1康威生命游戏的规则1.2实现康威生命游戏1.3空间生命和智能体模拟2.实现生命模拟3.生命模拟应用小结系列链接0.前言生命模拟是进化计算的一个特定子集,模拟了自然界中所观察到的自然过程,例如粒子或鸟群的聚集方式。生命模拟只是用来探索和优化问题的模拟形式之一,还有很多其他形式的模拟,可以更好地建模各种过程,但它们都源于康威

- PyTorch从入门到精通:探索深度学习新境界

lmtealily

深度学习pytorch人工智能

引言PyTorch作为当前最受欢迎的深度学习框架之一,凭借其动态计算图的独特设计和与Python生态的无缝集成,正重塑着人工智能开发的新范式1。从NVIDIA的研究实践到Meta的产业应用,PyTorch的价值已渗透至学术研究、工业部署的每个角落。本文将带领您从张量操作基础开始,逐步探索GPU加速、动态图机制、框架生态集成等高级主题,最终实现理论与实战的双重突破。一、PyTorch核心基础构建1.

- 【Python】已解决:pip安装第三方模块(库)与PyCharm中不同步的问题(PyCharm添加本地python解释器)

屿小夏

pythonpippycharm

个人简介:某不知名博主,致力于全栈领域的优质博客分享|用最优质的内容带来最舒适的阅读体验!文末获取免费IT学习资料!文末获取更多信息精彩专栏推荐订阅收藏专栏系列直达链接相关介绍书籍分享点我跳转书籍作为获取知识的重要途径,对于IT从业者来说更是不可或缺的资源。不定期更新IT图书,并在评论区抽取随机粉丝,书籍免费包邮到家AI前沿点我跳转探讨人工智能技术领域的最新发展和创新,涵盖机器学习、深度学习、自然

- windows下源码安装golang

616050468

golang安装golang环境windows

系统: 64位win7, 开发环境:sublime text 2, go版本: 1.4.1

1. 安装前准备(gcc, gdb, git)

golang在64位系

- redis批量删除带空格的key

bylijinnan

redis

redis批量删除的通常做法:

redis-cli keys "blacklist*" | xargs redis-cli del

上面的命令在key的前后没有空格时是可以的,但有空格就不行了:

$redis-cli keys "blacklist*"

1) "blacklist:12:

[email protected]

- oracle正则表达式的用法

0624chenhong

oracle正则表达式

方括号表达示

方括号表达式

描述

[[:alnum:]]

字母和数字混合的字符

[[:alpha:]]

字母字符

[[:cntrl:]]

控制字符

[[:digit:]]

数字字符

[[:graph:]]

图像字符

[[:lower:]]

小写字母字符

[[:print:]]

打印字符

[[:punct:]]

标点符号字符

[[:space:]]

- 2048源码(核心算法有,缺少几个anctionbar,以后补上)

不懂事的小屁孩

2048

2048游戏基本上有四部分组成,

1:主activity,包含游戏块的16个方格,上面统计分数的模块

2:底下的gridview,监听上下左右的滑动,进行事件处理,

3:每一个卡片,里面的内容很简单,只有一个text,记录显示的数字

4:Actionbar,是游戏用重新开始,设置等功能(这个在底下可以下载的代码里面还没有实现)

写代码的流程

1:设计游戏的布局,基本是两块,上面是分

- jquery内部链式调用机理

换个号韩国红果果

JavaScriptjquery

只需要在调用该对象合适(比如下列的setStyles)的方法后让该方法返回该对象(通过this 因为一旦一个函数称为一个对象方法的话那么在这个方法内部this(结合下面的setStyles)指向这个对象)

function create(type){

var element=document.createElement(type);

//this=element;

- 你订酒店时的每一次点击 背后都是NoSQL和云计算

蓝儿唯美

NoSQL

全球最大的在线旅游公司Expedia旗下的酒店预订公司,它运营着89个网站,跨越68个国家,三年前开始实验公有云,以求让客户在预订网站上查询假期酒店时得到更快的信息获取体验。

云端本身是用于驱动网站的部分小功能的,如搜索框的自动推荐功能,还能保证处理Hotels.com服务的季节性需求高峰整体储能。

Hotels.com的首席技术官Thierry Bedos上个月在伦敦参加“2015 Clou

- java笔记1

a-john

java

1,面向对象程序设计(Object-oriented Propramming,OOP):java就是一种面向对象程序设计。

2,对象:我们将问题空间中的元素及其在解空间中的表示称为“对象”。简单来说,对象是某个类型的实例。比如狗是一个类型,哈士奇可以是狗的一个实例,也就是对象。

3,面向对象程序设计方式的特性:

3.1 万物皆为对象。

- C语言 sizeof和strlen之间的那些事 C/C++软件开发求职面试题 必备考点(一)

aijuans

C/C++求职面试必备考点

找工作在即,以后决定每天至少写一个知识点,主要是记录,逼迫自己动手、总结加深印象。当然如果能有一言半语让他人收益,后学幸运之至也。如有错误,还希望大家帮忙指出来。感激不尽。

后学保证每个写出来的结果都是自己在电脑上亲自跑过的,咱人笨,以前学的也半吊子。很多时候只能靠运行出来的结果再反过来

- 程序员写代码时就不要管需求了吗?

asia007

程序员不能一味跟需求走

编程也有2年了,刚开始不懂的什么都跟需求走,需求是怎样就用代码实现就行,也不管这个需求是否合理,是否为较好的用户体验。当然刚开始编程都会这样,但是如果有了2年以上的工作经验的程序员只知道一味写代码,而不在写的过程中思考一下这个需求是否合理,那么,我想这个程序员就只能一辈写敲敲代码了。

我的技术不是很好,但是就不代

- Activity的四种启动模式

百合不是茶

android栈模式启动Activity的标准模式启动栈顶模式启动单例模式启动

android界面的操作就是很多个activity之间的切换,启动模式决定启动的activity的生命周期 ;

启动模式xml中配置

<activity android:name=".MainActivity" android:launchMode="standard&quo

- Spring中@Autowired标签与@Resource标签的区别

bijian1013

javaspring@Resource@Autowired@Qualifier

Spring不但支持自己定义的@Autowired注解,还支持由JSR-250规范定义的几个注解,如:@Resource、 @PostConstruct及@PreDestroy。

1. @Autowired @Autowired是Spring 提供的,需导入 Package:org.springframewo

- Changes Between SOAP 1.1 and SOAP 1.2

sunjing

ChangesEnableSOAP 1.1SOAP 1.2

JAX-WS

SOAP Version 1.2 Part 0: Primer (Second Edition)

SOAP Version 1.2 Part 1: Messaging Framework (Second Edition)

SOAP Version 1.2 Part 2: Adjuncts (Second Edition)

Which style of WSDL

- 【Hadoop二】Hadoop常用命令

bit1129

hadoop

以Hadoop运行Hadoop自带的wordcount为例,

hadoop脚本位于/home/hadoop/hadoop-2.5.2/bin/hadoop,需要说明的是,这些命令的使用必须在Hadoop已经运行的情况下才能执行

Hadoop HDFS相关命令

hadoop fs -ls

列出HDFS文件系统的第一级文件和第一级

- java异常处理(初级)

白糖_

javaDAOspring虚拟机Ajax

从学习到现在从事java开发一年多了,个人觉得对java只了解皮毛,很多东西都是用到再去慢慢学习,编程真的是一项艺术,要完成一段好的代码,需要懂得很多。

最近项目经理让我负责一个组件开发,框架都由自己搭建,最让我头疼的是异常处理,我看了一些网上的源码,发现他们对异常的处理不是很重视,研究了很久都没有找到很好的解决方案。后来有幸看到一个200W美元的项目部分源码,通过他们对异常处理的解决方案,我终

- 记录整理-工作问题

braveCS

工作

1)那位同学还是CSV文件默认Excel打开看不到全部结果。以为是没写进去。同学甲说文件应该不分大小。后来log一下原来是有写进去。只是Excel有行数限制。那位同学进步好快啊。

2)今天同学说写文件的时候提示jvm的内存溢出。我马上反应说那就改一下jvm的内存大小。同学说改用分批处理了。果然想问题还是有局限性。改jvm内存大小只能暂时地解决问题,以后要是写更大的文件还是得改内存。想问题要长远啊

- org.apache.tools.zip实现文件的压缩和解压,支持中文

bylijinnan

apache

刚开始用java.util.Zip,发现不支持中文(网上有修改的方法,但比较麻烦)

后改用org.apache.tools.zip

org.apache.tools.zip的使用网上有更简单的例子

下面的程序根据实际需求,实现了压缩指定目录下指定文件的方法

import java.io.BufferedReader;

import java.io.BufferedWrit

- 读书笔记-4

chengxuyuancsdn

读书笔记

1、JSTL 核心标签库标签

2、避免SQL注入

3、字符串逆转方法

4、字符串比较compareTo

5、字符串替换replace

6、分拆字符串

1、JSTL 核心标签库标签共有13个,

学习资料:http://www.cnblogs.com/lihuiyy/archive/2012/02/24/2366806.html

功能上分为4类:

(1)表达式控制标签:out

- [物理与电子]半导体教材的一个小问题

comsci

问题

各种模拟电子和数字电子教材中都有这个词汇-空穴

书中对这个词汇的解释是; 当电子脱离共价键的束缚成为自由电子之后,共价键中就留下一个空位,这个空位叫做空穴

我现在回过头翻大学时候的教材,觉得这个

- Flashback Database --闪回数据库

daizj

oracle闪回数据库

Flashback 技术是以Undo segment中的内容为基础的, 因此受限于UNDO_RETENTON参数。要使用flashback 的特性,必须启用自动撤销管理表空间。

在Oracle 10g中, Flash back家族分为以下成员: Flashback Database, Flashback Drop,Flashback Query(分Flashback Query,Flashbac

- 简单排序:插入排序

dieslrae

插入排序

public void insertSort(int[] array){

int temp;

for(int i=1;i<array.length;i++){

temp = array[i];

for(int k=i-1;k>=0;k--)

- C语言学习六指针小示例、一维数组名含义,定义一个函数输出数组的内容

dcj3sjt126com

c

# include <stdio.h>

int main(void)

{

int * p; //等价于 int *p 也等价于 int* p;

int i = 5;

char ch = 'A';

//p = 5; //error

//p = &ch; //error

//p = ch; //error

p = &i; //

- centos下php redis扩展的安装配置3种方法

dcj3sjt126com

redis

方法一

1.下载php redis扩展包 代码如下 复制代码

#wget http://redis.googlecode.com/files/redis-2.4.4.tar.gz

2 tar -zxvf 解压压缩包,cd /扩展包 (进入扩展包然后 运行phpize 一下是我环境中phpize的目录,/usr/local/php/bin/phpize (一定要

- 线程池(Executors)

shuizhaosi888

线程池

在java类库中,任务执行的主要抽象不是Thread,而是Executor,将任务的提交过程和执行过程解耦

public interface Executor {

void execute(Runnable command);

}

public class RunMain implements Executor{

@Override

pub

- openstack 快速安装笔记

haoningabc

openstack

前提是要配置好yum源

版本icehouse,操作系统redhat6.5

最简化安装,不要cinder和swift

三个节点

172 control节点keystone glance horizon

173 compute节点nova

173 network节点neutron

control

/etc/sysctl.conf

net.ipv4.ip_forward =

- 从c面向对象的实现理解c++的对象(二)

jimmee

C++面向对象虚函数

1. 类就可以看作一个struct,类的方法,可以理解为通过函数指针的方式实现的,类对象分配内存时,只分配成员变量的,函数指针并不需要分配额外的内存保存地址。

2. c++中类的构造函数,就是进行内存分配(malloc),调用构造函数

3. c++中类的析构函数,就时回收内存(free)

4. c++是基于栈和全局数据分配内存的,如果是一个方法内创建的对象,就直接在栈上分配内存了。

专门在

- 如何让那个一个div可以拖动

lingfeng520240

html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/1999/xhtml

- 第10章 高级事件(中)

onestopweb

事件

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- 计算两个经纬度之间的距离

roadrunners

计算纬度LBS经度距离

要解决这个问题的时候,到网上查了很多方案,最后计算出来的都与百度计算出来的有出入。下面这个公式计算出来的距离和百度计算出来的距离是一致的。

/**

*

* @param longitudeA

* 经度A点

* @param latitudeA

* 纬度A点

* @param longitudeB

*

- 最具争议的10个Java话题

tomcat_oracle

java

1、Java8已经到来。什么!? Java8 支持lambda。哇哦,RIP Scala! 随着Java8 的发布,出现很多关于新发布的Java8是否有潜力干掉Scala的争论,最终的结论是远远没有那么简单。Java8可能已经在Scala的lambda的包围中突围,但Java并非是函数式编程王位的真正觊觎者。

2、Java 9 即将到来

Oracle早在8月份就发布

- zoj 3826 Hierarchical Notation(模拟)

阿尔萨斯

rar

题目链接:zoj 3826 Hierarchical Notation

题目大意:给定一些结构体,结构体有value值和key值,Q次询问,输出每个key值对应的value值。

解题思路:思路很简单,写个类词法的递归函数,每次将key值映射成一个hash值,用map映射每个key的value起始终止位置,预处理完了查询就很简单了。 这题是最后10分钟出的,因为没有考虑value为{}的情