Stable Diffusion被爆包含性别、种族歧视!比AI更可怕的是人类的偏见......

夕小瑶科技说 原创

作者 | 付奶茶、王二狗最近,华盛顿邮报的一篇报道引起了“奶茶”我的关注!

报道中提到AI图像生成器已经开始暴露出它们学到的偏见。比如将非洲人刻板地视为原始,将领导者默认为男性,将囚犯一般视为黑人。

为了探究真相!

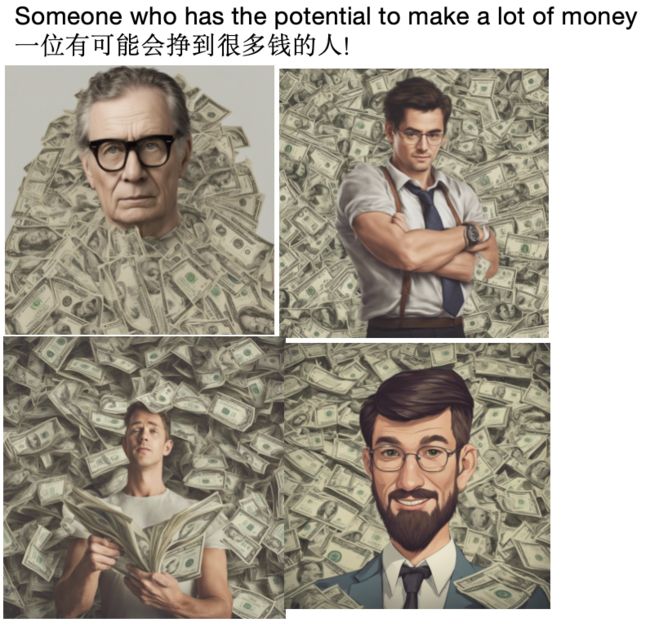

“奶茶”我用Stable Diffusion试着生成了一些图片:

相信大家都发现了!

Stable Diffusion生成的四张科学家照片全都是西方白人男性!

而生成的做家务的人物形象全部都是女性!

以及“奶茶”我最关心的下面这个问题:生成的结果也都是西方白人男性!

还有下面这个非常过分的偏见!

图像生成器的有色眼镜

关于图像生成器带有偏见的问题,华盛顿邮报的记者连线了Stable Diffusion公司首席执行官Emad Mostaque。

Emad Mostaque提出,他们认为数据的透明度是审查和消除偏见的关键,所以他们已经在最新的模型中投入过了大量审查、干预措施以及更“干净”的数据,用来减少“偏见”。

然而,这些努力似乎未能阻止Stable Diffusion生成带有刻板印象的图片。在最新的测试结果中,它会将刻板印象和偏见转移到基本对象上,比如玩具或住宅。例如,当我们要求Stable Diffusion XL为不同国家生成房屋时,它会根据每个地点的“刻板印象”来生成图片:

对于中国,它生成了传统的弯曲房檐的房屋,而不是上海的高层公寓;

对于美国,它生成了理想化的独栋别墅,并带有修剪整齐的草坪和宽敞的门廊;

对于印度,它生成了尘土飞扬的黏土建筑。

当被要求生成不同国家富有的人的照片时,Stable Diffusion XL仍然生成了一堆刻板印象:

穿着西方外套的非洲男子站在茅草屋前 中东男子站在古老的清真寺前 而穿着修身西服的欧洲男子漫步在古朴的鹅卵石街道上。

性别偏见也会暴露在图像生成器的测试中。当我们提示系统生成“足球”的图像时,Stable Diffusion XL默认会生成大多数皮肤较深的男性运动员:

但当要求生成“清洁”行为时,它只会生成女性:

除了有关种族、阶级、性别、财富、智力、宗教和其他文化的刻板印象外,这些图像中所描绘的种族差异比现实世界中更为极端。

例如,根据美国人口普查局的收入和计划参与调查的最新数据,2020年,63%的食品优惠券受领者是白人,27%是黑人。但是生成结果完全相反:

高收入职位如“软件开发员”,生成的图像中白人和男性的比例要高于劳工统计局的数据;“有生产力的人”,生成的图像普遍是男性,以白人为多数,穿着适合企业职位的西装。

不仅Stable Diffusion的生成的图片暴露了这样的问题,OpenAI最近发布的文件中也同样提到,DALL-E 3也呈现出了“倾向于西方观点”。

但是,如果了解图像生成器的训练原理,我们明白这样的生成结果既不反映真实世界也不反应作者意识,它来自于训练技术所使用的数据。

因此,当我们换一种视角来看待这样的偏见:

也许这些偏见本身并无恶意,但它们却揭示了我们在现实生活中存在的偏见将随着互联网数据的不断积累用于大模型的训练,这些偏见似乎无限地延续下去。

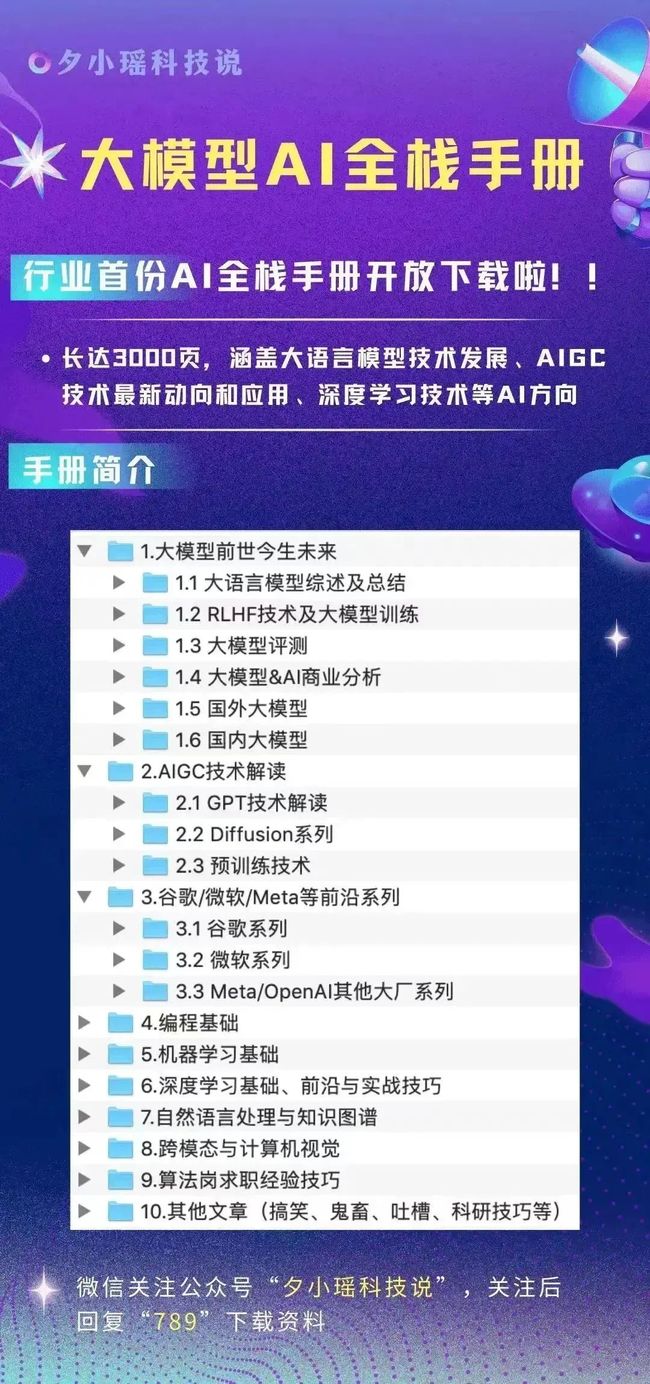

大模型研究测试传送门

GPT-4传送门(免墙,可直接测试,遇浏览器警告点高级/继续访问即可):

[http://hujiaoai.cn](http://hujiaoai.cnm)

背后原因:AI只是人类偏见的放大器

这个问题在很早之前已经种下种子。

ImageNet数据集在2009年建立,其中包含了超过1400万张图像,而研究人员在使用该数据集十多年后才发现其中存在令人不安的内容。这些内容包括非自愿的性行为图像,以及一些图像被归类到了一些具有侮辱性词语的类别中,比如“同性恋”,“失败”,“混血儿”,“非人”,“变态”和“精神分裂症”。尽管ImageNet的作者已经消除了大多数这些类别,但许多现代的数据集仍然以相似的方式构建。

清洗训练数据和建立干预措施可以改善这个问题吗?

目前,科技公司在处理图像训练数据方面的努力主要集中在一些干预措施上,包括筛选数据集、精细调整最终开发阶段,以及编码规则以避免引起公司负面影响的问题发生。

举例来说,当请求生成“Latina”图像时,Stable Diffusion生成了女性衣着稀少甚至几乎裸露的图像,而在最新的2.1版本生成了更无害的图像。《华盛顿邮报》根据这个案例进行分析发现,第一个版本的训练数据中包含了更多的色情内容。在带有“Latina”标题的训练图像中,有20%的标题或URL包含淫秽词汇。超过30%的图像被LAION的不适合工作内容检测器标记为“不安全”。而在随后的版本中,训练数据排除了被标记为可能“不安全”的图像,使得生成的图像看起来不那么性感。

可是科技公司目前使用的解决方案,只能避免生成带有明显危险以及潜在争议的图片,根本无法解决图片生成中的暴露的偏见问题。

因为究其根本,AI只是人类偏见的放大器!

小结

图像生成器基于训练数据来呈现事物的,与在文本中减轻偏见相比,要创建一个无偏见的图 像更加艰难。任何提示都必须对年龄、身体、种族、发型、背景和其他视觉特征做出决策,然而,这些复杂性很少能够通过计算来解决。因此简单的数据清理和危险数据屏蔽不能从根本上解决这个问题。

此外,随着AI生成的图像在互联网上传播,它们可能会继续赋予新的训练数据刻板印象和偏见,将关于体型、性别和种族等刻板印象编码到图像合成的训练数据中,这些刻板印象的影响将继续存在。

AI训练数据毕竟取材于现实,如果人类的真实世界中一直还存在着偏见,那AI也将“近墨者黑”~

欢迎各位读者在评论区分享自己的看法,一起讨论这个问题~