PanNet: A deep network architecture for pan-sharpening(ICCV 2017)

文章目录

- Abstract

- Introduction

-

- 过去方法存在的问题

- 我们提出新的解决方法

- Related work

- PanNet: A deep network for pan-sharpening(PanNet:用于泛锐化的深度网络)

-

- Background and motivation

- PanNet architecture

-

- Spectral preservation

- Structural preservation

- Network architecture

- Experiments

- Conclusion

論文鏈接

源代码

Abstract

我们针对泛锐化问题提出了一种深度网络架构,称为PanNet。我们结合特定领域的知识来设计我们的PanNet架构,重点关注泛锐化问题的两个目标:光谱和空间保存

为了保持光谱,我们将上采样的多光谱图像加入到网络输出中,直接将光谱信息传播到重建图像中

为了保持空间结构,我们在高通滤波域而不是图像域训练网络参数

我们表明,训练后的网络可以很好地泛化来自不同卫星的图像,而无需再训练。实验表明,在视觉上和标准质量度量方面,比最先进的方法有了显著的改进

Introduction

多光谱图像在农业、矿业和环境监测等领域有着广泛的应用。由于物理限制,卫星通常只能测量一张高分辨率全色(PAN)图像(即灰度)和几张低分辨率多光谱(LRMS)图像.泛锐化的目标是将这些光谱信息和空间信息融合在一起,得到与PAN相同尺寸的高分辨率多光谱(HRMS)图像

过去方法存在的问题

随着近年来深度神经网络在图像处理应用中的进展,研究人员已经开始探索这种泛锐化的途径,例如,一个深度泛锐化模型假设关系HR/LR多光谱图像斑块之间的差值与对应的HR/LR全色图像斑块之间的差值相同,并利用这一假设通过神经网络学习映射,最先进的泛锐化模型,基于卷积神经网络,称为PNN[21],采用了先前提出的图像超分辨率架构

这两种方法都把泛锐化问题看作一个简单的图像回归问题。也就是说,尽管他们能够获得良好的结果,但他们没有利用泛锐化的特定目标——光谱和空间保存——而是将泛锐化视为一个黑盒深度学习问题。然而,对于泛锐化,很明显,保留空间和光谱信息是融合的主要目标,因此深度学习方法应该明确地关注这些方面

我们提出新的解决方法

这激发了我们提出的称为“PanNet”的深度网络,它具有以下特征:

- 我们将泛锐化的问题特定知识纳入深度学习框架。具体来说,我们使用上采样的多光谱图像在网络中传播光谱信息,我们将此过程称为“光谱映射”。为了重点研究PAN图像中的主体结构,我们在高通域而不是图像域训练网络

- 我们的方法是一个端到端系统,它完全从数据中自动学习映射。与之前的(非深度)方法不同,卷积允许我们捕获MS图像和PAN图像不同波段的内部相关性

实验表明,PanNet与几种标准方法以及其他深度模型相比,实现了最先进的性能 - 由于成像值的范围不一致,大多数传统方法需要针对不同的卫星进行参数调整。然而,在高通域的训练消除了这个因素,允许在一个卫星上的训练很好地推广到新的卫星,这不是在图像域上训练的其他深度方法的特征

Related work

简要介绍下过去的work

近几十年来出现了各种各样的pan锐化方法。其中,最流行的是基于分量替换,包括强度色调饱和度技术(IHS)[5],主成分分析(PCA)[20]和Brovey变换[14]。这些方法简单而快速,但它们往往以引入光谱失真为代价,成功地接近了PAN中包含的HRMS图像的空间分辨率

为了解决这个问题,已经提出了更复杂的技术,例如自适应方法(例如,PRACS[8])和频段相关方法(例如,BDSD[13])。在多分辨率方法[19,22]中,PAN图像和LRMS图像被分解,例如使用小波或拉普拉斯金字塔,然后融合

其他基于模型的方法将PAN、HRMS和LRMS图像之间关系的信念编码为正则化目标函数,然后将融合问题视为图像恢复优化问题[3,4,7,9,12,18]。其中许多算法都取得了很好的效果。我们在这些方法中选择最好的方法进行实验比较

PanNet: A deep network for pan-sharpening(PanNet:用于泛锐化的深度网络)

图2显示了我们提出的泛锐化深度学习方法(称为PanNet)的高级概要。我们首先回顾了泛锐化问题的常见方法,然后在泛锐化的两个目标背景下讨论了我们的方法,即重建包含pan空间内容的高分辨率多光谱图像和低分辨率图像的光谱内容

Background and motivation

我们将期望的HRMS图像集表示为X,并设Xb为第b个波段的图像。对于观测数据,P为PAN图像,M为LRMS图像,Mb为第b波段。大多数最先进的方法将融合视为最小化形式的目标

其中f1 (X,P)项强制结构一致性,f2 (X,M)强制光谱一致性,f3 (X)对X施加期望的图像约束。例如,第一个变分方法P+XS让

ω是一个b维概率权向量

其他方法使用空间差分算子G来关注高频内容

为了光谱的一致性,许多方法定义

↑M b表示上采样M b与X b大小相同,通过与平滑核k卷积进行平滑。f3 (X)通常是总变异惩罚

对于泛锐化问题,一个直接的深度学习方法可以利用一个简单的网络架构来学习输入(P,M)和输出X之间的非线性映射关系

其中,fw代表一个神经网络,W代表其参数

PNN[21]使用了这一思想,它直接将(P,M)输入到一个深度卷积神经网络中来近似x。尽管这种直接的架构给出了很好的结果,但它没有利用已知的图像特征来定义输入或网络结构

PanNet architecture

与PNN一样,我们也使用卷积神经网络(CNN),但我们的具体结构与PNN不同,使用最近提出的ResNet结构作为我们的神经网络

卷积滤波器对于这个问题特别有用,因为它们可以利用多光谱图像不同波段之间的高相关性,这在SIRF算法[7]中被证明是有用的。与其他泛锐化方法一样,我们的深度网络旨在同时保留光谱和空间信息

High-level idea用图3所示的潜在网络结构序列表示

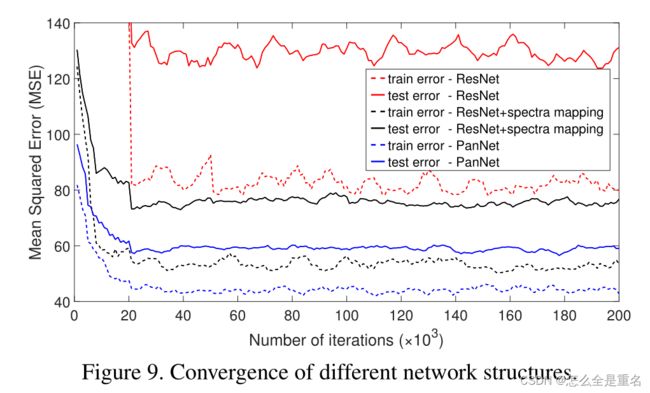

我们考虑的三种泛锐化模型结构的例子:(从左到右)ResNet [15],ResNet+光谱映射,以及最终提出的网络,称为PanNet。ResNet已被证明可以提高CNN在图像处理任务上的性能,但在泛锐化框架中存在缺点。第二种网络实现了光谱保存的目标,而最后一种网络同时捕获了空间和光谱信息。我们对这三种方法都进行了试验,但没有一种应用于泛锐化

Spectral preservation

为了融合频谱信息,我们对M进行了上采样,并在该形式的深层网络中添加了一个跳跃连接

↑M表示上采样LRMS图像,f W表示ResNet,这一项的动机与式(3)中表示的目标相同

正如我们将看到的,它强制X共享m的频谱内容。与变分方法不同,我们不将X与平滑核进行卷积,而是允许深度网络纠正高分辨率的差异。在我们的实验中,我们将此模型称为“光谱映射”,并使用ResNet模型进行fw;对应图3中的中间网络

Structural preservation

我们将PAN图像和上采样LRMS图像的高通内容输入到深度网络W中,修改后的模型为

为了获得由函数G表示的高通信息,我们从原始图像中减去使用平均滤波器找到的低通内容

对于LRMS图像,我们在获得高通含量后将样本提升到PAN的大小

我们观察到,由于↑M是低分辨率的,它可以被看作包含了X的低通光谱含量,这是↑M - X项模型。这使得网络f W可以学习映射,将PAN中包含的高通spa信息融合到x中。我们将↑G(M)输入到网络中,以了解PAN中的空间信息如何映射到x中的不同光谱波段。这个目标对应于图3中的PanNet

在图4中,我们展示了图3中左右网络的初步比较。HRMS和LRMS图像有8个光谱带,我们用灰度表示为平均年龄。图4©显示了(a)的ResNet重建的平均绝对误差(MAE)图像,而(d)显示了提出的PanNet的平均绝对误差(MAE)图像。很明显,光谱映射可以更好地模拟光谱内容(在较暗的光滑区域中很明显),而在高通域上训练网络可以保留边缘和细节,这些结论得到了我们大量定量实验的支持

正如引言中提到的,在高通域训练深度网络的另一个优点是消除PAN和HRMS图像在不同卫星上产生的不一致性

Network architecture

在保留光谱信息的同时恢复空间信息的目标激发了式(6)中提出的目标。此外,之前的变分方法试图通过使用先验图像假设[3,7]来提高性能,对应于式(1)中的f3。在这里,我们利用深度学习直接学习一个函数,该函数捕获了PAN和LRMS输入之间的关系,以及HRMS输出

我们采用带有卷积神经网络的ResNet结构作为方程(6)中的网络模型fw,卷积运算有助于多光谱图像不同波段间的耦合建模。因此,我们的网络结构通过以下操作表示

其中,W表示权重,b表示网络偏差,l = 1,…, L−2/2, Y l表示第l层的输出

因此,网络建模的是不包含在↑ M中的高频边缘信息。近似的惩罚是如式(6)所示的Frobenius范数

虽然我们架构的参数层遵循ResNet,但两者在光谱映射过程(底部方程)和网络的高通输入(顶部方程)方面是不同的。在我们的实验中,我们将这种PanNet框架与直接应用于图像域的ResNet进行了比较,以显示合并这种额外领域知识的明显优势。(我们再次回顾,这两种方法都没有应用于泛锐化问题。)我们还比较了最先进的PNN,它使用了与ResNet不同的深度CNN学习方法

Experiments

我们利用Worldview3卫星的数据进行了几次实验。该卫星的PAN分辨率为0.41m ~ 1.5m。我们使用随机梯度下降(SGD)来最小化方程(6)中的目标函数。在我们的实验中,我们提取了18,000个大小为64 × 64的PAN/LRMS/HRMS补丁对。我们将其分成90/10%用于训练/验证。我们比较了六种广泛使用的泛锐化方法:PRACS[8]、In- dusion[19]、PHLP[18]、BDSD[13]、SIRF[6,7]和PNN[21]。每个参数都使用了几个参数设置,并选择了最佳性能

Conclusion

我们提出了PanNet,这是一个基于泛锐化的两个目标:光谱和空间保存的深度模型

对于光谱保存,我们引入了一种称为“光谱映射”的技术,将上采样的LRMS图像添加到目标函数中,允许网络只关注图像中的细节

为了空间保存,我们在PAN和上采样LRMS图像的高通分量上训练网络参数

我们使用ResNet作为一个非常适合这项任务的深度模型,与目前最先进的方法(包括PNN和vanilla ResNet)相比,Pan-Net实现了更好的图像重建,并更好地推广到新卫星