业界领先的这些大模型,都被一家「收编」了

毋庸置疑,GPT-4 发布是一件足以载入 AI 史册的大事件。但随着时间的推移,人们也发现,即使是最先进的大模型也还没有强大到可以把所有的事情都做完。比如,如果你把一份很长的文本粘贴到 GPT-4 的对话框,它会告诉你文本过长,处理不了(它支持的上下文窗口仅为 32k token,约 2.5 万汉字)。

再比如,如果你需要算一个超过 8 位数字乘法的运算,或者涉及小数、分数的运算,GPT-4 可能也给不出正确答案(其多位乘法运算准确率仅为 4.3%)。

看起来,现阶段我们并没有实现理想中的「通用人工智能」,强如 GPT-4 也并不完美。这也意味着,对于大模型使用者或者想在其上开发应用的技术人员来说,GPT-4 或许不是唯一的选择,甚至不是最适合的选择。

那么,在生成式 AI 的下半场,应用到底应该怎么造?这并不是一个能够简单得出答案的问题,很多时候,我们恨不得把现有的比较强的模型都试一下。但即使要做这件事也不容易,因为很多模型在发布的同时其实并没有提供太多「配套服务」,试用也有成本和代价。

好在,拥有强大基础设施的亚马逊云科技也关注到了这些问题。近日正式上线的 Amazon Bedrock 就是奔着「提供更多选择」和配套服务这一目标来的。

Claude、Llama 2、Stable Diffusion... 超全明星模型库

除了 ChatGPT,在更多领域中,人们想要应用生成式 AI 还存在肉眼可见的挑战:我们必须构建专用于生成式 AI 的硬件基础设施,配合自身数据对大模型进行调优,不断更新部署,同时还需要保护隐私数据的安全。即使对于科技公司而言,这也是非常复杂的事。

对此,亚马逊云科技拿出了一套帮助人们建大模型应用的「基础设施」。

今年 4 月,亚马逊云科技正式发布 Amazon Bedrock,这是一套生成式 AI 全托管服务,包含业界领先的基础模型和构建生成式 AI 应用程序所需的一系列功能。

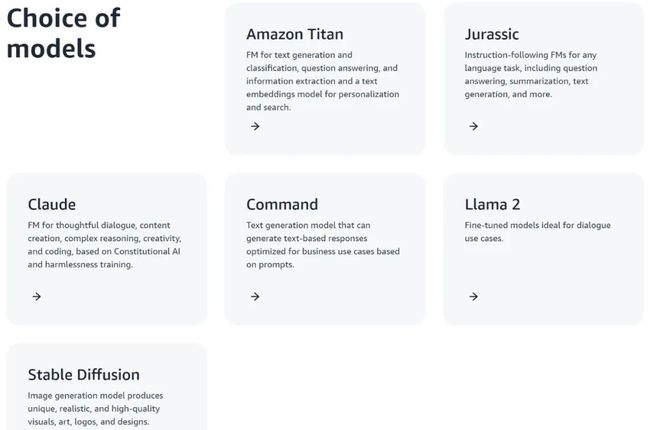

Amazon Bedrock 汇聚了业内几乎所有领先的基础大模型,面对不同应用场景,它可以让人们只需通过单一 API 就能用上来自 AI21 Labs、Anthropic、Cohere、Meta Llama2、Stability AI 等公司的先进大模型来构建自己的应用。

提到亚马逊,很多人可能都会想到前段时间的一个重要融资事件:他们计划对 OpenAI 头号竞争对手 ——Anthropic 投资 40 亿美元。

在大模型创业领域,Anthropic 是一个非常耀眼的存在。它由 OpenAI 前研究副总裁 Dario Amodei、GPT-3 论文第一作者 Tom Brown 等人在 2021 年共同创立,其创始成员大多为 OpenAI 的核心员工,他们曾经深度参与过 OpenAI 的 GPT-3,率先提出引入人类偏好的强化学习(RLHF)等技术。

这套强大的阵容打造出了一个同样耀眼的模型 ——Claude(最新版本是 Claude 2)。在某些方面,这个模型甚至做到了 GPT-4 都没做到的事情,比如 100k token 的上下文窗口,其代码生成能力也超过了原版的 GPT-4。这些都是亚马逊选择投资 Anthropic 的重要原因。

更重要的是,亚马逊云科技发布的新闻中有这么一段话:「作为投资协议的一部分,Anthropic 将使用亚马逊云科技的服务承担关键任务工作负载,合作进行安全研究和未来基础模型开发。使用亚马逊云科技的开发人员和工程师将能够通过 Amazon Bedrock 在 Anthropic 最先进的模型基础上构建应用。」

没错,应用生成式 AI,现在有了新的思路:有人把表现优秀的模型上线到 AI 基础设施平台上,让用户去选什么是最合适的。为了扩大操作的范围,Amazon Bedrock 不仅上线了 Claude 2,还有开源界的扛把子 Llama 2 以及口碑同样很好的 Jurassic-2、Command 等模型。

Jurassic-2 来自 AI21 Labs,是业内规模最大,性能最强的几种基础大模型之一。在 Amazon Bedrock 上甚至提供了超千亿参数的 Ultra 版本,其可以应用于任何复杂的语言生成任务,例如问答、摘要、长格式副本生成、高级信息提取等,也支持多种语言。

Command 则是另一家明星创业公司 Cohere 推出的,可够接受用户个性化命令训练的文本生成模型。企业用户在将自己的数据和 Command 结合之后,就可以生成一个面向特定应用的语言模型,能在实际业务中立即发挥作用。在 520 亿参数的体量之上,Command 的性能超过了很多更大的模型。

此外,在 ChatGPT 之前就已席卷 AI 圈,拥有强大文生图能力的 Stable Diffusion 也在他们的模型列表里。

至此,在大模型应用的方向上,一条道路正在变得逐渐清晰。

生成式 AI 落地的全流程服务

最近在业内,人们对于大模型的应用方向逐渐形成了一种思路:利用业内领先的大模型作为基础模型(Foundation Model),配合自有数据进行训练和调优,进而构建出面向不同业务场景的应用。亚马逊云科技把这条路迅速成为了现实,还进一步降低了企业入门的难度。

在 Amazon Bedrock 的基础之上,企业可以更方便、快速地尝试各种领先的基础模型,进行提示工程,完成微调和检索增强生成(RAG)等动作,使用自身专有数据定制模型。

利用 Amazon Bedrock Agents 工具生成式 AI 应用的开发、部署、管理等 Agent 能力被集合在一起。我们可以像用 AutoGPT 一样无需编写任何代码就能创建出托管代理(AI agent),让它来指挥大模型执行复杂的任务,如旅行预订、处理保险索赔、策划广告活动和管理库存等。

只需用自然语言文字写指令,Agent 就能明白要完成的目标。

在平台和硬件上,作为专为人工智能打造的平台,Amazon Bedrock 连接了亚马逊云科技的基础设施,从硬件和软件都对 AI 计算进行了专门的优化,覆盖大模型从构建、训练到部署的一系列工作负载。由于 Amazon Bedrock 采用无服务器(Serverless)技术,客户不必管理任何基础设施,就能在熟悉的亚马逊云科技服务平台上将生成式 AI 能力安全地集成和部署到应用程序中。

想要做大模型的应用,一个绕不过的问题就是算力的成本。最近就有人给微软 GitHub Copilot 的服务算了笔账:每月每位用户收费 10 美元,结果微软反而还要倒贴 20 美元。

对于亚马逊云科技这样的服务厂商而言,提高算力、降低成本的系统性解决方案是其最擅长的事。以使用最先进 AI 芯片英伟达 H100 的 Amazon EC2 P5 为例,它可以为训练大模型提供高达 20 exaflops 的计算性能。与上一代基于 GPU 的实例相比,训练时间最多可缩短 6 倍,而训练成本则可以降低多达 40%。

具体到每 token 的价格上,Amazon Bedrock 上使用 Claude 系列模型的价格相比 GPT 系列有显著优势。

当然,Amazon Bedrock 也充分考虑了安全性和隐私保护。客户可以使用 Amazon PrivateLink 在 Amazon Bedrock 与虚拟私有网络(VPC)之间建立专门的安全连接,确保任何数据传输都不会暴露在公共网络上。

有趣的是,除了可以高效构建生成式 AI 应用之外,亚马逊云科技也在其他层面上充分利用技术帮我们提高工作效率,比如利用大模型工具写有你「自己风格」的代码。

Amazon CodeWhisperer 是亚马逊云科技提出的 AI 编码应用程序,可在 IDE 中生成整行代码和完整的函数代码建议,帮人加速完成工作,它在今年 6 月发布了预览版,并对个人开发者免费。目前它可以帮人们生成的 15 种编程语言的代码,包括 Python、Java 和 JavaScript。

最近,亚马逊云科技推出了一项 CodeWhisperer 企业计划,旨在实现自定义化的 AI 代码生成和建议服务。基于新功能,用户可以利用企业内部的代码存储库当训练数据,让 AI 相应地调整代码生成建议,管理员也可以从控制台管理自定义,在控制台查看评估指标,估计每个自定义的执行方式,并有选择地将它们部署给开发人员,保证了企业质量与安全标准。

在开发新技术之外,我们也能应用生成式 AI 提高业务评估和诊断的效率。Amazon QuickSight 提供了生成式 BI 的数据分析功能,它能够创建交互式仪表盘、分页报告以及嵌入式分析,同时具备进行自然语言查询的能力,让业务分析师能够更加方便快捷的探索数据,并使用自然语言描述轻松创建可视化报告。

在所有流程上,亚马逊云科技提供的能力大幅度降低了先进大模型的落地门槛,在人们使用技术领先大模型的同时,消除了管理环境、配置硬件与安全管理的事务,只需要关心业务创新就可以了。

生成式 AI 的变革,应该走这条路

我们知道,生成式 AI 的前景是不可限量的。

随着门槛被 AI 基础设施打下来,我们可以展望:在医疗健康领域,让 AI 自动提取关键细节并根据临床医生与患者的互动创建文档摘要;在药物发现上,使用生成式 AI 工具进行蛋白质折叠、蛋白质序列、对接和分子设计,加速药物发现和设计过程;在制造业中,生成式 AI 可以通过提取历史数据实时诊断设备故障,并建议维护操作,例如输入调整、维修或可能的备件。

利用开箱即用的生成式 AI 服务提升创新效率,更快地构建出实用化应用,或许才是大模型时代创新的正确方式。

如此看来,构建平台,降低门槛的意义与 Llama2 这样的重要技术创新可谓同等重要。

正如亚马逊 CEO Andy Jaessy 所说的:「让任何人,哪怕他还在自己的宿舍或者车库里刚刚开始创业之旅,也能获得与大型企业一样先进的基础设施和成本来实现自己的创新。我们希望帮助所有初创企业都有机会成为明天的『巨头』。」

亚马逊云科技提供的服务,正在让众多这场 AI 浪潮的旁观者变成参与者。我们可以期待,生成式 AI 会在不远的未来颠覆更多行业。

参考内容:

https://aws.amazon.com/cn/blogs/china/new-amazon-ec2-p5-instances-powered-by-nvidia-h100-tensor-core-gpus-for-accelerating-generative-ai-and-hpc-applications/

https://aws.amazon.com/cn/blogs/machine-learning/announcing-new-tools-to-help-every-business-embrace-generative-ai/