ELK日志分析系统

什么是elk?

elk是一套完整的日志集中处理方案,由三个开源的软件简称组成:

E:elasticSearch ES 是开源的,分布式的存储检索引擎(牵引型的非关系数据库),存储日志

java代码开发的,基于Lucene结构开发的一套检索引擎,拥有一个web接口,用户可以通过浏览器的形式和ES组件通信

ES的作用

存储,允许全文搜索,结构化搜引(索引点),索引电可以支持大容量的日志数据,也可以搜索不同类型的文档

k:kiabana 图形化界面,可以更好的分析存储在ES上的日志数据,提供了一个图形化的界面,来浏览ES上的日志数据,汇总分析,搜索

l:Logstash 数据收集引擎,可以动态的

(实时)从各种服务应用收集日志资源,还可以收集到日志数据进行过滤,分析,丰富,统一格式等等操作,然后把数据同步到ES存储引擎

RUBY语言编写的,运行在java虚拟机上的一个强大的数据处理工具,数据传输,格式化处理,格式化输出,主要用来处理日志

数据收集工具

filebeat 轻量级的开源的,日志收集共计,收集的速度较快,但是没有数据分析和过滤的能力,一般都是Logstash一块使用

kafka

EabbitMQ 中间件消息队列

数据流程图

总结

elk的作用,当我们管理一个大集群时,需要分析和定位的日志就会很多,每一台服务器分别去分析,将会耗时耗力,所以我们应运而生了一个集中的统一的日志管理和分析系统,极大的提高了定位问题的效率

日志系统的特征

1、收集,可以收集基本上市面上常用的软件日志

2、传输,收集到的日志需要发送到ES上

3、存储,es负责存储数据

4、UI,图形化界面(kiabana)

实验准备

三台主机

es1 20.0.0.10

es2 20.0.0.11

Logstash kiabana 20.0.0.12(4核8G)

三台组件,最少要2核/4G

关闭防火墙和安全机制

#三台服务器上要有java

#查看java版本

JAVA -version

#配置两台es服务器

cd /opt

#把elasticsearch源码包拖到opt目录下

#安装rpm包

rmp -ivh elasticsearch

#修改配置文件

cd /etc/elasticsearch

es

#把配置文件做备份

cp elasticsearch.yml elasticsearch.yml.bak

vim elasticsearch.yml

#集群名称

cluster.name: my-elk-cluster

node.name: node1

node.master: true

node.data: true

#33行

path.data: /opt/log

#37行

#日志存放路径

默认

#45行

#禁止es使用交换分区

bootstrap.memory_lock: true

#56行

#监听端口

network.host: 0.0.0.0

#65行

#对外提供访问的端口

http.port: 9200

#es内部通信的端口

transport.tcp.port: 9300

#71行

discovery.zen.ping.unicast.hosts: ["20.0.0.10:9300", "20.0.0.11:9300"]

vim elasticsearch.yml

#集群名称

cluster.name: my-elk-cluster

node.name: node1

node.master: false

node.data: true

#33行

path.data: /opt/log

#45行

#禁止es使用交换分区

bootstrap.memory_lock: true

#56行

#监听端口

network.host: 0.0.0.0

#65行

#对外提供访问的端口

http.port: 9200

#es内部通信的端口

transport.tcp.port: 9300

#71行

discovery.zen.ping.unicast.hosts: ["20.0.0.10:9300", "20.0.0.11:9300"]

#查看修改的文件

grep -v "^#" /etc/elasticsearch/elasticsearch.tml

重启服务

systemctl restart elasticsearch

systemctl enable elasticsearch

重启不报错

查看端口(服务是否启)

netstat -antp | grep 9200

浏览器访问测试一下

20.0.0.10:9200

20.0.0.11:9200

健康状态

http://20.0.0.10:9200/_cluster/health?pretty

http://20.0.0.11:9200/_cluster/health?pretty

安装可视化界面

es两台服务器安装node

把node源码拖到opt下

yum install gcc gcc-c++ make -y

tar zxvf node-v8.2.1.tar.gz

cd /node-v8

./configure

make -j 2 && make install

安装可视化web插件

把phantomjs插件拖到opt目录下

解压

cd /opt

tar jxvf phantomjs-2.1.1-linux-x86_64.tar.bz2

cd /opt/phantomjs-2.1.1-linux-x86_64/bin

cp phantomjs /usr/local/bin

安装 Elasticsearch-head 数据可视化工具

上传软件包 elasticsearch-head-master.zip 到/opt

cd /opt

unzip elasticsearch-head-master.zip

cd elasticsearch-head-master/

npm install

如果嫌速度慢可以使用淘宝镜像

npm config set registry http://registry.npm.taobao.org/

npm install

vim /etc/elasticsearch/elasticsearch.uml

在最后一行后添加

#开启跨域访问的支持

http.cors.enabled: true

#开启跨域访问之后,允许访问的域名地址*:所有

http.cors.allow-origin: "*"

重启服务

systemctl restart elasticsearch

查看端口(服务是否启)

netstat -antp | grep 9200

npm run start &

查看端口(服务是否启)

netstat -antp | grep 9100

浏览器

20.0.0.10:9100

20.0.0.11:9100

9100是可视化工具的访问接口:9200还是es数据库的访问端口配置日志收集

查看java版本

java -version

把Logstash拖到opt目录下

cd /opt

rpm -ivh logstash-6.7.2.rpm

systemctl start logstash.service

systemctl enable logstash.service

ln -s /usr/share/Logstash /usr/local/bin

logstash -e 'input { stdin{} } output { stdout{} }'

#所有键盘命令行输出,转化成标准输出(rubydebug的模式),6.0之后,logstash的默认输出格式就是rubydebug格式的标准输出

logstash -e 'input { stdin{} } output { elasticsearch { hosts=>["20.0.0.10:9200", "20.0.0.11:9200"]} }' --path.data /opt/test1

#区分不同的数据存放目录,6.0之后logstash自带的输出格式rubydebug,可以自动的把输出格式,定义为统一的标准格式输出

安装kibana

安装kibana

cd /opt

rpm -ivh kibana-6.7.2-x86_64.rpm

修改配置文件

vim /etc/kibana.yml

2行

server.port: 5601

7行

server.host: "0.0.0.0"

28行

elasticsearch.host: ["http://20.0.0.10:9200","http://20.0.0.11:9200"]

37行

kibana.index: ".kibana"

96行

logging.dest: /var/log/kibana.log

113行

il8n.locale: "zh-CN"

创建日志目录

touch /var/log/kobana.log

chown kibana:kibana /var/log/kibana.log

重启服务

开机自启

查看服务是否启动

systemctl start kibana.service

systemctl enable kibana.service

netstat -natp | grep 5601

验证 Kibana

浏览器访问

20.0.0.12:5601

opt目录下创建log目录

mkdir log

cd log

vim system.conf

input {

file{

#收集日志的路径

path=>"/var/log/messages"

type =>"system"

#收集日志文件

start_position => "beginning"

}

}

output {

elasticsearch {

hosts => ["20.0.0.10:9200","20.0.0.11:9200"]

index =>"system-%{+YYYY.MM.dd}"

}

}

logstash -f system.conf --path.data /opt/xiaobu

kibana

先点击管理

创建索引

system-*

下一步

@timestamp

Create index pattern

elk监控http服务日志

添加服务日志

vim

input {

file{

#收集日志的路径

path=>"/var/httpd/logs/access_log"

type =>"access"

#收集日志文件

start_position => "beginning"

}

}

file{

#收集日志的路径

path=>"/var/httpd/logs/error_log"

type =>"error"

#收集日志文件

start_position => "beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["20.0.0.10:9200","20.0.0.11:9200"]

index => "http_access-%{YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["20.0.0.10:9200","20.0.0.11:9200"]

index => "http_error-%{YYYY.MM.dd}"

}

}

}

logstash -f httpd.conf --path.data /opt/test1elk监控Nginx服务日志(json格式 )

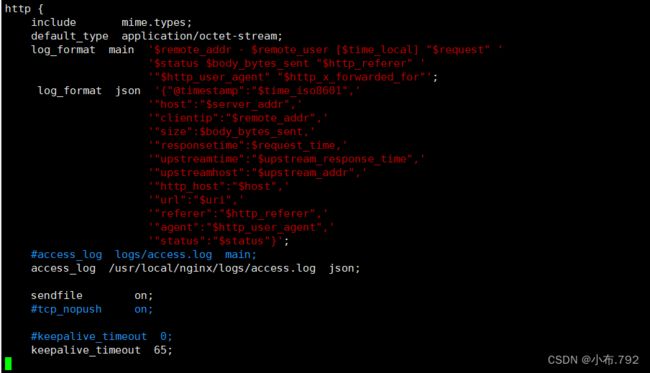

修改Nginx配置文件,修改为json格式

在全局模块中配置

http {

include mime.types;

default_type application/octet-stream;

log_format main '$remote_addr - $remote_user [$time_local] "$request" '

'$status $body_bytes_sent "$http_referer" '

'"$http_user_agent" "$http_x_forwarded_for"';

log_format json '{"@timestamp":"$time_iso8601",'

'"host":"$server_addr",'

'"clientip":"$remote_addr",'

'"size":$body_bytes_sent,'

'"responsetime":$request_time,'

'"upstreamtime":"$upstream_response_time",'

'"upstreamhost":"$upstream_addr",'

'"http_host":"$host",'

'"url":"$uri",'

'"referer":"$http_referer",'

'"agent":"$http_user_agent",'

'"status":"$status"}';

#access_log logs/access.log main;

access_log /usr/local/nginx/logs/access.log json;

在opt目录下创建conf

vim nginx.conf

input {

file{

path => "/usr/local/nginx/logs/access.log"

type => "access"

start_position => "beginning"

}

file{

path => "/usr/local/nginx/logs/error.log"

type => "error"

start_position =>"beginning"

}

}

output {

if [type] == "access" {

elasticsearch {

hosts => ["20.0.0.10:9200","20.0.0.11:9200"]

index => "nginx_access-%{+YYYY.MM.dd}"

}

}

if [type] == "error" {

elasticsearch {

hosts => ["20.0.0.10:9200","20.0.0.11:9200"]

index => "nginx_error-%{+YYYY.MM.dd}"

}

}

}

logstash -f nginx.conf --path.data /opt/test3

# --path.data /opt/test3:加上后会自动生成数据的工作目录且工作目录不能重复

path.config: /opt/log

#/opt/log:配置文件的指定位置

path.data: /var/lib/logstash

#/var/lib/logstash:这个工作目录不需要修改logstash的命令常用选项

-f 指定配置文件,根据配置文件识别输入和输出流

-e 测试,从命令行当中获取输入,然后经过Logstash加工之后,形成一个标准输出

-t 检测额配置文件是否正确,然后退出es的性能调优

修改打开的最大文件数

vim /etc/security/limit.conf

* soft nofile 65536

* hard nofile 65536

* soft nproc 32000

* hard nproc 32000

#不对内存使用限制

* soft memlock unlimited

* hard memlock unlimited

重启

reboot对系统内存优化

vim /etc/systemd/system.conf

#一个用户会话的默认最大文件描述符的限制量

#文件描述符:用于标识打开文件或者I/O资源限制的整数

DefaultLimitNOFILE=65536

#一个用户可以打开的最大进程数量的限制 32000 ,一个用户的终端可以运行多少个进程

DefaultLimitNPROC=32000

#一个用户的终端默认锁定内存的限制,不限制

DefaultLimitMEMLOCK=infinity内核优化

es是基于lucene架构,实现的一款索引型数据库,lucene可以利用操作系统的内存来缓存es的索引数据

提供更快的查询速度,在工作中我们会把系统的一般内存留给lucene

机器内存小于64G,50%给es,50%给操作系统,供lucene使用

机器内存大于64G,es分配4-32G即可,其他的都给操作系统,供lucene

vim /etc/sysctl.conf

vm.max_map_count=262144

#一个进程可以拥有的最大内存映射区参数

#内存映射:将文件或者其他设备映射进程地址空间的方法,允许进程直接读取或写入文件,无需常规的I\O方式,映射空间越大,ES和lucene的速度越快

2g/262144

4g/4194304

8g/8388608elk总结

es:存储数据,索引型的数据库

logstash:收集日志,然后按照标准化格式发送给es(RUBYDEBUG的格式)

k:可视化工具,更人性化的显示用户信息,方便用户检索查询