大型语言模型:SBERT — Sentence-BERT

一、介绍

Transformer 在 NLP 方面取得了进化进步,这已经不是什么秘密了。基于转换器,许多其他机器学习模型已经发展起来。其中之一是BERT,它主要由几个堆叠的变压器编码器组成。除了用于情感分析或问答等一系列不同的问题外,BERT在构建词嵌入(表示词的语义含义的数字向量)方面也越来越受欢迎。

以嵌入的形式表示单词具有巨大的优势,因为机器学习算法不能处理原始文本,但可以对向量的向量进行操作。这允许通过使用欧几里得或余弦距离等标准度量来比较不同单词的相似性。

问题在于,在实践中,我们经常需要构造嵌入,而不是为单个单词,而是为整个句子。但是,基本的 BERT 版本仅在单词级别上构建嵌入。因此,后来开发了几种类似 BERT 的方法来解决此问题,本文将对此进行讨论。通过逐步讨论它们,我们将达到称为 SBERT 的最先进的模型。

为了深入了解 SBERT 在后台的工作原理,建议您已经熟悉 BERT。如果没有,本系列文章的前一部分将对此进行详细解释。

二、Bert

首先,让我们提醒一下 BERT 如何处理信息。作为输入,它采用一个 [CLS] 令牌和两个句子,由一个特殊的 [SEP] 标记分隔。根据型号配置,多头注意力块会处理 12 或 24 次此信息。然后,将输出聚合并传递到简单的回归模型以获取最终标签。

BERT架构

有关 BERT 内部工作原理的更多信息,您可以参考本系列文章的前一部分:

2.1 交叉编码器架构

可以使用BERT来计算一对文档之间的相似性。考虑在大型集合中查找最相似的句子对的目标。为了解决这个问题,每个可能的对都被放在BERT模型中。这会导致推理过程中的二次复杂度。例如,处理 n = 10 000 个句子需要 n * (n — 1) / 2 = 49 995 000 次推理 BERT 计算,这实际上不可扩展。

2.2 其他方法

分析交叉编码器架构的低效率,为每个句子独立预计算嵌入似乎是合乎逻辑的。之后,我们可以直接计算所有文档对上所选的距离度量,这比将二次数的句子对提供给 BERT 要快得多。

不幸的是,这种方法在BERT中是不可能的:BERT的核心问题是,每次同时传递和处理两个句子时,很难获得仅独立表示单个句子的嵌入。

研究人员试图通过使用 [CLS] 标记嵌入的输出来消除这个问题,希望它包含足够的信息来表示一个句子。然而,事实证明,[CLS]对这项任务根本没有用,因为它最初是在BERT中预先训练的,用于下一个句子预测。

另一种方法是将单个句子传递给 BERT,然后对输出标记嵌入进行平均。然而,获得的结果甚至比简单地平均GLoVe嵌入还要糟糕。

推导独立的句子嵌入是BERT的主要问题之一。为了缓解这一方面,开发了SBERT。

三、SBERT

SBERT 引入了连体网络概念,这意味着每次两个句子通过同一个 BERT 模型独立传递。在讨论 SBERT 架构之前,让我们先看一下关于连体网络的一个微妙的注释:

大多数时候,在科学论文中,暹罗网络架构被描述为几个模型接收如此多的输入。实际上,可以将其视为具有相同配置和权重的单个模型,这些配置和权重在多个并行输入之间共享。每当为单个输入更新模型权重时,它们也会为其他输入同样更新。

左边是非连体(交叉编码器)架构,右边是连体(双编码器)架构。主要区别在于,在左侧,模型同时接受两个输入。在右侧,模型并行接受两个输入,因此两个输出不相互依赖。

回到 SBERT,在通过 BERT 传递句子后,将池化层应用于 BERT 嵌入以获得其低维表示:最初的 512 个 768 维向量被转换为单个 768 维向量。对于池化层,SBERT的作者建议选择均值池化层作为默认层,尽管他们也提到可以使用最大池化策略,或者简单地采用[CLS]令牌的输出。

当两个句子都通过池化层时,我们有两个 768 维向量 u 和 v。通过使用这两个向量,作者提出了三种优化不同目标的方法,这些方法将在下面讨论。

3.1 分类目标函数

此问题的目标是在几个类之一中正确地对给定的一对句子进行分类。

在生成嵌入 u 和 v 之后,研究人员发现生成从这两个源得出的另一个向量作为元素绝对差 |u-v| 是有用的。他们还尝试了其他特征工程技术,但这种技术显示出最好的结果。

最后,将三个向量 u、v 和 |u-v| 连接起来,乘以可训练的权重矩阵 W,并将乘法结果输入 softmax 分类器,该分类器输出对应于不同类的句子的归一化概率。交叉熵损失函数用于更新模型的权重。

用于分类目标的 SBERT 架构。参数 n 代表嵌入的维度(默认为 768 作为 BERT base),而 k 表示标签的数量。

NLI(自然语言推理)是用于解决该目标的最流行的现有问题之一,其中对于定义假设和前提的给定句子 A 和 B 对,有必要预测假设是真(蕴涵)、假(矛盾)还是未确定(中性)给定前提。对于此问题,推理过程与训练相同。

如本文所述,SBERT模型最初是在SNLI和MultiNLI两个数据集上训练的,这两个数据集包含一百万个句子对,具有相应的标签蕴涵、矛盾或中性。之后,论文研究人员提到了有关SBERT调谐参数的细节:

“我们用一个 3 分 softmax 分类器目标函数对 SBERT 进行微调,用于一个时期。我们使用了 16 个批处理大小、学习率为 2e−5 的 Adam 优化器,以及超过 10% 的训练数据的线性学习率预热。我们默认的池化策略是卑鄙的。

3.2 回归目标函数

在此公式中,在获得向量 u 和 v 后,它们之间的相似性分数由所选的相似性指标直接计算。将预测的相似度分数与真实值进行比较,并使用 MSE 损失函数更新模型。默认情况下,作者选择余弦相似度作为相似度指标。

回归目标的SBERT架构。参数 n 代表嵌入的维数(默认为 768 作为 BERT 基数)。

在推理过程中,可以通过以下两种方式之一使用此体系结构:

- 通过给定的句子对,可以计算相似度分数。推理工作流与训练完全相同。

- 对于给定的句子,可以提取其句子嵌入(在应用池化层之后)以供以后使用。当我们得到大量句子以计算它们之间的成对相似性分数时,这特别有用。通过仅通过 BERT 运行每个句子一次,我们提取了所有必要的句子嵌入。之后,我们可以直接计算所有向量之间选择的相似度指标(毫无疑问,它仍然需要二次比较,但同时我们避免了像以前那样使用 BERT 进行二次推理计算)。

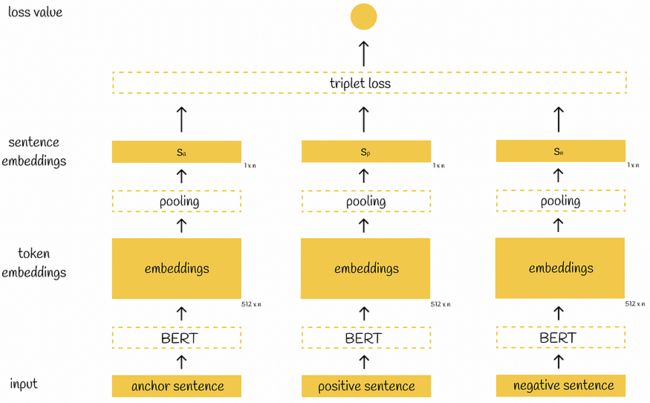

3.3 三重目标函数

三元组目标引入了三元组损失,该损失由三个句子计算,通常称为锚,正和负。假设锚句和肯定句彼此非常接近,而锚句和否定句则非常不同。在训练过程中,模型会评估对(锚,正)与对(锚,负)相比的接近程度。在数学上,以下损失函数最小化:

原始论文中的三元组损失函数。变量 sₐ、sp、sn 分别表示锚嵌入、正嵌入和负嵌入。符号 ||小号||是向量 s 的范数。参数 ε 称为边距。

边距 ε 确保肯定句比否定句更接近锚点至少ε。否则,损失将大于 0。默认情况下,在此公式中,作者选择欧几里得距离作为向量范数,参数 ε 设置为 1。

三元组 SBERT 架构与前两个架构的不同之处在于,该模型现在并行接受三个输入语句(而不是两个)。

回归目标的SBERT架构。参数 n 代表嵌入的维数(默认为 768 作为 BERT 基数)。

四、代码

SentenceTransformers 是一个最先进的 Python 库,用于构建句子嵌入。它包含用于不同任务的多个预训练模型。使用 SentenceTransformer 构建嵌入很简单,下面的代码片段中显示了一个示例。

然后,构造的嵌入可用于相似性比较。每个模型都是针对特定任务进行训练的,因此通过参考文档选择适当的相似度指标进行比较始终很重要。

五、结论

我们已经介绍了一种用于获取句子嵌入的高级 NLP 模型。通过将 BERT 推理执行的二次次数减少到线性,SBERT 在保持高精度的同时实现了速度的大幅增长。

为了最终理解这种差异有多显着,参考论文中描述的例子就足够了,研究人员试图在n = 10000个句子中找到最相似的一对。在现代 V100 GPU 上,使用 BERT 时此过程大约需要 65 小时,使用 SBERT 时只需 5 秒!这个例子表明 SBERT 是 NLP 的巨大进步。