YOLOv5改进 | 主干篇 | 利用RT-DETR特征提取网络PPHGNetV2改进YOLOv5 (附手撕结构图)

一、本文介绍

本文给大家带来利用RT-DETR模型主干HGNet去替换YOLOv8的主干,RT-DETR是今年由百度推出的第一款实时的ViT模型,其在实时检测的领域上号称是打败了YOLO系列,其利用两个主干一个是HGNet一个是ResNet,其中HGNet就是我们今天来讲解的网络结构模型,这个网络结构目前还没有推出论文,所以其理论知识在网络上也是非常的少,我也是根据网络结构图进行了分析。

推荐指数:⭐⭐⭐

专栏回顾:YOLOv5改进专栏——持续复现各种顶会内容——内含100+创新

训练结果对比图->

![]()

目录

一、本文介绍

二、HGNetV2原理讲解

三、HGNetV2的代码

四、手把手教你添加HGNetV2

4. 1 HGNetV2-l的yaml文件(此为对比试验版本)

4.2 HGNetV2-x的yaml文件

五、运行成功记录

六、本文总结

二、HGNetV2原理讲解

![]()

论文地址:RT-DETR论文地址

本文代码来源:HGNetV2的代码来源

![]()

PP-HGNet 骨干网络的整体结构如下:

![]()

其中,PP-HGNet是由多个HG-Block组成,HG-Block的细节如下:

![]()

上面的图表是PP-HGNet神经网络架构的概览,下面我会对其中的每一个模块进行分析:

1. Stem层:这是网络的初始预处理层,通常包含卷积层,开始从原始输入数据中提取特征。

2. HG(层次图)块:这些块是网络的核心组件,设计用于以层次化的方式处理数据。每个HG块可能处理数据的不同抽象层次,允许网络从低级和高级特征中学习。

3. LDS(可学习的下采样)层:位于HG块之间的这些层可能执行下采样操作,减少特征图的空间维度,减少计算负载并可能增加后续层的感受野。

4. GAP(全局平均池化):在最终分类之前,使用GAP层将特征图的空间维度减少到每个特征图一个向量,有助于提高网络对输入数据空间变换的鲁棒性。

5. 最终的卷积和全连接(FC)层:网络以一系列执行最终分类任务的层结束。这通常涉及一个卷积层(有时称为1x1卷积)来组合特征,然后是将这些特征映射到所需输出类别数量的全连接层。

这种架构的主要思想是利用层次化的方法来提取特征,其中复杂的模式可以在不同的规模和抽象层次上学习,提高网络处理复杂图像数据的能力。

这种分层和高效的处理对于图像分类等复杂任务非常有利,在这些任务中,精确预测至关重要的是在不同规模上识别复杂的模式和特征。图表还显示了HG块的扩展视图,包括多个不同滤波器大小的卷积层,以捕获多样化的特征,然后通过一个元素级相加或连接的操作(由+符号表示)在数据传递到下一层之前。

下面为手撕网络结构图->

三、HGNetV2的核心代码

我们找到如下的目录'yolov5-master/models'在这个目录下创建一个文件目录(注意是目录,因为我这个专栏会出很多的更新,这里用一种一劳永逸的方法)文件目录起名modules,然后在下面新建一个文件,将我们的代码复制粘贴进去。

import torch

import torch.nn as nn

import math

import torch.nn.functional as F

def autopad(k, p=None, d=1): # kernel, padding, dilation

"""Pad to 'same' shape outputs."""

if d > 1:

k = d * (k - 1) + 1 if isinstance(k, int) else [d * (x - 1) + 1 for x in k] # actual kernel-size

if p is None:

p = k // 2 if isinstance(k, int) else [x // 2 for x in k] # auto-pad

return p

class Conv(nn.Module):

"""Standard convolution with args(ch_in, ch_out, kernel, stride, padding, groups, dilation, activation)."""

default_act = nn.SiLU() # default activation

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, d=1, act=True):

"""Initialize Conv layer with given arguments including activation."""

super().__init__()

self.conv = nn.Conv2d(c1, c2, k, s, autopad(k, p, d), groups=g, dilation=d, bias=False)

self.bn = nn.BatchNorm2d(c2)

self.act = self.default_act if act is True else act if isinstance(act, nn.Module) else nn.Identity()

def forward(self, x):

"""Apply convolution, batch normalization and activation to input tensor."""

return self.act(self.bn(self.conv(x)))

def forward_fuse(self, x):

"""Perform transposed convolution of 2D data."""

return self.act(self.conv(x))

class LightConv(nn.Module):

"""

Light convolution with args(ch_in, ch_out, kernel).

https://github.com/PaddlePaddle/PaddleDetection/blob/develop/ppdet/modeling/backbones/hgnet_v2.py

"""

def __init__(self, c1, c2, k=1, act=nn.ReLU()):

"""Initialize Conv layer with given arguments including activation."""

super().__init__()

self.conv1 = Conv(c1, c2, 1, act=False)

self.conv2 = DWConv(c2, c2, k, act=act)

def forward(self, x):

"""Apply 2 convolutions to input tensor."""

return self.conv2(self.conv1(x))

class DWConv(Conv):

"""Depth-wise convolution."""

def __init__(self, c1, c2, k=1, s=1, d=1, act=True): # ch_in, ch_out, kernel, stride, dilation, activation

"""Initialize Depth-wise convolution with given parameters."""

super().__init__(c1, c2, k, s, g=math.gcd(c1, c2), d=d, act=act)

class HGStem(nn.Module):

"""

StemBlock of PPHGNetV2 with 5 convolutions and one maxpool2d.

https://github.com/PaddlePaddle/PaddleDetection/blob/develop/ppdet/modeling/backbones/hgnet_v2.py

"""

def __init__(self, c1, cm, c2):

"""Initialize the SPP layer with input/output channels and specified kernel sizes for max pooling."""

super().__init__()

self.stem1 = Conv(c1, cm, 3, 2)

self.stem2a = Conv(cm, cm // 2, 2, 1, 0)

self.stem2b = Conv(cm // 2, cm, 2, 1, 0)

self.stem3 = Conv(cm * 2, cm, 3, 2)

self.stem4 = Conv(cm, c2, 1, 1)

self.pool = nn.MaxPool2d(kernel_size=2, stride=1, padding=0, ceil_mode=True)

def forward(self, x):

"""Forward pass of a PPHGNetV2 backbone layer."""

x = self.stem1(x)

x = F.pad(x, [0, 1, 0, 1])

x2 = self.stem2a(x)

x2 = F.pad(x2, [0, 1, 0, 1])

x2 = self.stem2b(x2)

x1 = self.pool(x)

x = torch.cat([x1, x2], dim=1)

x = self.stem3(x)

x = self.stem4(x)

return x

class HGBlock(nn.Module):

"""

HG_Block of PPHGNetV2 with 2 convolutions and LightConv.

https://github.com/PaddlePaddle/PaddleDetection/blob/develop/ppdet/modeling/backbones/hgnet_v2.py

"""

def __init__(self, c1, cm, c2, k=3, n=6, lightconv=False, shortcut=False, act=True):

"""Initializes a CSP Bottleneck with 1 convolution using specified input and output channels."""

super().__init__()

block = LightConv if lightconv else Conv

self.m = nn.ModuleList(block(c1 if i == 0 else cm, cm, k=k, act=act) for i in range(n))

self.sc = Conv(c1 + n * cm, c2 // 2, 1, 1, act=act) # squeeze conv

self.ec = Conv(c2 // 2, c2, 1, 1, act=act) # excitation conv

self.add = shortcut and c1 == c2

def forward(self, x):

"""Forward pass of a PPHGNetV2 backbone layer."""

y = [x]

y.extend(m(y[-1]) for m in self.m)

y = self.ec(self.sc(torch.cat(y, 1)))

return y + x if self.add else y

四、手把手教你添加HGNetV2

4.1 细节修改教程

4.1.1 修改一

我们找到如下的目录'yolov5-master/models'在这个目录下创建一个文件目录(注意是目录,因为我这个专栏会出很多的更新,这里用一种一劳永逸的方法)文件目录起名modules,然后在下面新建一个文件,将我们的代码复制粘贴进去。

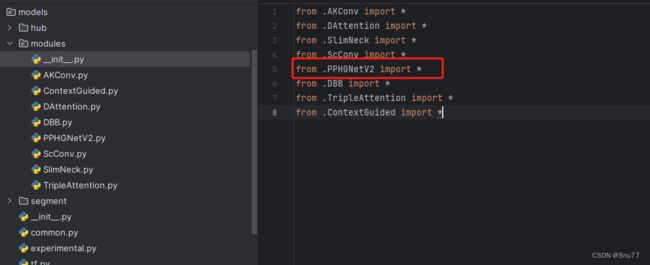

4.1.2 修改二

然后新建一个__init__.py文件,然后我们在里面添加一行代码。注意标记一个'.'其作用是标记当前目录。

4.1.3 修改三

然后我们找到如下文件''models/yolo.py''在开头的地方导入我们的模块按照如下修改->

(如果你看了我多个改进机制此处只需要添加一个即可,无需重复添加。)

![]()

4.1.4 修改四

然后我们找到parse_model方法,按照如下修改->

其中的DWConv以及集成在YOLOv5中了。

到此就修改完成了,复制下面的ymal文件即可运行。

4.2 HGNetV2 的yaml文件(仔细看这个否则会报错)

4.2.1 HGNetV2-x的yaml文件一

下面的配置文件为我修改的DBB的位置,参数的位置里面什么都不用添加空着就行,大家复制粘贴我的就可以运行,同时我提供多个版本给大家,根据我的经验可能涨点的位置。

# YOLOv5 by Ultralytics, AGPL-3.0 license

# Parameters

nc: 80 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.25 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# YOLOv5 v6.0 backbone

backbone:

# [from, repeats, module, args]

[[-1, 1, HGStem, [32, 48]], # 0-P2/4

[-1, 6, HGBlock, [48, 128, 3]], # stage 1

[-1, 1, DWConv, [128, 3, 2, 1, False]], # 2-P3/8

[-1, 6, HGBlock, [96, 512, 3]], # stage 2

[-1, 1, DWConv, [512, 3, 2, 1, False]], # 4-P3/16

[-1, 6, HGBlock, [192, 1024, 5, True, False]], # cm, c2, k, light, shortcut

[-1, 6, HGBlock, [192, 1024, 5, True, True]],

[-1, 6, HGBlock, [192, 1024, 5, True, True]], # stage 3

[-1, 1, DWConv, [1024, 3, 2, 1, False]], # 8-P4/32

[-1, 6, HGBlock, [384, 2048, 5, True, False]], # stage 4

[-1, 1, SPPF, [1024, 5]]], # 10

# YOLOv5.0n head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 7], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 14

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 3], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 18 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 21 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 24 (P5/32-large)

[[18, 21, 24], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]4.2.2 HGNetV2-l的yaml文件二

# YOLOv5 by Ultralytics, AGPL-3.0 license

# Parameters

nc: 80 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.25 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

# YOLOv5 v6.0 backbone

backbone:

# [from, repeats, module, args]

[[-1, 1, HGStem, [32, 64]], # 0-P2/4

[-1, 6, HGBlock, [64, 128, 3]], # stage 1

[-1, 1, DWConv, [128, 3, 2, 1, False]], # 2-P3/8

[-1, 6, HGBlock, [128, 512, 3]],

[-1, 6, HGBlock, [128, 512, 3, False, True]], # 4-stage 2

[-1, 1, DWConv, [512, 3, 2, 1, False]], # 5-P3/16

[-1, 6, HGBlock, [256, 1024, 5, True, False]], # cm, c2, k, light, shortcut

[-1, 6, HGBlock, [256, 1024, 5, True, True]],

[-1, 6, HGBlock, [256, 1024, 5, True, True]],

[-1, 6, HGBlock, [256, 1024, 5, True, True]],

[-1, 6, HGBlock, [256, 1024, 5, True, True]], # 10-stage 3

[-1, 1, DWConv, [1024, 3, 2, 1, False]], # 11-P4/32

[-1, 6, HGBlock, [512, 2048, 5, True, False]],

[-1, 6, HGBlock, [512, 2048, 5, True, True]], # 13-stage 4

[-1, 1, SPPF, [1024, 5]], # 14

]

# YOLOv5.0n head

head:

[[-1, 1, Conv, [512, 1, 1]], # 15

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 10], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 18

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 22 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 18], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 25 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 28 (P5/32-large)

[[22, 25, 28], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]4.3 HGNetV2运行成功截图

附上我的运行记录确保我的教程是可用的。

![]()

五、本文总结

到此本文的正式分享内容就结束了,在这里给大家推荐我的YOLOv5改进有效涨点专栏,本专栏目前为新开的平均质量分98分,后期我会根据各种最新的前沿顶会进行论文复现,也会对一些老的改进机制进行补充,目前本专栏免费阅读(暂时,大家尽早关注不迷路~),如果大家觉得本文帮助到你了,订阅本专栏,关注后续更多的更新~

专栏回顾:YOLOv5改进专栏——持续复现各种顶会内容——内含100+创新

![]()