Empowering Molecule Discovery for Molecule-Caption Translation with Large Language Models

Empowering Molecule Discovery for Molecule-Caption Translation with Large Language Models: A ChatGPT Perspective

基本信息

博客贡献人

秦明

作者

Jiatong Li,Yunqing Liu, Wenqi Fan, Xiao-Yong Wei, Hui Liu, Jiliang Tang, Qing Li

[单位]

The Hong Kong Polytechnic University

摘要

在各种科学领域,分子发现起着至关重要的作用,推动了定制材料和药物的设计。传统的分子发现方法遵循试错过程,既耗时又昂贵,而计算方法,如人工智能(AI)已经成为加快各种任务,如分子字幕翻译的革命性工具。尽管分子字幕翻译对于分子发现的重要性,但现有的大多数方法严重依赖领域专家,需要过多的计算成本,并且表现不佳。另一方面,像ChatGPT这样的大型语言模型(LLM)在各种跨模态任务中表现出了出色的性能,因为它们在自然语言理解、泛化和推理方面具有强大的能力,这为推进分子发现提供了前所未有的机会。为了解决上述限制,我们在这项工作中,提出了一种基于LLM的新框架(MolReGPT)进行分子字幕翻译,其中引入了一种基于检索的提示范式,以使LLM如ChatGPT在无需微调的情况下增强分子发现的能力。更具体地说,MolReGPT利用分子相似性的原理从本地数据库中检索相似分子及其文本描述,以便通过在上下文中的少数派分子学习来指导LLM的生成。我们通过分子字幕翻译评估MolReGPT的效果,其中包括分子理解和基于文本的分子生成。实验结果表明,MolReGPT在没有任何额外训练的情况下超过了像MolT5-base这样的微调模型。据我们所知,这是我们的最佳性能。

现有挑战&动机

1、分子-文本描述间相互翻译任务中的模型架构的设计严重依赖领域专家,这大大限制了人工智能驱动分子发现的发展。

2、大多数现有方法遵循“预训练&微调”的模型进行,这需要过多的计算成本。

3、现有的方法,如Text2Mol和MolT5,不能对复杂的任务进行推理,也不能对未曾见过的样本进行归纳。

大语言模型(LLMs)在自然语言处理(NLP)领域取得了巨大的成就。LLMs除了在自然语言理解和生成方面具有令人印象深刻的能力外,还展示了强大的泛化和推理能力。它可以通过上下文学习(In-Context Learning,ICL)泛化到其他未见过的任务,而无需进行微调,在很大程度上降低计算成本。因此,LLMs在推进分子发现方面具有前所未有的潜力,特别是在分子-文本描述间相互翻译任务方面。

1. 分子-文本描述检索(Molecule-Caption Retrieval)

这个阶段,用于从数据库中检索出n个与输入分子或者分子文本描述最相似的分子-分子描述对(即小样本学习的例子)。这个过程主要依赖于分子摩根指纹(针对Mol2Cap)和BM25(针对Cap2Mol)两种检索方法。

a. 基于摩根指纹的分子检索(针对Mol2Cap)

分子摩根指纹和Dice相似性图示。绿色对应的是对分子间相似性分数有正贡献的子结构,紫色部分对应的是对分子间相似性分数有负贡献的或者有差异的子结构。

为了提取摩根指纹,使用rdkit库将分子的SMILES表示转换为rdkit对象。随后应用Dice相似度,来衡量输入分子和本地数据库中的分子之间的相似度。在数学上,可以表示为:

D i c e ( A , B ) = ( 2 ∗ ∣ A ∩ B ∣ ) ∣ A ∣ + ∣ B ∣ Dice(A,B)=\frac{(2*\left |A\cap B \right | )}{\left | A \right |+\left | B \right | } Dice(A,B)=∣A∣+∣B∣(2∗∣A∩B∣)

其中,A和B是两个分子的摩根指纹。|A|和|B|表示A和B的基数(例如,子结构数量)。|A ∩ B|表示A和B共有的子结构的数量。Dice相似性的范围是0到1,其中0表示分子之间没有重叠或相似性,1表示完全重叠。

b. 基本BM25的分子文本生成检索(针对Cap2Mol)

BM25是信息检索中最具代表性的排名方法之一,用于计算文档与给定查询的相关性。在Cap2Mol任务中,使用输入的文字描述作为查询句子,而本地数据库中的文字描述作为文档的语料库,其中每个文本描述代表一个文档。在数学上,BM25公式可以定义如下:

s c o r e ( Q , D ) = ∑ i = 1 N I D F ( q i ) ∗ f ( q i , D ) ∗ ( k 1 + 1 ) f ( q i , D ) + k 1 ∗ ( 1 − b + b ∗ ∣ D ∣ a v g d l ) score(Q,D)=\sum_{i=1}^{N}IDF(q_{i})*\frac{f(q_{i,D})*(k_{1}+1)}{f(q_{i},D)+k_{1}*(1-b+b*\frac{\left | D \right | }{avgdl} )} score(Q,D)=i=1∑NIDF(qi)∗f(qi,D)+k1∗(1−b+b∗avgdl∣D∣)f(qi,D)∗(k1+1)

其中,D是文本描述语料库,Q使查询的文本描述。N是查询文本描述中查询词的数量,Qi是第i个查询词,IDF(Qi)是Qi的反文档频率,f(Qi,D)是Qi在D中的词频,k1和b是调整参数,|D|是D的长度,avgdl是语料库中平均文本描述的长度。在文本描述检索中,BM25被用于计算文本描述之间的相似性分数,这样可以通过筛选分子-文本描述对来学习文本描述中所对应的相关分子结构。

2. Prompt提示管理 (Prompt Management)

Prompt提示管理 (Prompt Management) :这一阶段主要对ChatGPT的系统提示进行管理和构建,Prompt提示中主要包括角色识别(Role Identification)、任务描述(Task Description)、检索的示例(Examples)和输出指示(Output Instruction)这四个部分。其中,示例将由第一步的检索过程给出。每一部分都承担着对输出的特定指导作用。

a. 角色识别(Role Identification)

角色识别的目的是帮助LLMs认知为在化学和分子发现领域的专家角色。通过认知为这个角色,鼓励LLMs产生与特定领域预期的专业知识相一致的回答。

b. 任务描述(Task Description)

任务描述提供了对任务内容的全面解释,确保LLM对他们需要处理的具体任务有一个明确的认识。它还包括关键的定义,以澄清分子-文本描述间相互翻译任务中的专业术语或概念。

c. 检索的示例(Examples)

将检索的示例作为用户输入提示,使LLMs能够利用小样本学习示例中包含的信息作出更好的回应。

d. 输出指示(Output Instruction)

输出指示规定了响应的格式。这里,研究人员将输出限制为JSON格式。选择JSON格式可以快速有效地验证LLMs的回答,确保它符合预期的结果,便于进一步处理和分析。

3. 上下文小样本分子学习(In-Context Few-Shot Moleule Learning)

上下文小样本分子学习(In-Context Few-Shot Moleule Learning): 在这个阶段,系统提示和用户输入提示将会一起提供给ChatGPT进行上下文小样本分子学习。这个过程基于大语言模型的上下文学习能力,仅仅依靠少量相似的样本,就可以捕获到分子的结构所对应的特性,来进行分子-文本描述间相互翻译任务,而不需要对大语言模型进行微调。

系统提示和用户输入提示的结合通过上下文学习为ChatGPT提供了清晰的指引,系统提示建立了分子-文本描述间相互翻译和分子领域专业知识的任务框架,而用户提示则缩小了范围,将模型的注意力引导到具体的用户输入上。

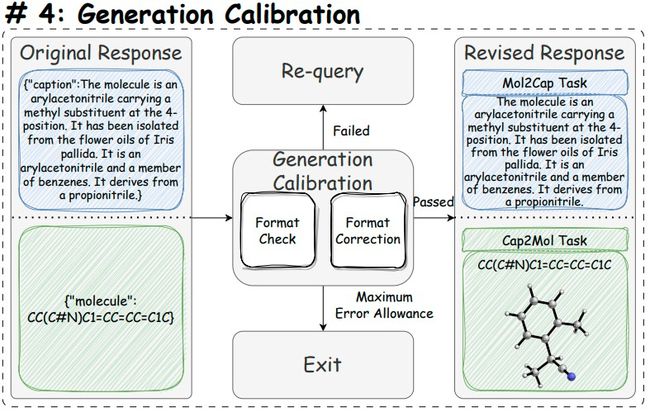

4. 生成校准(Generation Calibration)

生成校准(Generation Calibration): 在这个阶段,系统会对ChatGPT的输出进行校准,以确保其符合预期的格式和要求。如果输出不符合预期,系统会重新交给ChatGPT进行生成,直到达到最大允许的错误次数。

尽管指定了所需的输出格式,LLM(例如ChatGPT)偶尔也会产生意外的响应,包括不正确的输出格式和拒绝回答。为了解决这些问题,研究人员引入了一个生成校准机制来验证ChatGPT的响应。在生成校准中,他们首先通过将原始响应解析为JSON对象来检查其格式。如果解析过程失败,表明偏离了预期的格式,就会引入几个预定义的格式校正策略,如正则匹配,以校正格式并从响应中提取所需的结果。如果原始回答成功地通过了格式检查,或者可以使用格式校正策略进行校准,那么它就被认为是有效的并被接受为最终回答。然而,如果原始响应没有通过格式检查,并且不能在预定的策略中进行校正,我们就会启动重新查询。值得注意的是,重新查询有一个特殊情况。当原始响应报告 "超出最大输入长度限制 "错误时,将在重新查询阶段删除最长的例子,直到查询长度满足长度限制。重新查询过程包括对LLM进行额外的查询,直到获得一个有效的响应或达到最大的错误允许值为止。这个最大误差允许值的设置是为了确保系统不会陷入无休止的循环,而是在可接受的范围内向用户提供一个合适的响应。

通过采用生成校准阶段,可以减少与所需输出格式的意外偏差,并确保最终的响应与预期的格式和要求一致。

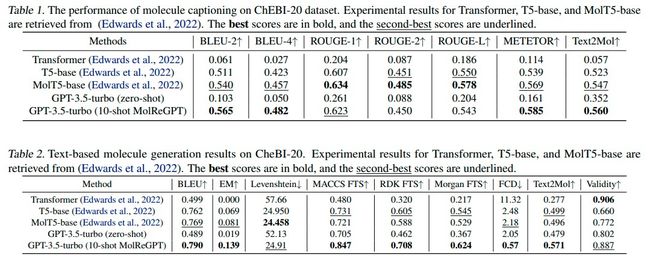

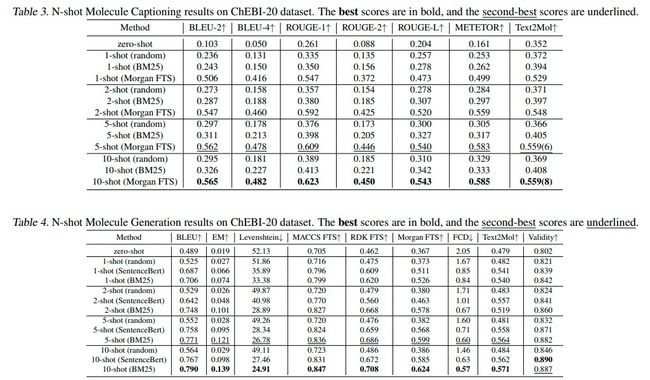

实验结果

表3 分子描述不同shot对结果的影响

表4 分子生成不同shot对结果的影响

总结

这篇文章提出了MolReGPT,一种通用的基于检索的上下文小样本分子学习的提示范式,赋予大语言模型(如ChatGPT)分子发现的能力。MolReGPT利用分子相似性原理从本地数据库中检索分子-分子文本描述对作为上下文学习中的示例,指导大语言模型生成分子的SMILES字符串,从而无需对大语言模型进行微调。

这篇工作的方法专注于分子-文本描述间相互翻译任务,包括分子文本描述生成(Mol2Cap)和基于文本的分子生成(Cap2Mol),并在该任务上对大语言模型的能力进行了评估。实验结果表明,MolReGPT可以使ChatGPT在分子描述生成和分子生成方面分别达到0.560和0.571的Text2Mol分数。从分子理解和基于文本的分子生成角度来看,其性能都超过了MolT5-base这样的微调模型,甚至可以与微调的MolT5-large相媲美。总而言之,MolReGPT提供了一个新颖的、多功能集成的范式,通过上下文学习在分子发现中部署大型语言模型,这大大降低了领域转移的成本,探索了大型语言模型在分子发现中的潜力。

亮点

- 在不进行训练和微调的前提之下,直接使用gpt进行分子翻译工作。

- 提出了未知分子描述和分子序列的自动生成方法。

BibTex

@misc{tang2023graphgpt,

title={GraphGPT: Graph Instruction Tuning for Large Language Models},

author={Jiabin Tang and Yuhao Yang and Wei Wei and Lei Shi and Lixin Su and Suqi Cheng and Dawei Yin and Chao Huang},

year={2023},

eprint={2310.13023},

archivePrefix={arXiv},

primaryClass={cs.CL}

}