[转]hadoop的安装和使用

hadoop是目前比较流程的分布式计算平台,虽然安装和使用方法官方网站介绍的比较详细,但是其中细节还是挺多的,稍不注意就要走很多弯路,希望通过本文的介绍,大家能够在很短的时间内能将hadoop跑起来。 由于公司云梯用的是0.19.2版本的,所以下面就以这个版本为例,而没有采用目前最新的0.21版本。

hadoop官方网站地址:http://hadoop.apache.org

可以用以下三种支持的模式中的一种启动Hadoop集群:

•单机模式

•伪分布式模式

•完全分布式模式

单机和伪分布模式只需要一台机器就可以完成,下面我们先来学习这两种模式。

hadoop目前只有linux版本,所以你需要一台linux系统的服务器,可以跟我一样用虚拟机,而且需要先安装好jdk。我的服务器版本是centos 5.6,自己将jdk安装到了/usr/java/jdk1.6.0_25。下面我们来下载并配置hadoop运行环境。

1.单机模式

我这台机器的ip地址是:192.168.218.128,为了方便,我将这台机器的hostname改成了hd128,这样以后需要配置的地方都是用hd128了,修改方法是编辑文件/proc/sys/kernel/hostname。然后修改下hosts文件,将 192.168.218.128 hd128也加入进来吧。为了方便,将所用的windows机器hosts也添加下这个配置,因为以后要用浏览器访问hadoop的服务,查看hadoop的运行状况。

注意:下面配置中涉及到hd128的地方,你需要修改成你自己相应的配置。

- cd /data

- wget http://archive.apache.org/dist/hadoop/core/hadoop-0.19.2/hadoop-0.19.2.tar.gz

- tar xf hadoop-0.19.2.tar.gz

- mv hadoop-0.19.2 hadoop

然后修改配置文件/data/hadoop/conf/hadoop-env.sh,将JAVA_HOME的值为jdk安装目录,如下:

export JAVA_HOME=/usr/java/jdk1.6.0_25

下面的实例将已解压的conf 目录拷贝作为输入,查找并显示匹配给定正则表达式的条目。输出写入到指定的output目录。

- mkdir input

- //向input目录放置一些待分析的xml文件

- cp conf/*.xml input

- //执行hadoop-0.19.2-examples.jar这个jar文件,将input目录所有的文件中匹配'dfs[a-z.]+'的条目,输出到output目录

- bin/hadoop jar hadoop-0.19.2-examples.jar grep input output 'dfs[a-z.]+'

下面看看程序运行结果,可以看到所有匹配'dfs[a-z.]+'的字符串及其匹配的次数。

- cat output/*

- [root@hd128 hadoop]# cat output/*

- 3 dfs.

- 3 dfs.name.dir

- 1 dfs.https.address

- 1 dfs.access.time.precision

- 1 dfs.balance.bandwidth

- 1 dfs.block.size

- 1 dfs.blockreport.initial

- 1 dfs.blockreport.interval

- 1 dfs.client.block.write.retries

- 1 dfs.data.dir

- 1 dfs.datanode.address

- 1 dfs.datanode.dns.interface

- 1 dfs.datanode.dns.nameserver

- 1 dfs.datanode.du.reserved

- 1 dfs.datanode.handler.count

- 1 dfs.datanode.http.address

- 1 dfs.datanode.https.address

- 1 dfs.datanode.ipc.address

- 1 dfs.default.chunk.view.size

- 1 dfs.df.interval

- 1 dfs.heartbeat.interval

- 1 dfs.hosts

- 1 dfs.hosts.exclude

- 1 dfs.http.address

- 1 dfs.impl

- 1 dfs.max.objects

- 1 dfs.name.edits.dir

- 1 dfs.namenode.decommission.interval

- 1 dfs.namenode.decommission.interval.

- 1 dfs.namenode.decommission.nodes.per.interval

- 1 dfs.namenode.handler.count

- 1 dfs.namenode.logging.level

- 1 dfs.permissions

- 1 dfs.permissions.supergroup

- 1 dfs.replication

- 1 dfs.replication.consider

- 1 dfs.replication.interval

- 1 dfs.replication.max

- 1 dfs.replication.min

- 1 dfs.replication.min.

- 1 dfs.safemode.extension

- 1 dfs.safemode.threshold.pct

- 1 dfs.secondary.http.address

- 1 dfs.support.append

- 1 dfs.web.ugi

2.伪分布式模式

Hadoop可以在单节点上以所谓的伪分布式模式运行,此时每一个Hadoop守护进程都作为一个独立的Java进程运行。

伪分布式模式需要免密码ssh设置,确认能否不输入口令就用ssh登录localhost:

- ssh localhost

如果不输入口令就无法用ssh登陆localhost,执行下面的命令(注意:只有拥有root权限的用户才能执行下面命令):

- ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

- cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

$ ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

$ cat ~/.ssh/id_dsa.pub >> ~/.ssh/authorized_keys

$ chmod 600 ~/.ssh/authorized_keys

$ chmod 700 ~/.ssh/

然后修改conf/hadoop-site.xml,注意,官方教程有点错误:<value>localhost:9000</value>,这个地址必须带上hdfs://,不然后面会报错的。另外,dfs.name.dir配置的路径/data/hadoopdata/NameData需要自己手动创建下,不然也会报错的。

- <configuration>

- <property>

- <name>fs.default.name</name>

- <value>hdfs://hd128:9090</value>

- </property>

- <property>

- <name>mapred.job.tracker</name>

- <value>hdfs://hd128:9091</value>

- </property>

- <property>

- <name>dfs.replication</name>

- <value>1</value>

- </property>

- <property>

- <name>dfs.name.dir</name>

- <value>/data/hadoopdata/NameData</value>

- </property>

- <property>

- <name>hadoop.tmp.dir</name>

- <value>/data/hadoopdata/temp</value>

- </property>

- </configuration>

配置完成后就可以测试下伪分布式模式运行的hadoop集群了。

格式化一个新的分布式文件系统:

- bin/hadoop namenode -format

启动Hadoop守护进程:

- bin/start-all.sh

Hadoop守护进程的日志写入到 ${HADOOP_LOG_DIR} 目录 (默认是 ${HADOOP_HOME}/logs).如果启动有错误,可以在这些日志文件看到更详细的错误信息。

浏览NameNode和JobTracker的网络接口,它们的地址默认为:

•NameNode - http://hd128:50070/

•JobTracker - http://hd128:50030/

下面我们来使用伪分布模式做点事情。

首先将输入文件拷贝到分布式文件系统,下面命令将本地的conf目录文件拷贝到hdfs的input目录。

bin/hadoop fs -put conf input

下面运行程序对input目录的文件进行解析,找到所有符合'dfs[a-z.]+'的行。

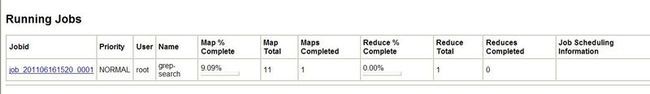

- [root@hd128 hadoop]# bin/hadoop jar hadoop-*-examples.jar grep input output 'dfs[a-z.]+'

- 11/06/16 15:23:23 INFO mapred.FileInputFormat: Total input paths to process : 10

- 11/06/16 15:23:24 INFO mapred.JobClient: Running job: job_201106161520_0001

- 11/06/16 15:23:25 INFO mapred.JobClient: map 0% reduce 0%

- 11/06/16 15:24:05 INFO mapred.JobClient: map 9% reduce 0%

- 11/06/16 15:25:30 INFO mapred.JobClient: map 9% reduce 3%

- 11/06/16 15:25:32 INFO mapred.JobClient: map 27% reduce 3%

- 11/06/16 15:26:37 INFO mapred.JobClient: map 27% reduce 9%

可以看到控制显示的map和reduce的进度,这时候通过浏览器查看NameNode和JobTracker的运行状态分别如下图所示:

等map-reduce程序运行完毕,我们在hdfs文件系统上看看程序的运行结果:

- bin/hadoop fs -cat output/part-00000

可以看到跟单机运行的结果是一样的。

完成全部操作后,停止守护进程:

- bin/stop-all.sh

3.完全分布式模式

为了在完全分布式模式下运行,我弄了三个centos虚拟机,ip分别是 192.168.218.128,192.168.218.129,192.168.218.130,hostname分别设置为 hd128,hd129,hd130, hosts文件将这些都配置进去了,这样以后就可以直接通过hostname访问到了。

我准备将hd128这台机器做为master(NameNode和JobTracker),hd129和hd130都做为slave机器(DataNode和TaskTracker)。

由于master和所有的slave之间是需要使用ssh协议进行通讯的,所以每两台之间,以及每台对自己都必须做到可以无密码ssh访问。上面已经介绍了怎样对自己无密码ssh访问,下面再说下怎样做到两台机器之间无密码访问,我们以hd128和hd129之间为例:

首先在hd128上生成一个公钥,并拷贝到hd129上:

- ssh-keygen -t dsa -P '' -f ~/.ssh/id_dsa

- scp ~/.ssh/id_dsa.pub root@hd129:/tmp

然后在hd129上,将这个公钥加入到权限控制文件中:

- cat /tmp/id_dsa.pub >> ~/.ssh/authorized_keys

经过上面的步骤,hd128对hd129的ssh访问就不需要输入密码了,依照上面的方法,将hd128,hd129,hd130两两之间都弄好无密码访问的权限,这个工作一定要细致,很容易弄错或弄漏了,做好后,最好都ssh试试。

经过我的实验,完全分布式模式至少需要在上面的基础下还要进行如下配置。

修改conf/hadoop-env.sh,添加下面配置:

- export HADOOP_HOME=/data/hadoop

- export HADOOP_CONF_DIR=$HADOOP_HOME/conf

- export HADOOP_SLAVES=${HADOOP_HOME}/conf/slaves

- export HADOOP_MASTER=hd128:/data/hadoop

修改conf/masters,一行一个master

- hd128

修改conf/slaves,一行一个slave

- hd129

- hd130

就这样master就配置好了,下面将hadoop整个目录分发到所有slave机器上面。

- cd /data

- tar -czvf hadoop-ok.tar.gz hadoop

- scp hadoop-ok.tar.gz root@hd129:/data

- scp hadoop-ok.tar.gz root@hd130:/data

在slave机器上解压tar文件

- cd /data

- tar xf hadoop-ok.tar.gz

配置基本上就完成了,下面就可以以完全分布式模式启动hadoop集群了。对hadoop集群的操作都在master机器上进行就行了,slave进程的启动和停止都是master通过ssh来控制的。

(1)首先我们需要格式化hdfs文件系统

- cd /data/hadoop

- bin/hadoop namenode -format

(2)启动hdfs文件系统

- bin/start-dfs.sh

测试下hdfs文件系统是否好用了,我们将conf目录下的所有文件放到hdfs的input目录:

bin/hadoop fs -put conf input

下面查看下input目录下下的文件:

- [root@hd128 hadoop]# bin/hadoop fs -ls input

- Found 10 items

- -rw-r--r-- 1 root supergroup 2065 2011-06-19 15:41 /user/root/input/capacity-scheduler.xml

- -rw-r--r-- 1 root supergroup 535 2011-06-19 15:41 /user/root/input/configuration.xsl

- -rw-r--r-- 1 root supergroup 50230 2011-06-19 15:41 /user/root/input/hadoop-default.xml

- -rw-r--r-- 1 root supergroup 2397 2011-06-19 15:41 /user/root/input/hadoop-env.sh

- -rw-r--r-- 1 root supergroup 1245 2011-06-19 15:41 /user/root/input/hadoop-metrics.properties

- -rw-r--r-- 1 root supergroup 711 2011-06-19 15:41 /user/root/input/hadoop-site.xml

- -rw-r--r-- 1 root supergroup 2815 2011-06-19 15:41 /user/root/input/log4j.properties

- -rw-r--r-- 1 root supergroup 6 2011-06-19 15:41 /user/root/input/masters

- -rw-r--r-- 1 root supergroup 12 2011-06-19 15:41 /user/root/input/slaves

- -rw-r--r-- 1 root supergroup 401 2011-06-19 15:41 /user/root/input/sslinfo.xml.example

如果顺利看到这些文件,hdfs就启动正常了。

(3)启动map-reduce服务

- bin/start-mapred.sh

下面检测下服务是否启动正常。

看看master机器上namenode和jobTracker服务是否存在:

- [root@hd128 hadoop]# ps axu|grep java

- root 28546 0.3 11.3 1180236 24564 ? Sl 15:26 0:00 /usr/java/jdk1.6.0_25/bin/java -Xmx1000m -Dcom.sun.management.jmxremote -Dcom.sun.management.jmxremote -Dhadoop.log.dir=/data/hadoop/logs -Dhadoop.log.file=hadoop-root-secondarynamenode-hd128.log -Dhadoop.home.dir=/data/hadoop -Dhadoop.id.str=root -Dhadoop.root.logger=INFO,DRFA -Djava.library.path=/data/hadoop/lib/native/Linux-i386-32 -classpath /data/hadoop/conf:/usr/java/jdk1.6.0_25/lib/tools.jar:/data/hadoop:/data/hadoop/hadoop-0.19.2-core.jar:/data/hadoop/lib/commons-cli-2.0-SNAPSHOT.jar:/data/hadoop/lib/commons-codec-1.3.jar:/data/hadoop/lib/commons-httpclient-3.0.1.jar:/data/hadoop/lib/commons-logging-1.0.4.jar:/data/hadoop/lib/commons-logging-api-1.0.4.jar:/data/hadoop/lib/commons-net-1.4.1.jar:/data/hadoop/lib/hsqldb-1.8.0.10.jar:/data/hadoop/lib/jets3t-0.6.1.jar:/data/hadoop/lib/jetty-5.1.4.jar:/data/hadoop/lib/junit-3.8.1.jar:/data/hadoop/lib/kfs-0.2.0.jar:/data/hadoop/lib/log4j-1.2.15.jar:/data/hadoop/lib/oro-2.0.8.jar:/data/hadoop/lib/servlet-api.jar:/data/hadoop/lib/slf4j-api-1.4.3.jar:/data/hadoop/lib/slf4j-log4j12-1.4.3.jar:/data/hadoop/lib/xmlenc-0.52.jar:/data/hadoop/lib/jetty-ext/commons-el.jar:/data/hadoop/lib/jetty-ext/jasper-compiler.jar:/data/hadoop/lib/jetty-ext/jasper-runtime.jar:/data/hadoop/lib/jetty-ext/jsp-api.jar org.apache.hadoop.hdfs.server.namenode.SecondaryNameNode

- root 28628 6.3 16.8 1185080 36392 pts/0 Sl 15:28 0:01 /usr/java/jdk1.6.0_25/bin/java -Xmx1000m -Dcom.sun.management.jmxremote -Dcom.sun.management.jmxremote -Dhadoop.log.dir=/data/hadoop/logs -Dhadoop.log.file=hadoop-root-jobtracker-hd128.log -Dhadoop.home.dir=/data/hadoop -Dhadoop.id.str=root -Dhadoop.root.logger=INFO,DRFA -Djava.library.path=/data/hadoop/lib/native/Linux-i386-32 -classpath /data/hadoop/conf:/usr/java/jdk1.6.0_25/lib/tools.jar:/data/hadoop:/data/hadoop/hadoop-0.19.2-core.jar:/data/hadoop/lib/commons-cli-2.0-SNAPSHOT.jar:/data/hadoop/lib/commons-codec-1.3.jar:/data/hadoop/lib/commons-httpclient-3.0.1.jar:/data/hadoop/lib/commons-logging-1.0.4.jar:/data/hadoop/lib/commons-logging-api-1.0.4.jar:/data/hadoop/lib/commons-net-1.4.1.jar:/data/hadoop/lib/hsqldb-1.8.0.10.jar:/data/hadoop/lib/jets3t-0.6.1.jar:/data/hadoop/lib/jetty-5.1.4.jar:/data/hadoop/lib/junit-3.8.1.jar:/data/hadoop/lib/kfs-0.2.0.jar:/data/hadoop/lib/log4j-1.2.15.jar:/data/hadoop/lib/oro-2.0.8.jar:/data/hadoop/lib/servlet-api.jar:/data/hadoop/lib/slf4j-api-1.4.3.jar:/data/hadoop/lib/slf4j-log4j12-1.4.3.jar:/data/hadoop/lib/xmlenc-0.52.jar:/data/hadoop/lib/jetty-ext/commons-el.jar:/data/hadoop/lib/jetty-ext/jasper-compiler.jar:/data/hadoop/lib/jetty-ext/jasper-runtime.jar:/data/hadoop/lib/jetty-ext/jsp-api.jar org.apache.hadoop.mapred.JobTracker

- root 28738 0.0 0.3 4028 704 pts/0 R+ 15:28 0:00 grep java

看看slave机器DataNode和TaskTracker进程是否存在:

- [root@hd129 logs]# ps axu|grep java

- root 2026 0.1 11.5 1180316 24860 ? Sl 15:22 0:00 /usr/java/jdk1.6.0_25/bin/java -Xmx1000m -Dcom.sun.management.jmxremote -Dcom.sun.management.jmxremote -Dhadoop.log.dir=/data/hadoop/logs -Dhadoop.log.file=hadoop-root-datanode-hd129.log -Dhadoop.home.dir=/data/hadoop -Dhadoop.id.str=root -Dhadoop.root.logger=INFO,DRFA -Djava.library.path=/data/hadoop/lib/native/Linux-i386-32 -classpath /data/hadoop/conf:/usr/java/jdk1.6.0_25/lib/tools.jar:/data/hadoop:/data/hadoop/hadoop-0.19.2-core.jar:/data/hadoop/lib/commons-cli-2.0-SNAPSHOT.jar:/data/hadoop/lib/commons-codec-1.3.jar:/data/hadoop/lib/commons-httpclient-3.0.1.jar:/data/hadoop/lib/commons-logging-1.0.4.jar:/data/hadoop/lib/commons-logging-api-1.0.4.jar:/data/hadoop/lib/commons-net-1.4.1.jar:/data/hadoop/lib/hsqldb-1.8.0.10.jar:/data/hadoop/lib/jets3t-0.6.1.jar:/data/hadoop/lib/jetty-5.1.4.jar:/data/hadoop/lib/junit-3.8.1.jar:/data/hadoop/lib/kfs-0.2.0.jar:/data/hadoop/lib/log4j-1.2.15.jar:/data/hadoop/lib/oro-2.0.8.jar:/data/hadoop/lib/servlet-api.jar:/data/hadoop/lib/slf4j-api-1.4.3.jar:/data/hadoop/lib/slf4j-log4j12-1.4.3.jar:/data/hadoop/lib/xmlenc-0.52.jar:/data/hadoop/lib/jetty-ext/commons-el.jar:/data/hadoop/lib/jetty-ext/jasper-compiler.jar:/data/hadoop/lib/jetty-ext/jasper-runtime.jar:/data/hadoop/lib/jetty-ext/jsp-api.jar org.apache.hadoop.hdfs.server.datanode.DataNode

- root 2204 2.3 16.0 1185772 34604 ? Sl 15:28 0:00 /usr/java/jdk1.6.0_25/bin/java -Xmx1000m -Dhadoop.log.dir=/data/hadoop/logs -Dhadoop.log.file=hadoop-root-tasktracker-hd129.log -Dhadoop.home.dir=/data/hadoop -Dhadoop.id.str=root -Dhadoop.root.logger=INFO,DRFA -Djava.library.path=/data/hadoop/lib/native/Linux-i386-32 -classpath /data/hadoop/conf:/usr/java/jdk1.6.0_25/lib/tools.jar:/data/hadoop:/data/hadoop/hadoop-0.19.2-core.jar:/data/hadoop/lib/commons-cli-2.0-SNAPSHOT.jar:/data/hadoop/lib/commons-codec-1.3.jar:/data/hadoop/lib/commons-httpclient-3.0.1.jar:/data/hadoop/lib/commons-logging-1.0.4.jar:/data/hadoop/lib/commons-logging-api-1.0.4.jar:/data/hadoop/lib/commons-net-1.4.1.jar:/data/hadoop/lib/hsqldb-1.8.0.10.jar:/data/hadoop/lib/jets3t-0.6.1.jar:/data/hadoop/lib/jetty-5.1.4.jar:/data/hadoop/lib/junit-3.8.1.jar:/data/hadoop/lib/kfs-0.2.0.jar:/data/hadoop/lib/log4j-1.2.15.jar:/data/hadoop/lib/oro-2.0.8.jar:/data/hadoop/lib/servlet-api.jar:/data/hadoop/lib/slf4j-api-1.4.3.jar:/data/hadoop/lib/slf4j-log4j12-1.4.3.jar:/data/hadoop/lib/xmlenc-0.52.jar:/data/hadoop/lib/jetty-ext/commons-el.jar:/data/hadoop/lib/jetty-ext/jasper-compiler.jar:/data/hadoop/lib/jetty-ext/jasper-runtime.jar:/data/hadoop/lib/jetty-ext/jsp-api.jar org.apache.hadoop.mapred.TaskTracker

- root 2266 0.0 0.3 4028 676 pts/0 R+ 15:29 0:00 grep java

我们可以看到master和slave上各自有两个java线程在服务,下面我们还是用之前的例子试试。

bin/hadoop jar hadoop-0.19.2-examples.jar grep input output 'dfs[a-z.]+'

我们用浏览器看看master和slave的运行情况:

到此为止,hadoop的安装和基本的用法就介绍完了。其实我也是新手,如果哪里说的不对,欢迎拍砖。

![[转]hadoop的安装和使用_第1张图片](http://img.e-com-net.com/image/product/1a0242970b7d4c9abde865425022786c.jpg)

![点击查看原始大小图片 [转]hadoop的安装和使用_第2张图片](http://img.e-com-net.com/image/product/05f43887e67e4626b71f96de78ad756b.jpg)

![点击查看原始大小图片 [转]hadoop的安装和使用_第3张图片](http://img.e-com-net.com/image/product/70615a0cfde34fbd807706ed601bb1cf.jpg)