- 宇树人形机器人开源模型

真相很简单

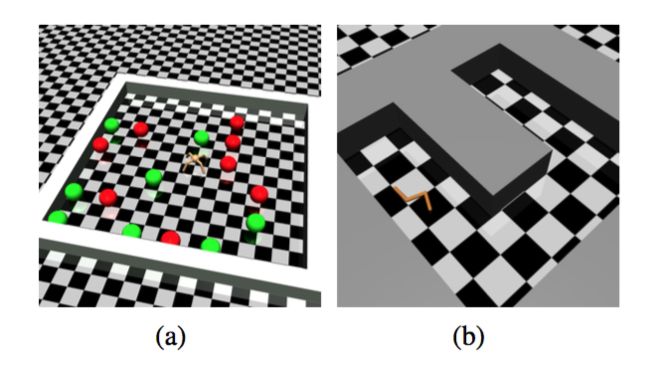

Gazebo仿真gazebo模型宇树人形机器人GO2B2H1

1.下载源码https://github.com/unitreerobotics/unitree_ros.git2.启动Gazeboroslaunchh1_descriptiongazebo.launch3.仿真效果H1GO2B2LaikagoZ14.VMware:vmw_ioctl_commanderrorInvalidargument这个错误通常出现在虚拟机环境中运行需要OpenGL支持的应用

- 深度学习之优化器Optimizer介绍

yueguang8

人工智能深度学习人工智能

优化器(Optimizer)是深度学习训练中非常关键的组件,它负责根据损失函数的梯度来更新模型参数,从而使模型性能不断提升。1.优化器的作用和重要性优化器是训练深度学习模型的核心组件之一。它负责根据损失函数的梯度来更新模型参数,推动模型性能不断提高。选择合适的优化器可以极大地影响模型的收敛速度和最终性能。2.优化器的基本原理优化器的基本思路是利用梯度下降法来最小化损失函数。每一步都根据当前梯度的方

- 人形机器人进入工厂

百态老人

笔记人工智能

人形机器人已进入工厂,主要应用于汽车制造、智能制造等领域,具备提高生产效率、降低成本等优势,但面临技术成熟度、成本控制等挑战,市场前景广阔。人形机器人进入工厂的现状国内外企业的实践特斯拉、优必选等企业已开始在工厂中部署人形机器人,如特斯拉的Optimus和优必选的WalkerS,分别用于汽车制造和工业领域。这些实践表明人形机器人已经在实际生产环境中得到应用,尤其是在需要高精度和高重复性任务的场景中

- Python 爬虫基础教程

盛子涵666

python爬虫开发语言

爬虫的背景与应用诞生爬虫(WebCrawling)是自动化程序,用于从互联网上获取信息。爬虫的基本任务是自动访问网站,通过抓取网页内容并提取有用数据来构建数据库、索引或者进行进一步的数据分析。爬虫通常会模拟浏览器的行为,以避免被服务器识别为机器人,并且能够在大规模范围内高效地抓取信息。爬虫技术最早由搜索引擎开发者提出,目的是自动收集网页信息并将其索引,便于用户搜索时快速检索相关内容。随着互联网的快

- 《人形机器人入门实践》开源项目指南

荣宣廷

《人形机器人入门实践》开源项目指南项目地址:https://gitcode.com/gh_mirrors/in/IntroductionToHumanoidRobotics本指南旨在帮助您深入了解并快速上手由ShuujiKajita等专家维护的“人形机器人入门实践”开源项目,该项目可以从此处获取。我们将分步骤介绍项目的结构、关键文件及其用途,确保您可以轻松地探索与开发人形机器人的精彩世界。1.项目

- 人形机器人专题:人形机器人产品方案对比,百花齐放,各擅胜场

人工智能学派

搜索引擎

今天分享的是人形机器人系列深度研究报告:《人形机器人专题:人形机器人产品方案对比,百花齐放,各擅胜场》。(报告出品方:国泰君安证券)报告共计:25页来源:人工智能学派特斯拉人形机器人迭代迅速,从执行层到控制层进化明显特斯拉机器人产品迭代迅速,产品性能进步明显。2021年8月,在特斯拉AIDAY上,马斯克公布人形机器人初步设计方案,仅1年后,Optimus实现了从概念到整机的落地,已具备了行走、拾取

- 深度学习 常见优化器

Humingway

深度学习人工智能

一、基础优化器随机梯度下降(SGD)•核心:∇θJ(θ)=η*∇θJ(θ)•特点:学习率固定,收敛路径震荡大•适用场景:简单凸优化问题•改进方向:动量加速二、动量系优化器2.SGDwithMomentum•公式:v_t=γv_{t-1}+η∇θJ(θ)•效果:平滑梯度更新,加速收敛•经典参数:γ=0.9(多数场景推荐)三、自适应学习率家族3.Adagrad•创新:∇θJ(θ)_t=∇θJ(θ)/(

- Python, Springboot 开发基于人类指令生成机器人3D可视化动态模型app

Geeker-2025

pythonspringboot

开发一个基于人类指令生成机器人3D可视化动态模型的APP是一个复杂且多层次的项目,涉及前端和后端的多个技术栈。以下是一个高层次的设计概述,涵盖主要的技术栈和功能模块,并提供使用Python和SpringBoot进行联合开发的示例。##技术栈概述###前端-**框架**:React.js或Vue.js(用于构建用户界面)-**3D可视化**:Three.js或React-Three-Fiber(用于

- 深度学习中常用的优化器

无能者狂怒

深度学习计算机视觉人工智能深度学习算法

梯度下降是优化神经网络的首选方法。本文将介绍各种基于梯度下降的优化器,如Momentum,Adagrad以及Adam等等StochasticGradientDescent(SGD)MomentumAdagradRMSpropAdamAdaMax1:梯度下降假设梯度下降法是一个下山的过程。假设这样一个场景:一个人被困在山上,需要从山上下来(找到山的最低点,也就是山谷)。但此时山上的浓雾很大,导致可视

- 常见的深度学习优化器

青灯剑客

算法python人工智能机器学习自然语言处理深度学习

一直用优化器解决问题,但是没有对它进行一个系统的总结。。不对,系统的总结进行过,只是时过境迁,早已忘却。一、照进我脑海的几个家伙一开始学习的当然是SGD,只是学着学着就忘记了。后来呢,接触到网上介绍的几种常用的优化器,看着原理挺给力,可是记了好几次都记不住。直到遇到《百面机器学习》,它从最基本的原理出发,给了我一点灵感。(1)几种常用的优化器,详情见这里链接34(2)二、以为自己遇见了大海老师说,

- 深度学习 bert与Transformer的区别联系

Humingway

深度学习berttransformer

BERT(BidirectionalEncoderRepresentationsfromTransformers)和Transformer都是现代自然语言处理(NLP)中的重要概念,但它们代表不同的层面。理解这两者之间的区别与联系有助于更好地掌握它们在NLP任务中的应用。TransformerTransformer是一种特定的深度学习模型架构,由Vaswani等人在2017年的论文《Attenti

- PyTorch 和 Python关系

一只积极向上的小咸鱼

pythonpytorch人工智能

1PyTorch和Python关系PyTorch和Python是两个不同但相互关联的工具,主要用于机器学习和深度学习领域。以下是它们之间的关系和各自的作用:Python编程语言:Python是一种高级编程语言,以其简洁易读的语法而闻名。广泛使用:Python在数据科学、人工智能、Web开发、自动化等多个领域有着广泛的应用。库和生态系统丰富:Python拥有丰富的第三方库和工具,如NumPy、pan

- Python与人工智能:为何它们是天作之合?

纪至训至

python人工智能开发语言

引言在人工智能(AI)飞速发展的今天,Python已成为这一领域的“明星语言”。从机器学习到深度学习,从自然语言处理到计算机视觉,Python的身影无处不在。那么,Python究竟为何能成为AI开发的首选工具?本文将探讨Python与AI之间的深度关联,并解析其背后的原因。1.Python的简洁性与可读性AI开发的核心在于快速迭代和实验,而Python以其简洁的语法和直观的代码结构著称。开发者无需

- python和pytorch关系_PyTorch:Python优先的深度学习框架

weixin_39877182

最近,Torch7团队开源了PyTorch。据该项目官网介绍,PyTorch是一个Python优先的深度学习框架,能够在强大的GPU加速基础上实现张量和动态神经网络。PyTorch是一个Python软件包,其提供了两种高层面的功能:使用强大的GPU加速的Tensor计算(类似numpy)构建于基于tape的autograd系统的深度神经网络如有需要,你也可以复用你最喜欢的Python软件包(如nu

- 基于YOLOv5的车牌识别系统:从数据集到UI界面的实现

深度学习&目标检测实战项目

YOLOv5实战项目YOLOui分类数据挖掘目标跟踪

1.引言随着智能交通系统的发展,车牌识别技术已成为交通管理、停车场自动化、路面监控等应用中的关键技术之一。车牌识别系统(LicensePlateRecognition,LPR)主要用于识别车辆的车牌号码,并将其转化为可以进一步处理的数据。车牌识别系统通常由图像处理、字符识别、目标检测等多种技术组成。近年来,随着深度学习技术的飞速发展,基于卷积神经网络(CNN)的目标检测算法,如YOLO(YouOn

- 点云空洞的边界识别提取 pso-bp 神经网络的模型来修复点云空洞 附python代码

点云-激光雷达-Slam-三维牙齿

激光雷达点云c++为主神经网络人工智能深度学习点云python

代码是一个Python程序,用于处理3D点云数据,特别是检测和修复点云中的孔洞区域。1.**导入库**:-`numpy`:用于数学运算。-`open3d`:用于处理3D数据和可视化。-`torch`:PyTorch库,用于深度学习。-`torch.nn`和`torch.optim`:PyTorch的神经网络和优化器模块。-`mpl_toolkits.mplot3d`和`matplotlib.pyp

- Python深度学习033:Python、PyTorch、CUDA和显卡驱动之间的关系

若北辰

Python深度学习python深度学习pytorch

Python、PyTorch、CUDA和显卡驱动之间的关系相当紧密,它们共同构成了一个能够执行深度学习模型的高效计算环境。下面是它们之间关系的简要概述:PythonPython是一种编程语言,广泛用于科学计算、数据分析和机器学习。它是开发和运行PyTorch代码的基础环境。PyTorchPyTorch是一个开源的机器学习库,用于应用如自然语言处理和计算机视觉的深度学习模型。它提供了丰富的API,使

- Activeloop Deep Lake: AI时代的数据湖解决方案

HGWAcsdgvs

人工智能python

技术背景介绍在当前AI技术蓬勃发展的背景下,数据的存储和检索显得尤为重要。ActiveloopDeepLake是一种多模态向量存储解决方案,支持嵌入和元数据(如文本、Json、图像、音频、视频等)的存储。它适用于本地、云端或Activeloop存储,通过嵌入以及其属性进行混合搜索。该解决方案是一个无服务器的数据湖,具备版本控制、查询引擎和深度学习框架的流媒体数据加载器。核心原理解析DeepLake

- Deep Lake:人工智能时代的数据湖

开源项目精选

人工智能

DeepLake是一款由Activeloop开发的开源深度学习数据湖,旨在解决深度学习数据管理的挑战。它提供高效的多模态数据管理、类似Git的版本控制、强大的查询和可视化功能,并与MLOps生态系统无缝集成,助你轻松驾驭海量数据,加速模型训练!Stars数8,458Forks数652主要特点多模态数据支持:支持图像、视频、音频、文本、点云等各种数据类型。张量存储:以深度学习框架友好的张量格式存储数

- PyTorch深度学习框架进阶学习计划 - 第21天:自然语言处理基础

凡人的AI工具箱

深度学习pytorch学习人工智能AI编程AIGC自然语言处理

PyTorch深度学习框架进阶学习计划-第21天自然语言处理基础今天我们将深入学习自然语言处理(NLP)的基础概念,重点关注词嵌入技术、序列建模原理以及主流模型之间的区别和优缺点。通过理解这些基础知识,你将能够更好地应用PyTorch构建NLP应用。1.词嵌入原理与实现词嵌入(WordEmbeddings)是NLP中的核心概念,它将单词映射到连续向量空间,使得语义相似的词在向量空间中距离较近。为什

- PyTorch深度学习框架60天进阶学习计划 - 第19天:时间序列预测

凡人的AI工具箱

深度学习pytorch学习人工智能AI编程迁移学习python

PyTorch深度学习框架60天进阶学习计划-第19天:时间序列预测目录时间序列预测概述滑动窗口数据构造方法归一化策略对比:MinMaxvsZ-ScoreLSTM基础原理Attention机制与LSTM结合LSTM-Attention模型实现TeacherForcing技术与应用Prophet基准模型对比多步预测的滚动验证方法综合实战:股票价格预测1.时间序列预测概述时间序列预测是机器学习中的一个

- PyTorch深度学习框架60天进阶学习计划 - 第18天:模型压缩技术

凡人的AI工具箱

深度学习pytorch学习python人工智能

PyTorch深度学习框架60天进阶学习计划-第18天:模型压缩技术目录模型压缩技术概述知识蒸馏详解软标签生成策略KL散度损失推导温度参数调节结构化剪枝技术通道剪枝评估准则L1-norm剪枝算法APoZ剪枝算法量化训练基础量化类型与精度PyTorch量化API剪枝与量化协同优化Torch.fx动态计算图修改自动化模型压缩流程实现实战案例:ResNet模型压缩性能评估与分析进阶挑战与思考1.模型压缩

- 深度学习c++资源库:vector容器,蓝桥杯常用算法sort,unique(排序+去重)

AI少女小鹿

c++算法开发语言

vector容器1.基本概念是STL中的一个容器类,不同于普通数组的静态空间,vector可以动态扩展。动态扩展:并不是在原空间连接新空间,而是找到更大的内存空间,将原数据拷贝到新空间,释放原空间。是一个序列容器,它允许用户在容器的末尾快速地添加或删除元素。与数组相比,提供了更多的功能,如自动调整大小、随机访问等。2.声明与初始化需要指定元素类型,可通过多种方式进行初始化:#include#inc

- 《探秘人工智能与鸿蒙系统集成开发的硬件基石》

人工智能深度学习

在科技飞速发展的当下,人工智能与鸿蒙系统的集成开发开辟了创新的前沿领域。这一融合不仅代表着技术的演进,更预示着智能设备生态的全新变革。而在这场技术盛宴的背后,坚实的硬件配置是确保开发顺利进行的关键,它就像一座大厦的基石,决定了上层建筑的高度和稳定性。处理器:运算核心的澎湃动力处理器作为硬件系统的核心,在人工智能与鸿蒙系统集成开发中扮演着至关重要的角色。对于模型训练任务,尤其是深度学习模型,其复杂的

- AI基于深度学习的代码搜索案例(一)

人工智能MOS

人工智能深度学习机器学习

1.背景近年来,人工智能逐渐进入各个领域并展现出了强大的能力。在计算机视觉领域,以ImageNet为例,计算机的图像分类水平已经超过了人类。在自然语言处理(NLP)领域,BERT、XLNet以及MASS也一遍遍的刷新着任务榜单。当人工智能进入游戏领域,也取得了惊人的成绩,在Atari系列游戏中,计算机很容易超过了大部分人类,在围棋比赛中,AlphaGo和AlphaZero也已经超越了人类顶尖棋手。

- 基于多模态大模型的不完整多组学数据特征选择策略

m0_65156252

人工智能

基于多模态大模型的不完整多组学数据特征选择策略是当前生物信息学和精准医学领域的一个前沿问题。在多组学数据中,通常包括不同层次的生物信息(如基因组、转录组、蛋白质组、代谢组等),这些数据通常存在缺失、噪声或不一致的情况。因此,如何有效地在这些不完整的数据中进行特征选择,是实现精确疾病预测和个性化治疗的关键。结合多模态大模型(如自监督学习、图神经网络、Transformer等)可以有效解决这一问题。以

- 大模型相关知识学习随记

m0_65156252

语言模型人工智能自然语言处理

2024/3/151,概念解释:通义千问,是阿里云推出的一个超大规模的语言模型,功能包括多轮对话、文案创作、逻辑推理、多模态理解、多语言支持。能够跟人类进行多轮的交互,也融入了多模态的知识理解,且有文案创作能力,能够续写小说,编写邮件等。2,多模态大模型:多模态大模型是一种基于深度学习的机器学习技术,其核心思想是将不同媒体数据(如文本、图像、音频和视频等)进行融合,通过学习不同模态之间的关联,实现

- DeepSeek在供热行业中的应用

杨航 AI

人工智能深度学习python机器学习算法

目录引言1.1DeepSeek技术概述1.2供暖行业业务挑战1.3DeepSeek在供暖行业的应用前景DeepSeek技术基础2.1深度学习与机器学习2.2自然语言处理(NLP)2.3图像识别与处理2.4数据挖掘与分析供暖行业应用场景3.1设备监控与维护3.1.1设备状态监控3.1.2故障预测与诊断3.1.3维护计划优化3.2能源管理与优化3.2.1能耗数据分析3.2.2热负荷预测3.2.3节能优

- Transformer大模型实战 对比ALBERT与BERT

AI天才研究院

AI大模型企业级应用开发实战Python实战DeepSeekR1&大数据AI人工智能大模型javapythonjavascriptkotlingolang架构人工智能大厂程序员硅基计算碳基计算认知计算生物计算深度学习神经网络大数据AIGCAGILLM系统架构设计软件哲学Agent程序员实现财富自由

文章标题在当今人工智能领域的迅速发展中,Transformer大模型无疑成为了自然语言处理(NLP)领域的璀璨明星。为了深入理解这一技术,我们特别撰写了《Transformer大模型实战对比ALBERT与BERT》这篇文章,旨在为广大读者提供一场关于Transformer模型及其实战应用的技术盛宴。关键词:Transformer,BERT,ALBERT,自然语言处理,深度学习,模型对比,实战应用摘

- Windows 10/11下安装labelImg标注工具

czimt开摆

python

abelImg是深度学习最常用的标注工具之一,下面讲解安装方法!1、下载windows免安装版本进入下载地址:Releases·HumanSignal/labelImg(github.com),选择windows_v1.8.1.zip,下载并解压,直接双击exe文件即可打开或者可以访问https://sjmwsw.com/xTI4Z2、安装labelImg打开命令行cmd终端下使用:pipinst

- ASM系列四 利用Method 组件动态注入方法逻辑

lijingyao8206

字节码技术jvmAOP动态代理ASM

这篇继续结合例子来深入了解下Method组件动态变更方法字节码的实现。通过前面一篇,知道ClassVisitor 的visitMethod()方法可以返回一个MethodVisitor的实例。那么我们也基本可以知道,同ClassVisitor改变类成员一样,MethodVIsistor如果需要改变方法成员,注入逻辑,也可以

- java编程思想 --内部类

百合不是茶

java内部类匿名内部类

内部类;了解外部类 并能与之通信 内部类写出来的代码更加整洁与优雅

1,内部类的创建 内部类是创建在类中的

package com.wj.InsideClass;

/*

* 内部类的创建

*/

public class CreateInsideClass {

public CreateInsideClass(

- web.xml报错

crabdave

web.xml

web.xml报错

The content of element type "web-app" must match "(icon?,display-

name?,description?,distributable?,context-param*,filter*,filter-mapping*,listener*,servlet*,s

- 泛型类的自定义

麦田的设计者

javaandroid泛型

为什么要定义泛型类,当类中要操作的引用数据类型不确定的时候。

采用泛型类,完成扩展。

例如有一个学生类

Student{

Student(){

System.out.println("I'm a student.....");

}

}

有一个老师类

- CSS清除浮动的4中方法

IT独行者

JavaScriptUIcss

清除浮动这个问题,做前端的应该再熟悉不过了,咱是个新人,所以还是记个笔记,做个积累,努力学习向大神靠近。CSS清除浮动的方法网上一搜,大概有N多种,用过几种,说下个人感受。

1、结尾处加空div标签 clear:both 1 2 3 4

.div

1

{

background

:

#000080

;

border

:

1px

s

- Cygwin使用windows的jdk 配置方法

_wy_

jdkwindowscygwin

1.[vim /etc/profile]

JAVA_HOME="/cgydrive/d/Java/jdk1.6.0_43" (windows下jdk路径为D:\Java\jdk1.6.0_43)

PATH="$JAVA_HOME/bin:${PATH}"

CLAS

- linux下安装maven

无量

mavenlinux安装

Linux下安装maven(转) 1.首先到Maven官网

下载安装文件,目前最新版本为3.0.3,下载文件为

apache-maven-3.0.3-bin.tar.gz,下载可以使用wget命令;

2.进入下载文件夹,找到下载的文件,运行如下命令解压

tar -xvf apache-maven-2.2.1-bin.tar.gz

解压后的文件夹

- tomcat的https 配置,syslog-ng配置

aichenglong

tomcathttp跳转到httpssyslong-ng配置syslog配置

1) tomcat配置https,以及http自动跳转到https的配置

1)TOMCAT_HOME目录下生成密钥(keytool是jdk中的命令)

keytool -genkey -alias tomcat -keyalg RSA -keypass changeit -storepass changeit

- 关于领号活动总结

alafqq

活动

关于某彩票活动的总结

具体需求,每个用户进活动页面,领取一个号码,1000中的一个;

活动要求

1,随机性,一定要有随机性;

2,最少中奖概率,如果注数为3200注,则最多中4注

3,效率问题,(不能每个人来都产生一个随机数,这样效率不高);

4,支持断电(仍然从下一个开始),重启服务;(存数据库有点大材小用,因此不能存放在数据库)

解决方案

1,事先产生随机数1000个,并打

- java数据结构 冒泡排序的遍历与排序

百合不是茶

java

java的冒泡排序是一种简单的排序规则

冒泡排序的原理:

比较两个相邻的数,首先将最大的排在第一个,第二次比较第二个 ,此后一样;

针对所有的元素重复以上的步骤,除了最后一个

例题;将int array[]

- JS检查输入框输入的是否是数字的一种校验方法

bijian1013

js

如下是JS检查输入框输入的是否是数字的一种校验方法:

<form method=post target="_blank">

数字:<input type="text" name=num onkeypress="checkNum(this.form)"><br>

</form>

- Test注解的两个属性:expected和timeout

bijian1013

javaJUnitexpectedtimeout

JUnit4:Test文档中的解释:

The Test annotation supports two optional parameters.

The first, expected, declares that a test method should throw an exception.

If it doesn't throw an exception or if it

- [Gson二]继承关系的POJO的反序列化

bit1129

POJO

父类

package inheritance.test2;

import java.util.Map;

public class Model {

private String field1;

private String field2;

private Map<String, String> infoMap

- 【Spark八十四】Spark零碎知识点记录

bit1129

spark

1. ShuffleMapTask的shuffle数据在什么地方记录到MapOutputTracker中的

ShuffleMapTask的runTask方法负责写数据到shuffle map文件中。当任务执行完成成功,DAGScheduler会收到通知,在DAGScheduler的handleTaskCompletion方法中完成记录到MapOutputTracker中

- WAS各种脚本作用大全

ronin47

WAS 脚本

http://www.ibm.com/developerworks/cn/websphere/library/samples/SampleScripts.html

无意中,在WAS官网上发现的各种脚本作用,感觉很有作用,先与各位分享一下

获取下载

这些示例 jacl 和 Jython 脚本可用于在 WebSphere Application Server 的不同版本中自

- java-12.求 1+2+3+..n不能使用乘除法、 for 、 while 、 if 、 else 、 switch 、 case 等关键字以及条件判断语句

bylijinnan

switch

借鉴网上的思路,用java实现:

public class NoIfWhile {

/**

* @param args

*

* find x=1+2+3+....n

*/

public static void main(String[] args) {

int n=10;

int re=find(n);

System.o

- Netty源码学习-ObjectEncoder和ObjectDecoder

bylijinnan

javanetty

Netty中传递对象的思路很直观:

Netty中数据的传递是基于ChannelBuffer(也就是byte[]);

那把对象序列化为字节流,就可以在Netty中传递对象了

相应的从ChannelBuffer恢复对象,就是反序列化的过程

Netty已经封装好ObjectEncoder和ObjectDecoder

先看ObjectEncoder

ObjectEncoder是往外发送

- spring 定时任务中cronExpression表达式含义

chicony

cronExpression

一个cron表达式有6个必选的元素和一个可选的元素,各个元素之间是以空格分隔的,从左至右,这些元素的含义如下表所示:

代表含义 是否必须 允许的取值范围 &nb

- Nutz配置Jndi

ctrain

JNDI

1、使用JNDI获取指定资源:

var ioc = {

dao : {

type :"org.nutz.dao.impl.NutDao",

args : [ {jndi :"jdbc/dataSource"} ]

}

}

以上方法,仅需要在容器中配置好数据源,注入到NutDao即可.

- 解决 /bin/sh^M: bad interpreter: No such file or directory

daizj

shell

在Linux中执行.sh脚本,异常/bin/sh^M: bad interpreter: No such file or directory。

分析:这是不同系统编码格式引起的:在windows系统中编辑的.sh文件可能有不可见字符,所以在Linux系统下执行会报以上异常信息。

解决:

1)在windows下转换:

利用一些编辑器如UltraEdit或EditPlus等工具

- [转]for 循环为何可恨?

dcj3sjt126com

程序员读书

Java的闭包(Closure)特征最近成为了一个热门话题。 一些精英正在起草一份议案,要在Java将来的版本中加入闭包特征。 然而,提议中的闭包语法以及语言上的这种扩充受到了众多Java程序员的猛烈抨击。

不久前,出版过数十本编程书籍的大作家Elliotte Rusty Harold发表了对Java中闭包的价值的质疑。 尤其是他问道“for 循环为何可恨?”[http://ju

- Android实用小技巧

dcj3sjt126com

android

1、去掉所有Activity界面的标题栏

修改AndroidManifest.xml 在application 标签中添加android:theme="@android:style/Theme.NoTitleBar"

2、去掉所有Activity界面的TitleBar 和StatusBar

修改AndroidManifes

- Oracle 复习笔记之序列

eksliang

Oracle 序列sequenceOracle sequence

转载请出自出处:http://eksliang.iteye.com/blog/2098859

1.序列的作用

序列是用于生成唯一、连续序号的对象

一般用序列来充当数据库表的主键值

2.创建序列语法如下:

create sequence s_emp

start with 1 --开始值

increment by 1 --増长值

maxval

- 有“品”的程序员

gongmeitao

工作

完美程序员的10种品质

完美程序员的每种品质都有一个范围,这个范围取决于具体的问题和背景。没有能解决所有问题的

完美程序员(至少在我们这个星球上),并且对于特定问题,完美程序员应该具有以下品质:

1. 才智非凡- 能够理解问题、能够用清晰可读的代码翻译并表达想法、善于分析并且逻辑思维能力强

(范围:用简单方式解决复杂问题)

- 使用KeleyiSQLHelper类进行分页查询

hvt

sql.netC#asp.nethovertree

本文适用于sql server单主键表或者视图进行分页查询,支持多字段排序。KeleyiSQLHelper类的最新代码请到http://hovertree.codeplex.com/SourceControl/latest下载整个解决方案源代码查看。或者直接在线查看类的代码:http://hovertree.codeplex.com/SourceControl/latest#HoverTree.D

- SVG 教程 (三)圆形,椭圆,直线

天梯梦

svg

SVG <circle> SVG 圆形 - <circle>

<circle> 标签可用来创建一个圆:

下面是SVG代码:

<svg xmlns="http://www.w3.org/2000/svg" version="1.1">

<circle cx="100" c

- 链表栈

luyulong

java数据结构

public class Node {

private Object object;

private Node next;

public Node() {

this.next = null;

this.object = null;

}

public Object getObject() {

return object;

}

public

- 基础数据结构和算法十:2-3 search tree

sunwinner

Algorithm2-3 search tree

Binary search tree works well for a wide variety of applications, but they have poor worst-case performance. Now we introduce a type of binary search tree where costs are guaranteed to be loga

- spring配置定时任务

stunizhengjia

springtimer

最近因工作的需要,用到了spring的定时任务的功能,觉得spring还是很智能化的,只需要配置一下配置文件就可以了,在此记录一下,以便以后用到:

//------------------------定时任务调用的方法------------------------------

/**

* 存储过程定时器

*/

publi

- ITeye 8月技术图书有奖试读获奖名单公布

ITeye管理员

活动

ITeye携手博文视点举办的8月技术图书有奖试读活动已圆满结束,非常感谢广大用户对本次活动的关注与参与。

8月试读活动回顾:

http://webmaster.iteye.com/blog/2102830

本次技术图书试读活动的优秀奖获奖名单及相应作品如下(优秀文章有很多,但名额有限,没获奖并不代表不优秀):

《跨终端Web》

gleams:http