- Spark集群的三种模式

MelodyYN

#Sparksparkhadoopbigdata

文章目录1、Spark的由来1.1Hadoop的发展1.2MapReduce与Spark对比2、Spark内置模块3、Spark运行模式3.1Standalone模式部署配置历史服务器配置高可用运行模式3.2Yarn模式安装部署配置历史服务器运行模式4、WordCount案例1、Spark的由来定义:Hadoop主要解决,海量数据的存储和海量数据的分析计算。Spark是一种基于内存的快速、通用、可

- Hadoop windows intelij 跑 MR WordCount

piziyang12138

一、软件环境我使用的软件版本如下:IntellijIdea2017.1Maven3.3.9Hadoop分布式环境二、创建maven工程打开Idea,file->new->Project,左侧面板选择maven工程。(如果只跑MapReduce创建java工程即可,不用勾选Creatfromarchetype,如果想创建web工程或者使用骨架可以勾选)image.png设置GroupId和Artif

- Hadoop之mapreduce -- WrodCount案例以及各种概念

lzhlizihang

hadoopmapreduce大数据

文章目录一、MapReduce的优缺点二、MapReduce案例--WordCount1、导包2、Mapper方法3、Partitioner方法(自定义分区器)4、reducer方法5、driver(main方法)6、Writable(手机流量统计案例的实体类)三、关于片和块1、什么是片,什么是块?2、mapreduce启动多少个MapTask任务?四、MapReduce的原理五、Shuffle过

- Spark分布式计算原理

NightFall丶

#Sparkapachesparkspark

目录一、RDD依赖与DAG原理1.1RDD的转换一、RDD依赖与DAG原理Spark根据计算逻辑中的RDD的转换与动作生成RDD的依赖关系,同时这个计算链也形成了逻辑上的DAG。1.1RDD的转换e.g.(以wordcount为例)packagesparkimportorg.apache.spark.{SparkConf,SparkContext}objectWordCount{defmain(a

- 【Hadoop】- MapReduce & YARN 初体验[9]

星星法术嗲人

hadoophadoopmapreduce

目录提交MapReduce程序至YARN运行1、提交wordcount示例程序1.1、先准备words.txt文件上传到hdfs,文件内容如下:1.2、在hdfs中创建两个文件夹,分别为/input、/output1.3、将创建好的words.txt文件上传到hdfs中/input1.4、提交MapReduce程序至YARN1.5、可通过node1:8088查看1.6、返回我们的服务器,检查输出文

- flink经典实战案例

不 爱吃肉肉

flinkbigdatajavascala

一、java版flink-wordcount-离线计算版1.1maven构建flink,加入依赖org.apache.flinkflink-java${flink.version}provided-->org.apache.flinkflink-clients_${scala.version}${flink.version}1.2java实现flinkwordCount的代码编写1.2.1代码编写

- Spark Streaming(二):DStream数据源

雪飘千里

1、输入DStream和Receiver输入(Receiver)DStream代表了来自数据源的输入数据流,在之前的wordcount例子中,lines就是一个输入DStream(JavaReceiverInputDStream),代表了从netcat(nc)服务接收到的数据流。除了文件数据流之外,所有的输入DStream都会绑定一个Receiver对象,该对象是一个关键的组件,用来从数据源接收数

- ros自定义srv记录

西木九

roboticROSsrv

文章目录自定义srv1.定义srv文件2.修改package.xml3.修改CMakeLists.txt4.sevice_server.py5.运行`catkinbuild`测试使用(rosservice命令)自定义srvros版本:kinetic自定义test包的文件结构如下|--test||--CMakeLists.txt||--srv||`--WordCount.srv||--package

- Hive使用双重GroupBy解决数据倾斜问题

黄土高坡上的独孤前辈

Hive/Kylin数据仓库hivehadoop数据仓库

文章目录1.数据准备2.双重groupby实现解决数据倾斜2.1第一层加盐groupby2.2第二层去盐groupby1.数据准备createtablewordcount(astring)rowformatdelimitedfieldsterminatedby‘,’;loaddatalocalinpath‘opt/2.txt’intotablewordcount;hive(default)>sel

- Scala基础教程--19--Actor

落空空。

javasparkscalajava开发语言

Scala基础教程–19–Actor章节目标了解Actor的相关概述掌握Actor发送和接收消息掌握WordCount案例1.Actor介绍Scala中的Actor并发编程模型可以用来开发比Java线程效率更高的并发程序。我们学习ScalaActor的目的主要是为后续学习Akka做准备。1.1Java并发编程的问题在Java并发编程中,每个对象都有一个逻辑监视器(monitor),可以用来控制对象

- 【Flink入门修炼】1-3 Flink WordCount 入门实现

flinkhadoop

本篇文章将带大家运行Flink最简单的程序WordCount。先实践后理论,对其基本输入输出、编程代码有初步了解,后续篇章再对Flink的各种概念和架构进行介绍。下面将从创建项目开始,介绍如何创建出一个Flink项目;然后从DataStream流处理和FlinkSQL执行两种方式来带大家学习WordCount程序的开发。Flink各版本之间变化较多,之前版本的函数在后续版本可能不再支持。跟随学习时

- 七天爆肝flink笔记

我才是真的封不觉

flink笔记大数据

一.flink整体介绍及wordcount案例代码1.1整体介绍从上到下包含有界无界流支持状态特点与spark对比应用场景架构分层1.2示例代码了解了后就整个demo吧数据源准备这里直接用的文本文件gradle中的主要配置group='com.example'version='0.0.1-SNAPSHOT'java{sourceCompatibility='11'}repositories{mav

- Hadoop手把手逐级搭建 第二阶段: Hadoop完全分布式(full)

郑大能

前置步骤:1).第一阶段:Hadoop单机伪分布(single)0.步骤概述1).克隆4台虚拟机2).为完全分布式配置ssh免密3).将hadoop配置修改为完全分布式4).启动完全分布式集群5).在完全分布式集群上测试wordcount程序1.克隆4台虚拟机1.1使用hadoop0克隆4台虚拟机hadoop1,hadoop2,hadoop3,hadoop41.1.0克隆虚拟机hadoop11.1

- FLink发布任务

卡门001

例子任务名:SocketWindowWordCount.jar开启客户端模拟发数据nc-lk9527命令行启动../../bin/flinkrun-corg.apache.flink.streaming.examples.socket.SocketWindowWordCountSocketWindowWordCount.jar--hostnamelocalhost--port9527参数--hos

- 【Flink入门修炼】1-3 Flink WordCount 入门实现

大数据王小皮

Flink入门修炼flink大数据

本篇文章将带大家运行Flink最简单的程序WordCount。先实践后理论,对其基本输入输出、编程代码有初步了解,后续篇章再对Flink的各种概念和架构进行介绍。下面将从创建项目开始,介绍如何创建出一个Flink项目;然后从DataStream流处理和FlinkSQL执行两种方式来带大家学习WordCount程序的开发。Flink各版本之间变化较多,之前版本的函数在后续版本可能不再支持。跟随学习时

- win10 spark scala 本地运行wordcount

疯琴

大数据java/scalaflink/spark

注意每次修改环境变量都要重启cmd本机运行需要hadoopcommon,可以从github下载zip,解包以后设置HADOOP_HOME环境变量指向它,然后在PATH里加上HADOOP_HOME\bin,特别注意,hadoopcommon的版本要和spark的hadoop版本匹配spark的scala和本机的scala大版本要匹配报错ExceptionwhiledeletingSparktempd

- 在多台阿里云服务器上部署Hadoop分布式系统及WordCount实验

Clearlove灬Star

大数据阿里云Hadoop分布式Wordcount

一、实现master与slave之间无密码连接分别在master及slave上生成rsa密钥:mkdir~/.sshcd~/.sshssh-keygen-t-rsa一路回车(选择默认设置),此时,ssh文件夹中生成了id_rsa.pub和id_rsa两个,然后使用scp命令将公钥(id_rsa.pub)分别拷到对方机器中scpid_rsa.pubh1@对方机器IP:~/.ssh/authorize

- 合肥工业大学2022大数据技术实验二

一头骇人鲸

大数据技术大数据hadoopjava

实验序号及名称:实验二在Hadoop平台上部署WordCount程序实验时间∶2022年5月14日预习内容一、实验目的和要求∶在Hadoop平台上部署WordCount程序。二、实验任务∶该项任务请同学作为作业自行完成,并提交实验报告。脱离ide环境运行wordcount三、实验准备方案,包括以下内容:(硬件类实验:实验原理、实验线路、设计方案等)(软件类实验:所采用的系统、组件、工具、核心方法、

- hadoopwordcount代码分析

姹紫_嫣红

大数据hadoopJava

packagecom.felix;importjava.io.IOException;//java输入输出文件异常类importjava.util.Iterator;Iterator是迭代器类importjava.util.StringTokenizer;用来对字符串进行切importorg.apache.hadoop.fs.Path;importorg.apache.hadoop.io.IntW

- 【实验2】在Hadoop平台上部署WordCount程序

-借我杀死庸碌的情怀-

hadoopnpm大数据centos分布式

文章目录实验内容一、实验环境:二、实验内容与步骤(过程及数据记录):5.分布式文件系统HDFS上的操作5.1利用Shell命令与HDFS进行交互5.2利用Web界面管理HDFS6.分布式文件系统HDFS上的编程实践6.1安装Eclipse6.2创建Eclipse工程6.3编写一个Java应用程序检测HDFS中是否存在一个文件7.Eclipse上的HDFS操作7.1安装Hadoop-Eclipse-

- Spark大数据分析与实战笔记(第二章 Spark基础-06)

想你依然心痛

#Spark大数据分析与实战spark数据分析笔记

文章目录每日一句正能量2.6IDEA开发WordCount程序2.6.1本地模式执行Spark程序2.6.2集群模式执行Spark程序每日一句正能量我们全都要从前辈和同辈学习到一些东西。就连最大的天才,如果想单凭他所特有的内在自我去对付一切,他也决不会有多大成就。2.6IDEA开发WordCount程序Spark-Shell通常在测试和验证我们的程序时使用的较多,然而在生产环境中,通常会在IDEA

- Spark Shuffle模块详解

晓之以理的喵~~

大数据HadoopSparkspark大数据hadoop

Shuffle,具有某种共同特征的一类数据需要最终汇聚(aggregate)到一个计算节点上进行计算。这些数据分布在各个存储节点上并且由不同节点的计算单元处理。以最简单的WordCount为例,其中数据保存在Node1、Node2和Node3;经过处理后,这些数据最终会汇聚到Nodea、Nodeb处理。这个数据重新打乱然后汇聚到不同节点的过程就是Shuffle。但是实际上,Shuffle过程可能会

- 6.0 MapReduce 服务使用教程

二当家的素材网

Hadoop教程mapreduce大数据

在学习了之前的MapReduce概念之后,我们应该已经知道什么是Map和Reduce,并了解了他们的工作方式。本章将学习如何使用MapReduce。WordCountWordCount就是"词语统计",这是MapReduce工作程序中最经典的一种。它的主要任务是对一个文本文件中的词语作归纳统计,统计出每个出现过的词语一共出现的次数。Hadoop中包含了许多经典的MapReduce示例程序,其中就包

- Spark Streaming实战:窗口操作,每10秒,把过去30秒的数据取出来(读取端口号1235中的数据)

Movle

1.需求:窗口操作,每10秒,把过去30秒的数据取出来窗口长度:30秒滑动距离:10秒2.代码:(1)pom.xmlorg.apache.sparkspark-core_2.112.1.0org.apache.sparkspark-sql_2.112.1.0org.apache.sparkspark-streaming_2.112.1.0(2)MyNetWorkWordCountByWindow.

- spark WordCount

lehuai

SparkWC.scalapackageday06importorg.apache.spark.rdd.RDDimportorg.apache.spark.{SparkConf,SparkContext}objectSparkWC{defmain(args:Array[String]):Unit={//配置信息类valconf:SparkConf=newSparkConf().setAppName

- 大数据组件笔记 -- Spark 入门

L小Ray想有腮

BigData

文章目录一、简介二、Spark运行模式2.1本地模式2.2集群角色2.3Standalone模式2.4Yarn模式2.5总结三、WordCount开发案例实操一、简介Spark是一种基于内存的快速、通用、可扩展的大数据分析计算引擎。Spark历史Spark虽然有自己的资源调度框架,但实际中常用Yarn来进行统一资源管理。Spark框架Spark内置模块SparkCore:实现了Spark的基本功能

- Flink的dataStream的状态保存和恢复

我还不够强

我们前面写的wordcount的例子,没有包含状态管理。如果一个task在处理过程中挂掉了,那么它在内存中的状态都会丢失,所有的数据都需要重新计算。从容错和消息处理的语义上(atleastonce,exactlyonce),Flink引入了state和checkpoint。首先区分一下两个概念state一般指一个具体的task/operator的状态【state数据默认保存在java的堆内存中】而

- Flink 1.18.1的基本使用

You Only Live Once_2

快速响应flink大数据

系统示例应用/usr/local/flink-1.18.1/bin/flinkrun/usr/local/flies/streaming/SocketWindowWordCount.jar--port9010nc-l9010asdasdsdfsfsdfsdfsdagdsdf单次统计示例工程cdC:\Dev\IdeaProjectsmvnarchetype:generate-DarchetypeGr

- Hadoop3.x基础(3)- MapReduce

魅美

大数据基础hadoop

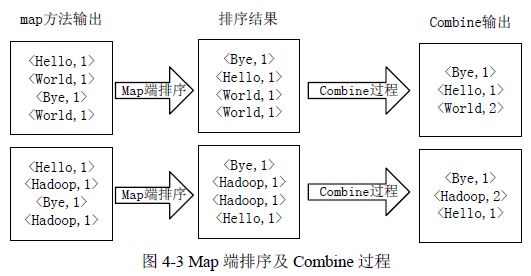

来源:B站尚硅谷目录MapReduce概述MapReduce定义MapReduce优缺点优点缺点MapReduce核心思想MapReduce进程常用数据序列化类型MapReduce编程规范WordCount案例实操本地测试提交到集群测试Hadoop序列化序列化概述自定义bean对象实现序列化接口(Writable)序列化案例实操MapReduce框架原理InputFormat数据输入切片与MapT

- 大数据 - Spark系列《一》- 从Hadoop到Spark:大数据计算引擎的演进

王哪跑nn

spark大数据sparkhadoop

目录1.1Hadoop回顾1.2spark简介1.3Spark特性1.通用性2.简洁灵活3.多语言1.4SparkCore编程体验1.4.1spark开发工程搭建1.开发语言选择:2.依赖管理工具:1.4.2Spark编程流程1.获取sparkcontext对象2.加载数据3.处理转换数据4.输出结果,释放资源1.4.3简单代码实现-wordCount在大数据领域,Hadoop一直是一个重要的框架

- 遍历dom 并且存储(将每一层的DOM元素存在数组中)

换个号韩国红果果

JavaScripthtml

数组从0开始!!

var a=[],i=0;

for(var j=0;j<30;j++){

a[j]=[];//数组里套数组,且第i层存储在第a[i]中

}

function walkDOM(n){

do{

if(n.nodeType!==3)//筛选去除#text类型

a[i].push(n);

//con

- Android+Jquery Mobile学习系列(9)-总结和代码分享

白糖_

JQuery Mobile

目录导航

经过一个多月的边学习边练手,学会了Android基于Web开发的毛皮,其实开发过程中用Android原生API不是很多,更多的是HTML/Javascript/Css。

个人觉得基于WebView的Jquery Mobile开发有以下优点:

1、对于刚从Java Web转型过来的同学非常适合,只要懂得HTML开发就可以上手做事。

2、jquerym

- impala参考资料

dayutianfei

impala

记录一些有用的Impala资料

1. 入门资料

>>官网翻译:

http://my.oschina.net/weiqingbin/blog?catalog=423691

2. 实用进阶

>>代码&架构分析:

Impala/Hive现状分析与前景展望:http

- JAVA 静态变量与非静态变量初始化顺序之新解

周凡杨

java静态非静态顺序

今天和同事争论一问题,关于静态变量与非静态变量的初始化顺序,谁先谁后,最终想整理出来!测试代码:

import java.util.Map;

public class T {

public static T t = new T();

private Map map = new HashMap();

public T(){

System.out.println(&quo

- 跳出iframe返回外层页面

g21121

iframe

在web开发过程中难免要用到iframe,但当连接超时或跳转到公共页面时就会出现超时页面显示在iframe中,这时我们就需要跳出这个iframe到达一个公共页面去。

首先跳转到一个中间页,这个页面用于判断是否在iframe中,在页面加载的过程中调用如下代码:

<script type="text/javascript">

//<!--

function

- JAVA多线程监听JMS、MQ队列

510888780

java多线程

背景:消息队列中有非常多的消息需要处理,并且监听器onMessage()方法中的业务逻辑也相对比较复杂,为了加快队列消息的读取、处理速度。可以通过加快读取速度和加快处理速度来考虑。因此从这两个方面都使用多线程来处理。对于消息处理的业务处理逻辑用线程池来做。对于加快消息监听读取速度可以使用1.使用多个监听器监听一个队列;2.使用一个监听器开启多线程监听。

对于上面提到的方法2使用一个监听器开启多线

- 第一个SpringMvc例子

布衣凌宇

spring mvc

第一步:导入需要的包;

第二步:配置web.xml文件

<?xml version="1.0" encoding="UTF-8"?>

<web-app version="2.5"

xmlns="http://java.sun.com/xml/ns/javaee"

xmlns:xsi=

- 我的spring学习笔记15-容器扩展点之PropertyOverrideConfigurer

aijuans

Spring3

PropertyOverrideConfigurer类似于PropertyPlaceholderConfigurer,但是与后者相比,前者对于bean属性可以有缺省值或者根本没有值。也就是说如果properties文件中没有某个bean属性的内容,那么将使用上下文(配置的xml文件)中相应定义的值。如果properties文件中有bean属性的内容,那么就用properties文件中的值来代替上下

- 通过XSD验证XML

antlove

xmlschemaxsdvalidationSchemaFactory

1. XmlValidation.java

package xml.validation;

import java.io.InputStream;

import javax.xml.XMLConstants;

import javax.xml.transform.stream.StreamSource;

import javax.xml.validation.Schem

- 文本流与字符集

百合不是茶

PrintWrite()的使用字符集名字 别名获取

文本数据的输入输出;

输入;数据流,缓冲流

输出;介绍向文本打印格式化的输出PrintWrite();

package 文本流;

import java.io.FileNotFound

- ibatis模糊查询sqlmap-mapping-**.xml配置

bijian1013

ibatis

正常我们写ibatis的sqlmap-mapping-*.xml文件时,传入的参数都用##标识,如下所示:

<resultMap id="personInfo" class="com.bijian.study.dto.PersonDTO">

<res

- java jvm常用命令工具——jdb命令(The Java Debugger)

bijian1013

javajvmjdb

用来对core文件和正在运行的Java进程进行实时地调试,里面包含了丰富的命令帮助您进行调试,它的功能和Sun studio里面所带的dbx非常相似,但 jdb是专门用来针对Java应用程序的。

现在应该说日常的开发中很少用到JDB了,因为现在的IDE已经帮我们封装好了,如使用ECLI

- 【Spring框架二】Spring常用注解之Component、Repository、Service和Controller注解

bit1129

controller

在Spring常用注解第一步部分【Spring框架一】Spring常用注解之Autowired和Resource注解(http://bit1129.iteye.com/blog/2114084)中介绍了Autowired和Resource两个注解的功能,它们用于将依赖根据名称或者类型进行自动的注入,这简化了在XML中,依赖注入部分的XML的编写,但是UserDao和UserService两个bea

- cxf wsdl2java生成代码super出错,构造函数不匹配

bitray

super

由于过去对于soap协议的cxf接触的不是很多,所以遇到了也是迷糊了一会.后来经过查找资料才得以解决. 初始原因一般是由于jaxws2.2规范和jdk6及以上不兼容导致的.所以要强制降为jaxws2.1进行编译生成.我们需要少量的修改:

我们原来的代码

wsdl2java com.test.xxx -client http://.....

修改后的代

- 动态页面正文部分中文乱码排障一例

ronin47

公司网站一部分动态页面,早先使用apache+resin的架构运行,考虑到高并发访问下的响应性能问题,在前不久逐步开始用nginx替换掉了apache。 不过随后发现了一个问题,随意进入某一有分页的网页,第一页是正常的(因为静态化过了);点“下一页”,出来的页面两边正常,中间部分的标题、关键字等也正常,唯独每个标题下的正文无法正常显示。 因为有做过系统调整,所以第一反应就是新上

- java-54- 调整数组顺序使奇数位于偶数前面

bylijinnan

java

import java.util.Arrays;

import java.util.Random;

import ljn.help.Helper;

public class OddBeforeEven {

/**

* Q 54 调整数组顺序使奇数位于偶数前面

* 输入一个整数数组,调整数组中数字的顺序,使得所有奇数位于数组的前半部分,所有偶数位于数组的后半

- 从100PV到1亿级PV网站架构演变

cfyme

网站架构

一个网站就像一个人,存在一个从小到大的过程。养一个网站和养一个人一样,不同时期需要不同的方法,不同的方法下有共同的原则。本文结合我自已14年网站人的经历记录一些架构演变中的体会。 1:积累是必不可少的

架构师不是一天练成的。

1999年,我作了一个个人主页,在学校内的虚拟空间,参加了一次主页大赛,几个DREAMWEAVER的页面,几个TABLE作布局,一个DB连接,几行PHP的代码嵌入在HTM

- [宇宙时代]宇宙时代的GIS是什么?

comsci

Gis

我们都知道一个事实,在行星内部的时候,因为地理信息的坐标都是相对固定的,所以我们获取一组GIS数据之后,就可以存储到硬盘中,长久使用。。。但是,请注意,这种经验在宇宙时代是不能够被继续使用的

宇宙是一个高维时空

- 详解create database命令

czmmiao

database

完整命令

CREATE DATABASE mynewdb USER SYS IDENTIFIED BY sys_password USER SYSTEM IDENTIFIED BY system_password LOGFILE GROUP 1 ('/u01/logs/my/redo01a.log','/u02/logs/m

- 几句不中听却不得不认可的话

datageek

1、人丑就该多读书。

2、你不快乐是因为:你可以像猪一样懒,却无法像只猪一样懒得心安理得。

3、如果你太在意别人的看法,那么你的生活将变成一件裤衩,别人放什么屁,你都得接着。

4、你的问题主要在于:读书不多而买书太多,读书太少又特爱思考,还他妈话痨。

5、与禽兽搏斗的三种结局:(1)、赢了,比禽兽还禽兽。(2)、输了,禽兽不如。(3)、平了,跟禽兽没两样。结论:选择正确的对手很重要。

6

- 1 14:00 PHP中的“syntax error, unexpected T_PAAMAYIM_NEKUDOTAYIM”错误

dcj3sjt126com

PHP

原文地址:http://www.kafka0102.com/2010/08/281.html

因为需要,今天晚些在本机使用PHP做些测试,PHP脚本依赖了一堆我也不清楚做什么用的库。结果一跑起来,就报出类似下面的错误:“Parse error: syntax error, unexpected T_PAAMAYIM_NEKUDOTAYIM in /home/kafka/test/

- xcode6 Auto layout and size classes

dcj3sjt126com

ios

官方GUI

https://developer.apple.com/library/ios/documentation/UserExperience/Conceptual/AutolayoutPG/Introduction/Introduction.html

iOS中使用自动布局(一)

http://www.cocoachina.com/ind

- 通过PreparedStatement批量执行sql语句【sql语句相同,值不同】

梦见x光

sql事务批量执行

比如说:我有一个List需要添加到数据库中,那么我该如何通过PreparedStatement来操作呢?

public void addCustomerByCommit(Connection conn , List<Customer> customerList)

{

String sql = "inseret into customer(id

- 程序员必知必会----linux常用命令之十【系统相关】

hanqunfeng

Linux常用命令

一.linux快捷键

Ctrl+C : 终止当前命令

Ctrl+S : 暂停屏幕输出

Ctrl+Q : 恢复屏幕输出

Ctrl+U : 删除当前行光标前的所有字符

Ctrl+Z : 挂起当前正在执行的进程

Ctrl+L : 清除终端屏幕,相当于clear

二.终端命令

clear : 清除终端屏幕

reset : 重置视窗,当屏幕编码混乱时使用

time com

- NGINX

IXHONG

nginx

pcre 编译安装 nginx

conf/vhost/test.conf

upstream admin {

server 127.0.0.1:8080;

}

server {

listen 80;

&

- 设计模式--工厂模式

kerryg

设计模式

工厂方式模式分为三种:

1、普通工厂模式:建立一个工厂类,对实现了同一个接口的一些类进行实例的创建。

2、多个工厂方法的模式:就是对普通工厂方法模式的改进,在普通工厂方法模式中,如果传递的字符串出错,则不能正确创建对象,而多个工厂方法模式就是提供多个工厂方法,分别创建对象。

3、静态工厂方法模式:就是将上面的多个工厂方法模式里的方法置为静态,

- Spring InitializingBean/init-method和DisposableBean/destroy-method

mx_xiehd

javaspringbeanxml

1.initializingBean/init-method

实现org.springframework.beans.factory.InitializingBean接口允许一个bean在它的所有必须属性被BeanFactory设置后,来执行初始化的工作,InitialzingBean仅仅指定了一个方法。

通常InitializingBean接口的使用是能够被避免的,(不鼓励使用,因为没有必要

- 解决Centos下vim粘贴内容格式混乱问题

qindongliang1922

centosvim

有时候,我们在向vim打开的一个xml,或者任意文件中,拷贝粘贴的代码时,格式莫名其毛的就混乱了,然后自己一个个再重新,把格式排列好,非常耗时,而且很不爽,那么有没有办法避免呢? 答案是肯定的,设置下缩进格式就可以了,非常简单: 在用户的根目录下 直接vi ~/.vimrc文件 然后将set pastetoggle=<F9> 写入这个文件中,保存退出,重新登录,

- netty大并发请求问题

tianzhihehe

netty

多线程并发使用同一个channel

java.nio.BufferOverflowException: null

at java.nio.HeapByteBuffer.put(HeapByteBuffer.java:183) ~[na:1.7.0_60-ea]

at java.nio.ByteBuffer.put(ByteBuffer.java:832) ~[na:1.7.0_60-ea]

- Hadoop NameNode单点问题解决方案之一 AvatarNode

wyz2009107220

NameNode

我们遇到的情况

Hadoop NameNode存在单点问题。这个问题会影响分布式平台24*7运行。先说说我们的情况吧。

我们的团队负责管理一个1200节点的集群(总大小12PB),目前是运行版本为Hadoop 0.20,transaction logs写入一个共享的NFS filer(注:NetApp NFS Filer)。

经常遇到需要中断服务的问题是给hadoop打补丁。 DataNod