tensorflow学习之tensorboard可视化

tensorboard

功能

可视化的好帮手

- Event: 展示训练过程中的统计数据(最值,均值等)变化情况

- Image: 展示训练过程中记录的图像

- Audio: 展示训练过程中记录的音频

- Histogram: 展示训练过程中记录的数据的分布图

原理

- 在运行过程中,记录结构化的数据

- 运行一个本地服务器,监听6006端口

- 请求时,分析记录的数据,绘制

with tf.name_scope('W'):

W = tf.Variable(tf.zeros([784, 10]) , name = 'W')

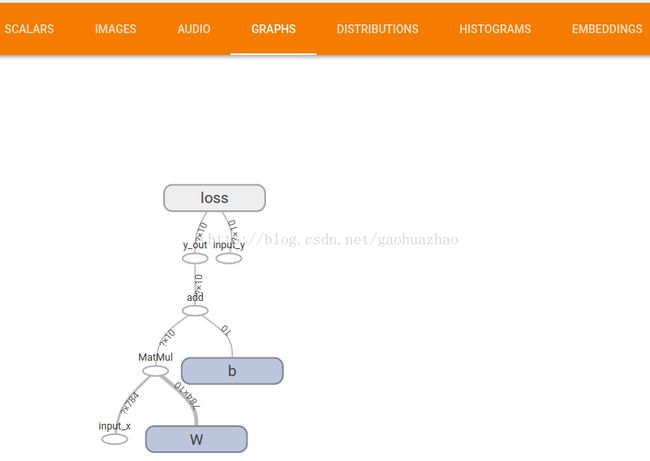

在tensorflow程序中的变量或者常量加上name=‘xxx’,with tf.name_scope('xxx'):是为了让它下面的包含在一个大的框里,这样在模型复杂的时候会看起来更清晰。

然后,我们需要把graph写到文件里面,通过tensorboard来调用显示

writer = tf.summary.FileWriter('logs' , sess.graph)需要注意的是,这是新版本的写法,旧版本是tf.train.SummaryWriter,如果用的tensorflow 1.0版本,那么用旧的方法会报错

运行程序,会在logs文件夹中保存此次的events。

然后将shell定位到当前文件夹中执行:

tensorboard --logdir = logs会出现下面的信息

以前我们是复制这个网址在浏览器打开,但是我发现这个方式行不通了,不知道是我方法的问题,还是浏览器的问题,所以我们用另一种方式。

打开你的浏览器,输入localhost:6006,回车。这时tensorboard就在你的浏览器中启动了

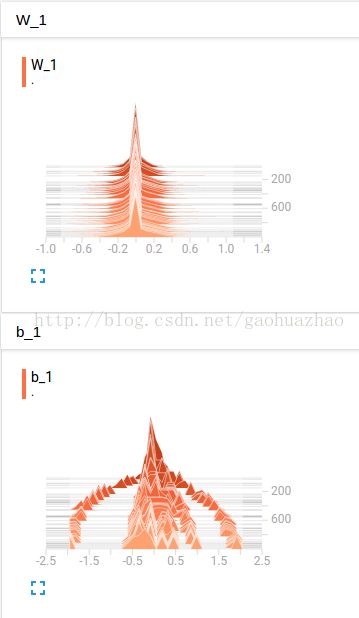

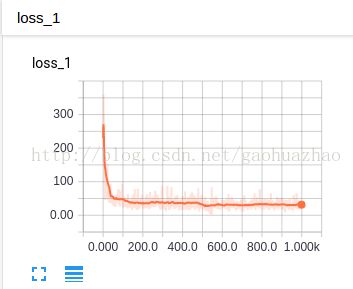

2.histograms显示,scalars显示

在需要查看的变量下面加上:

#histograms

tf.summary.histogram('W' , W)

#scalars

tf.summary.scalar('loss' , cross_entropy)然后,我们需要将这些即时数据合并到一个操作(op)中:

summary_op = tf.summary.merge_all()最后,在每次迭代时都要运行summary_op,并把最新的即时数据写入事件文件中:

for i in range(1000):

batch_xs, batch_ys = mnist.train.next_batch(100)

summary_str = sess.run(summary_op , feed_dict={x:batch_xs , y_:batch_ys})

writer.add_summary(summary_str , i)

train_step.run({x: batch_xs, y_: batch_ys})执行程序,生成新的events文件在logs中,然后同样执行:

tensorboard --logdir=logs这里有一点是要注意的就是,我的tensorboard是pip安装的,如果你的不是,那么tensorboard的启动方式变为

python tensorflow/tensorboard/tensorboard.py --logdir=path并在浏览器中输出localhost:6006打开tensorboard查看:

最后贴上完整的代码(softmax分类mnist数据集):

"""A very simple MNIST classifier.

See extensive documentation at

http://tensorflow.org/tutorials/mnist/beginners/index.md

"""

from __future__ import absolute_import

from __future__ import division

from __future__ import print_function

# Import data

#from tensorflow.examples.tutorials.mnist import input_data

import input_data

import tensorflow as tf

mnist = input_data.read_data_sets("Mnist_data/", one_hot=True)

sess = tf.InteractiveSession()

# Create the model

x = tf.placeholder(tf.float32, [None, 784] , name = 'input_x')

W = tf.Variable(tf.zeros([784, 10]) , name = 'W')

tf.summary.histogram('W' , W)

b = tf.Variable(tf.zeros([10]) , name = 'b')

tf.summary.histogram('b' , b)

y = tf.nn.softmax(tf.matmul(x, W) + b , name = 'y_out')

# Define loss and optimizer

y_ = tf.placeholder(tf.float32, [None, 10] , name = 'input_y')

with tf.name_scope('loss'):

cross_entropy = -tf.reduce_sum(y_ * tf.log(y))

tf.summary.scalar('loss' , cross_entropy)

summary_op = tf.summary.merge_all()

writer = tf.summary.FileWriter('logs' , sess.graph)

train_step = tf.train.GradientDescentOptimizer(0.01).minimize(cross_entropy)

# Train

tf.initialize_all_variables().run()

for i in range(1000):

batch_xs, batch_ys = mnist.train.next_batch(100)

summary_str = sess.run(summary_op , feed_dict={x:batch_xs , y_:batch_ys})

writer.add_summary(summary_str , i)

train_step.run({x: batch_xs, y_: batch_ys})

# Test trained model

correct_prediction = tf.equal(tf.argmax(y, 1), tf.argmax(y_, 1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

print(accuracy.eval({x: mnist.test.images, y_: mnist.test.labels}))

OK~