TF2.0初体验-使用TF2.0 + Keras构建简单的神经网络

群里的小伙伴们都说TF2.0挺不错的,方便了很多,今天咱也先简单学习一波。

先推荐一个教程:https://zhuanlan.zhihu.com/c_1091021863043624960

TensorFlow 2.0 使用 Keras 作为开发者的核心体验。今天体验了一把,确实挺不错的,那么今天就手把手来教学如何通过TF2.0 + Keras构建一个简单神经网络。

1、安装TF2.0虚拟环境

首先,我们要在电脑里装一个tf2.0的虚拟环境(我的电脑是mac,windows和linux类似)。这里使用anaconda的命令:

conda create --name tf2 python=3.6

注意,后面的python版本最好带上,否则什么库都不给你装。这样,在anaconda的envs路径下,就多了一个tf2的虚拟环境,我们可以使用activate命令激活它:

source activate tf2

也可以使用deactivate来退出环境:

source deactivate tf2

接下来,安装tensorflow的环境,我们首先使用清华源:

sudo pip config set global.index-url https://pypi.tuna.tsinghua.edu.cn/simple

然后,安装tf2.0:

sudo pip install tensorflow==2.0.0-alpha

2、创建Jupyter环境

安装了tf2.0的环境还不够,我们还需要把它作为一个kernel加入到jupyter环境中,执行下面两步:

conda install notebook ipykernel

sudo python -m ipykernel install --name tf2

接下来,使用jupyter notebook命令启动ipython。环境切换到tf2:

接下来,我们导入tf和keras,看看版本对不对:

import tensorflow as tf

from tensorflow.keras import layers

print(tf.__version__)

print(tf.keras.__version__)

输出为:

2.0.0-alpha0

2.2.4-tf

哈哈,我们的环境算是安装成功了!接下来,我们这里介绍两种建立神经网络的方式,分别是使用tf.keras.Sequential和使用 Keras 函数式 API创建神经网络。

3、使用tf.keras.Sequential创建神经网络

导入数据

这里,我们下载mnist数据集:

(x_train, y_train), (x_test, y_test) = tf.keras.datasets.mnist.load_data()

x_train = x_train.reshape([x_train.shape[0], -1])

x_test = x_test.reshape([x_test.shape[0], -1])

print(x_train.shape, ' ', y_train.shape)

print(x_test.shape, ' ', y_test.shape)

print(x_train.dtype)

结果为

(60000, 784) (60000,)

(10000, 784) (10000,)

uint8

创建神经网络结构

随后,我们使用tf.keras.Sequential创建神经网络,有两种使用方式:

方式1

model = tf.keras.Sequential()

model.add(layers.Dense(64,activation='relu',input_shape=(784,)))

model.add(layers.Dense(32,activation='relu',kernel_initializer=tf.keras.initializers.glorot_normal))

model.add(layers.Dense(32,activation='relu',kernel_regularizer=tf.keras.regularizers.l2(0.01)))

model.add(layers.Dense(10,activation='softmax'))

方式2

model = tf.keras.Sequential([

layers.Dense(64, activation='relu', kernel_initializer='he_normal', input_shape=(784,)),

layers.Dense(64, activation='relu', kernel_initializer='he_normal'),

layers.Dense(64, activation='relu', kernel_initializer='he_normal',kernel_regularizer=tf.keras.regularizers.l2(0.01)),

layers.Dense(10, activation='softmax')

])

compile函数

complie函数,主要是来编译我们的模型,代码如下:

model.compile(optimizer=tf.keras.optimizers.Adam(0.001),

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

可以看到,我们这里主要提供了三个函数,第一个是使用的优化器optimizer;第二个是模型的损失函数,这里使用的是sparse_categorical_crossentropy,当然也可以写成loss=tf.keras.losses.SparseCategoricalCrossentropy(),但是!但是!后一种写法,在使用save方法保存和加载模型的时候,是会报错的,所以推荐使用字符串的写法;第三个参数是模型评估的方式,这里我们使用正确率来评估模型,当然也可以添加更多。

可以通过model.summary()来查看构建的模型:

使用fit函数训练模型

接下来,使用fit函数训练模型

history = model.fit(x_train, y_train, batch_size=256, epochs=100, validation_split=0.3, verbose=0)

这里,我们加入了验证集,batch_size设置为256,并用history来保存了结果。

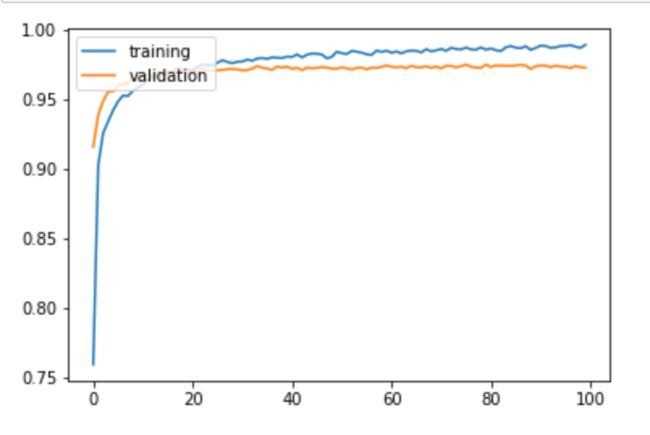

绘制accuracy曲线

来看看history里面都有什么把,运行history.__dict__。有一个关键的key是history,保留了每一步的loss、accuracy、val_loss、val_accuracy。我们直接可以使用history.history['accuracy']来访问每一步训练集的准确率,因此我们可以简单的将其绘制成图:

import matplotlib.pyplot as plt

plt.plot(history.history['accuracy'])

plt.plot(history.history['val_accuracy'])

plt.legend(['training', 'validation'], loc='upper left')

plt.show()

要注意的是,之所以会有accuracy,是因为在compile函数中加入了metrics=['accuracy'],之所以会有val_loss和val_accuracy,是因为我们在fit函数中加入了validation_split=0.3。

使用evaluate进行模型的评测

最后,使用evaluate进行模型的评测:

results = model.evaluate(x_test,y_test)

结果如下:

4、使用Keras 函数式 API创建神经网络

使用tf.keras.Sequential是层的简单堆叠,无法表示任意模型,如具有非序列数据流的模型(例如,残差连接)。而使用Keras 函数式 API则可以。在使用Keras 函数式 API时,层实例可调用并返回张量。 而输入张量和输出张量用于定义 tf.keras.Model 实例。

构建模型

input_x = tf.keras.Input(shape=(784,))

hidden1 = layers.Dense(64, activation='relu', kernel_initializer='he_normal')(input_x)

hidden2 = layers.Dense(64, activation='relu', kernel_initializer='he_normal')(hidden1)

hidden3 = layers.Dense(64, activation='relu', kernel_initializer='he_normal',kernel_regularizer=tf.keras.regularizers.l2(0.01))(hidden2)

output = layers.Dense(10, activation='softmax')(hidden3)

model2 = tf.keras.Model(inputs = input_x,outputs = output)

模型训练

后面的过程就跟前面一样了,不再赘述,直接上代码:

model2.compile(optimizer=tf.keras.optimizers.Adam(0.001),

#loss=tf.keras.losses.SparseCategoricalCrossentropy(),

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

history = model2.fit(x_train, y_train, batch_size=256, epochs=100, validation_split=0.3, verbose=0)

import matplotlib.pyplot as plt

plt.plot(history.history['accuracy'])

plt.plot(history.history['val_accuracy'])

plt.legend(['training', 'validation'], loc='upper left')

plt.show()

5、模型的保存和加载

使用save和tf.keras.models.load_model保存和加载模型:

model.save('model.h5')

model1 = tf.keras.models.load_model('model.h5')

results = model1.evaluate(x_test,y_test)

6、添加BN和Dropout

接下来,我们构建一个更复杂的网络,在里面加入BN和Dropout:

model4 = tf.keras.Sequential([

layers.Dense(64, activation='relu', input_shape=(784,)),

layers.BatchNormalization(),

layers.Dropout(0.2),

layers.Dense(64, activation='relu'),

layers.BatchNormalization(),

layers.Dropout(0.2),

layers.Dense(64, activation='relu'),

layers.BatchNormalization(),

layers.Dropout(0.2),

layers.Dense(10, activation='softmax')

])

model4.compile(optimizer=tf.keras.optimizers.Adam(0.001),

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

model4.compile(optimizer=tf.keras.optimizers.Adam(0.001),

#loss=tf.keras.losses.SparseCategoricalCrossentropy(),

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

history = model4.fit(x_train, y_train, batch_size=256, epochs=100, validation_split=0.3, verbose=0)

import matplotlib.pyplot as plt

plt.plot(history.history['accuracy'])

plt.plot(history.history['val_accuracy'])

plt.legend(['training', 'validation'], loc='upper left')

plt.show()

这个添加BN和Dropout的方式真的是太简单了。。写到这里,我有点拿不准了,先BN还是先Dropout呢?再进一步,Relu、BN和Dropout的顺序是怎样的呢?

7、思考-先BN还是先Relu?

在想这个问题之前,我一直认为的顺序是Relu->BN->Dropout,Dropout的顺序是最后一个应该是没有疑问的,关键是Relu和BN的顺序。更扩展点,是BN和非线性激活函数的关系。

关于这个问题,论文中给出的是先BN,后面接非线性激活函数。但实际中,也有人主张先非线性激活函数,再是BN。关于这个,大家可以看一下知乎的帖子:https://www.zhihu.com/question/283715823。

实际应用中,还是都试试吧,哈哈!

最后,说一下交流群的进群方式:关注微信公众号,“小小挖掘机”,后台回复“进群”即可。