目标检测之四,使用multinet的KittiBox部分进行车辆检测 (demo,train,evalute)

目标检测之四,使用multinet的KittiBox部分进行车辆检测(demo,train,evalute)

使用KittiBox进行车辆检测,训练环境和配置:Ubuntu16.04,python3.5,TensorFlow1.4,i76700K+双GTX Titan X。由于不能直接用作者的源码直接跑,修改了一点点地方,整个过程挺艰辛的(新手刚上路),希望能给大家一点经验。

最近一直在看目标检测的论文和代码,这是一篇用于自动驾驶的论文,在kitti数据集上检测效果特别好,论文称超过了faster-rcnn,在速度和精度上都超越了。能实时检测。Multinet,顾名思义就是指多个网络,这里是指该网络能同时进行三项任务,分类,检测和语义分割。

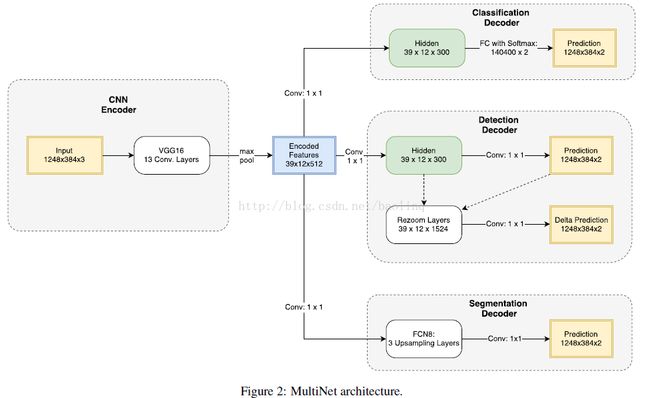

网络结构如下:

网络共用一个编码器,三个任务分别使用三个解码器。上图编码器部分使用VGG16为例进行编码部分的特征提取,也可以改为其他的网络结构,比如googlenet,resnet50,resnet101之类的替换。

主要看看检测解码器

检测解码器FastBox, 被设计为基于回归的检测系统。我们选择一种基于候选区域的解码器, 因为它可以进行端对端的训练, 并且可以非常有效地完成训练和推理。方法灵感来自ReInspect[39], Yolo [38]和Overfeat [44]。除了标准回归流程之外, 我们还包含一个ROI池化方法, 它允许网络利用更高分辨率的特征, 类似较慢的Faster-RCNN。

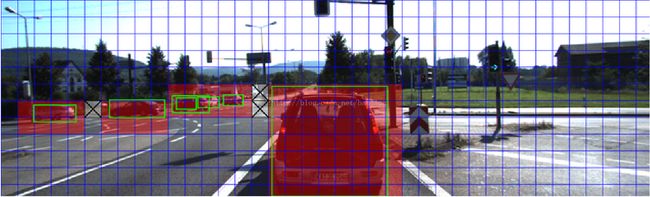

该解码器的第一步是产生bounding box的粗略估计。为了实现这一目标, 首先用500个滤波器的1×1卷积层传递编码的特征, 产生一个39×12×500大小的张量, 我们称之为隐藏层。随后该张量用另一个1×1卷积层处理, 输出6个分辨率为39×12的通道。我们称这个张量为prediction, 张量的值具有语义含义。该张量的前两个通道形成图像的粗分割。这些值表示感兴趣目标存在于39×12网格中的特定位置处的置信度。最后四个通道表示该单元周围区域中边界框的坐标。图3表示有cell的图像。

然而, 这种预测不是非常准确。在本文中, 我们认为这是由于编码器输出时的分辨率已经丢失。为了减轻这个问题, 我们引入了一个rezoom层, 它通过利用高分辨率特征来预测边界框位置上的残差。它通过将更高分辨率的VGG特征的子集(156×48)与隐藏特征(39×12)连接并在其上应用1×1卷积来完成。为了使其成为可能, 需要从高分辨率VGG特征产生39×12网格, 这些网格是通过应用ROI池化[40]使用由tensorprediction提供的粗预测来实现的。最后, 它与39×12×6特征连接, 并通过1×1卷积层以产生残差。

图3:可视化我们的标签编码。蓝色网格:单元(cells)。红细胞:含有汽车的细胞。灰色细胞:无关区域的细胞。绿色框:真实值

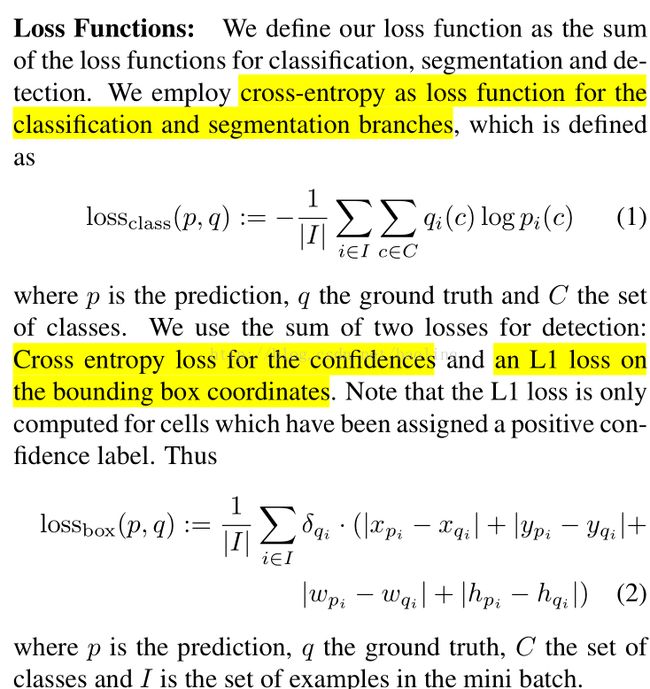

损失函数

训练过程

整个训练过程在作者的GitHub上面讲的蛮多的,很详细,但是吧有些代码是python2 的,如果你对环境是python3,直接按照步骤不能真确运行。需要对好几个文件做一些小小的修改,下面是我的一些训练记录和笔记。

首先是修改了哪些地方,具体文件和具体内容:

代码修改日志,改了5个地方

1.incl/utils/data_utils.py", line 71,in get_cell_grid

for iy in xrange(cell_height):

xrange改为range

2. "/incl/utils/data_utils.py",line 129, in annotation_jitter

if random.random > 0.8:

TypeError: unorderable types:builtin_function_or_method() > float()

random.random 改为random.random()

3.inputs/kitti_input.py", line 160

generator的next属性 gen.next()改为gen.__next__()

4.incl/tensorvision/train.py", line163, in _print_eval_dict

print_str = string.join([nam + ": %.2f" for nam ineval_names],

AttributeError: module 'string' has noattribute 'join'

改为print_str=", ".join([nam + ": %.2f" for nam ineval_names])

5.tensorflow.python.framework.errors_impl.InvalidArgumentError:0-th value returned by pyfunc_0 is uint8, but expects float

修改fastBox.py的evaluaction函数

473行

pred_log_img = tf.py_func(log_image,

[images,test_pred_confidences,

test_pred_boxes,global_step, 'pred'],

[tf.float32])

改为

pred_log_img = tf.py_func(log_image,

[images,test_pred_confidences,

test_pred_boxes,global_step, 'pred'],

[tf.uint8])

修改完后。就可以按照GitHub上面的步骤进行训练了。我复制了一下

- Clone this repository: git clone https://github.com/MarvinTeichmann/KittiBox.git

- Initialize all submodules: git submodule update --init --recursive

- Run cd submodules/utils && make to build cython code

- [Optional] Download Kitti Object Detection Data

- Retrieve Kitti data url here: http://www.cvlibs.net/download.php?file=data_object_image_2.zip

- Call python download_data.py --kitti_url URL_YOU_RETRIEVED

- [Optional] Run cd submodules/KittiObjective2/ && make to build the Kitti evaluation code (seesubmodules/KittiObjective2/README.md for more information)

数据集是KITTI 数据集,上面有下载链接,点击会让你输入一个邮箱,邮箱里有下载的具体地址。当然你也可以取kitti官网直接下载数据和标签。

没有数据集你可以先跑个demo看看效果,跑demo你需要下载KittiBox_pretrained.zip(下载目录ftp://mi.eng.cam.ac.uk/pub/mttt2/models/),demo.py程序是可以自己下载的有点大,2G左右,我是自己下载好的,解压放到新建的RUNS(根据demo.py可以看到)。Run: pythondemo.py --input_image data/demo.png toobtain a prediction using demo.png asinput.

Demo.py还是很容易跑通的。它会输出一大堆信息,然后在demo.png目录下生成一个demo_rects.png就是检测结果。

python demo.py --input_image data/5.png--logdir RUNS/kittiBox_VGG_2017_12_16_19.14 --gpus 0,1

--logdir指定model路径,可以使用任意训练好的model

正式开始训练前还要下载一个vgg.npy(下载链接ftp://mi.eng.cam.ac.uk/pub/mttt2/models/),这是针对用于VGG16训练需要的

现在就可以正式开始训练了

python train.py --hypes hypes/kittiBox_VGG.json --gpus 0,1 指定hypes文件,关于网络的一些参数信息

后面还可以指定一些其他的东西,比如hypes信息,通常是一个json文件,关于model、训练参数等一些信息;

还可以指定GPU训练等等

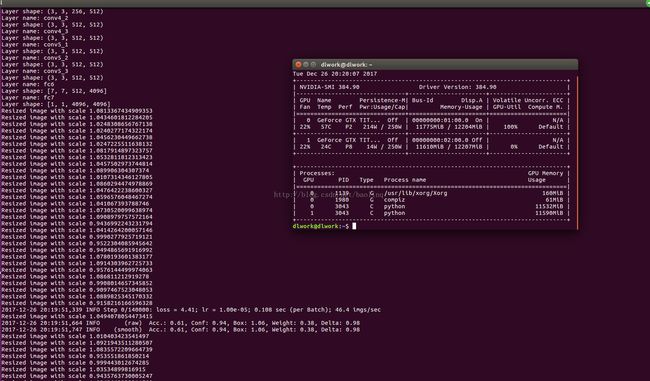

正常训练的截图:

第一次训练我没有修改参数,全是选用默认参数,训练了很久,双GTX-Titan x训练了40个小时左右吧。

训练完后对模型进行评估

evaluate.py文件

python evaluate.py --hypes hypes/kittiBox_VGG.json --RUNkittiBox_VGG_2017_12_16_19.14 --gpus 0,1 评估,指定hypes文件和model目录

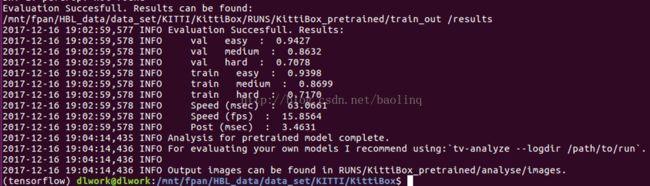

我自己训练的模型评估截图

下面是作者提供的pre_trained的评估结果:

从上图的对比可以看到,我训练的效果竟然比它更好,平均要高1-3的百分点,简直出乎我的意料。

再贴几张检测结果的截图吧

参考

[1] https://github.com/MarvinTeichmann/KittiBox

[2] https://arxiv.org/abs/1612.07695multinet论文

[3] http://blog.csdn.net/hanging_gardens/article/details/72724258一篇翻译

这是我训练KittiBox的一些笔记,不知道会不会适合其他人,有问题欢迎底下交流。