Mac平台下spark单机环境 安装

- 单机环境安装

- 1.安装环境

系统:Linux系统平台(Windows上需要安装Cygwin,以模拟Linux环境)

预装依赖:JDK(Linux系统一般会自带安装好的openjdk,本文跳过JDK的安装)、Scala

- 2.安装Scala

Scala官网地址:http://www.scala-lang.org

1)下载scala-2.11.7.tgz

2)当前目录下解压

tar -xzvf scala-2.11.7.tgz

3)配置环境变量

在/etc/profile中添加如下内容:

# Scala Variables Start

export

SCALA_HOME=/Users/alina/ComputerScience/scala-2.10.5

export

PATH=

${SCALA_HOME}

/bin:

$PATH

# Scala Variables End

$ source /etc/profile 使配置文件生效

$ scala -version 出现如下信息即为配置好

AlinadeMacBook-Pro:~ alina$ scala -version

Scala code runner version 2.10.5 -- Copyright 2002-2013, LAMP/EPFL

- 3.配置ssh

1)在master节点,执行以下命令(单机环境为本地)

$ssh-keygen -t rsa

2)追加到authorized_keys文件

$cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys

3)验证(如果连接被拒绝,需要在系统偏好设置的共享里开启远程登录服务)

$ssh localhost

- 4.安装Spark

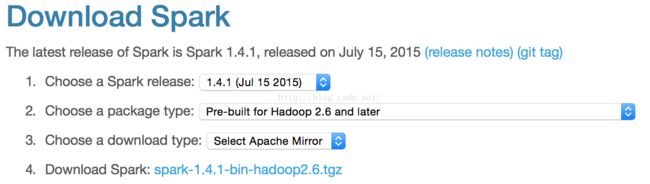

spark官网: http://spark.apache.org/downloads.html

1)下载 spark-1.4.1-bin-hadoop2.6.tgz

2)解压

tar -zxvf spark-1.4.1-bin-hadoop2.6.tar

3)配置环境变量

sudo vim /etc/profile

# Spark Variables Start

export

SPARK_HOME=/Users/alina/ComputerScience/spark-1.4.1-bin-hadoop2.6

export

PATH=

${SPARK_HOME}

/bin:

$PATH

# Spark Variables End

使配置生效

$ source /etc/profile

4)配置conf/spark-env.sh

$ mv spark-env.sh.template spark-env.sh

在spark-env.sh中添加(mac中使用

$(/usr/libexec/java_home)引用java的路径

)

export

SCALA_HOME=

/Users/alina/ComputerScience/scala

-2

.

11

.

7

export

JAVA_HOME=

$(/usr/libexec/java_home)

export

SPARK_WORKER_MEMORY=

2g

5)启动spark

$pwd

/Users/alina/ComputerScience/spark-1.4.1-bin-hadoop2.6/sbin

$./start-all.sh

AlinadeMacBook-Pro:spark-1.4.1-bin-hadoop2.6 alina$ jps

46319 Worker

46192 Master

46342 Jps