像钢铁侠拥有贾维斯管家

在生活中,每个人都幻想着要是我能拥有钢铁侠的贾维斯该多好,哪怕我不要那个战衣!其实我也一直在幻想着又从新把钢铁侠1-3、复仇者联盟、美国队长全部统统看了2次,幻想着自己是超人,深刻的认识到和蝙蝠侠似的,什么叫做“富人科技”,什么叫做有(qian)则无敌,当然,你还需要一颗爱因斯坦的大脑,哈哈哈

想想以前看第一部的时候,哇晒~~~biubiu,棒棒棒~~然后各种科技炫酷,可是现阶段是无法实现做到事情,让人眼前一亮的超前卫科技只能发生在电影中,然后自己回家脑补自己是正义的化身,拥有着万能、能够独立思考、无处不在、犹如百度似的全书般的私人管家——贾维斯。

在我的理解下,贾维斯就是个超级主观与客观因素相结合的程序,能自主将自己转移到任意一个终端(例如现在很火的区块链吧?勿喷哈),SO,只要世界上有互联网,贾维斯就不会消失,比你的男票或女票还体贴,现阶段的科技当然是实现不了,毕竟太科幻,无法做到这种程度,除非真的有传说中的外星文明被我们接纳引用,还是有可能的。

不过,重点来了,基于现在的人工智能,咋们先解读下啥子是人工智能,阿里巴巴的智能运输货仓?京东的物流布局?大数据?笔者认为所有的所有都离不开大数据分析与人工智能和深度学习。

大数据:

把已有数据场景搭建成数据形成可视化是比较个性化了,但是一旦实现出来,某种程度来说还是能增加了很多的工作效率。

假如把所有和你有关的都连在一起,在生活中,社交图谱分析在反欺诈、影响力分析、舆情监测、市场细分、参与优化、体验优化,以及其他需要快速确定复杂行为模式的领域成功应用。云端低成本、快速、解决各种数据运算,再根据用户的倾向,个性化地提供资产配置组合方案,从而让更多人低门槛、低成本地管理自己。说出来我都有点怕。

人工智能:

在我所了解到的,一般入门选手都应该听过人工智能和深度学习,读者跟着我的思路走,别迷路哟~注:这里我引用下段落文章

很多人觉得比较难,其实那只是因为没有遇到能够讲的清楚的人而已。很多人喜欢把简单的事情说得玄乎,以显示自己很厉害,但其实真正厉害的人,是能够把复杂的事情讲解的很深入浅出、通俗易懂的,这才是精髓。

人工智能”的定义所谓智能,其实就是对人某些高级功能的模拟,让计算机去完成一些以前只有人才能完成的工作,比如思考、决策、解决问题等等例如:计算器

人工智能的发展经历了好几个发展阶段,从最开始的简单的逻辑推理,到中期的基于规则(Rule-based)的专家系统,这些都已经有一定的的智能了,但距离我们想象的人工智能还有一大段距离。直到机器学习诞生以后,人工智能界感觉终于找到了感觉。基于机器学习的图像识别和语音识别在某些垂直领域达到了跟人相媲美的程度。人工智能终于能够达到一定的高度了。

根据训练的方法不同,机器学习算法可以大致分类为监督学习、无监督学习和强化学习三种。

监督学习,就是训练数据是有标签的,也就是每个数据都是标注过的,是有正确答案的。训练的时候会告诉模型什么是对的,什么的错的,然后找到输入和输出之间正确的映射关系,比如物体种类的图像识别,识别一张图片内容是只狗,还是棵树。

非监督学习,就是训练数据没有标签的,只有部分特征。模型自己分析数据的特征,找到数据别后隐含的架构关系,比如说自己对数据进行学习分类等等,常见的算法有聚类算法,给你一堆数据,将这数据分为几类。比如在银行的数据库中,给你所有客户的消费记录,让你挑选出哪些可以升级成VIP客户,这就是聚类算法。

还有一种是强化学习,目标是建立环境到行为之间的最佳映射。强化学习的训练是不需要数据的,你告诉他规则或者给他明确一个环境,让模型自己通过不断地尝试,自己根据结果来自己摸索。

Deep Mind的AlphaGo Zero就是通过强化学习训练的,号称花了3天的训练时间就能100:0打败AlphaGo。

比较适合强化学习的一般是环境到行为之间的结果规则比较明确,或者环境比较单一、不太容易受噪音干扰等等,比如下围棋的输赢等等,还可以模拟直升机起降、双足机器人行走等等。

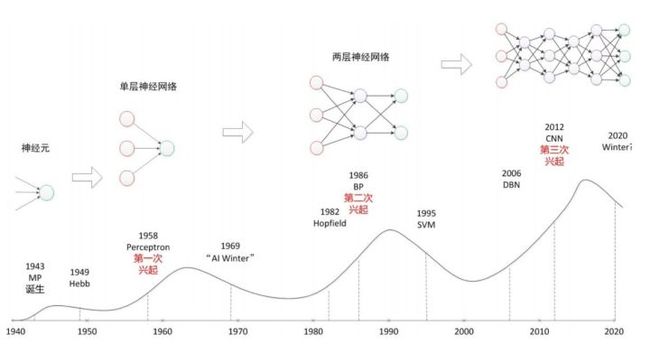

接下来我们再看下人工智能的历史

在这之前,我们先介绍一个比赛。这个比赛是一项图像识别的挑战赛,给你大量图片去做图像识别,比赛看谁的识别错误低。在2012年之前,错误率降低到30%以后,再往下降就很难了,每年只能下降个2,3个百分点。

直到2012年,有一个哥们叫Alex,这哥们在寝室用GPU死磕了一个卷积神经网络的模型,将识别错误率从26%下降到了16%,下降了10%左右,一举震惊了整个人工智能界,当之无愧的获得了当年的冠军。

从此之后,卷积神经网络一炮而红。

那么Alex这哥们的卷积神经网络这么厉害,是因为这个哥们是个学术大牛,有什么独创性的学术研究成果么?--其实并不是。

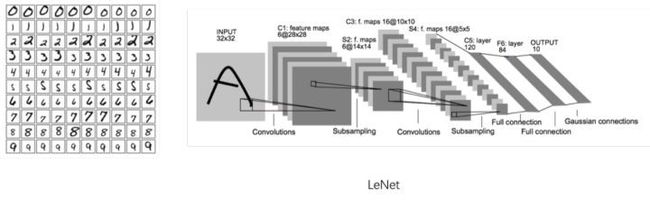

他所采用的模型是1998年Yann Lecun就提出了这个模型,当时Yann Lecun把这个模型应用在识别手写邮编数字的识别上,取得了很好的效果,他搭建的网络,命名为Lenet。这个人的名字——Yann Lecun

人工智能突然爆发背后深层次的原因是什么?数据+算法+计算能力

数据获取,互联网的爆发,尤其是移动互联网和社交网络的普及,可以比较容易的获取大量的互联网资源,尤其是图片和视频资源,因为做深度学习训练的时候需要大量的数据

算法的成熟,尤其是随机梯度下降的方法的优化,以及一些能够有效防止过拟合的算法的提出,至于什么是随机梯度下降和过拟合

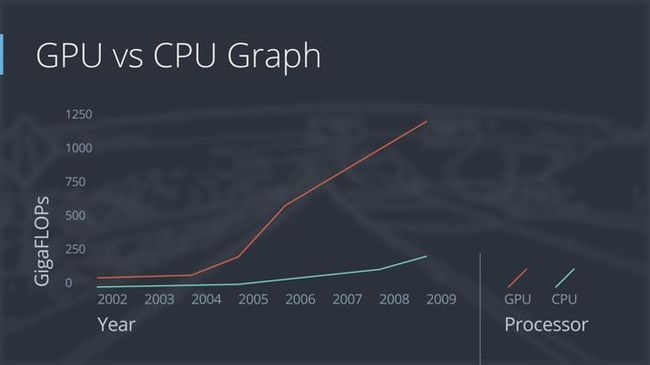

计算能力的提升,因为要训练的数据量很大(都是百万级以上的数据),而且训练的参数也很大(有的比较深的模型有几百万甚至上千万个的参数需要同时优化),而多亏了摩尔定律,能够以较低的价格获取强大的运算能力,也多亏了Nvida,开发了GPU这个神器,可以大幅降低训练时间

GPU的运算速度是CPU的5-10倍左右,同样的模型需要训练,如果用CPU训练需要一个礼拜的话,那使用GPU,只需要一天时间就可以了。

循环神经网络

新鲜的词汇,是目前非常流行的神经网络模型,在自然语言处理的很多任务中已经展示出卓越的效果。但是在介绍 RNN 的诸多文章中,通常都是介绍 RNN 的使用方法和实战效果循环神经网络是一个在时间上传递的神经网络,网络的深度就是时间的长度。该神经网络是专门用来处理时间序列问题的,能够提取时间序列的信息。如果是前向神经网络,每一层的神经元信号只能够向下一层传播,样本的处理在时刻上是独立的。对于循环神经网络而言,神经元在这个时刻的输出可以直接影响下一个时间点的输入,因此该神经网络能够处理时间序列方面的问题(找不到插图,读者自己脑补一堆的函数皆可哈)

截止到目前,我们汇总下我们的学习内容,我们了解了人工智能的简单介绍,大致了解了人工智能的算法分类以及发展历史。

现在回想起来先要真正的贾维斯,基于现在还是只能存在于我们的电影科幻世界里面,我相信未来的50年能有第一位贾维斯管家出现在我们面前,在这里读者看到这句话前介绍一部电影叫《机械公敌》不到未来的未来会不人工智能控制着人类咧?

《本文引用聊聊汽车大牛段落文章,经过作者许可引用》