- Spark集群启动与关闭

陈沐

sparksparkhadoopbigdata

Hadoop集群和Spark的启动与关闭Hadoop集群开启三台虚拟机均启动ZookeeperzkServer.shstartMaster1上面执行启动HDFSstart-dfs.shslave1上面执行开启YARNstart-yarn.shslave2上面执行开启YARN的资源管理器yarn-daemon.shstartresourcemanager(如果nodeManager没有启动(正常情况

- Spark 解析_spark.sparkContext.getConf().getAll()

闯闯桑

spark大数据分布式

spark.sparkContext.getConf().getAll()是ApacheSpark中的一段代码,用于获取当前Spark应用程序的所有配置项及其值。以下是逐部分解释:代码分解:spark:这是一个SparkSession对象,它是Spark应用程序的入口点,用于与Spark集群进行交互。spark.sparkContext:sparkContext是Spark的核心组件,负责与集群通

- Pandas与PySpark混合计算实战:突破单机极限的智能数据处理方案

Eqwaak00

Pandaspandas学习python科技开发语言

引言:大数据时代的混合计算革命当数据规模突破十亿级时,传统单机Pandas面临内存溢出、计算缓慢等瓶颈。PySpark虽能处理PB级数据,但在开发效率和局部计算灵活性上存在不足。本文将揭示如何构建Pandas+PySpark混合计算管道,在保留Pandas便捷性的同时,借助Spark分布式引擎实现百倍性能提升,并通过真实电商用户画像案例演示全流程实现。一、混合架构设计原理1.1技术栈优势分析维度P

- 自定义Spark启动的metastore_db和derby.log生成路径

节昊文

spark大数据分布式

1.进入安装spark目录的conf目录下2.复制spark-defaults.conf.template文件为spark-defaults.conf3.在spark-defaults.conf文件的末尾添加一行:spark.driver.extraJavaOptions-Dderby.system.home=/log即生成的文件存放的目录

- 介绍 Apache Spark 的基本概念和在大数据分析中的应用

佛渡红尘

apache

ApacheSpark是一个开源的集群计算框架,最初由加州大学伯克利分校的AMPLab开发,用于大规模数据处理和分析。相比于传统的MapReduce框架,Spark具有更快的数据处理速度和更强大的计算能力。ApacheSpark的基本概念包括:弹性分布式数据集(RDD):是Spark中基本的数据抽象,是一个可并行操作的分区记录集合。RDD可以在集群中的节点间进行分布式计算。转换(Transform

- 从“笨重大象”到“敏捷火花”:Hadoop与Spark的大数据技术进化之路

Echo_Wish

大数据大数据hadoopspark

从“笨重大象”到“敏捷火花”:Hadoop与Spark的大数据技术进化之路说起大数据技术,Hadoop和Spark可以说是这个领域的两座里程碑。Hadoop曾是大数据的开山之作,而Spark则带领我们迈入了一个高效、灵活的大数据处理新时代。那么,它们的演变过程到底有何深意?背后技术上的取舍和选择,又意味着什么?一、Hadoop:分布式存储与计算的奠基者Hadoop诞生于互联网流量爆发式增长的时代,

- Hive 与 SparkSQL 的语法差异及性能对比

自然术算

Hivehivehadoop大数据spark

在大数据处理领域,Hive和SparkSQL都是极为重要的工具,它们为大规模数据的存储、查询和分析提供了高效的解决方案。虽然二者都致力于处理结构化数据,并且都采用了类似SQL的语法来方便用户进行操作,但在实际使用中,它们在语法细节和性能表现上存在诸多差异。了解这些差异,对于开发者根据具体业务场景选择合适的工具至关重要。语法差异数据定义语言(DDL)表创建语法Hive:在Hive中创建表时,需要详细

- Spark任务读取hive表数据导入es

小小小小小小小小小小码农

hiveelasticsearchsparkjava

使用elasticsearch-hadoop将hive表数据导入es,超级简单1.引入pomorg.elasticsearchelasticsearch-hadoop9.0.0-SNAPSHOT2.创建sparkconf//spark参数设置SparkConfsparkConf=newSparkConf();//要写入的索引sparkConf.set("es.resource","");//es集

- Spark sql 中row的用法

闯闯桑

sparksql大数据开发语言

在ApacheSpark中,Row是一个表示一行数据的类。它是SparkSQL中DataFrame或Dataset的基本数据单元。每一行数据都由一个Row对象表示,而Row对象中的每个字段对应数据的一个列。Row的用法Row对象通常用于以下场景:创建数据:当你手动创建数据时,可以使用Row对象来表示每一行数据。访问数据:当你从DataFrame或Dataset中提取数据时,每一行数据都是一个Row

- Spark Sql 简单校验的实现

小小小小小小小小小小码农

sparksqljava

在网上参考了很多资料,都是要依赖Sparksession,这个需要spark环境,非常不友好,jdk版本也不好控制。不使用Sparksession获取上下文,利用spark和antlr的静态方法使用java实现简单的sparksql的语法以及内置函数的校验。1.spark版本3.2.0org.apache.sparkspark-sql_2.123.2.0org.antlrantlr4-runtim

- PySpark安装及WordCount实现(基于Ubuntu)

uui1885478445

ubuntulinux运维

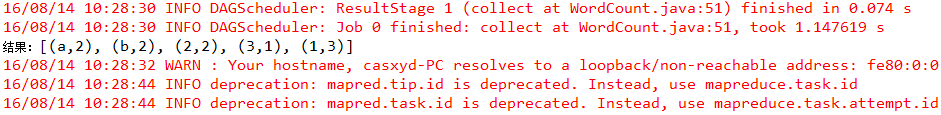

在Ubuntu上安装PySpark并实现WordCount,需要以下步骤:安装PySpark:安装Java:PySpark需要Java运行环境。你可以使用以下命令安装OpenJDK:sudoaptupdatesudoaptinstalldefault-jredefault-jdk安装Scala:PySpark还需要Scala,可以使用以下命令安装:sudoaptinstallscala安装Pyth

- 大数据手册(Spark)--Spark安装配置

WilenWu

数据分析(DataAnalysis)大数据spark分布式

本文默认在zsh终端安装配置,若使用bash终端,环境变量的配置文件相应变化。若安装包下载缓慢,可复制链接到迅雷下载,亲测极速~准备工作Spark的安装过程较为简单,在已安装好Hadoop的前提下,经过简单配置即可使用。假设已经安装好了hadoop(伪分布式)和hive,环境变量如下JAVA_HOME=/usr/opt/jdkHADOOP_HOME=/usr/local/hadoopHIVE_HO

- 国内外AI搜索产品盘点

Suee2020

人工智能

序号AISearch产品名简介网站开发者1Perplexity强大的对话式AI搜索引擎https://www.perplexity.aiPerplexity2GensparkAIAgent搜索引擎https://www.genspark.aiMainFunc(景鲲、朱凯华)3Kimi.ai智能助手https://kimi.moonshot.cn/月之暗面(杨植麟)4秘塔AI搜索AI搜索引擎http

- HIVE开窗函数

Cciccd

sqlhive

ETL,SQL面试高频考点——HIVE开窗函数(基础篇)目录标题ETL,SQL面试高频考点——HIVE开窗函数(基础篇)一,窗口函数介绍二,开窗函数三,分析函数分类1,排序分析函数:实列解析对比总结2.聚合分析函数3.用spark自定义HIVE用户自定义函数后续更新中~一,窗口函数介绍窗口函数,也叫OLAP函数(OnlineAnallyticalProcessing,联机分析处理),可以对数据库数

- Hive MR & Spark & Yarn参数优化总结

大数据侠客

hive相关问题汇总及解决hivesparkmryarn参数优化

一、hivemr参数调优:sethive.optimize.ppd=true;--开启谓词下推。--动态分区参数sethive.exec.mode.local.auto=true;sethive.exec.dynamic.partition.mode=nonstrict;--默认是strict,表示至少有一个静态分区,nonstri

- Spark 中创建 DataFrame 的2种方式对比

闯闯桑

spark大数据分布式scala

spark.createDataFrame(data).toDF("name","age")和spark.createDataFrame(spark.sparkContext.parallelize(data),schema)创建df的方式有什么区别?在Spark中,创建DataFrame的方式有多种,其中两种常见的方式是:spark.createDataFrame(data).toDF("nam

- python手写kmeans算法

菜鸟懿

机器学习聚类算法python

kmean聚类是最基础和常见的算法,工程上使用比较常见,spark,sklearn都有实现,本文手写实现kmeans#!/usr/bin/pythonimportsysimportrandomimportmathdefcreate_rand_points(max_x,max_y,count):"""Createcountpoints(0-x),(0-y)."""points=[]foriinran

- 数据分析大数据面试题大杂烩01

爱学习的菜鸟罢了

大数据flink大数据面试hivehadoopkafka

互联网:通过埋点实时计算用户浏览频次用优惠券等措施吸引用户,通过历史信息用非智能学习的title方式构造用户画像(抖音,京东)电信,银行统计营收和针对用户的个人画像:处理大量非实时数据政府:健康码,扫码之后确诊,找出与确诊对象有关联的人订单订单表(除商品以外所有信息),商品详情表,通过搜集用户title进行定制化推荐点击流数据通过埋点进行用户点击行为分析FLINK一般用来做实时SPARK一般用来做

- doris:SQL 方言兼容

向阳1218

大数据doris

提示从2.1版本开始,Doris可以支持多种SQL方言,如Presto、Trino、Hive、PostgreSQL、Spark、Clickhouse等等。通过这个功能,用户可以直接使用对应的SQL方言查询Doris中的数据,方便用户将原先的业务平滑的迁移到Doris中。警告该功能目前是实验性功能,您在使用过程中如遇到任何问题,欢迎通过邮件组、GitHubIssue等方式进行反馈。部署服务下载最新版

- 25年大数据开发省赛样题第一套,离线数据处理答案

Tometor

大数据sparkscala

省赛样题一,数据抽取模块这一模块的作用是从mysql抽取数据到ods层进行指标计算,在题目中要求进行全量抽取,并新增etl-date字段进行分区,日期为比赛前一天importorg.apache.spark.sql.SparkSessionimportjava.util.PropertiesobjectTask1{defmain(args:Array[String]):Unit={valspark

- sparkML入门,通俗解释机器学习的框架和算法

Tometor

spark-ml机器学习算法回归数据挖掘人工智能scala

一、机器学习的整体框架(类比烹饪)假设你要做一道菜,机器学习的过程可以类比为:步骤-->烹饪类比-->机器学习对应1.确定目标|想做什么菜(红烧肉/沙拉)|明确任务(分类/回归/聚类)2.准备食材|买菜、洗菜、切菜|数据收集与预处理3.设计食谱|决定烹饪步骤和调料|选择算法和模型设计4.试做并尝味道|调整火候和调味|模型训练与调参5.最终成品|端上桌的菜|模型部署与应用二、机器学习的核心流程1.数

- 大数据面试之路 (三) mysql

愿与狸花过一生

大数据面试职场和发展

技术选型通常也是被问道的问题,一方面考察候选人对技术掌握程度,另一方面考察对项目的理解,以及项目总结能力。介绍项目是从数据链路介绍,是一个很好来的方式,会让人觉得思路清晰,项目理解透彻。将SparkSQL加工后的数据存入MySQL通常基于以下几个关键原因:1.数据应用场景适配OLTP与OLAP分工:SparkSQL擅长处理大数据量的OLAP(分析型)任务,而MySQL作为OLTP(事务型)数据库,

- 如何使用 SparkLLM 进行自然语言处理

shuoac

python

在当代自然语言处理领域,拥有强大的跨域知识和语言理解能力的模型至关重要。iFLYTEK开发的SparkLLM便是这样一个大规模认知模型。通过学习大量文本、代码和图像,SparkLLM能够理解和执行基于自然对话的任务。在本文中,我们将深入探讨如何配置和使用SparkLLM来处理自然语言任务。技术背景介绍大规模语言模型(LLM)近年来在各个领域中获得了广泛的应用,它们在处理自然语言任务时表现出色。iF

- RDD 行动算子

阿强77

RDDSpark

在ApacheSpark中,RDD(弹性分布式数据集)是核心数据结构之一。行动算子会触发实际的计算并返回结果或执行某些操作。以下是Scala中常见的RDD行动算子:1.collect()将RDD中的所有数据收集到驱动程序中,并返回一个数组。注意:如果数据集很大,可能会导致内存不足。valdata:Array[T]=rdd.collect()2.count()返回RDD中元素的总数。valcount

- 讲一下Spark的shuffle过程

冰火同学

Sparkspark大数据分布式

首先Spark的shuffle是Spark分布式集群计算的核心。Spark的shuffle可以从shuffle的阶段划分,shuffle数据存储,shuffle的数据拉取三个方面进行讲解。首先shuffle的阶段分为shuffle的shufflewrite阶段和shuffleread阶段。shufflewrite的触发条件就是上游的Stage任务shuffleMapTask完成计算后,会哪找下游S

- Spark常见面试题目(1)

冰火同学

Sparkspark面试大数据

Spark有哪几种部署的方式,谈谈方式都有哪些特点第一种是local本地部署,通常就是一台机器用于测试。第二种是standalone部署模式,就是一个master节点,控制几个work节点,其实一台机器的standalone模式就是它自己即是master,又是work。第三种是yarn模式,就是吧spark交给yarn进行资源调度管理。第四种就是messon模式,这种在国内很少见到。Spark主备

- Spark数据倾斜的问题

冰火同学

Sparkspark大数据分布式

Spark数据倾斜业务背景Spark数据倾斜表现Spark的数据倾斜,包括SparkStreaming和SparkSQL,表现主要有下面几种:1、Excutorlost,OOM,Shuffle过程出错2、DriverOOM3、单个Excutor执行器一直在运行,整体任务卡在某个阶段不能结束4、正常运行的任务突然失败数据倾斜产生的原因以Spark使用场景为例,我们再做数据计算的时候会涉及类似coun

- PySpark实现导出两个包含多个Parquet数据文件的S3目录里的对应值的差异值分析

weixin_30777913

pythonspark数据分析云计算

编写PySpark代码实现从一个包含多个Parquet数据文件的AmazonS3目录的dataframe数据里取两个维度字段,一个度量字段的数据,根据这两个维度字段的数据分组统计,计算度量字段的数据的分组总计值,得到一个包含两个维度字段和度量字段的分组总计值字段的dataframe,再从另一个包含多个Parquet数据文件的S3目录的dataframe数据里取两个维度字段,一个度量字段的数据组成一

- Hadoop、Spark和 Hive 的详细关系

夜行容忍

hadoopsparkhive

Hadoop、Spark和Hive的详细关系1.ApacheHadoopHadoop是一个开源框架,用于分布式存储和处理大规模数据集。核心组件:HDFS(HadoopDistributedFileSystem):分布式文件系统,提供高吞吐量的数据访问。YARN(YetAnotherResourceNegotiator):集群资源管理和作业调度系统。MapReduce:基于YARN的并行处理框架,用

- 大数据技术生态圈:Hadoop、Hive、Spark的区别和关系

雨中徜徉的思绪漫溢

大数据hadoophive

大数据技术生态圈:Hadoop、Hive、Spark的区别和关系在大数据领域中,Hadoop、Hive和Spark是三个常用的开源技术,它们在大数据处理和分析方面发挥着重要作用。虽然它们都是为了处理大规模数据集而设计的,但它们在功能和使用方式上存在一些区别。本文将详细介绍Hadoop、Hive和Spark的区别和关系,并提供相应的源代码示例。Hadoop:Hadoop是一个用于分布式存储和处理大规

- apache ftpserver-CentOS config

gengzg

apache

<server xmlns="http://mina.apache.org/ftpserver/spring/v1"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="

http://mina.apache.o

- 优化MySQL数据库性能的八种方法

AILIKES

sqlmysql

1、选取最适用的字段属性 MySQL可以很好的支持大数据量的存取,但是一般说来,数据库中的表越小,在它上面执行的查询也就会越快。因此,在创建表的时候,为了获得更好的 性能,我们可以将表中字段的宽度设得尽可能小。例如,在定义邮政编码这个字段时,如果将其设置为CHAR(255),显然给数据库增加了不必要的空间,甚至使用VARCHAR这种类型也是多余的,因为CHAR(6)就可以很

- JeeSite 企业信息化快速开发平台

Kai_Ge

JeeSite

JeeSite 企业信息化快速开发平台

平台简介

JeeSite是基于多个优秀的开源项目,高度整合封装而成的高效,高性能,强安全性的开源Java EE快速开发平台。

JeeSite本身是以Spring Framework为核心容器,Spring MVC为模型视图控制器,MyBatis为数据访问层, Apache Shiro为权限授权层,Ehcahe对常用数据进行缓存,Activit为工作流

- 通过Spring Mail Api发送邮件

120153216

邮件main

原文地址:http://www.open-open.com/lib/view/open1346857871615.html

使用Java Mail API来发送邮件也很容易实现,但是最近公司一个同事封装的邮件API实在让我无法接受,于是便打算改用Spring Mail API来发送邮件,顺便记录下这篇文章。 【Spring Mail API】

Spring Mail API都在org.spri

- Pysvn 程序员使用指南

2002wmj

SVN

源文件:http://ju.outofmemory.cn/entry/35762

这是一篇关于pysvn模块的指南.

完整和详细的API请参考 http://pysvn.tigris.org/docs/pysvn_prog_ref.html.

pysvn是操作Subversion版本控制的Python接口模块. 这个API接口可以管理一个工作副本, 查询档案库, 和同步两个.

该

- 在SQLSERVER中查找被阻塞和正在被阻塞的SQL

357029540

SQL Server

SELECT R.session_id AS BlockedSessionID ,

S.session_id AS BlockingSessionID ,

Q1.text AS Block

- Intent 常用的用法备忘

7454103

.netandroidGoogleBlogF#

Intent

应该算是Android中特有的东西。你可以在Intent中指定程序 要执行的动作(比如:view,edit,dial),以及程序执行到该动作时所需要的资料 。都指定好后,只要调用startActivity(),Android系统 会自动寻找最符合你指定要求的应用 程序,并执行该程序。

下面列出几种Intent 的用法

显示网页:

- Spring定时器时间配置

adminjun

spring时间配置定时器

红圈中的值由6个数字组成,中间用空格分隔。第一个数字表示定时任务执行时间的秒,第二个数字表示分钟,第三个数字表示小时,后面三个数字表示日,月,年,< xmlnamespace prefix ="o" ns ="urn:schemas-microsoft-com:office:office" />

测试的时候,由于是每天定时执行,所以后面三个数

- POJ 2421 Constructing Roads 最小生成树

aijuans

最小生成树

来源:http://poj.org/problem?id=2421

题意:还是给你n个点,然后求最小生成树。特殊之处在于有一些点之间已经连上了边。

思路:对于已经有边的点,特殊标记一下,加边的时候把这些边的权值赋值为0即可。这样就可以既保证这些边一定存在,又保证了所求的结果正确。

代码:

#include <iostream>

#include <cstdio>

- 重构笔记——提取方法(Extract Method)

ayaoxinchao

java重构提炼函数局部变量提取方法

提取方法(Extract Method)是最常用的重构手法之一。当看到一个方法过长或者方法很难让人理解其意图的时候,这时候就可以用提取方法这种重构手法。

下面是我学习这个重构手法的笔记:

提取方法看起来好像仅仅是将被提取方法中的一段代码,放到目标方法中。其实,当方法足够复杂的时候,提取方法也会变得复杂。当然,如果提取方法这种重构手法无法进行时,就可能需要选择其他

- 为UILabel添加点击事件

bewithme

UILabel

默认情况下UILabel是不支持点击事件的,网上查了查居然没有一个是完整的答案,现在我提供一个完整的代码。

UILabel *l = [[UILabel alloc] initWithFrame:CGRectMake(60, 0, listV.frame.size.width - 60, listV.frame.size.height)]

- NoSQL数据库之Redis数据库管理(PHP-REDIS实例)

bijian1013

redis数据库NoSQL

一.redis.php

<?php

//实例化

$redis = new Redis();

//连接服务器

$redis->connect("localhost");

//授权

$redis->auth("lamplijie");

//相关操

- SecureCRT使用备注

bingyingao

secureCRT每页行数

SecureCRT日志和卷屏行数设置

一、使用securecrt时,设置自动日志记录功能。

1、在C:\Program Files\SecureCRT\下新建一个文件夹(也就是你的CRT可执行文件的路径),命名为Logs;

2、点击Options -> Global Options -> Default Session -> Edite Default Sett

- 【Scala九】Scala核心三:泛型

bit1129

scala

泛型类

package spark.examples.scala.generics

class GenericClass[K, V](val k: K, val v: V) {

def print() {

println(k + "," + v)

}

}

object GenericClass {

def main(args: Arr

- 素数与音乐

bookjovi

素数数学haskell

由于一直在看haskell,不可避免的接触到了很多数学知识,其中数论最多,如素数,斐波那契数列等,很多在学生时代无法理解的数学现在似乎也能领悟到那么一点。

闲暇之余,从图书馆找了<<The music of primes>>和<<世界数学通史>>读了几遍。其中素数的音乐这本书与软件界熟知的&l

- Java-Collections Framework学习与总结-IdentityHashMap

BrokenDreams

Collections

这篇总结一下java.util.IdentityHashMap。从类名上可以猜到,这个类本质应该还是一个散列表,只是前面有Identity修饰,是一种特殊的HashMap。

简单的说,IdentityHashMap和HashM

- 读《研磨设计模式》-代码笔记-享元模式-Flyweight

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.util.ArrayList;

import java.util.Collection;

import java.util.HashMap;

import java.util.List;

import java

- PS人像润饰&调色教程集锦

cherishLC

PS

1、仿制图章沿轮廓润饰——柔化图像,凸显轮廓

http://www.howzhi.com/course/retouching/

新建一个透明图层,使用仿制图章不断Alt+鼠标左键选点,设置透明度为21%,大小为修饰区域的1/3左右(比如胳膊宽度的1/3),再沿纹理方向(比如胳膊方向)进行修饰。

所有修饰完成后,对该润饰图层添加噪声,噪声大小应该和

- 更新多个字段的UPDATE语句

crabdave

update

更新多个字段的UPDATE语句

update tableA a

set (a.v1, a.v2, a.v3, a.v4) = --使用括号确定更新的字段范围

- hive实例讲解实现in和not in子句

daizj

hivenot inin

本文转自:http://www.cnblogs.com/ggjucheng/archive/2013/01/03/2842855.html

当前hive不支持 in或not in 中包含查询子句的语法,所以只能通过left join实现。

假设有一个登陆表login(当天登陆记录,只有一个uid),和一个用户注册表regusers(当天注册用户,字段只有一个uid),这两个表都包含

- 一道24点的10+种非人类解法(2,3,10,10)

dsjt

算法

这是人类算24点的方法?!!!

事件缘由:今天晚上突然看到一条24点状态,当时惊为天人,这NM叫人啊?以下是那条状态

朱明西 : 24点,算2 3 10 10,我LX炮狗等面对四张牌痛不欲生,结果跑跑同学扫了一眼说,算出来了,2的10次方减10的3次方。。我草这是人类的算24点啊。。

然后么。。。我就在深夜很得瑟的问室友求室友算

刚出完题,文哥的暴走之旅开始了

5秒后

- 关于YII的菜单插件 CMenu和面包末breadcrumbs路径管理插件的一些使用问题

dcj3sjt126com

yiiframework

在使用 YIi的路径管理工具时,发现了一个问题。 <?php

- 对象与关系之间的矛盾:“阻抗失配”效应[转]

come_for_dream

对象

概述

“阻抗失配”这一词组通常用来描述面向对象应用向传统的关系数据库(RDBMS)存放数据时所遇到的数据表述不一致问题。C++程序员已经被这个问题困扰了好多年,而现在的Java程序员和其它面向对象开发人员也对这个问题深感头痛。

“阻抗失配”产生的原因是因为对象模型与关系模型之间缺乏固有的亲合力。“阻抗失配”所带来的问题包括:类的层次关系必须绑定为关系模式(将对象

- 学习编程那点事

gcq511120594

编程互联网

一年前的夏天,我还在纠结要不要改行,要不要去学php?能学到真本事吗?改行能成功吗?太多的问题,我终于不顾一切,下定决心,辞去了工作,来到传说中的帝都。老师给的乘车方式还算有效,很顺利的就到了学校,赶巧了,正好学校搬到了新校区。先安顿了下来,过了个轻松的周末,第一次到帝都,逛逛吧!

接下来的周一,是我噩梦的开始,学习内容对我这个零基础的人来说,除了勉强完成老师布置的作业外,我已经没有时间和精力去

- Reverse Linked List II

hcx2013

list

Reverse a linked list from position m to n. Do it in-place and in one-pass.

For example:Given 1->2->3->4->5->NULL, m = 2 and n = 4,

return

- Spring4.1新特性——页面自动化测试框架Spring MVC Test HtmlUnit简介

jinnianshilongnian

spring 4.1

目录

Spring4.1新特性——综述

Spring4.1新特性——Spring核心部分及其他

Spring4.1新特性——Spring缓存框架增强

Spring4.1新特性——异步调用和事件机制的异常处理

Spring4.1新特性——数据库集成测试脚本初始化

Spring4.1新特性——Spring MVC增强

Spring4.1新特性——页面自动化测试框架Spring MVC T

- Hadoop集群工具distcp

liyonghui160com

1. 环境描述

两个集群:rock 和 stone

rock无kerberos权限认证,stone有要求认证。

1. 从rock复制到stone,采用hdfs

Hadoop distcp -i hdfs://rock-nn:8020/user/cxz/input hdfs://stone-nn:8020/user/cxz/运行在rock端,即源端问题:报版本

- 一个备份MySQL数据库的简单Shell脚本

pda158

mysql脚本

主脚本(用于备份mysql数据库): 该Shell脚本可以自动备份

数据库。只要复制粘贴本脚本到文本编辑器中,输入数据库用户名、密码以及数据库名即可。我备份数据库使用的是mysqlump 命令。后面会对每行脚本命令进行说明。

1. 分别建立目录“backup”和“oldbackup” #mkdir /backup #mkdir /oldbackup

- 300个涵盖IT各方面的免费资源(中)——设计与编码篇

shoothao

IT资源图标库图片库色彩板字体

A. 免费的设计资源

Freebbble:来自于Dribbble的免费的高质量作品。

Dribbble:Dribbble上“免费”的搜索结果——这是巨大的宝藏。

Graphic Burger:每个像素点都做得很细的绝佳的设计资源。

Pixel Buddha:免费和优质资源的专业社区。

Premium Pixels:为那些有创意的人提供免费的素材。

- thrift总结 - 跨语言服务开发

uule

thrift

官网

官网JAVA例子

thrift入门介绍

IBM-Apache Thrift - 可伸缩的跨语言服务开发框架

Thrift入门及Java实例演示

thrift的使用介绍

RPC

POM:

<dependency>

<groupId>org.apache.thrift</groupId>