特征匹配中OpenCV Dmatch类的用法解析以及非常详细的ORB特征提取与匹配解析

首先说明一点,在SLAM中进行特征提取和匹配时,需要注意使用的OpenCV版本,在使用OpenCV2.x版本时,可以创建特征对象如下所示(省略了参数表):

ORB orb;

SURF surf;

SIFT sift;

orb.detect();

sift.detect();

surf.detect();

但是OpenCV3.X中就不允许这么做了,这是因为,opencv3.0直接使用 ORB orb时,ORB里面没有构造方法,只有一个静态的create。所以特征提取时,就只能使用以下方式:

Ptr orb=ORB::create()//参数表省略了,具体可查看官方文档,或者输入VS2015等IDE看智能提示;

下面重点说一下,DMatch类,在OpenCV2.x中Dmatch为结构体数据类型,在OpenCV3.x中为Class类型。在OpenCV3.x中的定义为:

class CV_EXPORTS_W_SIMPLE DMatch

{

public:

CV_WRAP DMatch();

CV_WRAP DMatch(int _queryIdx, int _trainIdx, float _distance);

CV_WRAP DMatch(int _queryIdx, int _trainIdx, int _imgIdx, float _distance);

CV_PROP_RW int queryIdx; // query descriptor index

CV_PROP_RW int trainIdx; // train descriptor index

CV_PROP_RW int imgIdx; // train image index

CV_PROP_RW float distance;

// less is better

bool operator<(const DMatch &m) const;

};

一个匹配器尝试在一副或一组图中匹配一幅图中的关键点,如果匹配成功,将返回 cv::DMatch 的列表,说人话:Dmatch对象保存的是匹配成功的结果,当然这个匹配结果里面包含了不少的误匹配。

成员说明:

queryIdx : 查询点的索引(当前要寻找匹配结果的点在它所在图片上的索引).

trainIdx : 被查询到的点的索引(存储库中的点的在存储库上的索引)

distance: 为两个描述子之间的距离

举个例子:下面给出提取ORB特征并进行匹配的过程(基于OpenCV3.2),以及DMatch对象的用法。下面使用的两张图盘我就不上传了,随便找一张图片,然后截图一部分当做另一张图片,一般而言,截图出来的那部分图片,当做第一张,也就是train,完整的是第二张也就是query。运行环境:VS2015+OpenCV3.2.0

#include 本身对上述代码中Dmatch理解并不透彻,于是进行了单步调试:

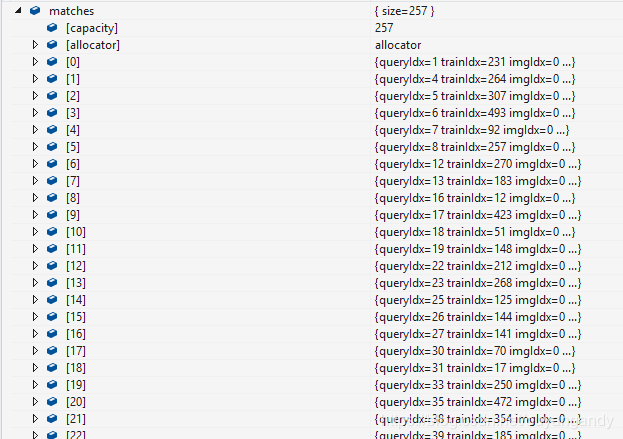

运行至43行时,结果如下:

看出两幅图的匹配点对数为257对:第一对匹配点为:查询图片的第1个特征点匹配训练图片的第231个特征点,4-264,5-307,7-92,等等等等。

这样就可以取出匹配点对的id,继而进行下一步操作。

有需要的话,再继续讲下去。