《深入浅出统计学》读书笔记

1、信息图形化

饼图

对不同组(或者类)所占的比例进行比较

条形图

对大小进行比较,但更精确、更灵活

注意频数和百分比同时展示

可以在一张表中体现多批数据:

- 堆积条形图

- 分段条形图

直方图

用来体现分组数据

长方形之间没有间隔

面积与频数成比例

- 长方形面积 = 每组频数

- 频数 = 长方形宽度 ✖ 长方形高度

- 频数密度 = 频数 / 组距

累计频数

到某个特定数值为止的总频数,频数的累计总和

折线图

体现趋势

不要使用折线图显示类别数据

2、集中趋势的量度

均值

与平均数的不同:平均数不止一种,包括均值、中位数、众数

Σx(sum,读作“西格玛”) = X₁ + X₂ + ··· + Xn

μ(均值,读作“Mu”) = Σx / n

处理频数(f代表频数)相关的均值:

Σfx = f₁*X₁ + f₂*X₂ + ··· + fn*Xn

Σf = f₁ + f₂ + ··· + fn

μ = Σfx / Σf

关注重要统计量

- 异常值

与其他数据格格不入的极高或极低的数值 - 偏斜数据

- 向右偏斜

右侧有一条尾巴,有偏大异常 - 向左偏斜

左侧有一条尾巴,异常值位于低端

- 向右偏斜

中位数

在数据由于异常值而发生偏斜时使用

- 排列

- 计算(n+1)/ 2,取数或左右两侧平均值

众数

众数可能不止一个

众数不仅能用于数值型数据,也是唯一能用于类别数据的平均数

3、分散性与变异性的量度

分散性

量度全距

也叫极差:上界 -下界

仅仅描述了数据宽度,并没有描述数据的分布形态,无法摆脱异常值的影响

四分位数

- 升序排列

- 四个相等的数据块,各包含四分之一的原有数据

- Q1:下四分位数,第一四分位数,最小的四分位数

"n ÷ 4"(向上取整),和下一个数的平均值 - Q3:上四分位数,第三四分位数,最大的四分位数

"3n ÷ 4"(向上取整),和下一个数的平均值 - Q2:中位数

"n ÷ 2"(向上取整),和下一个数的平均值

四分卫距(IQR):Q3 - Q1

四分卫距仅使用了中间50%的数据,如此将异常值弃而不用

百分位数

- 升序排序

- 第K百分位数的位置:K*(n/100)

箱线图

变异性

方差

度量数据分散性的一种方法,数值与均值的距离的平方数的平均值

σ² = Σ(x - μ)² / N

σ² = ( Σx² / N ) - μ²

标准差

方差(σ²)的平方根

σ(标准差,读作“西格玛”) = √方差

标准分

比较不同数据集中的数值分布

将几个数据集转换成通用分布,均值为0,标准差为1

标准分 = 距离均值的标准差个数

z(标准分) = (x - μ) / σ

标准差检测异常值:偏离均值超过三个标准差的数值

4、概率计算

维恩图

概率树

概率

P(A) = n(A) / n(S)

- P(A):发生事件A的概率

- n(A):发生事件A的可能数目

- n(S):概率空间,样本空间,所有可能结果的数目

交集 和 并集

交集 ∩ 表示"与"

并集 ∪ 表示"或"

P(A∪B) = P(A) + P(B) - P(A∩B)

对立事件(穷举事件)

A'是A的对立事件,即事件A不可能发生的事件

P(A') = 1 - P(A)

P(A∪A') = 1

互斥事件

如果两个事件互斥,则这两个事件有不可能同时发生

P(A∩B) = 0

P(A | B) = 0

P(B | A) = 0

穷举事件

P(A∪B) = 1

相交事件

如果两个事件相交,则这两个事件有可能同时发生

条件概率

P(A|B):在已知B发生的条件下A的概率

- P(A|B) = P(A∩B) / P(B)

- P(A∩B) = P(B) × P(A|B) = P(B∩A) = P(A) × P(B|A)

全概率

根据条件概率计算一个特定事件的全概率

P(B) = P(A∩B) + P(A'∩B)

P(A∩B) = P(A) × P(B|A)

P(A'∩B) = P(A') × P(B|A')

P(B) = P(A) × P(B|A) + P(A') × P(B|A')

贝叶斯定理

一种计算逆条件概率的方法:在需要求出条件概率,且该条件概率与已知条件概率顺序相反时用

相关事件 与 独立事件

如果几个事件互有影响,则为相关事件

如果几个事件互不影响,则为独立事件

建议:不要用维恩图来思考独立性,因为一张维恩图中,两个事件肯定会有影响;独立事件是两张独立的维恩图;

独立事件

P(A|B) = P(A)

- P(A|B) = P(A∩B) / P(B)

- P(A) = P(A∩B) / P(B)

- P(A∩B) = P(A) × P(B)

独立事件 vs 互斥事件

如果A和B是互斥事件,即如果A发生,则B不发生,这是一种相关关系,二者不是独立事件;反之,如果A和B是独立事件,则二者不会互斥。

5、离散概率分布的运用

期望 和 方差

E(X) = μ = Σ(x * P(X=x))

E(f(X)) = Σ(f(x) * P(X=x))

E(X²) = Σ(X² * P(X=x))

Var(X) = σ²

Var(X) = E(X - μ)²

Var(X) = E(X²) - μ²

Var(X) = Σ((x - μ)² * P(X=x))

线性变换

变量X按照aX + b的形式发生变换(改变基础数据)

E(aX + b) = aE(X) + b

Var(aX + b) = a²Var(X)

独立观测值

这些观测值都有相同的概率分布

E(X₁ + X₂ + ··· + Xn) = nE(X)

Var(X₁ + X₂ + ··· + Xn) = nVar(X)

独立的随机变量

这些观测值相互独立,没有关系

E(X + Y) = E(X) + E(Y)

E(X - Y) = E(X) - E(Y)

Var(X + Y) = Var(X) + Var(Y)

Var(X - Y) = Var(X) - Var(Y)

线性变化 + 加减运算

E(aX + bY) = aE(X) + bE(Y)

E(aX - bY) = aE(X) - bE(Y)

Var(aX + bY) = a²Var(X) + b²Var(Y)

Var(aX - bY) = a²Var(X) + b²Var(Y)

6、排列与组合

排位

n 个独立对象的可能的排列方式

阶乘 n! = n × (n-1) × (n-2) × ··· × 3 × 2 × 1

圆形排位

不在意名次,只在意顺序

(n-1)! = (n-1) × (n-2) × ··· × 3 × 2 × 1

按种类排位

需要清点n个对象的排位方式,但有k个对象是类似的(不关注内部排位)

需要清点n个对象的排位方式,第一类对象有k个,第一类对象有j个···

排列

从n个对象中选取出r个对象

组合

从n个对象中选取出r个对象,但不关注r个对象的顺序

7、几何分布、二项分布、柏松分布

离散型概率分布

- r发生的概率:

| 几何分布 | 二项分布 | 泊松分布 | |

|---|---|---|---|

| 定义 | 进行多次独立的实验,每一次实验都存在成功或失败的可能,问题:为了取得第一次成功需要进行多少次实验 | 进行固定次数的独立实验时,每次都存在成功或失败的可能,问题:成功的次数 | 已知λ为给定时间或空间的事件发生频次,问题:发生特定频次的概率 |

| 表示方式 | X ~ Geo(p) | X ~ B(n,p) | X ~ Po(λ) |

| 概率P(X=r) | P(X=r) = p * qr-1 P(X>r) = qr P(X≤r) = 1 - qr |

nCr * pr * qn-r | |

| 期望E(X) | 1/p | np | λ |

| 方差Var(X) | q / p² | npq | λ |

注:

- 二项分布是唯一与比例有关的分布

- 泊松分布:对独立随机变量进行组合

如果X ~ Po(λ)且Y ~ Po(λ),则:

X + Y ~ Po(λx + λy)

- 泊松分布与二项分布有何关系

如果X ~ B(n,p),当n较大而p较小时(np与npq值近似),X可以近似表示为:

X ~ Po(np)

8、正太(高斯)分布的运用

连续性概率分布

连续数据包含了一个数据范围,这个数据范围内的数值都可能发生;

概率密度函数

描述连续随机变量的概率分布;特定数值范围的概率大小,通过概率密度线下方的面积表示;面积之和等于1

正太分布

钟形曲线,曲线对称,中央部位的概率密度最大;均值和中位数位于中央,具有最大的概率密度;

正太分布通过参数μ和σ²进行定义:

X ~ N(μ,σ²)

- μ:指出曲线的中央位置

- σ²:指出分散性

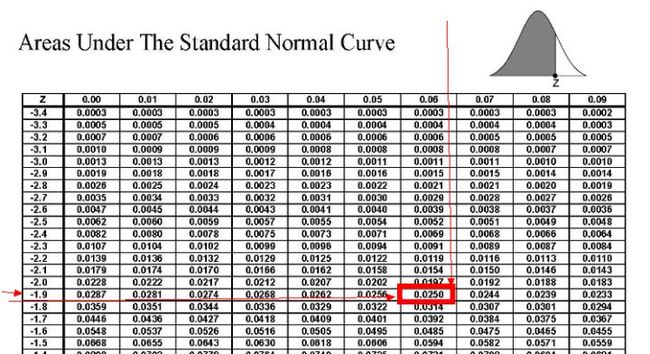

正太概率计算三部曲

- 确定μ和σ²

- 使其标准化

- 查找概率

标准化(Z为标准分,说明了数值与均值相距多少个标准差):

求解P(a P(a 如果X ~ B(n,p),当np>5,nq>5,X可以近似表示为: 如果X ~ Po(λ)且λ>15,则X可以近似表示为: 二项分布、泊松分布是离散分布,正态分布是连续分布,用正态分布近似替代需要连续性修正 样本均值被称为总体均值的点估计量,点估计量可以近似总体参数 μ:总体均值 p:成功事件的比例 已知总体满足x ~ B(n,p),则 所有样本比例的分布,称作“比例的抽样分布”,或者称作“Ps的分布”,用来描述每个样本的比例形成的抽样分布;即用它来求出从一个已知总体中取出的某个样本的比例的概率。 注:只有二项分布适用;比例标准误差指出期望的样本比例与总体比例真值的差距。 当n很大时(n>30),ps 的分布接近正态分布: Ps ~ Ps 需要进行连续性修正 如果每个总体的np和nq都大于5,则可以近似于正太分布: 已知总体的均值μ和方差σ²,取n个样本从X1到Xn,每一个Xi的期望都是μ,方差都是σ²;可以用表示这n个样本的均值。所有样本的期望符合正态分布。 则所有样本均值的均值 则所有样本均值的方差 样本均值与μ的可能偏离距离 如果已知总体方差和,则符合正太分布: 如果,则 当n很大时,仍然可以用正太分布近似 注:中心极限定理无需进行连续性修正 点估计是有价值的,但是存在误差 选择a和b,使得该区间中包含总体均值(比例)的概率为m,(a,b)为置信区间: P(a < μ < b) = m 求解置信区间四步骤(已总体均值μ为示例): 其中不知道总体方差σ²的真实值,用它的点估计量s²进行估计: 分布形态: 根据置信区间(假设m=0.95)和概率表,求Z值的范围。 指的是样本均值的分布,可以用样本的值。 注: 置信区间 = 统计量 ± (误差范围) 并非任何情况都能用正太分布进行良好的近似,原因有二: 当总体符合正态分布,σ²未知,且样本很小时,符合t分布 因此置信区间上下限为: 则t分布的上下限 假设检验:做出假设或检验,对照证据进行检验 假设检验6步骤 根据原假设H0选择检验统计量,即一个分布。 c:拒绝域的分界点,临界值,需要确认的值 P(X < c) < α :左尾检验 p值即为取得样本中的各种结果或取得拒绝域方向上的某些更为极端的结果的概率。 P(第一类错误) = α 前提:H1需要规定了唯一特定的值 假设检验的功效:在H0为假的情况下拒绝H0的概率。 功效 = 1 - β X²分布,“卡方”分布,通过一个检验统计量来比较期望结果和实际结果之间的差别;X²越小,观察频数和期望频数之间的总差值越小。 表示自由度 = (组数)-(限制组数) 以显著性水平α进行检验,拒绝域位于上尾,检验统计量数值越大,观察频数和期望频数之间的差异越大: 根据自由度和显著性水平α,得到频数的临界值和拒绝域 没有期望频数,生成期望频数: 期望频数 E = * 列合计 自由度 = (行数-1)*(列数-1) 散点图指出模式 要将误差最小化 误差平方和 SS-E = 决定系数以r2或R2表示,可以用x变量进行解释的y变量的变异百分数。有两种计算方式,结果相同 将其转换为线性关系: y' = bx' + a

9、再谈正太分布的运用

X 概率变化

X + Y

X - Y

aX + b

X₁ + X₂ + ··· + Xn

~

~ N(μ,σ²)

~ N(μ,σ²)

~ N(aμ+b,a²σ²)

~ N(nμ,nσ²)

μ

μx + μy

μx - μy

aμ+b

nμ

σ²

σx² + σy²

σx² + σy²

a²σ²

nσ²

二项分布的近似

X ~ N(np,npq)泊松分布的近似

X ~ N(λ,λ)连续性修正

如果求P(X≤a),实际上需要计算P(X

如果求P(X≥a),实际上需要计算P(X>a - 0.5)

如果求P(a≤X≤b),实际上需要计算P(a - 0.5 < X < b + 0.5)适用正太分布的经验法则

适用于任何分布的切比雪夫定理

10、统计抽样的运用

抽样三要素

抽样方法

11、总体和样本的估计

均值

方差

预测总体比例(二项分布适用)

为样本计算概率:已知总体参数

比例的抽样分布

Ps符合什么分布

X的正太连续性修正为±(1/2);Ps = X/n

抽样分布 — 两个比例之间的差异

均值的抽样分布

可以利用从所有可能样本得出的所有样本均值形成一个分布,叫“均值的抽样分布”,或叫做的分布。

其中:

抽样分布 — 两个均值之间的差异

如何分布

如果X符合正态分布,则均符合正态分布

如果X不符合正态分布

中心极限定理:如果从一个非正太总体X中取出一个样本,且样本很大,则的分布近似为正态分布。使用中心极限定理

总体X ~ B(n,p),μ = np,σ² = npq,如果n大于30,则:

总体X ~ Po(λ),μ = λ,σ² = λ,如果n大于30,则:

12、置信区间的构建

置信区间

1.选择总体统计量

目标:为总体均值μ构建一个置信区间,即求a、b

2.求解其抽样分布

已知均值的抽样分布和方差:

如果X~N(μ,σ²),且样本容量很大,则也符合正态分布。

3.决定置信水平

4.求解置信区间上下限

先求Z值:

置信区间的简便算法

总体统计量

总体分布

条件

置信区间

μ

正太

σ²已知

n可大可小

为样本均值

μ

非正太

σ²已知

n很大(至少30)

为样本均值

μ

正太或非正太

σ²未知

n很大(至少30)

为样本均值

为样本方差

p

二项

n很大(至少30)

为样本比例

p

泊松

λ为期望

λ为方差

置信区间 = 统计量 ± (c × 统计量的标准差)

C值取决于置信水平t分布

t分布只有一个参数(称为自由度),。

t分布的标准分

P(-t ≤ T ≤ t) = 置信区间

总体统计量

总体分布

条件

置信区间

μ

正太或非正太

σ²未知

n很小(小于30)

为样本均值

为样本方差

13、假设检验的运用

1-确定要进行检验的假设

进行假设检验时,假定原假设为真;如果有足够的证据反驳原假设,则拒绝原假设,接受备择假设。2-选择检验统计量

3-确定要用于做决策的拒绝域

α:显著性水平,希望在样本结果的不可能程度达到多大时,就拒绝原假设H0

P(X > c) < α :右尾检验

P(X < c1) < α/2 和 P(X > c2) < α/2 :双尾检验

如果备择假设包含一个<符号,则使用左尾4-求出检验统计量的p值

5-查看样本结果是否位于拒绝域内

6-做出决策

假设检验的功效

接受H0

拒绝H0

H0真

√

第一类错误

H0假

第二类错误

√(检验的功效)

P(第二类错误) = β第二类错误计算

检验的功效

14、X²分布

X²分布的俩个主要用途

X²分布用到一个参数

先高后低的平滑曲线

随着越来越高,接近正太分布

拟合优度

自由度

分布

条件

二项分布

已知p

未知p,必须通过观察频数进行估计 = n-1

= n-2

泊松分布

已知λ

未知λ,必须通过观察频数进行估计 = n-1

= n-2

正太分布

已知μ和σ²

未知μ和σ²,必须通过观察频数进行估计 = n-1

= n-3检验独立性

A

B

C

合计

x

Ax

Bx

Cx

行合计x

y

Ay

By

Cy

合计y

z

Az

Bz

Cz

合计z

列合计

A合计

B合计

C合计

总和

自由度

15、相关与回归

两个变量之间存在相关关系并不一定意味着一个变量会影响另一个变量,也不意味着二者存在实际关系。

y = bx + a,最小二乘回归法

回归线需穿越()

用相关系数 r 衡量直线与数据的拟合度

最小二乘回归法的其他公式

决定系数

非线性关系

回归线斜率的置信区间